今天凌晨,微软研究院开源了创新音频模型VibeVoice-1.5B。

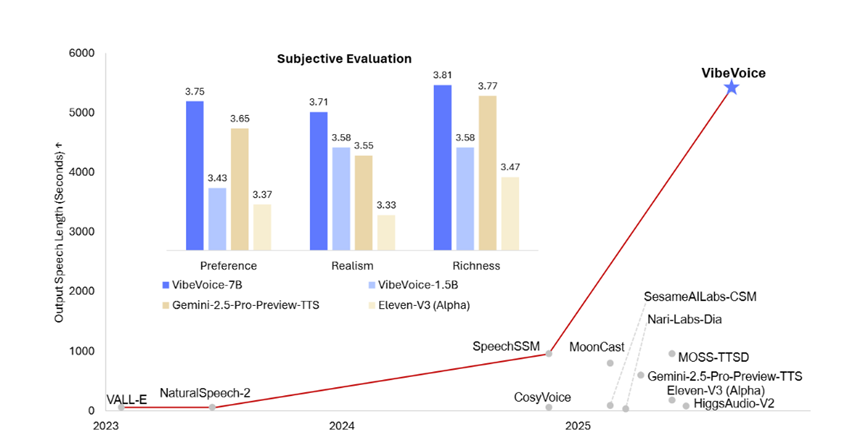

VibeVoice-1.5B开创了语音界多个重大技术突破:一次性可连续合成90分钟超长逼真语音,之前多数模型只能合成60分钟以内语音,并且30分钟后会出现音色漂移、语义断裂等难题;

最多支持4名发言人,而之前开源的SesameAILabs-CSM、HiggsAudio-V2等知名模型最多支持2人;可对24kHz原始音频实现3200倍累计压缩,并且压缩效率是主流Encodec模型的80倍,同时仍能保持高保真语音效果;

以往TTS模型多依赖单一tokenizer提取特征,非常容易出现音色与语义不匹配,微软通过首创双tokenizer协同架构成功解决这一难题。

VibeVoice案例

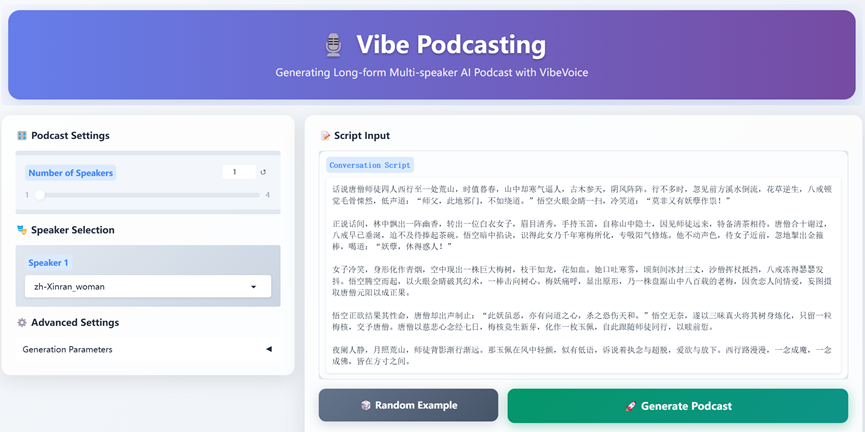

下面就为大家展示一下VibeVoice神奇的语音效果。

93分钟超长合成语音,一共四位演讲者,两男两女。

这个是老外教英语的音频播客,有背景音乐、有英语到汉语的转换,整个流程非常丝滑。如果不告诉你,能听出来这是语音合成的嘛?

这个是「AIGC开放社区」根据demo测试的效果,主要是根据西游记二创了一段。使用了单一女性演讲。

这个是带背景音乐的科技资讯介绍GPT-5正式发布,一共有3位演讲者,两男一女。

关于体育资讯,主要讨论谁是篮球界的扛把子。一共两位演讲者,一男一女。

一段拟人化的语音效果,主要体现这个模型强大的拟人化情绪效果,一男一女两个人。

VibeVoice架构简单介绍

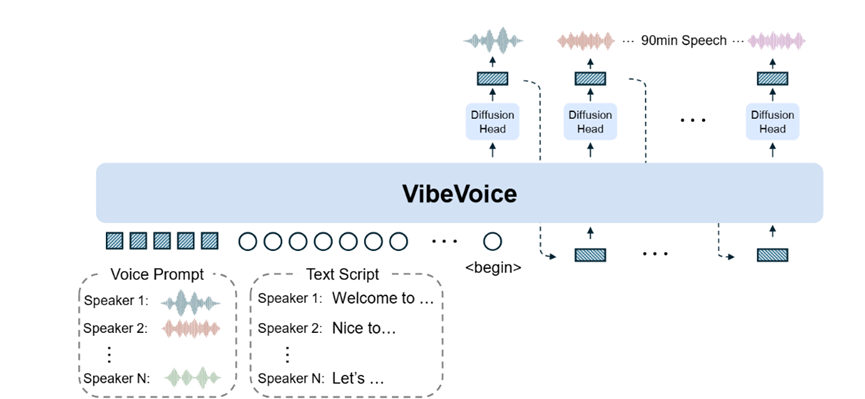

VibeVoice首创了双语音tokenizer模块,声学tokenizer与语义tokenizer,两者各有分工又相互配合,为后续的建模提供高效压缩且语义与声学对齐”的混合特征。

声学tokenizer承担保留声音特征并实现极致压缩的核心任务,其架构采用基于变分自编码器的对称编码-解码结构,这种设计既解决了传统变分自编码器在自回归建模中容易出现的方差坍缩问题,简单说就是数据多样性丢失,又通过层级化的下采样实现超高压缩率。

声学编码器部分包含7个阶段的改进版Transformer模块,和传统Transformer依赖的自注意力模块不同,该模块采用1D深度可分离因果卷积,这种设计不仅支持流式处理,也就是一边接收音频一边进行特征提取,避免长音频全部加载进来导致内存不够用,还能有效捕捉音频的时间顺序关联性;

通过6个下采样层逐步降低数据维度,最终将24kHz采样率的原始音频转化为每秒仅7.5个潜在向量的形式,实现3200倍的累计压缩率,并且每个编码器与解码器组件的参数规模控制在3.4亿左右,兼顾了处理效率与性能。

在训练方面,声学tokenizer参考DAC框架的训练目标,引入生成器与判别器双损失机制,生成器负责确保音频重建质量,判别器则通过区分合成音频与真实音频来优化细节保真度,同时其变分自编码器设计采用固定方差分布策略将方差定义为预先设定的正态分布,一种常见的数据分布形态,而不是传统变分自编码器中的可学习参数,通过特定计算方式确保潜在向量始终保持足够的多样性,为长音频生成的多样性与稳定性打下基础。

和声学tokenizer聚焦声音特征不同,语义tokenizer的核心目标是提取与文本语义对齐的特征,解决传统单一tokenizer容易出现的音色与语义脱节问题,比如悲伤的文本用欢快的语调合成。它的架构与声学tokenizer的编码器部分完全对应,同样包含7个阶段的改进版Transformer模块与1D深度可分离因果卷积,但关键区别在于去掉了变分自编码器组件,因为语义特征需要具备确定性,以确保文本与语音的语义一致。

在训练方式上,语义tokenizer没有采用音频重建目标,而是以自动语音识别为代理任务:训练过程中,编码器输出的语义特征会输入到一个临时的Transformer解码器中,这个解码器的任务是根据语义特征预测对应的文本内容,通过这种方式强制语义特征与文本语义深度绑定;等训练完成后,用于预测文本的Transformer解码器会被舍弃,只保留编码器作为语义特征提取器,这样做既实现了语义与文本的对齐,又通过移除多余模块将语义tokenizer的推理速度提升40%,避免给长音频处理增加额外的计算负担。

作为架构的上下文理解与决策核心,VibeVoice选用预训练的Qwen2.5大语言模型作为序列建模主体,核心作用是解析复杂的用户输入包括多个说话人的语音提示、文本脚本以及角色分配,并生成能够引导后续扩散生成的上下文隐藏状态。

为了适配多说话人长音频场景,VibeVoice对大语言模型的输入形式进行了针对性设计:输入序列采用“角色标识-语音特征-文本脚本”交错拼接的格式,具体表现为[说话人1:语音特征1,说话人2:语音特征2,……,说话人N:语音特征N]与[说话人1:文本脚本1,说话人2:文本脚本2,……,说话人N:文本脚本N]的组合,其中语音特征是语音提示经声学tokenizer编码后的潜在向量,文本脚本是对应角色的文本内容经过分词处理后转化为嵌入向量,而说话人k作为角色标识标签,能让大语言模型精准关联“某段文本应该由哪个说话人的音色生成”,从而实现多说话人的自然轮替。

在模型训练与优化方面,VibeVoice采用课程学习策略将大语言模型的输入序列长度从初始的4096个token逐步增加到65536个token,对应24千赫兹采样率下90分钟的音频长度,避免模型因为一开始就处理超长序列而出现训练失败。

为了提升训练效率,预训练完成的声学tokenizer与语义tokenizer参数在整个训练过程中保持不变,只更新大语言模型与后续扩散头的参数,这样做使训练周期缩短50%,还能确保特征提取模块的稳定性。

值得一提的是,VibeVoice-1.5B只是试水,未来微软还会开源一个更大参数的语音模型。