行业巨头重金押注,数据中心网络“以光换电”已成必答题。

作者 | 陈骏达

编辑 | 漠影

在上周举办的中国家电及消费电子博览会(AWE)上,一项以OCS(光路交换)重塑智算网络架构的最新成果,宣告落地。

上海仪电联合曦智科技、壁仞科技、中兴通讯发布了“光跃超节点128卡商用版”,实现长期稳定训练状态,带动模型训练性能显著提升,传输延迟相较传统电交换降低90%以上。

该超节点以曦智科技全球首创的硅光OCS光交换芯片为核心,最初在去年7月的WAIC大会上发布,仅用半年多时间,便实现从概念验证到实际商用的跨越。这也是国内首个端到端OCS批量部署方案。

此外,这一方案成功了适配阶跃星辰、DeepSeek等多个国产大模型,验证了其成为高性价比、高能效国产算力解决方案的潜力。

面对大模型训练中传统电交换网络日益严峻的功耗和延迟困境,拥有低功耗、低延迟和调度灵活性的OCS技术,正成为突破算力效能天花板的关键抓手。

01.

传统电路交换网络功耗问题难解

OCS如何成为AI时代的“破壁者”

首先要承认一个事实,当前在数据中心中,传统的电分组交换(Packet Switch)仍然是主流。这主要是因为其技术成熟、生态完善。

从原理上来看,在交换数据时,电分组交换机首先将来自光纤链路的光信号通过光模块转换为电信号,然后在交换芯片中对数据包进行解析与转发,最后再通过光模块将电信号重新转换为光信号并发送。

整个过程依赖“光-电-光”(O-E-O)的转换与电子交换芯片完成数据处理,光模块把光信号转换为电信号,由交换芯片完成读取、缓存与路由,再通过光模块重新转回光信号继续发送。

可以把它理解为一个繁忙的铁路货运站。当满载数据的列车到达时,必须进站停车,将货物卸下、分拣、重新编组到另一列车上,再发车出站。列车在站内的每一次停顿、装卸设备的持续运转,都带来更高的延迟与能耗。

以此类网络中常见的400G光模块(光电转换器件)为例,其功耗大约为10W左右,传输1比特(bit)数据所消耗的能量大约为25皮焦耳(pJ)。再加上交换机内部负责处理信号的SerDes芯片本身的功耗,总能耗可轻松超过30 pJ/bit。更先进的800G模块虽然在能效上有所提升,但单位能耗仍维持在15–20 pJ/bit的量级。

在超大规模数据中心中,这种能耗将迅速累积,不仅显著增加运营成本,也给散热和系统设计带来巨大压力。

这正是OCS(Optical Circuit Switch)能发挥价值的场景。

OCS可以在物理层直接改变光信号的传播路径。当数据流到达交换节点时,无需像电交换那样经历复杂切换过程,只需要调整方向,就能把光信号直接引导到目标链路上,从而建立一条端到端的光通路。

它更像是在铁路网络中部署了一套智能道岔系统。光列车无需进站停车,直接切换轨道方向,保持高速直通状态。虽然维持这个“道岔”系统的运行仍需要能量,但与O-E-O转换相比,其能耗降低了几个数量级,理论上能做到fj/bit(1000fj=1pj)量级。

除了能耗与延迟之外,OCS还在带宽、可靠性、兼容性方面具有优势。它不受电子交换芯片端口速率和SerDes速率的限制,可更轻松地支持高带宽的数据传输;也不依赖于特定的数据传输协议,可无缝兼容不同厂商使用的互连协议,消除生态锁闭风险。

同时,OCS可以在物理层快速重新建立光路。当某条链路或设备出现故障时,网络能够在几秒内通过重新配置光通路绕过故障路径,从而提高网络的整体稳定性和容错能力。

02.

OCS技术路线分立

中国玩家探索现实可行方案

OCS的优势明显,但其技术门槛高、涉及多学科交叉。不同厂商和研究机构正基于各自的技术积累与产业生态进行探索:有的延续传统光通信中的MEMS光开关路径,有的尝试基于硅光波导实现高度集成化的光交换,还有一些方案则采用液晶、压电陶瓷等光学调控技术。

在这些技术路径中,MEMS(微机电系统)OCS是目前相对成熟的一类方案。该方案通过微型可动反射镜阵列改变光束传播方向,实现端口之间的光路重构。

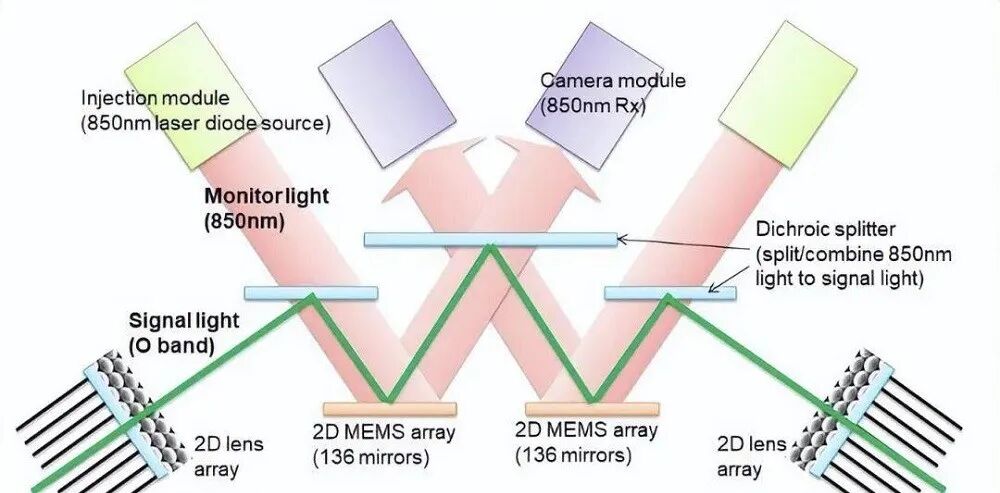

谷歌是全球范围内唯一完成OCS大规模量产部署的公司,已有10年左右的研发经验,其方案基于MEMS。结合谷歌开发的全栈软件,这一方案极大提高了TPU训练集群的数据交换效率。

▲谷歌的MEMS光交换方案

▲谷歌的MEMS光交换方案MEMS方案的优势在于端口规模大、光学性能稳定;但其也存在一定局限,例如机械结构带来的切换速度限制(目前为毫秒级)、器件体积较大以及系统封装复杂度较高、价格昂贵等。

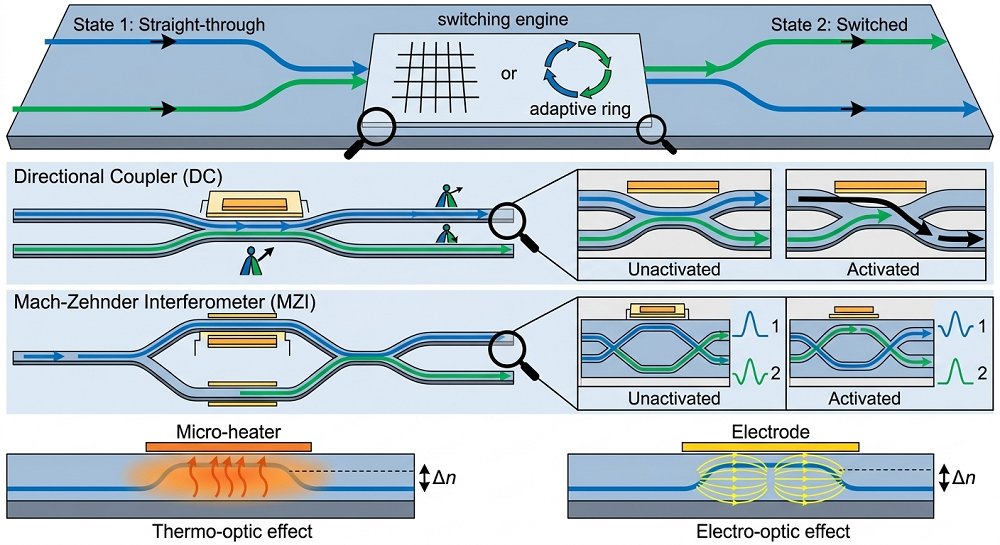

另一条备受关注的路线是硅光(Silicon Photonics)OCS。该方案利用硅基波导等器件在芯片上实现光信号的路由与切换。相比MEMS依赖微机械结构的方式,硅光方案没有机械运动,切换速度可达微秒甚至纳秒级。

一些初创公司正在推动硅光OCS的发展,例如国内的曦智科技等企业。曦智打造了全球首创的基于硅光子技术的OCS光交换芯片,相关研究论文被国际通信网络领域顶级会议SIGCOMM 2025接收。

硅光OCS还能够依托成熟的CMOS制造工艺实现规模化生产,并具备更好的集成度和潜在的成本优势。但在光损耗控制以及热串扰问题等方面,还有优化空间。

除了MEMS和硅光之外,OCS领域还存在一些其他技术路线,例如基于液晶材料调控光路的方案,以及利用压电陶瓷驱动光学结构改变传播路径的方案等。这些技术各有特点,在切换速度、稳定性或成本方面提供了不同的工程权衡。

总体而言,OCS领域正处于“多路线并行探索”的阶段,各种技术在端口规模、切换速度、能效与可制造性之间不断寻找平衡,尚未出现绝对主导路线,未来很可能会在不同应用场景中形成多种技术并存的格局。

而结合国内当前的发展阶段与技术环境,依托成熟半导体制造体系的硅光路线,在产业链协同和规模化制造方面具备一定现实优势,也因此成为曦智等国内企业重点探索的方向之一。

03.

硬件落地先行、软件生态跟进

OCS不再是“选答题”

在智东西与曦智科技CEO沈亦晨的沟通中,我们了解到,过去半年,曦智科技从软件和硬件两个方面双管齐下,推动光互连光交换超节点的商用落地。

研发过程中,团队面临了巨大的工程挑战。比如,在初期他们遇到了光信号连接不稳定、传输切换不如理论预期顺畅等问题。为了解决这些问题,曦智科技联合GPU厂商和服务器厂商,组建了庞大的技术团队,通过大量的调优,最终实现了稳定部署的质变。

此外,曦智开发了光交换相关的配套软件,并与GPU和服务器厂商等生态伙伴一道完善配套软件生态。

对于“铜退光进”的演进,业界已经形成了基本共识。2025年底,市场调研公司Cignal AI发布了最新的OCS市场报告,这份报告的核心是:随着超大规模数据中心和AI算力中心部署,OCS的角色从验证逐渐过渡到大规模试点与商用,其部署范围扩展至谷歌以外的更多厂商、更多应用场景,OCS的总市场规模到2029年将至少达到25亿美元。

英伟达这样的头部玩家正在用行动投票。本月,英伟达分别向Lumentum(MEMS路径)和Coherent(液晶路径)这两家专注于OCS技术的企业投资了20亿美元,并签署了多年数十亿美元的采购承诺和未来产能优先获取权,体现出其对OCS的长期看好。

我们也与沈亦晨聊到了英伟达在OCS赛道的这一大动作。沈亦晨称:“2-3年前,曦智便做出判断,未来数据中心30%的芯片都会是光芯片,英伟达也一定会全面拥抱光芯片。”这次英伟达的押注,其实是因为光芯片即将在其产品中“快速起量”,因此需对供应链进行提前布局。

至于不同技术路径的选择,沈亦晨保持了开放的态度。在他看来,不同OCS技术路径虽有具体指标的差异,但核心功能共性高达80%-90%。现阶段的首要任务是将光交换集群从概念变为现实,落地部署大规模光互连光交换集群。

此外,硬件落地是软件优化的前提。只有先拥有一套实体的光交换集群,软件和系统才能针对其特性进行优化。从“电交换”改为“光交换”是软件层面最重要的变革环节,在光交换体系内部,后续对软件层面的优化属于“边际收益(marginal gain)”。

沈亦晨类比道:“与其现在纠结于用哪一种技术路线的电机,不如先让一辆电动车上路。车能上路,配套设施自然就会建起来。”

04.

结语:数据中心网络“以光换电”

中国方案抢占技术高地

OCS技术正以前所未有的方式重塑AI算力基础设施。它不仅在能耗、延迟和带宽上带来质的飞跃,也为下一代超大规模大模型的训练、推理和广泛落地,提供了坚实支撑。

而在OCS加速落地的进程中,以曦智科技为代表的中国企业,正凭借硅光OCS芯片、光跃超节点等创新实践,探索一条自主可控、兼具高性能与高能效的国产算力路线。

沈亦晨透露,未来,除了在训练侧支撑千卡、万卡级别集群之外,曦智也计划扩展128卡商用版本超节点在推理侧的应用。而在今年的WAIC大会上,曦智将会公开下一代光交换集群的方案。