編譯 | 楊蕊伃

編輯 | 漠影

智東西9月4日消息,據BBC 9月3日報道,近期即時通訊軟件Telegram出現了大量使用深度僞造技術的性犯罪事件,這些事件已經影響到了韓國500多所學校。目前,受影響的具體人數尚未確定。據悉,許多涉案的犯罪嫌疑人是青少年。

上周,韓國政界人士和警方承諾將對這些罪行進行徹底調查,並確保將肇事者繩之以法,以做出強有力的回應。

周一,韓國首爾國家警察廳宣佈,將調查Telegram在允許分發非法使用深度僞造技術製作的兒童色情圖片方面的責任。

據《環球時報》援引韓媒報道,針對女性的深度僞造犯罪在韓國日趨猖獗,不僅大學校園中出現此類案件,甚至連中小學、軍隊等場所也成為高發地。社交媒體上,特別是Telegram群組中不斷有受害學校及被害者信息流出。

韓國男性頻頻使用AI技術,將熟人女性的照片換臉到現有的色情視頻中,並在Telegram上進行傳播和戲弄。

此前震驚世界的韓國「N號房」事件,正在頻繁「更新」2.0乃至3.0版本。

一、用戶利用Deepfake AI製造虛假露骨視頻,女性肖像權受到侵犯

上周六,大學生Heejin(化名)收到了一個匿名Telegram消息,聲稱她的照片和個人信息被泄露。對方發送了一張她的照片和一張經過深度僞造技術處理的不雅圖片,後者將她的臉非法合成在了一張具有性暗示的圖片上。

在接受BBC採訪時,Heejin表現的很自責:「我一直在想,是不是因為我把照片上傳到了社交媒體,才導致了這樣的事情。」

事實上,Heejin並不是唯一的受害者。

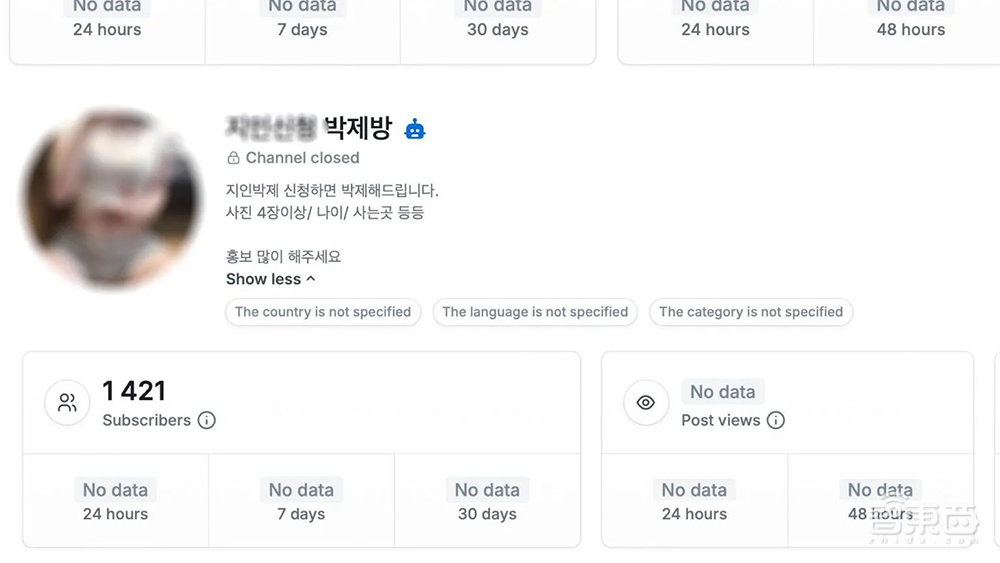

韓國記者Ko Narin在此前的調查中就在Telegram上發現了數十個聊天群組。

在這些群組中,用戶分享他們認識的女性的照片,並使用AI軟件在幾秒鐘內將這些照片轉換成虛假的色情圖片。

Ko告訴我們:「每時每刻都有人上傳他們認識的女孩的照片,並要求將她們變成深度僞造的照片。」

▲深度僞造聊天群組的說明,「如果你要求羞辱某人(進行深度僞造),我們會這樣做。」(圖源:BBC)

此外,Ko還發現,這些群組的目標不僅限於大學生,還包括特定高中甚至初中的學生。

如果很多內容是使用特定學生的圖像創建的,該學生甚至可能擁有自己的「專屬房間」。

這些房間通常被稱為「羞辱室」,它們往往設有嚴格的進入條件。

Ko說:「我對這一過程的系統化和組織性感到震驚。」

她發現的最可怕的事情是,一所學校的未成年學生群組竟然擁有2000多名成員。

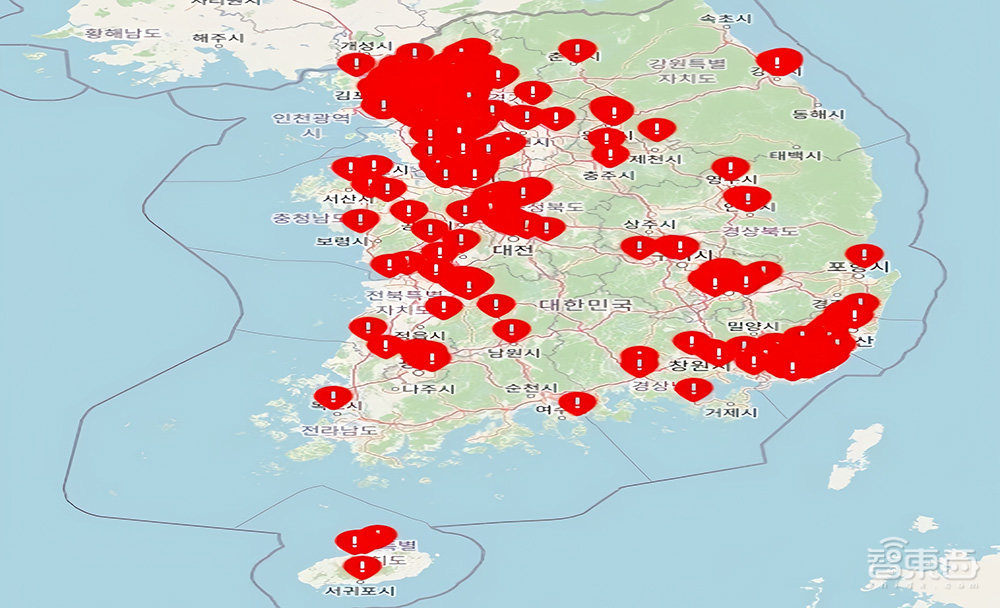

截至上周末,已經有500多所學校被確定受到影響。受影響的實際人數仍有待確定,但據悉許多人的年齡都在16歲以下。

▲截至1日,據信發生了深度僞造性犯罪的韓國學校(圖源:《韓民族日報》)

二、深度僞造犯罪涉案人數約達22萬,民衆擔心受害者規模繼續擴大

Heejin事件後,韓國全國各地的許多女性出於對自己可能成為下一個被利用對象的恐懼,已經從社交媒體上刪除了自己的照片或完全停用了賬戶。

早在此次事件之前,ACOSAV(韓國網絡性虐待受害者維權中心)就已經注意到,深度僞造色情內容的未成年受害者人數急劇上升。

2023年,他們輔導了86名青少年受害者。而今年纔到8月份,這一數字就躍升至238人。上周,在一周內就出現了64名青少年受害者。

對此,ACOSAV呼籲加強立法和公衆教育,以保護未成年人免受此類AI技術的侵害。

據《韓民族日報》報道,截至目前,韓國全國涉及深度僞造犯罪的人數估計可能達到22萬。這種情況導致許多女性感到不安和恐懼。

據悉,深度僞造技術的核心過程主要包括四個步驟:數據收集、模型訓練、Deepfake合成和渲染。

創造深度僞造的核心是生成對抗網絡(GAN),它由兩個神經網絡組成:生成器負責創建虛假圖像或視頻,而鑑別器則評估它們的真實性。

隨着生成器和鑑別器的持續優化,深度僞造越來越難以被肉眼識別。

ACOSAV負責人Park Seonghye表示:「對我們來說,這是一場全面的緊急事件,其緊迫性堪比戰爭時期。隨着最新深度僞造技術的出現,現在僞造的錄像數量遠遠超過了以往,我們擔心這種情況只會愈演愈烈。」

《福布斯》稱,深度僞造技術常將真實人臉疊加在僞造或真實的色情材料上,導致許多年輕女性和女孩成為受害者,這已成為韓國公衆極為憤怒的焦點話題。

▲Deepfake醜聞曝光後,韓國民衆上街表示憤怒(圖源:BBC)

大學生Ah-eun說:「我現在無法確定,是否會有人在我不知情的情況下對我做出不當行為。因此,我在與人交往時變得高度警惕,這並不是一個好現象。」

三、韓國將加大對深度僞造性犯罪的監管力度

韓國女權組織承認,新的AI技術使得剝削受害者變得更加容易。但他們認為,這不過是韓國網絡上最新形式的厭女症的體現。

由84個婦女組織共同簽署的一份聲明中寫道:「造成這一現象的根本原因是結構性性別歧視,而解決之道則是性別平等。」

這是對該國總統尹錫悅的直接批評,他否認結構性性別歧視的存在,削減了對受害者支持團體的資助,並正在廢除政府的性別平等部。

此前,也有人批評韓國對深度僞造犯罪者的懲罰力度不足。

其中一個主要問題是,大多數犯罪者為青少年,他們在青少年法庭受審,而那裏的判決通常較為寬鬆。

《韓民族日報》稱,韓國性暴力救助中心主任認為,在學校、家庭等日常生活場所,非法拍攝、傳播、合成、性侮辱等現象頻繁發生,嚴重影響了女性的安全感。他強調:「現在是需要通過教育和平台監管等措施,加強組織合作來解決問題的時候了。」

與此同時,韓國政府表示將加強對創建和分享深度僞造圖像行為的刑事處罰,並計劃對那些觀看非法色情內容的人實施懲罰。

結語:深度僞造圖像日趨逼真,業界積極開發檢測工具以提升識別能力

Deepfake技術在近年來得到了迅速發展,從最初的簡單換臉到能夠生成百萬像素級別的深度僞造圖像,技術的進步使得僞造圖像和視頻變得越來越逼真。

不止在韓國,深度僞造性犯罪在全球範圍內都頻繁發生。

用戶利用深度僞造技術生成的圖像絕大多數是針對年輕女性和未成年女孩,其內容涉及性侮辱、兒童性虐待等。

為了應對深度僞造技術帶來的威脅,AI社區正在開發更高級的檢測工具,以降低用戶使用深度僞造技術犯罪的可能性。

這些檢測工具運用機器學習算法分析視頻和圖像,以尋找僞造內容的跡象,包括不自然的面部動作、異常的光照模式,以及背景中的不一致性。