4月23日,快手Kwaipilot團隊發布全新大模型訓練方法SRPO並宣佈開源。該方法僅用 GRPO 1/10的訓練成本,在數學與代碼雙領域基準測試中實現性能突破:AIME2024 得分50,LiveCodeBench 得分41.6,成為業界首個在兩大專業領域同時復現DeepSeek-R1-Zero 的方法。

快手 Kwaipilot 團隊在最新研究成果《SRPO: A Cross-Domain Implementation of Large-Scale Reinforcement Learning on LLM》中提出了一種創新的強化學習框架 —— 兩階段歷史重採樣策略優化(two-Staged history-Resampling Policy Optimization ,SRPO),這是業界首個同時在數學和代碼兩個領域復現 DeepSeek-R1-Zero 性能的方法。通過使用與 DeepSeek 相同的基礎模型 (Qwen2.5-32B) 和純粹的強化學習訓練,SRPO 成功在 AIME24 和 LiveCodeBench 基準測試中取得了優異成績(AIME24 = 50、LiveCodeBench = 41.6),超越了 DeepSeek-R1-Zero-32B 的表現。更值得注意的是,SRPO 僅需 R1-Zero 十分之一的訓練步數就達到了這一水平。

圖:SRPO AIME24 和 LiveCodeBench 表現,每項為 pass@1 的32 次平均得分

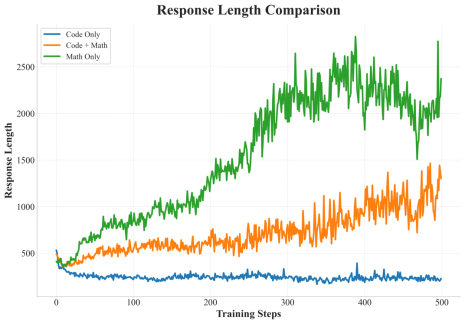

技術報告中,快手Kwaipilot團隊實現了一種兩階段訓練範式,有效解決數學和代碼之間內在的響應長度衝突問題。實驗表明,兩階段訓練在數學和編程領域均表現出優異的結果。該模型在解決數學問題時始終如一地生成詳細的逐步推理模式,並在處理編程任務時生成結構化的推理模式。

圖:不同訓練數據策略對響應長度的影響

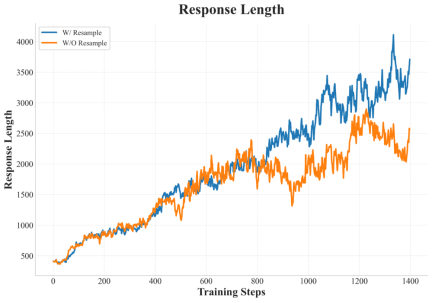

在訓練的中後期階段,快手 Kwaipilot 團隊創新性地引入了歷史重採樣(History Resampling)實現動態採樣,確保了在每個訓練步驟中梯度更新始終有效,從而直接提高了信息梯度的比例。與DAPO中提出的Dynamic Sampling方法相比,History Resampling顯著提高了計算效率,響應長度增長也更加穩定。

圖:Training statistics of History Resampling

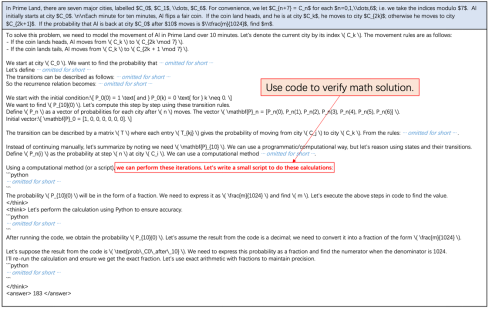

更令人驚喜的是,在訓練過程中模型的自我反思、糾正和回溯頻率逐漸增加,在訓練後期,模型已經會藉助程序性思維進行自我糾錯和多次嘗試,掌握了廣泛思考和綜合運用多種代碼思維進行問題求解的能力。

目前,快手Kwaipilot團隊已將SRPO-Qwen-32B模型開源,希望這一成果能夠為社區在構建更強大的推理模型方面提供有力支持。未來,他們將持續探索數據與模型的擴展、更高效的強化學習算法以及SRPO在更廣泛的推理場景中的應用。