AI圈子最有意思的事,已經不是「誰家模型參數最多」,而是——誰家小模型,能把大模型打趴下。

最近,微軟研究院開源了一款「小而強」的研究:Phi-4-reasoning-plus。這是一款專為深度結構化推理任務設計的開源語言模型。

14B參數,不到DeepSeek 70B的五分之一,但數學、科學、代碼、邏輯推理的表現,都比較能打。

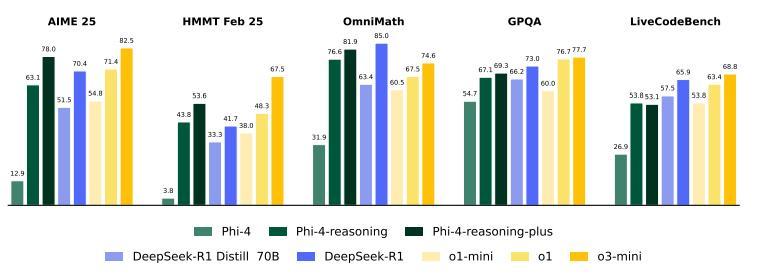

在AIME 2025數學考試上,14B的小模型,第一次嘗試的全題正確率,居然幹過了70B的精煉大塊頭,甚至快摸到DeepSeek 671B的腳後跟。

微軟團隊用一串「推理鏈」打破了常規,讓AI學會慢下來、囉嗦一點、反覆琢 磨、允許自己犯錯,主要體現在:

推理鏈(Chain-of-Thought)成為核心訓練目標 。不是像傳統大模型那樣直接給出答案,而是專門訓練模型寫「推理過程」;在訓練數據和輸出裏,強制要求模型用<think>...</think>標籤,把自己的思考、分步推理、反覆驗證詳細寫出來。這種推理鏈往往很「囉嗦」:不是一句話解決問題,而是像人類一樣,細緻分解、逐步排查。

鼓勵「慢思考」,獎勵囉嗦的推理過程。 在RL(強化學習)階段,獎勵機制被專門設計成:答錯時鼓勵更長推理鏈,答對時鼓勵簡潔;只要模型沒答對,就鼓勵它「多想兩步」,推理過程可以更長、更詳細,甚至反覆自我否定和修正。

結果?不僅答案對,思路也清晰。

技術報告裏有個細節特別有意思:Phi-4-reasoning的推理鏈,不是越長越好,也不是越短越強,而是「啱啱好」地模擬了人類的「思考長度」。

RL階段的獎勵模式具體是:「答對了要簡潔,答錯了反而鼓勵多思考」,而有些任務,答題過程還會「自我否定」,甚至推翻重來。當然,不是所有領域都大幅提升,比如生物、化學、離散數學,AI也會「卡殼」。

Phi-4-reasoning-plus在SFT(有監督微調)之後,還加了一層 基於規則的強化學習 ,獎勵設計也很精妙:

答對了鼓勵簡潔(獎勵簡短推理)

答錯了反而鼓勵囉嗦(獎勵多想一步)

輸出格式不對、思路紊亂要扣分

重複語句有懲罰,鼓勵多樣性和探索

這和傳統RLHF(基於人類反饋強化學習)不同,Phi-4團隊用的是可自動驗證的數學題,獎勵函數直接和推理鏈長度、答案正確性掛鉤,模型被訓練成「有錯就多想、多寫,多步反省」。

Phi-4推理模型在跨領域基準測試中的表現

報告裏的評測結果,Phi-4-reasoning和plus不僅在AIME、OmniMath、GPQA等數學/科學基準上幹翻了體量更大的Distill-Llama-70B、DeepSeek-R1,甚至在算法(TSP/3SAT)、規劃(BA-Calendar)、代碼(LiveCodeBench)等新領域也展現了極強的「遷移力」,而這些領域,模型訓練時根本沒專門覆蓋。

這就是推理鏈帶來的元能力:模型不僅會解題,更會「怎麼推理」,新題型也能舉一反三,遇到沒見過的難題也能慢慢推、反覆試。對比傳統大模型「一步到位」的完美答案,這種「磨嘰」的AI反而更靠譜、更有韌性。

甚至在一些「非推理」任務,如長文本問答、指令遵循、毒性檢測等通用能力測試中,Phi-4-reasoning-plus也有顯著提升。歸根結底,讓AI學會慢思考、會自我檢視,比單純提升算力和知識面更可持續。