軟件硬件雙管齊下,定義「下一代 AI 產品」怎麼做。

作者|張勇毅

首先是一個冷知識:ChatGPT 中的「T」代表「Transformer」,這個概念是谷歌的一群工程師在 2017 年提出的,並發表在一篇現在已成經典的論文《Attention Is All You Need》中。

這個小細節,很大程度上能說明谷歌在 AI 領域並不是一個花架子團隊,而是由一群 AI 產品業內經驗最豐富的老兵組成的團隊,從 Gemini 2.5 發布之後,Google 在 AI 領域的優勢已經頗有點「漸入佳境」的感覺:基礎模型能力的大幅提升,加上 Gemini 在谷歌軟件生態內的逐漸深入,讓全球數以十億計的用戶都在這個過程中,逐漸被「轉化」成谷歌 AI 產品的用戶。

如何「轉化普通用戶變成 AI 產品用戶」,是這個時代幾乎所有 2C AI 產品都需要回答的問題,顯而易見,在這個問題上,Google 已經憑藉着巨大的存量用戶優勢,甩開了所有競爭對手——但谷歌同樣需要奔跑不停,才能在 Perplexity、OpenAI 以及微軟等強大競爭對手的圍剿中,留住用戶的心。

Google 顯然最清楚在端側 AI 爆發的時代,谷歌的實際優勢在哪裏,用戶同樣知道谷歌知道他們想要哪些 AI 能力,出現在自己最常用的日常應用中。

這就是今年穀歌 I/O 2025 大家的共識,Google 也確實在主題演講中,幾乎全程都在介紹谷歌在這些領域中的潛力,以及向世界展示,AI 能給這些用戶原本已經熟悉的使用體驗帶來哪些改變。

01

Google 搜索引擎 AI Mode 深入

作為目前巨頭中 AI 落地成效最顯著的選手,Google 毫不掩飾自己在 AI 產品商業化用戶規模上的領先,上來就展示了大量 AI 能力在谷歌產品中的實際應用成果。

Google CEO 桑達爾-皮查伊 介紹,基於 Gemini 能力的 AI 總結功能現在已覆蓋全球超過 15 億用戶,AI 總結功能在全球的調用次數增長已經超過 10%,而且這種增長還在持續。多模態識別能力的谷歌Lens 現在同樣已經有超過 15 億的月活用戶。

桑達爾-皮查伊將其稱為「搜索引擎過去十年內最成功的革命」| 圖片來源:極客公園

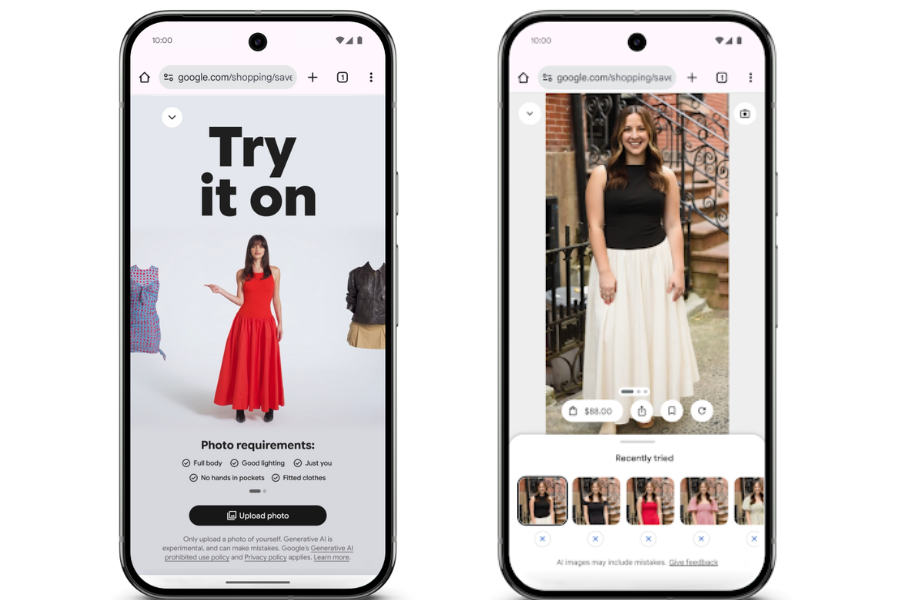

但 AI 顯然不只是能在搜索引擎上起到作用,比如谷歌同時就宣佈了新的「虛擬試穿」功能,谷歌會要求你提供一張全身照片,通過大模型「理解人體和服裝的細微差別,不同材料在不同身體上摺疊、拉伸和垂墜。然後使用這張照片,生成你穿着你正在選購的衣服的圖像。

一直傳聞中的谷歌想要藉助 Chrome 入局 AI 瀏覽器,本次 IO 中也終於嶄露頭角,除了 Chrome 瀏覽器本身更深度的整合 Gemini 接口、識別網頁內容以外,谷歌還為搜索引擎調添加了全新的「AI 模式」。這個模式把類似 Gemini 或 ChatGPT 的聊天機器人功能直接帶入了用戶的網頁搜索體驗。你可以用它來找鏈接,但也能更快地獲取信息、追問問題,讓 Gemini 以平時在普通網頁上找不到的方式來整合信息。

谷歌搜索的負責人甚至放出豪言:如果你想知道互聯網上最重要的搜索引擎未來會變成什麼樣,那你就去點開「AI 模式」看看。

「AI 模式」同時也支持深度研究功能,會自動將用戶的提示詞轉化為海量的搜索,並自動查找和整合信息,同時在這個模式下,AI 搜索還可以訪問你之前的搜索記錄,你也可以手動開啓權限,讓它可以訪問你的電子郵件,以便 AI能更了解「你是誰」以及你關心什麼。

把所有這些功能加起來,你就會得到一個更加靈活和個性化的 AI 搜索,無論是針對用戶本身還是當前的具體查詢,顯然都能根據用戶信息給出更加精準的回答。

Gemini 2.5 家族也同時加入了支持深度思考的版本 —— Gemini 2.5 Pro Deep Think,在 2025 年美國數學奧林匹克競賽 (USAMO) 中取得了 40.4% 的高分,要知道這可是最難的數學基準測試之一,比之前的 2.5 Pro 版本足足提升了 10 多個百分點。同時在 LiveCodeBench 競賽級編程難題中,它的得分更是高達 80.4%。同時,在多模態推理 MMMU 測試中,也取得了 84.0% 的成績。

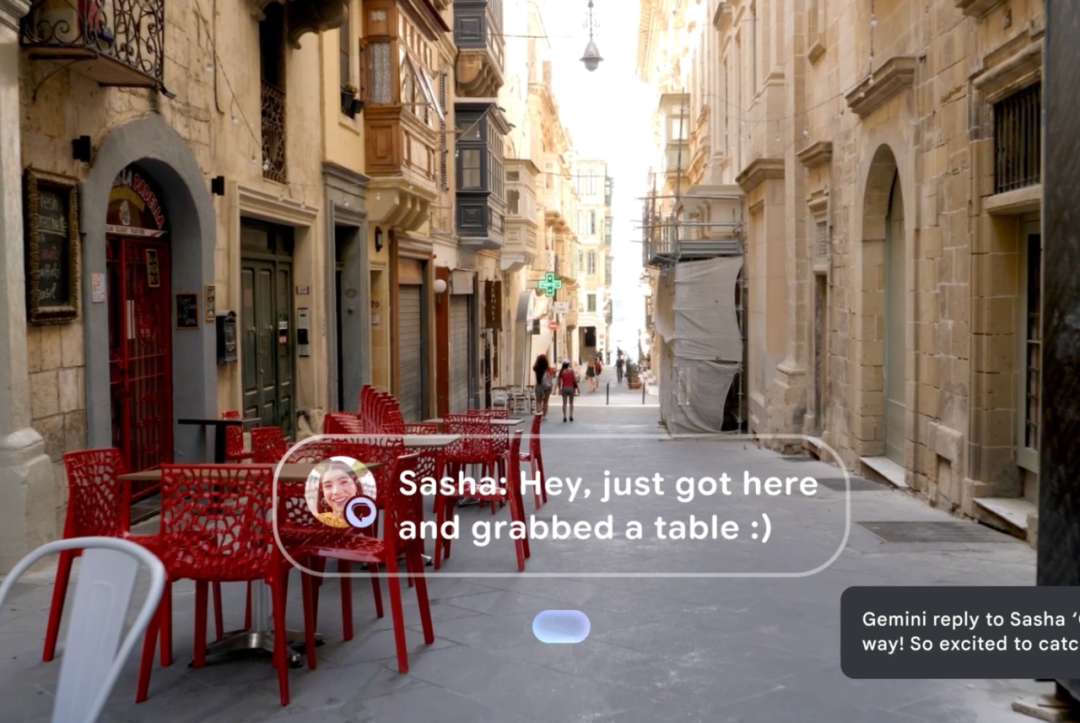

Gemini Live 的攝像頭共享功能於去年在谷歌I/O 大會上首次亮相,當時它的名字還叫 Project Astra,隨後作為 Gemini Live 在 Android 上正式推出。它允許谷歌Gemini「看到」您攝像頭中的一切,因此您可以就周圍的世界進行持續對話——例如,根據冰箱中的食材詢問食譜建議。

隨着谷歌在用戶場景中逐漸深入,現在這一功能被直接引入搜索的 AI 模式中,通過點擊「Live」圖標,用戶將能夠與搜索共享他們的攝像頭畫面,並直接詢問眼前的事物,例如自行車應該如何組裝。並且可以自動根據上下文對你們的情況進行同步更新回答。

在現場的演示中,最令筆者印象深刻的新功能,是其新獲得的主動性。可以根據它觀察到的事件選擇何時開口,像一個真人一樣,對你的操作進行建議,例如在用戶做作業時進行觀察,它可能會注意到您犯了一個錯誤,並直接指出用戶哪裏錯了,而不是反過來等着用戶要求 AI 去執行任務。

據 DeepMind CEO Demis Hassabis 表示,教 AI 自主行動一直是計劃的一部分。這些「察言觀色」的技巧,是人類相對擅長但難以量化或研究的事情。

02

Android XR

明眼人看到這裏已經能反映過來了:比起手機攝像頭,這個如此深入現實世界的多模態 AI 功能,似乎更適合的載體是在眼鏡上。

Google 顯然同樣想到了這一點,隨即趁熱打鐵,宣佈了 Android XR 的新進展,同時在現場展示了谷歌XR 眼鏡的原型機。

在演示中,Google 強調它們是使用 Gemini 的「最佳硬件」:Google的、 展示的原型眼鏡搭載有相機,麥克風和揚聲器,Gemini 可以調用這些硬件,幫用戶理解周圍的世界。同時在顯示屏上顯示類似地圖導航等更多信息。

目前,谷歌正通過與三星、XREAL 的合作,來研發首批搭載 Android XR 操作系統的眼鏡硬件。谷歌 XR 副總裁 Shahram Izadi 表示,第一款硬件設備是三星的 Project Moohan,但那是一款更接近 Apple Vision Pro 的 XR 頭顯。第二款 Project Aura 屬於 XREAL。定位是一款 AR 眼鏡。

除了三星、XREAL 這樣的硬件廠商,Google 顯然也是從 Meta Ray-Ban 的大獲成功中吸取到了經驗,同時也宣佈了與包括 Gentle Monster 在內的兩家時尚眼鏡巨頭合作,一同將 AI 眼鏡打造的更加時尚。

03

AI 創作全家桶

除了直接面向最多普通用戶的 Gemini,Google 同時還針對創作者的一系列 AI 創作工具,進行了更新換代 —— 其中不僅有直接與 Sora 競爭的 Veo3、圖像生成工具 image4,Lyria 2 音樂生成模型,還有全新視頻創作工具 FLOW。

Veo 3 相比前代,最大的升級是它可以生成包含音效、背景噪音,甚至對話的視頻。

谷歌現場演示了一段 CGI 級別的生成動畫,其中動物在森林裏說話。聲音和視頻完美同步:有聲音的視頻顯然大大提升了 AI 生成視頻的實用性。谷歌 DeepMind 首席執行官 Demis Hassabis 也表示:「我們正在走出視頻生成的‘無聲時代’。」

Google 同步宣佈了「大杯」和「超大杯」訂閱服務,AI Pro 與 AI Ultra,其中頂配的谷歌AI Ultra 要價每月 249 美元,但同時也確實提供了物超所值的服務 —— 例如幾乎無限制的各項服務使用額度,以及 30TB 的谷歌Cloud 雲端存儲容量。

AI Ultra 計劃允許用戶試用 Gemini 2.5 Pro 全新的增強推理模式 Deep Think,據谷歌介紹,該模式專為「高度複雜」的數學和編程問題設計。它還提供 Chrome 中 Gemini 的早期訪問權限,允許訂閱者直接在瀏覽器中使用 AI 完成任務和總結信息。

除了這些之外,訂閱用戶還可以試用谷歌的 AI Agent 原型 —— Project Mariner,可以同時自動化多達 10 項任務,例如查找信息、預訂和購買產品。

通過將 Gemini 能力深度融入搜索引擎、Chrome瀏覽器、虛擬試穿、乃至全新的Android XR生態和AI眼鏡,Google不僅在提升現有產品的用戶體驗,同時也是在潛移默化地定義「下一代 AI 產品」怎麼做。

顯然,在端側 AI 產品如何做這件事上,Google I/O 展示出的「軟件硬件雙管齊下」,已經足以讓谷歌再次成為 AI 產品生態中最讓人忌憚的選手。

*頭圖來源:極客公園