炒股就看金麒麟分析師研報,權威,專業,及時,全面,助您挖掘潛力主題機會!

「歐洲的OpenAI」Mistral AI終於發布了首款推理模型——Magistral

然而再一次遭到網友質疑:怎麼又不跟最新版Qwen和DeepSeek R1 0528對比?

(此前該公司發布Ministral 3B/8B時,聲稱「始終優於同行」,卻沒有對比Qwen2.5)

在該模型發布的前幾個小時,Mistral AI的CEO Arthur Mensch在接受爐邊訪談時聲稱即將發布的Magistral能夠與其他所有競爭對手相抗衡。

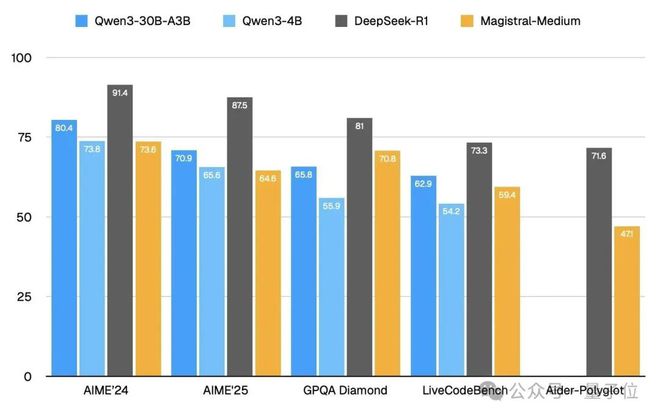

在官方展示的基準測試結果中,DeepSeek-R1的數據確實不是最新的(在AIME-25數學測試中,DeepSeek-R1-0528的準確率已經從舊版的70%提升至87.5%),並且比較行列裏完全不見Qwen的身影。

不過,與同公司初期模型Mistral Medium 3相比,該框架在AIME-24上的準確率提升了50%。

此次Magistral發布了兩種版本:

Magistral Small——24B參數的開源權重版本,可在Apache 2.0許可下自行部署。

Magistral Medium——更強大的、面向企業的版本,在Amazon SageMaker上提供。

在Magistral發布之前,Mistral AI的CEO Arthur Mensch在訪談中提到:

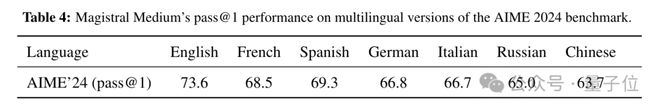

於是,這次Magistral的一個亮點就是支持多語言推理,尤其是解決了主流模型用歐洲語言的推理效果不如本土語言的缺陷。

下面的例子展示了在Le Chat中,使用Magistral Medium的阿拉伯語提示和響應。

與通用模型不同的是,Magistral針對多步邏輯進行了微調,提升了可解釋性,並在用戶的語言中提供了可追溯的思考過程,能夠實現大規模實時推理。

下面的例子展示了重力、摩擦和碰撞的單次物理模擬,在預覽中使用的是Magistral Medium。

就好像Magistral不是黑箱預言家,而是一個能陪你「擺事實、講道理」的智能夥伴。

並且,在Le Chat中,通過Flash Answers,Magistral Medium的token吞吐量比大多數競爭對手快10倍。

這就能夠實現大規模的實時推理和用戶反饋。

作為Mistral推出的首個基於純強化學習(RL)訓練的推理大模型,Magistral採用改進的Group Relative Policy Optimization(GRPO)算法。

直接通過RL訓練,不依賴任何現有推理模型的蒸餾數據(如DeepSeek-R1需SFT預熱)。

通過消除KL散度懲罰、動態調整探索閾值和基於組歸一化的優勢計算,在AIME-24數學基準上實現從26.8%到73.6%的準確率躍升。

首創異步分佈式訓練架構,通過Generators持續生成、Trainers異步更新的設計,配合動態批處理優化,實現高效的大規模RL訓練。

還反直覺地發現純文本RL訓練可提升多模態性能(如MMMU-Pro-Vision提升12%),並驗證RL對小模型同樣有效(24B的Magistral Small在AIME-24準確率達70.7%)。

這些創新使Magistral在無需預訓練蒸餾的情況下,以純RL方式為LLM的強化學習訓練提供了新範式。

官方沒有給出Magistral與最新版Qwen和R1的對比,網友來代勞了。

從結果可以看出,Qwen 4B與該模型相近,小型的30B MoE效果更好,R1最新版就更不用說了(doge

並且,由於「歐洲的OpenAI」越來越不Open,Stability AI前CEO建議Mistral AI應該爭取真正的開源來佔據開源的領導地位。

[1]https://mistral.ai/news/magistral

[2]https://x.com/dylan522p/status/1932563462963507589

[3]https://x.com/arthurmensch/status/1932451932406415531

— 完 —