炒股就看金麒麟分析師研報,權威,專業,及時,全面,助您挖掘潛力主題機會!

在 3D 重建領域,無論是 NeRF 還是最新的 3D Gaussian Splatting(3DGS),在生成逼真新視角時仍面臨一個核心難題:視角一旦偏離訓練相機位置,圖像就容易出現模糊、鬼影、幾何錯亂等僞影,嚴重影響實際應用。

為了解決這個問題,來自英偉達的研究團隊聯合提出了一種創新方案 ——Difix3D+,通過單步擴散模型對 3D 渲染結果進行 「圖像修復」,顯著提升新視角圖像的質量和一致性。該工作已被 CVPR 2025 接收,併入選Best Paper Award 候選。

背景:3D 重建的 「致命短板」

近年來,NeRF(神經輻射場)和 3D Gaussian Splatting(3DGS)等技術在三維重建與新視角合成中取得突破。然而,在訓練相機視角之外,這些方法往往會出現模糊、鬼影、幾何錯亂等僞影,尤其在視角跨度較大、數據稀疏、光照變化或相機標定不準確的情況下尤為嚴重。這些僞影極大限制了其在自動駕駛、機器人、AR/VR 等真實場景中的應用。

這主要是因為傳統方法過度依賴局部一致性和 per-scene 優化流程,缺乏跨場景泛化能力,且無法有效填補觀測稀疏區域的 「空洞」。

關鍵洞察:2D 擴散模型為何能 「修好」 3D?

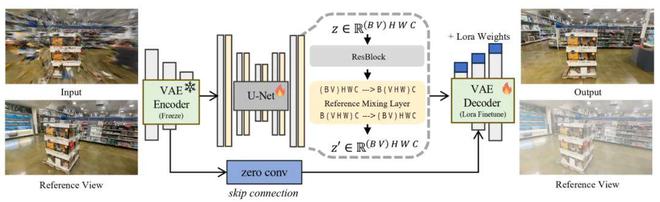

Difix3D+提出了一個突破性的視角:將預訓練 2D 擴散模型的視覺先驗引入 3D 渲染流程,將其作為 「圖像修復器」,精準去除神經渲染僞影。

這一設計基於一個關鍵觀察:神經渲染僞影的分佈,與擴散模型訓練過程中的噪聲圖像分佈驚人地相似。

為驗證這一點,研究者將渲染圖輸入擴散模型進行單步 「去噪」,並系統性測試不同噪聲強度(t)的效果 ——

這一發現使得單步擴散模型成為 「修復」 NeRF/3DGS 渲染圖的理想選擇,不僅效率高,而且具備泛化能力。

Difix 具備以下核心優勢:

1. 單步擴散:發現渲染僞影的分佈在 t=200 處最接近擴散模型訓練數據,DIFIX 可一次去除僞影並保留語義結構。

2. 無需大量訓練:僅需在消費級 GPU 上訓練幾個小時,即可適配 NeRF/3DGS 的渲染僞影;

3. 支持多種 3D 表徵:同一個模型可同時修復 NeRF(隱式)與 3DGS(顯式)渲染;

4. 近實時推理:在 NVIDIAA100上,僅需 76ms 即可完成圖像修復,比傳統多步擴散快 10 倍以上。

5. 可進可退:修復後的圖像還能反向蒸餾回 3D 模型,提升整體建模精度和一致性。

解決方案:DIFIX3D+ = 擴散模型 + 蒸餾增強 + 實時修復

DIFIX3D+ 以一個經過少量微調的單步擴散模型(DIFIX)為核心模塊,結合漸進式優化策略,構建出一個無需修改原始 3D 重建結構即可增強視覺質量的插件化系統。

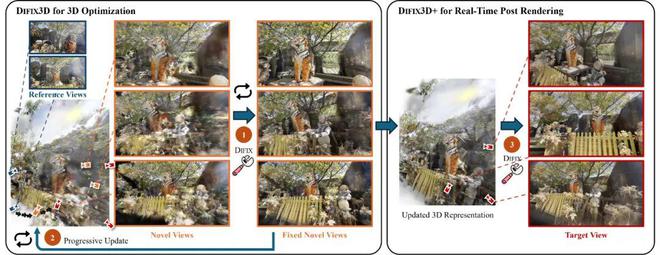

核心三步流程:

Step 1:DIFIX 修復中間視角圖像。從訓練視角向目標視角進行插值採樣,生成中間視角圖,並用 DIFIX 去除僞影。

Step 2:蒸餾至 3D 表示。將修復後的圖像 「反向蒸餾」 回 3D 表示中,逐步提升建模質量與區域覆蓋度。

Step 3:推理時再修復。最終渲染出的圖像,再次通過 DIFIX 後處理,消除殘留細節錯誤,僅需 76ms,支持實時渲染。

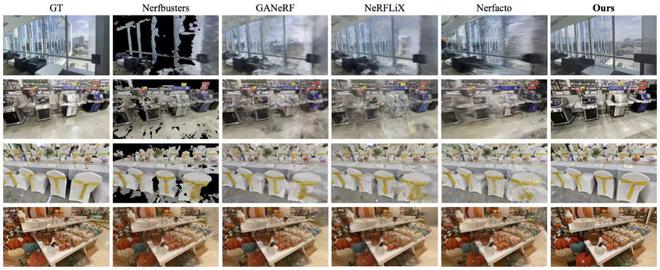

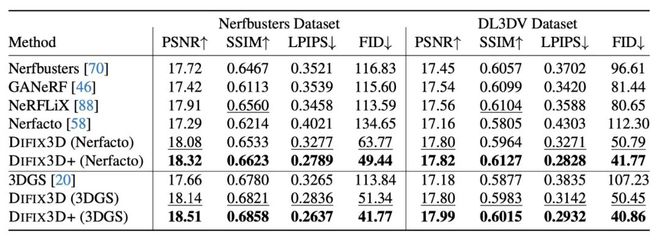

實驗結果一覽:效果、指標全面領先

支持 NeRF、3DGS 多種 3D 表徵。

FID 降幅超過 60%~70%,LPIPS 接近 SOTA 一半,大幅領先其他方法。

此外,在自動駕駛場景中(橫向 6 米偏移或仰角 30°),DIFIX3D+ 仍能維持視角一致性與圖像清晰度,極具工程落地價值。

結語:讓 2D 模型 「反哺」 3D,打開新一代 3D 重建大門

DIFIX3D+ 展示了 2D 擴散模型在 3D 渲染修復中的巨大潛力。它無需改變原始建模流程,即可顯著提升重建質量,為未來更加通用、智能、高效的 3D 場景生成與理解提供了堅實基礎。