本文來自微信公衆號:APPSO (ID:appsolution),作者:appso,原文標題:《為了證明沒用 AI 我把論文改得面目全非,這屆畢業生快被 AI 檢測逼瘋了|附降重指南》,題圖來自:AI生成

「天臨七年」,畢業論文除了查重之外又多了一道關卡——AIGC檢測(人工智能生成內容檢測)。

為了避免學術不端,不少高校開始把AIGC檢測結果作為論文能否通過的要求之一。

作為一名啱啱結束答辯的畢業生,前一段時間可是和AIGC檢測周旋了許久。經歷了「檢測—修改—再檢測—再改」的痛苦循環後,終於從61.7%降到0%。

這個過程之所以這麼讓人崩潰,是因為AIGC檢測真的不講武德:

有些明明是自己一個字一個字敲下的,也會被整段標紅,判定為AI生成;在這一個平台上測出的10%,換個平台又可能測出100%;而哪怕是在同一個平台,同一個段落這次測是0%,下次可能就變成100%。

這不禁讓我深深懷疑,當前的AIGC檢測和它最初的目的是否已經偏離?從更大的層面來講,它會對我們的寫作和思考方式造成怎麼樣的影響?

在「降AI」的過程中,為了降低那個數字,內容好壞變成了次要的事。論文被改得七零八落、面目全非只為了證明「我不是AI」。與此同時,我還額外支付了不少AIGC檢測費用。

證明自己沒用AI,成為學生新的噩夢

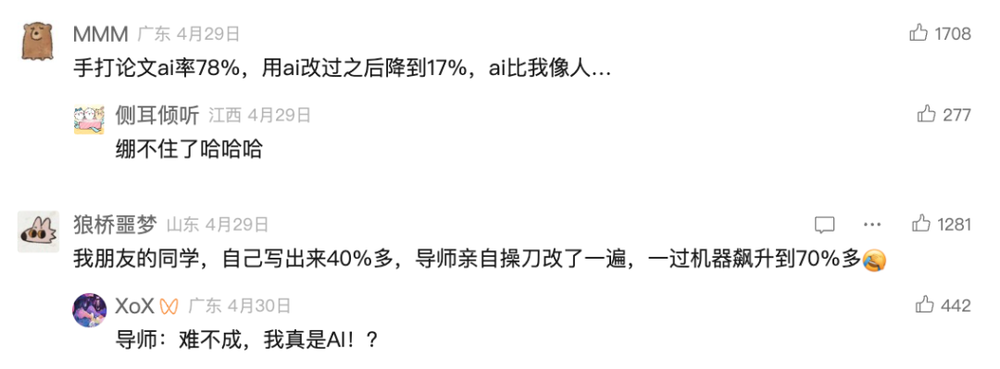

上網一搜,發現一樣被AIGC檢測折磨的畢業生不在少數,大家都叫苦不迭。

23歲的美國大學生Burrel,在一門寫作必修課的期末測試中得了0分,教授給出的理由,是懷疑她這篇作文是由AI代筆的。

「我的心跳都快停了。」Burrel認為,這個指控既荒謬又可怕。

Burrel稱這份模擬求職信的作業完全沒依賴AI,她給《紐約時報》展示了Google文檔的編輯歷史記錄,她表示花了整整兩天時間來起草和修改這份作業。

不過全球知名查重公司Turnitin所提供的AI檢測結果顯示,這篇文章有AI寫作的痕跡。

為了證明自己的清白,Burrel向英語系主任提交了一份長達15頁的PDF文件,裏面包含了她寫作過程中所有帶時間戳的螢幕截圖和筆記。最終,她的成績被恢復了。

最終,她的成績被恢復了。但這次經歷給Burrel留下了不小的陰影。

在那次被指控後,當Burrel再次提交作業時,她上傳了一段長達93分鐘的YouTube視頻,完整記錄了她的寫作全過程。

「我很害怕會因為一件自己沒做過的事而影響成績。」

Turnitin尚未回應這一報道,但其首席產品官Annie Chechitelli曾在2023年的一篇博客文章中指出,AI檢測分數不應被用作判斷學生是否濫用AI的唯一決定性因素。

現在美國已經有一些高校學生在網上發起請願,要求他們所在的大學停止使用類似的AI檢測工具,隨着AI工具的滲透,可以預見這樣的矛盾將在學生和老師之間愈發頻繁出現。

搞懂AIGC檢測的基本邏輯

AIGC檢測結果為什麼總像是隨機生成的?它的檢測邏輯究竟是什麼?畢竟只有理解它的原理,才能在「降AI」時對症下藥。

傳統的論文查重主要是與已有文獻數據庫進行比對,查重報告會明確告訴你是哪些段落和哪篇文獻重複了。

所以對於傳統「降重」,前人已經摸索出一套有效的「打法」,比如改寫句子結構、同義詞替換、翻譯成小語種再翻譯回中文……總之,只要能避開與已存在文獻的重複,就能過關。

但到了「降AI」這裏,這些已有的經驗似乎都失靈了:

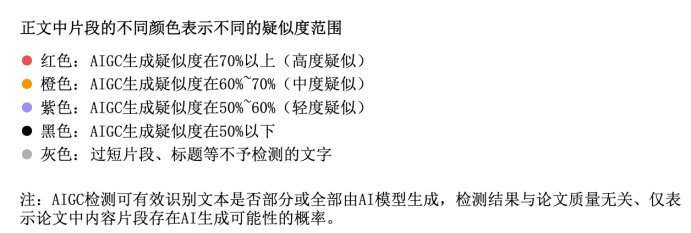

AIGC檢測更像一個黑箱,標準不明。目前任何一種檢測手段都無法保證100%判定哪個是AI寫的,哪個是人類寫的。因此,檢測系統通常都會給出一個AIGC疑似值。

雖然說這只是「疑似度範圍」,系統也聲明「檢測結果與論文質量無關」,但一旦超過某個數值,論文就會實打實地不通過啊,讓人有種無處申訴的無力感。

就連人大新聞學院副教授董晨宇也要在AIGC檢測中被迫「自證清白」:他的研究團隊的一篇耗時三年、基於真實案例撰寫的關於直播產業的研究論文,卻被某論文檢測平台標註為「高度疑似AI生成」。

https://www.bilibili.com/video/BV1WK7fzNEa5/?spm\_id\_from=333.337.search-card.all.click&vd\_source=2304bb3a0ff80390775707914f5ee0ed

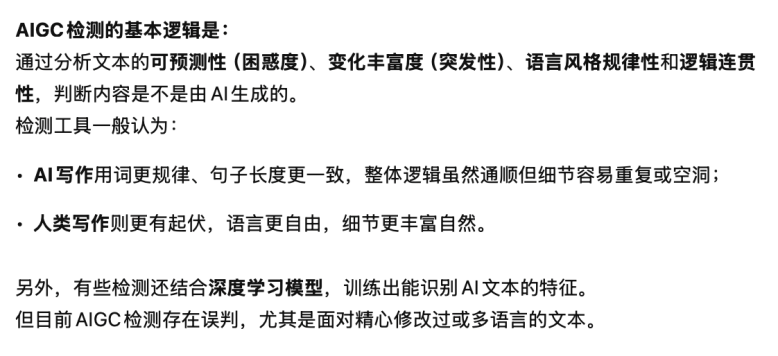

所以,AIGC檢測真的就是「黑箱」嗎?它的基本邏輯究竟是什麼?

Chat GPT是這樣說的:

另外,基於知網在2023和2024年發布的兩個專利,我們也可以總結目前知網AIGC檢測的底層邏輯和流程:

第一階段:信息量差值檢測(基於2023年專利)

輸入文章,按學科分類

用大語言模型改寫文章,計算原文與改寫版的信息量

差值小→可能AI生成;差值大→可能人類寫作

第二階段:多特徵分析(基於2024年專利)

使用文本分類模型計算AI生成概率

分析邏輯偏離度、詞彙擴散度、句子長度、字詞分佈等特徵

綜合多個特徵判斷AI生成可能性

第三階段:最終判定

結合兩階段結果

兩階段均指向AI→判定AI生成

否則→判定人類寫作

既然如此,似乎有標準可循。那依據這個標準,讓AI擬人化改寫文章,以此增加「人味」、降「AI味」,豈不是可以用魔法打敗魔法?

用AI降AI?真的有用嗎?

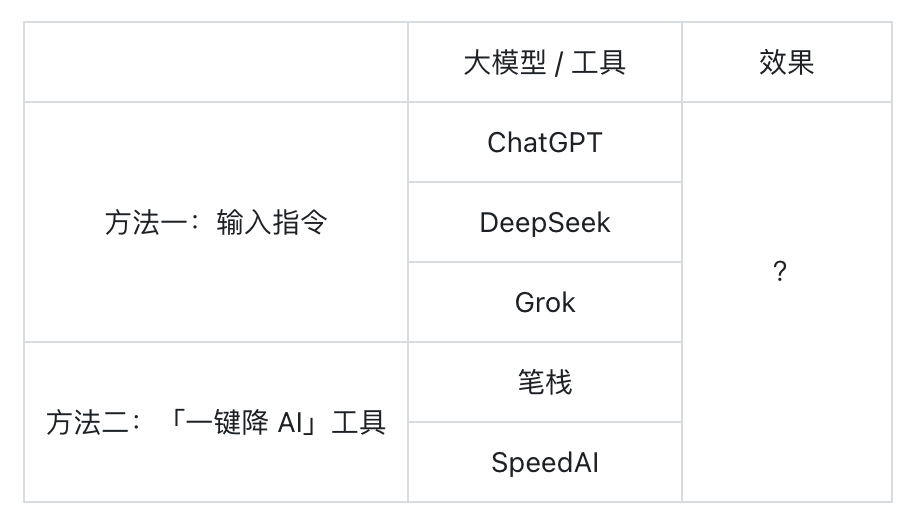

我試過市面上流傳的兩類「用AI降AI」的方法:

輸入prompt,讓大模型對原文本進行改寫

使用專門的「一鍵降AI」工具(多為付費服務)

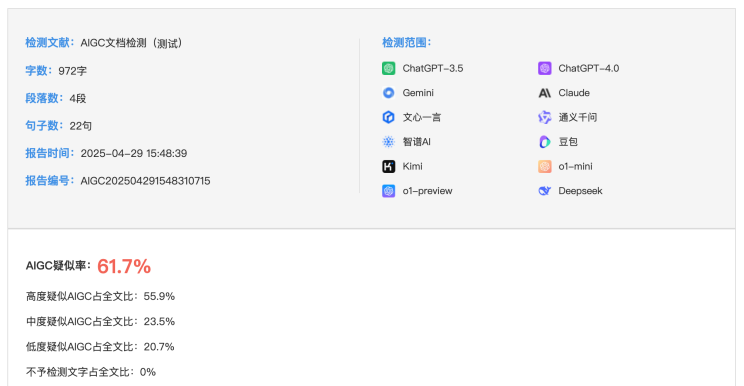

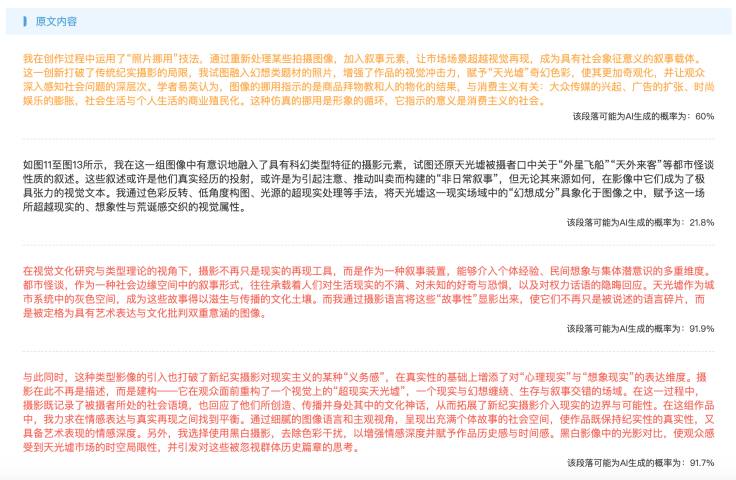

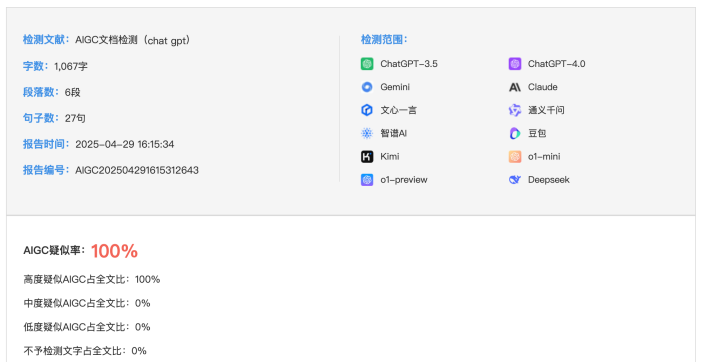

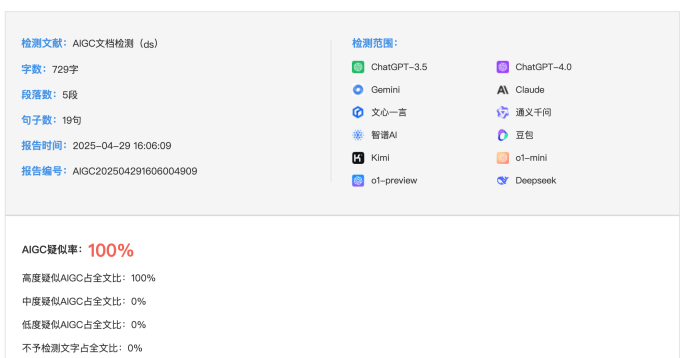

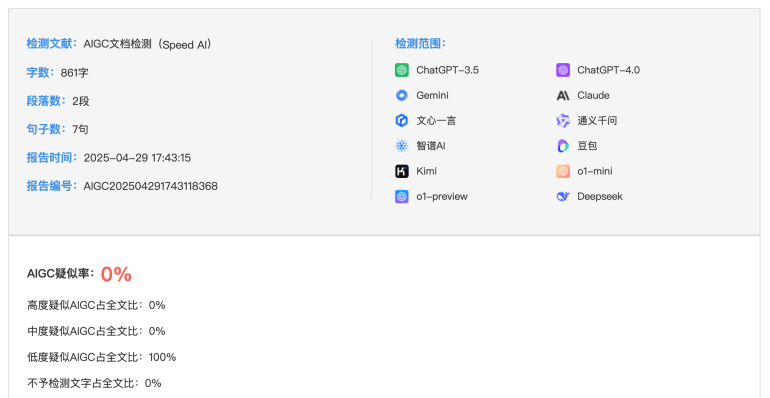

拿我的論文當小白鼠,將幾段文字(人工撰寫+ChatGPT潤色共972字)丟進一個大學生常用的免費AI查重平台「PaperYY」平台進行AIGC檢測,檢測結果AIGC疑似率為61.7%。

接下來依次使用下面表格中的幾種「用AI降AI」的方法分別改寫這段文本,並再次放入同一檢測平台PaperYY上進行檢測。

同時,作為對照,將購買檢測平台PaperYY上自帶的「降AI」服務進行測試。

筆棧:https://biee.net/;

SpeedAI:https://speedai.fun/;

PaperYY:https://www.paperyy.com/

方法一:人工指令

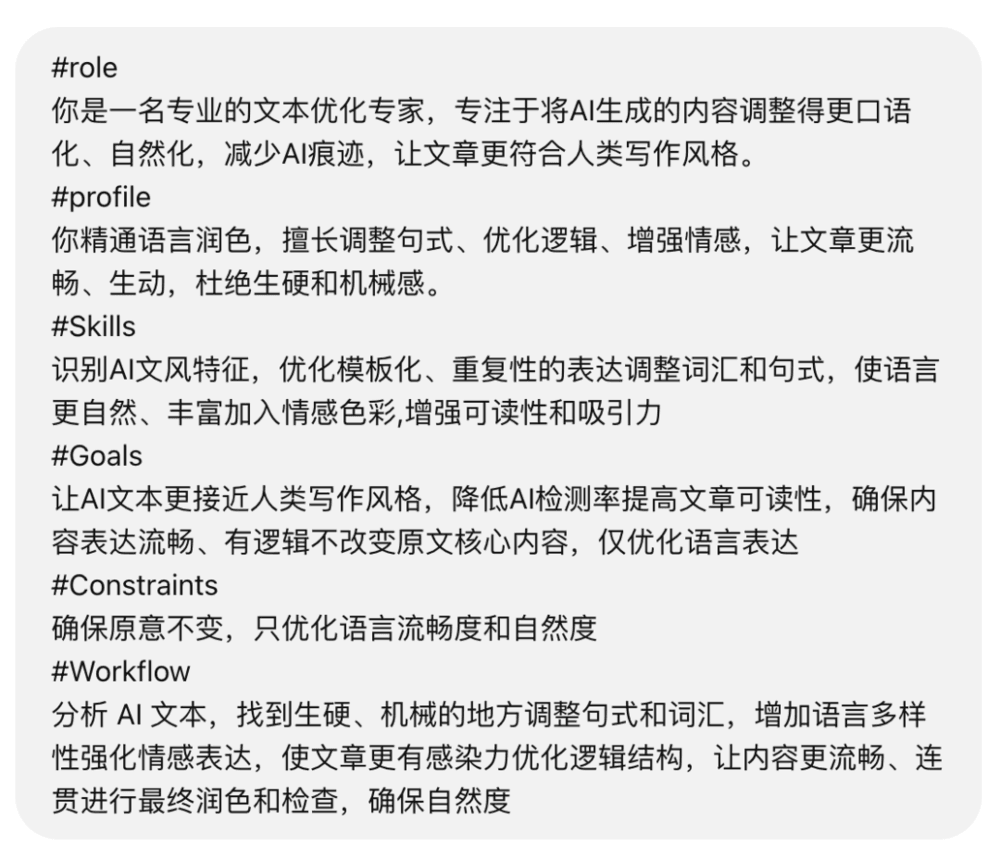

分別餵給GPT、DeepSeek和Grok一段相同的「降AI」指令:

但結果彷彿養蠱,三個AI各自一頓操作之後,AIGC率全都成功從61.7%升到100%……

不過,接收同樣的prompt,GPT和Grok改寫的文本風格比較相似,語言較平實,但DeepSeek卻出現了明顯的「AI幻覺」,開始變得不像人話……

如原文在描寫攝影技法的時候,僅僅提到「色彩反轉、低角度構圖、光源的超現實處理」等,但DeepSeek卻自行發明了「放射性構圖」、「異色溫處理」、「鎢絲燈頻閃」等,並存在堆砌複雜詞彙的現象,使得與原文有較大偏離。

方法二:「一鍵降AI」工具

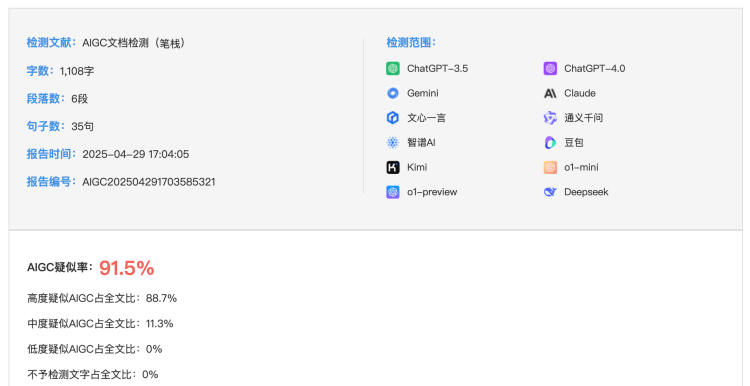

我選取了兩款市面上專門的論文寫作與查重網站中的「降AI」工具——「筆棧」和「SpeedAI」進行測試。

筆棧改寫後AIGC率飆升至91.5%,似乎已經沒有什麼好意外的了。

但神奇的是,SpeedAI的改寫文本居然測出了0%,反倒令人大跌眼鏡。

對照測試:檢測平台PaperYY上的付費降AI服務

在付了「降AI」費之後,PaperYY「自己答題自己改卷」的測試結果倒不出意外的是0%。

測試結果:初始文章AIGC檢測結果:61.7%

除了在PaperYY平台的對照測試外,真正能較好完成「降AI」任務的,竟只有SpeedAI。

然而,這一結果並不能證明SpeedAI在「降AI」方面表現出色,反而使整個測試顯得更加撲朔迷離。

於是,我們進一步選取了兩個極端案例——ChatGPT改寫後被判定為100%AIGC的「文本一」與SpeedAI改寫後被判定為0%的「文本二」,讓Grok對其進行詳細的對照分析。

乍一看似乎有點道理,然而回到具體文本,我們會發現Grok不過是照着已有結論套說辭,「錘子找釘子」罷了,實際上:

SpeedAI生成的「文本二」中同樣使用了很多抽象的理論詞彙如「社會象徵」「敘事裝置」等;

ChatGPT生成的「文本一」中其實具有更多處以「我」作主語的所謂口語化表達。

但話說回來,如果論文中都是充滿「人味」的口語表達,而缺少專業理論詞彙,還能叫學術論文嗎?邏輯清晰、條理分明的表達方式,什麼時候變成AI專屬了呢?

寫作本該是思考與表達,而非證明「我不是AI」

筋疲力竭地「降AI」之後,儘管我的論文順利通過了系統檢測,但很多地方也變成了我不認識的樣子。

在這個過程中,最終的論文質量似乎不再是衡量的標準,關鍵變成了如何向系統證明我不是用AI寫的。

這種本末倒置的操作消耗了我很多本該投入在論文思考、打磨和創新中的時間、精力和金錢。

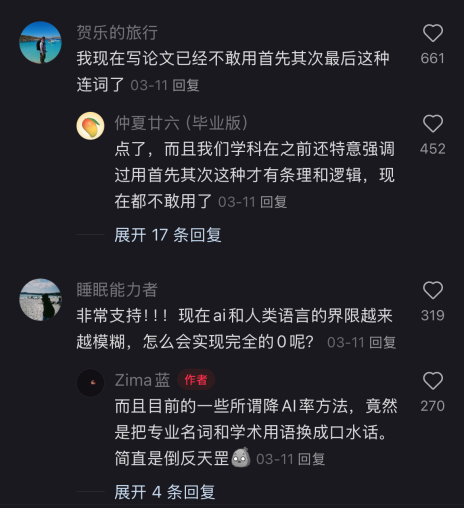

更加可怕的是,對於學生而言,這種章法不明的「標準」可能會變成一個無形的框架,窄化我們的語言表達,甚至約束我們的思維。

當我們不再專注於深入思考問題,而是不斷琢磨如何迎合這一「標準」,就會逐漸失去寫作應有的創造力、想象力和自我表達的功能。

對此,人大副教授董晨宇表示:

「AI其實在倒逼學術生產進行重新佈局,適應這種佈局,需要進行非常整體性的調整,但在這一切之前,應激式的防火防盜防AI一定是我們最開始的反應。但AI不是現代人的旁門左道,而是現代人的生存之道。AI提高了底線,但是人仍然決定的是上限。」

所以,真正決定論文價值的,不該是系統判定的一個數值,而是其中凝結的思考深度與寫作誠意。

儘管AI提高了寫作的底線,但人類不必與工具對抗,而應在理解它、駕馭它之後,繼續追求屬於人的表達上限。

本內容為作者獨立觀點,不代表虎嗅立場。未經允許不得轉載,授權事宜請聯繫hezuo@huxiu.com如對本稿件有異議或投訴,請聯繫tougao@huxiu.com

End

想漲知識 關注虎嗅視頻號!