炒股就看金麒麟分析師研報,權威,專業,及時,全面,助您挖掘潛力主題機會!

IT之家 7 月 11 日消息,科技媒體 NeoWin 昨日(7 月 10 日)發布博文,報道稱微軟推出 Phi-4-mini-flash-reasoning 小語言模型,重點提升端側 AI 模型的數學和邏輯推理能力。

Phi-4-mini-flash-reasoning 的主要優勢在於,它能夠在邊緣設備、移動應用和嵌入式系統等資源不足的場景下,引入先進的推理功能。

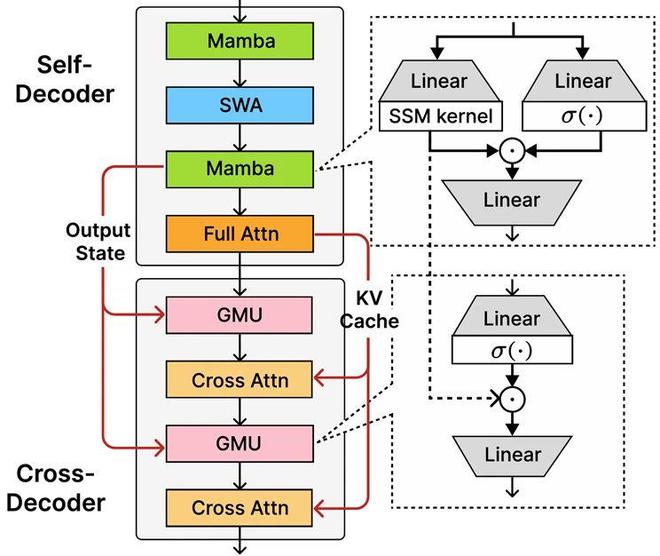

在架構方面,Phi-4-mini-flash-reasoning 創新引入了 SambaY 架構,而該架構的一大亮點,就是名為 Gated Memory Unit(GMU)的組件,它能夠高效地在模型的內部之間共享信息,從而提高模型的效率。

這些改進讓模型能夠更快地生成答案和完成任務,即使面對非常長的輸入也能應對自如,Phi 模型還能處理大量數據,理解非常長的文本或對話。

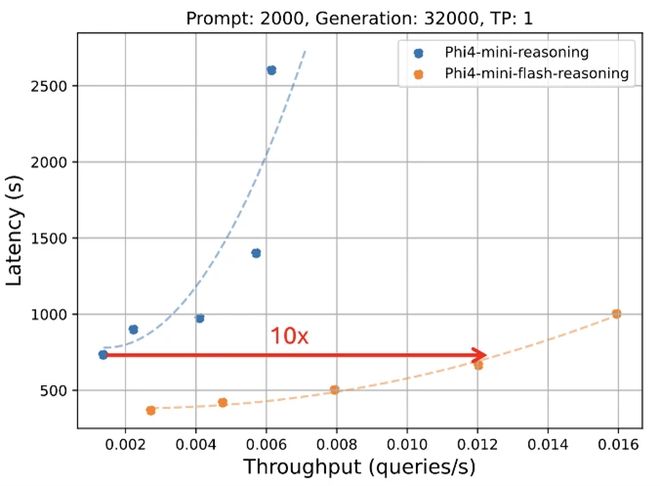

在性能方面,相比較其它 Phi 模型,Phi-4-mini-flash-reasoning 的吞吐量最高提升 10 倍,這意味着在給定的時間內,Phi-4-mini-flash-reasoning 可以完成更多的工作。

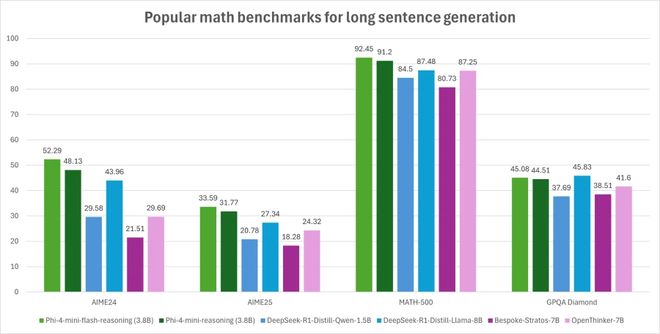

它可以在相同的時間內處理 10 倍多的請求或生成 10 倍多的文本,這對於實際應用來說是一個巨大的改進,此外,延遲也降低至其它 Phi 模型的 1/2~1/3。IT之家附上相關性能數據如下:

Phi-4-mini-flash-reasoning 新型模型已在 Azure AI Foundry、NVIDIA API Catalog 和 Hugging Face 上線。

(轉自:網易科技)