今天凌晨,麻省理工技術評論發布了專訪文章《塑造OpenAI研究未來的兩個人》,主要介紹了OpenAI兩位最重要的研究主管Mark Chen和Jakub Pachocki。

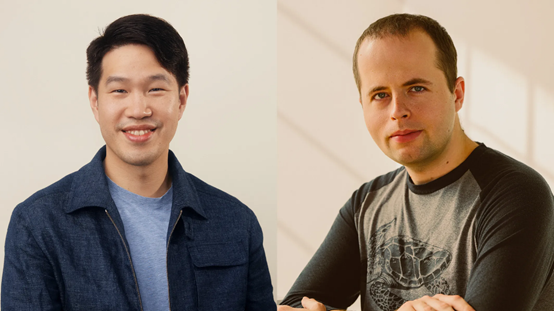

前OpenAI聯合創始人兼首席科學家Ilya Sutskever離開OpenAI之後,Jakub Pachocki接替了他的職位,曾領導開發過GPT-4、OpenAI Five、o1、o3等重要模型。

Mark Chen是在前OpenAI首席技術官Mira Murati離開後,接替了她的職責並任命為首席研究官。曾領導開發過GPT‑3、GPT‑4/Turbo、DALL·E、Codex等重要模型。

而OpenAI即將發布的重磅產品GPT-5模型,依然由這兩位技術大神領導研發。

對於麻省理工技術評論這篇專題文章,Sam Altman相當認可,並表示,我通常覺得這類文章都沒說到點子上,但這篇確實抓住了Mark和Jakub的合作精髓。

以下是專訪文章的完整內容:

在過去幾年裏,OpenAI 給人的感覺像是 「一人品牌」。憑藉其娛樂圈風格和籌資魅力,首席執行官Sam Altman蓋過了公司其他所有知名人士的風頭。甚至他那次搞砸的被趕下台事件也以他重新回到巔峯並比以往任何時候都更出名而告終。但如果你能越過這位富有魅力的代言人,你就能更清楚地了解這家公司的走向。畢竟,Altman並不是構建該公司賴以立足的技術的人。

這一責任落在了 OpenAI的雙料研究負責人身上首席研究官Mark Chen和首席科學家Jakub Pachocki。他們共同肩負着確保 OpenAI在像谷歌這樣的強大競爭對手面前保持領先一步的職責。

在我與Chen和Pachocki進行獨家對話期間,他們剛於2023年前往倫敦,那裏是 OpenAI 設立的首個國際辦公室所在地。我們討論了他們如何應對研究與產品之間固有的緊張關係。

我們還討論了他們為何認為編程和數學是更通用模型的關鍵;當他們談論通用人工智能(AGI)時,他們真正指的是什麼;以及 OpenAI 的超級對齊團隊發生了什麼,該團隊由公司聯合創始人兼前首席科學家Ilya Sutskever設立,旨在防止假設中的超級智能失控,該團隊在他離職後不久便解散了。

特別是,我想了解在 OpenAI 即將推出數月來最大產品發布之際GPT-5,他們的想法是什麼。

有報道稱,該公司的下一代模型將於 8 月推出。OpenAI 的官方說法好吧,是Altman的說法是 GPT-5 將「很快」發布,期待值很高。

OpenAI 在GPT-3 和 GPT-4 上取得的飛躍提高了人們對這一技術可能性的預期。然而,GPT-5 發布的延遲引發了謠言,稱OpenAI 在構建符合自身更不用說其他所有人期望的模型方面遇到了困難。

但對於一家在過去幾年裏一直為行業設定議程的公司來說,管理預期是工作的一部分。而Chen和Pachocki則在OpenAI 內部設定議程。

雙巨頭並峙

OpenAI的倫敦總部位於聖詹姆斯公園,距離白金漢宮以東幾百米。但我是在國王十字車站附近的一個共享工作空間的會議室裏見到Chen和Pachocki的,OpenAI在那裏保留了一個落腳點的地方,位於倫敦科技街區的中心。OpenAI 的研究傳播主管Laurance Fauconnet坐在桌子一端,打開筆記本電腦。

穿着酒紅色馬球衫的Chen,看起來整潔利落,幾乎有點書生氣。他接受過媒體培訓,與記者交談時很自在。穿着印有大象標誌的黑色 T 恤的Pachocki,看起來更像是電影裏的黑客。他說話時經常盯着自己的手。

但這對搭檔比他們最初看起來更緊密。Pachocki總結了他們的角色。Chen負責塑造和管理研究團隊,他說。「我負責制定研究路線圖並建立我們的長期技術願景。」

「但角色之間存在流動性,」Chen說。「我們都是研究人員,我們都在研究技術問題。無論我們看到什麼可以深入研究並解決的問題,那就是我們要做的。」

Chen於 2018 年加入該公司,此前他在華爾街公司 Jane Street Capital 擔任量化交易員,開發用於期貨交易的機器學習模型。

左Mark Chen,右Jakub Pachocki

在OpenAI他主導了 DALL-E 的創建,這是該公司突破性的生成式圖像模型。隨後,他參與了為 GPT-4 添加圖像識別功能的工作,並主導了 Codex的開發,Codex 是為 GitHub Copilot 提供支持的生成式編碼模型。

Pachocki於2017年離開理論計算機科學的學術生涯加入 OpenAI,並於 2024 年接替Sutskever擔任首席科學家。他是 OpenAI 所謂的推理模型的關鍵架構師尤其是 o1 和 o3這些模型旨在解決科學、數學和編程中的複雜任務。當我們見面時,他們啱啱經歷了公司技術連續兩次獲勝的興奮。

7月16日,OpenAI 的一個大型語言模型在AtCoder世界巡迴賽總決賽中獲得第二名,這是世界上最艱難的編程比賽之一。7 月 19 日,OpenAI 宣佈其一個模型在 2025 年國際數學奧林匹克競賽中取得了金牌水平的成績,這是世界上最負盛名的數學競賽之一。

數學競賽的結果登上了頭條新聞,不僅因為 OpenAI 取得了令人矚目的成就,還因為競爭對手谷歌 DeepMind在兩天後透露,其一個模型在同一競賽中取得了相同的分數。谷歌 DeepMind 遵守了競賽規則,等待組織者檢查結果後再宣佈;而 OpenAI實際上是自己評判自己的答案。

對於Chen和Pachocki來說,結果不言自明。不過,他們更興奮的是編程比賽的勝利。「我認為這有點被低估了,」Chen對我說。國際數學奧林匹克競賽的金牌成績會讓你躋身前20到50名的選手之列,他說。但在AtCoder競賽中,OpenAI 的模型位列前兩名:「突破到人類表現的一個真正不同的層級這是前所未有的。」

不斷推出新產品

OpenAI的員工仍然喜歡說他們是在研究實驗室工作。但該公司已經不同於 ChatGPT 發布三年前的公司了。該公司現在正與世界上最大、最富有的科技公司展開競爭,其估值高達 3000 億美元。突破性的研究和引人注目的演示已經不夠了。它需要推出產品並將其交到人們手中而且它確實做到了。

OpenAI一直在推出新產品發布其GPT-4 系列的重大更新,推出一系列生成式圖像和視頻模型,並引入與 ChatGPT 語音交流的功能。六個月前,它啓動了新一輪所謂的推理模型,首先是o1,隨後是 o3。上周,它向公衆發布了其瀏覽器使用智能體Operator。該公司現在聲稱每周有超過 4 億人使用其產品,並提交25億個提示。

OpenAI即將上任的應用程序首席執行官Fidji Simo計劃保持這一勢頭。在給公司的一份備忘錄中,她告訴員工,她期待着「幫助將 OpenAI 的技術交到世界各地更多人的手中」,在那裏它們將「為人們創造比歷史上任何其他技術都更多的機會」。

我問 OpenAI 如何平衡開放式研究和產品開發。「這是我們很久以前就在思考的問題,遠遠早於 ChatGPT 時代,」Pachocki說。「如果我們真的要認真嘗試構建通用人工智能,顯然,你可以用這項技術做很多事情,中途可以走很多分支,這些分支都可以成為重要的產品。」換句話說,不斷搖動這棵樹,收穫你能得到的一切。

OpenAI人士經常提到的一個觀點是,將實驗性模型推向世界是研究的必要部分。目標是讓人們意識到這項技術已經變得多麼出色。「我們希望讓人們了解即將到來的事情,這樣我們就可以參與一場非常艱難的社會對話,」Altman在 2022 年告訴我。這種奇怪新技術的製造者也很好奇它能用於什麼:OpenAI 很想將其交到人們手中,看看他們會用它做什麼。

這種情況仍然存在嗎?他們同時回答道。「是的!」Chen說。「在某種程度上,」Pachocki說。Chen笑了:「不,你先說。」

「我不是說研究會在產品上迭代,」Pachocki說。「但現在這些模型已經處於可以通過經典基準測試的邊緣,許多我們一直在思考的長期挑戰也開始被攻克,我們正處於一個真正關乎模型在現實世界中能做什麼的階段。」

比如在編程比賽中與人類一較高下。在今年於日本舉行的 AtCoder 競賽中擊敗 OpenAI 模型的人是一名名叫Przemysław Dębiak的程序員,他也被稱為 Psyho。這場比賽是一場解謎馬拉松,參賽者有 10 個小時的時間來找到解決複雜編程問題的最高效方法。在他獲勝後,Psyho 在 X 上發文說:「我完全筋疲力盡……我幾乎要崩潰了。」

Chen和Pachocki與競爭性編程的世界有着深厚的聯繫。他們過去都參加過國際編程比賽,Chen還指導美國計算機奧林匹克競賽隊。我問他們,對競爭性編程的個人熱情是否影響了他們對模型在這種挑戰中表現出色的重要性看法。

他們倆都笑了。「當然,」Pachocki說。「所以:Psyho 是一種傳奇人物。他多年來一直是排名第一的選手。他實際上也是我的朋友我們過去常在一起參加這些比賽。」Dębiak也曾與Pachocki在 OpenAI一起工作過。

當Pachocki參加編程比賽時,他更喜歡那些關注較短問題且有明確解決方案的比賽。但Dębiak喜歡更長、開放式的問題,沒有明顯的正確答案。

「他過去常常取笑我,說我會參加的那種比賽比他喜歡的那種比賽更早被自動化,」Pachocki回憶說。「所以我非常關注這個模型在最近這次比賽中的表現。」

Pachocki告訴我,他一直關注着從東京傳來的深夜直播,看着自己的模型獲得第二名:「Psyho 這次堅持住了。」

「我們已經跟蹤大型語言模型在編程比賽中的表現有一段時間了,」Chen說。「我們看着它們變得比我強,比雅庫布強。這有點像李世石下圍棋。」

李世石是一名圍棋大師,他在 2016 年與谷歌 DeepMind 的圍棋模型 AlphaGo 進行了一系列比賽並輸掉了比賽。這一結果震驚了國際圍棋界,並導致李世石放棄了職業棋手的身份。去年,他告訴《紐約時報》:「在某種意義上,輸給人工智能意味着我的整個世界正在崩潰……我再也無法享受這個遊戲了。」然而,與李世石不同的是,Chen和Pachocki對於被超越感到非常興奮。

但其他人為什麼應該關心這些小衆的勝利呢?很明顯,這種旨在模仿並最終取代人類智能的技術是由那些認為在數學競賽中取得優異成績或與傳奇程序員一較高下是智力巔峯的人構建的。這種對智力的看法偏向於數學、分析這一端是否存在問題?

「我的意思是,我想你說得對你知道,自私地說,我們確實想創建能夠加速我們自身發展的模型,」Chen對我說。「我們將其視為一個非常快速的進步因素。」

像Chen和Pachocki這樣的研究人員所提出的論點是,數學和編程是更通用智能形式的基礎,這種智能可以以我們自己可能想不到的方式解決各種問題。「我們在這裏談論的是編程和數學,」Pachocki說。「但這實際上關乎創造力,提出新奇的想法,將來自不同地方的想法聯繫起來。」

看看最近的兩次比賽:「在這兩種情況下,都有問題需要非常艱難的、突破常規的思考。Psyho 在編程比賽的一半時間裏都在思考,然後想出了一個真正新穎且與我們的模型所考慮的任何內容都相當不同的解決方案。」

「這正是我們所追求的,」Pachocki繼續說道。「我們如何讓模型發現這種新奇的見解?真正推動我們的知識進步?我認為它們已經在某些有限的方式上能夠做到這一點。但我認為這項技術有潛力真正加速科學進步。」

我又回到了關於是否專注於數學和編程是一個問題的問題上,承認也許如果我們正在構建的是幫助我們做科學研究的工具,這沒關係。我們不一定希望大型語言模型取代政治家並具備人際交往能力,我建議道。

Chen皺了皺臉,抬頭望向天花板:「為什麼不呢?」

OpenAI還缺少什麼

OpenAI的成立帶有一種即使在硅谷也很突出的傲慢,當時它就吹噓其構建通用人工智能(AGI)的目標,而當時談論 AGI 還聽起來很荒謬。OpenAI 仍然和以往一樣熱衷於 AGI,並且它比大多數人更多地使 AGI 成為一個主流的數十億美元的焦點。不過,它還沒有實現。我問Chen和Pachocki他們認為還缺少什麼。

「我認為設想未來的方式是真正深入研究我們今天看到的技術,」Pachocki說。「從一開始,OpenAI就將深度學習視為一種非常神祕且顯然非常強大的技術,具有很大的潛力。我們一直在試圖了解它的瓶頸。它能做什麼?它不能做什麼?」

Chen說,目前處於最前沿的是推理模型,這些模型將問題分解成更小、更易於管理的步驟,但即使是它們也有侷限性:「你知道,你有這些模型,它們知道很多事情,但卻無法將這些知識串聯起來。為什麼呢?為什麼它不能像人類那樣做到這一點呢?」

OpenAI正在全力以赴回答這個問題。

「我們可能仍然處於這種推理範式的非常初期階段,」Pachocki告訴我。「真的,我們正在思考如何讓這些模型長期學習和探索,並真正提出全新的想法。」

Chen強調了這一點:「我真的不認為推理已經完成。我們絕對沒有解決這個問題。你必須閱讀大量的文本,才能對人類所知道的東西有一個大致的了解。」

OpenAI不會透露其用於訓練模型的數據,也不會透露有關模型的大小和形狀的細節只說它正在努力使開發過程的各個階段更加高效。

這些努力使他們相信,所謂的規模定律這些定律表明,隨着你投入更多的計算能力,模型將繼續變得更好並沒有顯示出任何崩潰的跡象。

「我認為沒有證據表明規模定律已經死亡,」Chen堅持說。「總是存在瓶頸,對吧?有時它們與模型的構建方式有關。有時它們與數據有關。但從根本上說,這只是關於找到能夠突破當前瓶頸的研究。」

我對進步的信心是堅定不移的。我提到了Pachocki在 5 月接受《自然》雜誌採訪時關於 AGI 的說法:「2017 年我加入OpenAI 時,我仍然是公司裏最大的懷疑論者之一。」他看起來有些懷疑。

「我不確定我對這個概念是否懷疑,」他說。「但我認為我是」他停頓了一下,看着放在面前桌子上的手。「當我加入 OpenAI 時,我預計達到我們現在所處的階段的時間會更長。」

「人工智能有很多後果,」他說。「但我最常思考的是自動化研究。當我們回顧人類歷史時,其中大部分是關於技術進步的,是關於人類構建新技術的。當計算機能夠自己開發新技術時,這似乎是一個非常重要的、嗯,轉折點。

「我們已經看到這些模型協助科學家。但當它們能夠從事更長期的工作當它們能夠為自己建立研究項目時世界將會有實質性的不同。」

對於Chen來說,模型能夠獨立工作更長時間的能力是關鍵。「我的意思是,我認為每個人對通用人工智能都有自己的定義,」他說。「但這個自主時間的概念模型在遇到死衚衕時能夠花在解決一個難題上的時間是我們所追求的一個重要目標。」

這是一個大膽的願景遠遠超出了當今模型的能力。但我仍然被Chen和Pachocki使通用人工智能聽起來幾乎平淡無奇的方式所打動。與 18 個月前我和Sutskever交談時他的反應相比,他當時告訴我:「這將是具有里程碑意義的,是震撼世界的。這將是一個分水嶺。」面對他正在構建的東西的巨大性,Sutskever將他的職業生涯重心從設計越來越好的模型轉移到弄清楚如何控制他認為很快就會比自己更聰明的技術上。

兩年前,Sutskever成立了一個所謂的超級對齊團隊,他將與另一位 OpenAI 安全研究員揚·萊克(Jan Leike)共同領導這個團隊。該團隊聲稱將投入 OpenAI 五分之一的資源來研究如何控制假設中的超級智能。如今,超級對齊團隊的大多數人,包括Sutskever和萊克,都已離開公司,該團隊也不復存在。

萊克離職時說,是因為該團隊沒有得到他認為應得的支持。他在 X 上發帖說:「製造比人類更聰明的機器本質上是一項危險的事業。OpenAI 正代表全人類肩負着巨大的責任。但在過去幾年裏,安全文化和流程被耀眼的產品所忽視。」其他離職的研究人員也發表了類似的聲明。

我問Chen和Pachocki他們如何看待這些擔憂。「很多事情都是非常個人的決定,」Chen說。「你知道,研究人員可能會有一種信念,認為該領域將朝着某個方向發展,他們的研究將取得成果並結出碩果。而你知道,也許公司並沒有按照你希望的方式進行調整。這是一個非常動態的領域。」

「很多事情都是非常個人的決定,」他重複道。「有時該領域的發展方向與你的研究方式不太一致。」

但他們倆都堅持認為,對齊現在是核心業務的一部分,而不是某個特定團隊的專屬問題。根據Pachocki的說法,這些模型根本無法工作,除非它們按照你的預期工作。而且,當現有的模型已經足夠具有挑戰性時,人們也不太願意專注於將假設中的超級智能與你的目標對齊。

「兩年前,我們所想象的風險大多是理論上的風險,」Pachocki說。「如今的世界看起來大不相同了,我認為許多對齊問題現在都是出於非常實際的動機。」

然而,實驗性技術被轉化為大衆市場產品的速度比以往任何時候都要快。這真的不會導致他們之間產生分歧嗎?

「我常常有幸能夠真正思考技術的長期發展方向,」Pachocki說。「應對過程的現實無論是人員方面,還是更廣泛的公司需求都落在了Chen身上。這並不是真正的分歧,但在我們之間確實存在一種自然的緊張關係,這種緊張關係源於公司面臨的這些不同的目標和不同的挑戰。」Chen插話說:「我認為這只是一個非常微妙的平衡。」