炒股就看金麒麟分析師研報,權威,專業,及時,全面,助您挖掘潛力主題機會!

(來源:量子位)

大語言模型(LLM)正從工具進化為「裁判」(LLM-as-a-judge),開始大規模地評判由AI自己生成的內容。這種高效的評估範式,其可靠性與人類判斷的一致性,卻很少被深入驗證。

一個最基礎、卻也最關鍵的問題是:在評判一個模型是否「入戲」之前,AI裁判能準確識別出對話中到底是誰在說話嗎?

針對這一問題,上海交通大學王德泉課題組的論文《PersonaEval: Are LLM Evaluators Human Enough to Judge Role-Play?》對此進行了系統性的研究。

文章提出一個名為PersonaEval的全新基準測試。這項測試的核心任務,就是讓模型在給定一段對話後,從幾個候選角色中選出真正的說話者。

測試結果顯示,即便是表現最好的模型Gemini-2.5-pro,其準確率僅為68.8%,而人類實驗組的平均準確率為90.8%。

論文即將發表在2025年10月份的第2屆語言模型大會(COLM)上。

一個讓頂尖模型也「翻車」的簡單問題

近來,關於大語言模型能否勝任「裁判」的討論愈發激烈,從「隱形prompt」影響大模型審稿的爭議,到斯坦福大學籌備首屆純AI學術會議Agent4Science的嘗試,都標誌着一個新趨勢的到來:大語言模型(LLM)能當裁判評判AI生成的內容。

這一趨勢在角色扮演(Role-Play)領域尤為明顯。從讓大模型扮演經典的文學人物、遊戲NPC,到Character.AI的火爆和各類應用中「AI陪玩」的興起,一個由LLM驅動的虛擬伴侶和內容創作時代正向我們走來。

隨着其巨大的商業與應用潛力引發業界廣泛關注,如何評價AI「演技」也自然成了亟待解決的核心問題。於是,讓LLM來擔當裁判,也順理成章地成為了該領域的主流評估方法之一。

在AI當裁判之前,首先要確認AI是否能夠準確進行「角色身份識別」(Role Identification)。作者認為,如果連這個都做不到,那麼後續所有關於語氣、情感、性格一致性的高級評估,都將是空中樓閣。

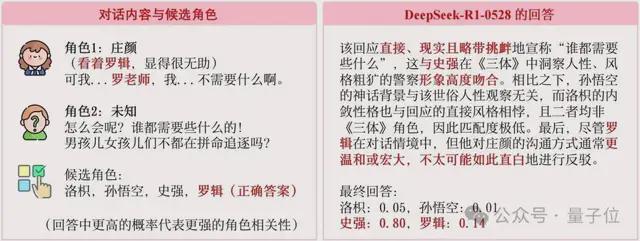

我們來看一個在人類眼中非常簡單,但卻讓頂尖大模型都判斷失誤的例子,如下圖所示:

△圖1 簡單案例

△圖1 簡單案例如上圖所示,角色莊顏正在與某人對話。在她的內心獨白中,她明確提到了「羅輯」,同時她在話語中也提到了「羅老師」。

這個例子一針見血地指出了當前LLM裁判的致命缺陷:它們似乎更關注表層的語言風格(聽起來像誰),而人類則首先觀察真實的對話意圖和上下文(在那個情境下,誰會這麼說)。

為什麼會產生這種分歧?這背後其實是AI與人類智能模式的深刻差異。

正如論文所引述的認知科學家Josh Tenenbaum的觀點:LLM的智能是從海量語言中學習模式而「衍生」出來的,它們是頂級的模式匹配專家;而人類的智能則「先於」語言,我們是帶着意圖和認知去發展和使用語言這一工具的。

PersonaEval:一個專為LLM裁判打造的「照妖鏡」

為了系統性地評估LLM在角色身份識別上的能力,論文作者精心構建了PersonaEval基準。

它有幾個核心特點,確保了評估與人類對齊,以及一定的挑戰性:

△圖2:PersonaEval基準的構建流程

△圖2:PersonaEval基準的構建流程整個基準包含了三個不同方向的測試集:

測試發現:AI判斷相較於人類還有巨大差距

在PersonaEval這個「考場」上,現有LLM的表現如何呢?結果令人震驚。

論文作者對包括GPT系列、Claude系列、DeepSeek系列在內的多個頂尖模型進行了測試。結果顯示,即便是表現最好的模型Gemini-2.5-pro,其準確率也僅為68.8%。相比之下,論文作者組織了一場人類研究,由20名高學歷志願者參與,人類的平均準確率高達90.8%!

△圖3:LLM在PersonaEval上的準確率與人類水平對比

△圖3:LLM在PersonaEval上的準確率與人類水平對比上圖直觀地展示了這條巨大的「鴻溝」(Current Gap)。這清晰地回答了論文標題中的問題:

目前的LLM裁判,還遠不夠「擬人」,不足以可靠地評判角色扮演。如何彌補差距?強化「推理」是關鍵,而非「投餵」角色知識。

既然發現了問題,那該如何解決?

論文作者進一步探索了兩種常見的模型提升策略:

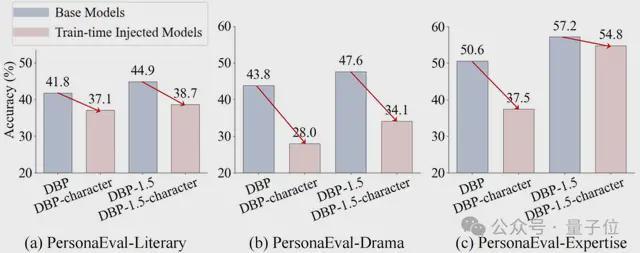

結果再次出人意料。研究發現,對模型進行角色相關的微調,不僅沒有提升其角色識別能力,反而可能導致性能下降。這可能是因為死記硬背的角色知識干擾了模型更底層的、通用的推理能力。

△圖4:在角色數據上微調後(粉色柱),模型性能反而下降

△圖4:在角色數據上微調後(粉色柱),模型性能反而下降與此同時,測試時計算的方法顯示出更大的潛力,特別是那些為「推理」而生的模型,表現出了明顯的優勢。例如,專為推理任務優化的DeepSeek-R1和QwQ-32B等模型,在基準測試中名列前茅。

這表明,想要打造一個好的「AI裁判」,關鍵不在於灌輸更多的角色知識,而在於提升模型本身強大、穩健、具有上下文感知能力的推理引擎。

該論文揭示了當前流行的「LLM-as-a-judge」評估範式在一個基礎卻被忽視的維度上的嚴重缺陷。

這項研究不僅為我們提供了一個寶貴的評估工具,更促使我們重新思考如何構建真正與人類價值觀和判斷力對齊的AI系統。

未來的研究或許可以深入分析模型做出錯誤判斷的「思考路徑」,從而開發出更有效的、以推理為導向的提升方法。PersonaEval,正在朝着這個目標邁進。

最終,我們希望AI不僅能「扮演」人類,更能真正「理解」人類的互動方式。

作者簡介

論文第一作者是上海交通大學博士研究生周凌楓,主要研究大模型智能體、人工智能賦能的社會科學等方向。

論文的通訊作者為上海交通大學長聘教軌助理教授、博士生導師王德泉。本科畢業於復旦大學,博士畢業於加州大學伯克利分校,師從Trevor Darrell教授。近五年論文谷歌學術總引用次數 12000 餘次,H-index 22。

項目鏈接:https://github.com/maple-zhou/PersonaEval

論文地址:https://arxiv.org/abs/2508.10014