作者 | 李水青

編輯 | 心緣

智東西10月15日報道,今日,阿里通義千問團隊推出其最強視覺語言模型系列Qwen3-VL的4B與8B版本,兩個尺寸均提供Instruct與Thinking版本,在幾十項權威基準測評中超越Gemini 2.5 Flash Lite、GPT-5 Nano等同級別頂尖模型。

阿里千問團隊公告截圖(圖源:X平台)

這兩個新版本模型實現了以下關鍵目標:

1、資源門檻更低:尺寸縮減顯著降低VRAM的佔用。現在,開發者可以在更廣泛的硬件設備上部署和運行模型。

2、核心能力不減配:在縮減尺寸的同時,其完整保留了Qwen3-VL的全部核心功能。

3、基準性能優秀:在STEM、VQA、OCR、視頻理解及Agent任務等多個權威基準上,其表現不僅超越了Gemini 2.5 Flash Lite和GPT-5 Nano,在許多場景下甚至能與阿里半年前的旗艦模型Qwen2.5-VL-72B相媲美。

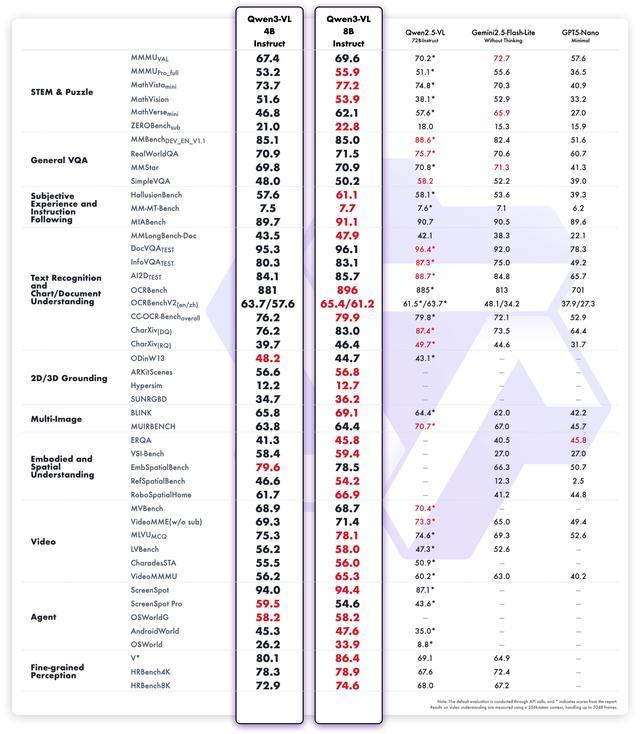

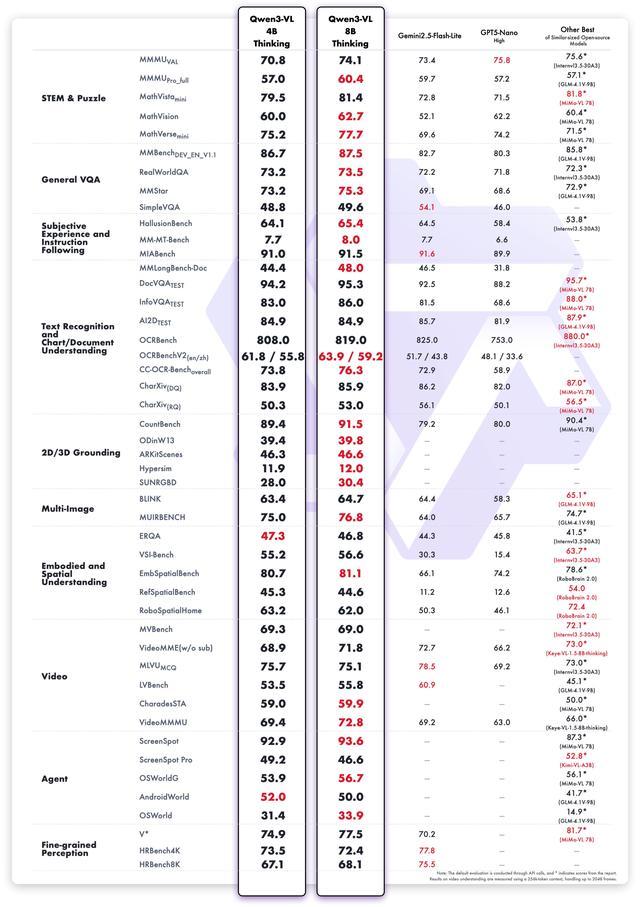

如下圖所示,在多模態性能方面,Qwen3-VL-8B Instruct在MIABench、OCRBench、SUNRGBD、ERQA、VideoMMMU、ScreenSpot等30項權威基準測評中取得SOTA(行業最佳)成績,超越了Gemini 2.5 Flash Lite、GPT-5 Nano以及Qwen2.5-VL-72B等頂尖模型。

Qwen3-VL-8B Instruct與Qwen3-VL-4B Instruct基準測評情況(圖源:Qwen)

Qwen3-VL-4B Instruct也展現出優秀的多模態性能,以更少的參數量,在STEM、VQA、OCR、視頻理解及Agent任務等測評中,能與Gemini 2.5 Flash Lite、GPT-5 Nano對打。

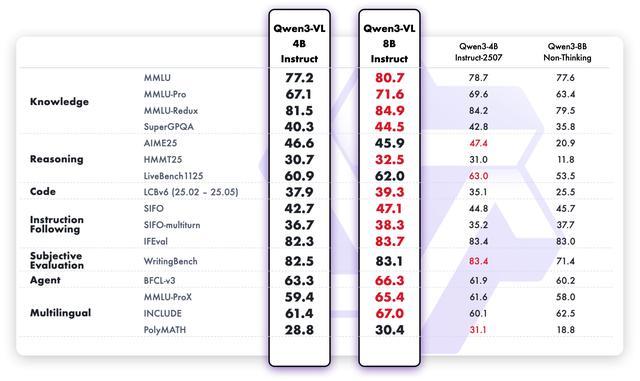

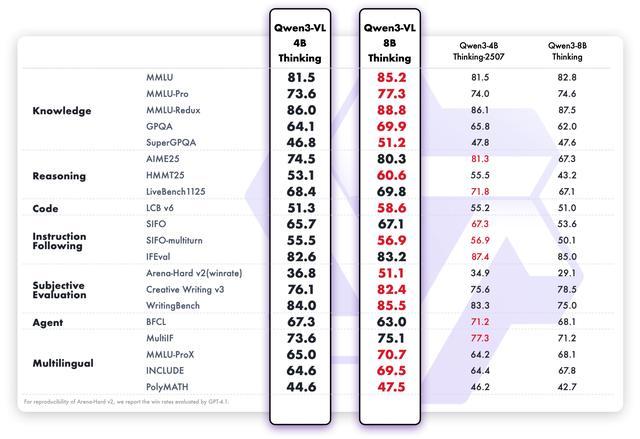

在純文本表現上,如下圖所示,Qwen3-VL-8B Instruct和Qwen3-VL-4B Instruct也相比Qwen3-4B Instruct-2507和Qwen3-8B Non-Thinking有整體提高。

Qwen3-VL-8B Instruct與Qwen3-VL-4B Instruct基準測評情況(圖源:Qwen)

在多模態性能方面,Qwen3-VL-8B Thinking取得了MathVision、MMStar、HallusionBench、MM-MT-Bench、CountBench等23項權威基準測評的SOTA,超越Gemini 2.5 Flash Lite、GPT-5 Nano高版本以及其他同等級頂尖開源模型。Qwen3-VL-4B Thinking同樣表現出「以小敵大」的成績。

Qwen3-VL-8B Thinking與Qwen3-VL-4B Thinking基準測評情況(圖源:Qwen)

在純文本表現上,Qwen3-VL-8B Thinking和Qwen3-VL-4B Thinking相比於Qwen3-4BThinking-2507和Qwen3-8B Thinking有整體提高。

Qwen3-VL-8B Thinking與Qwen3-VL-4B Thinking基準測評情況(圖源:Qwen)

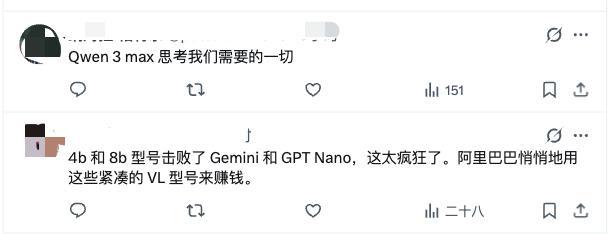

該模型一經發布,就在外網引起了不少開發者關注。不少人對此表示一直在等這個,有人稱:「終於,我在16GB的Mac上可以用了。」也有不少人開始催更Qwen3-Max及其他更多版本模型了。

外網用戶對新版本Qwen3-VL的評論(圖源:X平台)

自9月24日阿里開源Qwen3-VL系列以來,作為Qwen系列中最強的視覺語言模型,該模型在全球AI開源社區中快速收穫認可。(《阿里又一大模型開源,手機電腦樣樣玩的溜,多項測試秒GPT-5》)

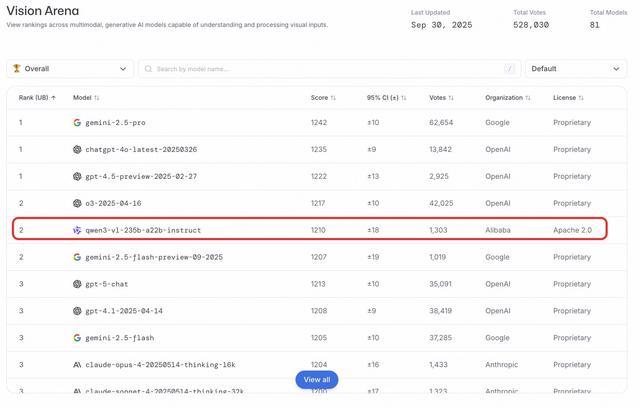

在9月底的Chatbot Arena子排行榜Vision Arena中,Qwen3-VL位居第二,是視覺理解領域中的全球開源冠軍;同時,Qwen3-VL還斬獲純文本賽道(Text Arena)的開源第一(全球第8),成為首個攬獲純文本和視覺兩大領域同時開源第一的大模型。

在Vision Arena中Qwen3-VL位居第二(圖源:Qwen)

並且,Qwen3-VL還在全球知名的大模型API三方聚合平台OpenRouter圖像處理排行榜上以48%的市場份額躍升至全球第一。

Qwen3-VL在OpenRouter圖像處理排行榜上表現(圖源:OpenRouter)

近期,阿里還推出Qwen3-VL Cookbook(使用指南),涵蓋圖像思維、計算機使用Agent、多模態變成、3D定位、空間推理、視頻理解等多種多模態用例,助用戶高效上手和深度應用。