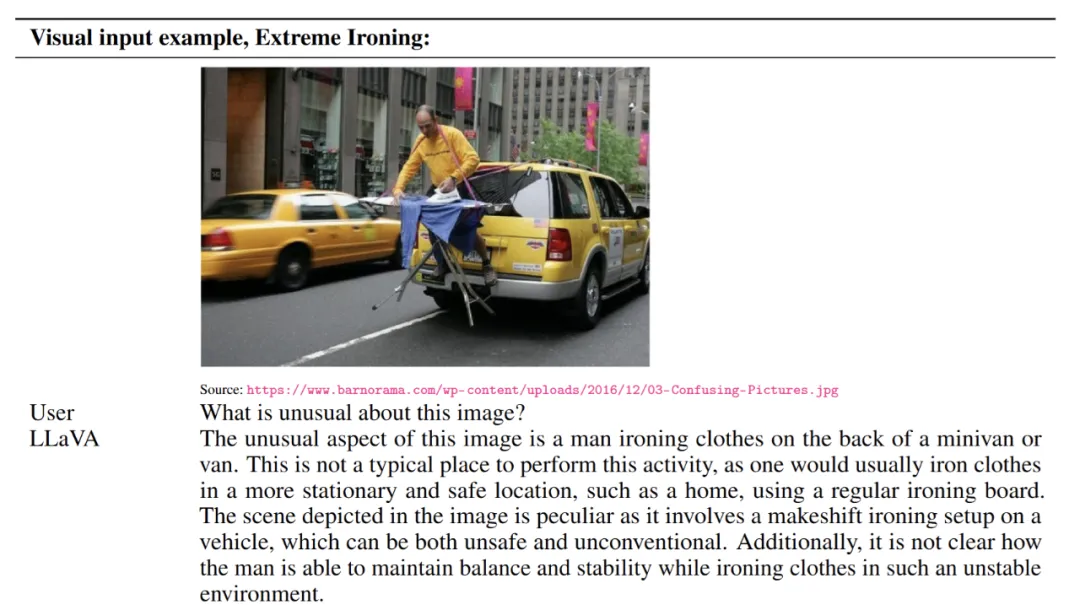

LLaVA 於 2023 年提出,通過低成本對齊高效連接開源視覺編碼器與大語言模型,使「看圖 — 理解 — 對話」的多模態能力在開放生態中得以普及,明顯縮小了與頂級閉源模型的差距,標誌着開源多模態範式的重要里程碑。

LLaVA 用低成本對齊打通「視覺編碼器 + 大語言模型」起步,LLaVA-1.5 以更大更乾淨的數據與高分辨率輸入強化理解,LLaVA-NeXT 拓展 OCR / 數理與多場景任務;隨後分支為 LLaVA-NeXT-Video 處理時序視頻、多幀推理,及 LLaVA-NeXT-Interleave 支持交替多圖文與跨圖聯推;最終在 LLaVA-OneVision 匯聚為統一接口,覆蓋圖像 / 文檔 / 圖表 / 多圖 / 視頻,兼顧效果與效率。

儘管多模態對齊的接口與架構趨於收斂,真正「可復現」的開源路徑仍與「僅開放權重」存在間距。Qwen2.5-VL、InternVL3.5 在 OCR、文檔理解、數理與跨圖推理上樹立高基線,但完整的數據清單、清洗與混合比例,以及對齊 / 採樣與訓練日程多為部分披露,難以端到端重現。Molmo 以更乾淨的數據流水線與精細化設計,在多項評測與偏好中逼近閉源強基線;Open-Qwen2VL 則表明在更高效範式下,即便原始多模態 token 佔比較低亦能取得強對比性能。當前主要鴻溝在於 「配方與工程細節的可復現性」,而非單一的模型架構選擇。

靈感實驗室團隊聯合 LMMs-Lab 圍繞「高性能 — 低成本 — 強復現」三大目標,在 LLaVA-OneVision 體系上推出完整開放的概念均衡 85M 預訓練數據集(LLaVA-OV-1.5-Mid-Training-85M)與精篩 22M 指令數據集(LLaVA-OV-1.5-Instruct-22M),並沿用緊湊的三階段流程(語言–圖像對齊 Stage-1、概念均衡與高質量知識注入 Stage-1.5、指令微調 Stage-2),結合離線並行數據打包(最高約 11× padding 壓縮)與 Megatron-LM + 分佈式優化器,將 8B 規模 VL 模型的 Stage-1.5 預訓練在 128 張 A800 上控制在約 4 天內完成,預算控制在 1.6 萬美元。

在此基礎上,我們提出 LLaVA-OneVision-1.5,繼承並擴展 LLaVA 系列:引入 RICE-ViT 支持原生分辨率與區域級細粒度語義建模、強化圖表 / 文檔 / 結構化場景理解,延續緊湊三階段範式以避免冗長 curriculum,構建並強調「質量 — 覆蓋 — 均衡」的 85M 預訓練與 22M 指令集合,並真正意義上實現全鏈條透明開放(數據、訓練與打包工具鏈、配置腳本、日誌與可復現評測命令及其構建與執行細節),以確保社區低成本復現與可驗證拓展。

實驗結果顯示,LLaVA-OneVision 在多項公開多模態基準上較 Qwen2.5-VL 展現出競爭性乃至更優性能(詳見技術報告)。

論文標題: LLaVA-OneVision-1.5: Fully Open Framework for Democratized Multimodal Training 代碼地址: https://github.com/EvolvingLMMs-Lab/LLaVA-OneVision-1.5 技術報告地址: https://arxiv.org/abs/2509.23661 數據 / 模型地址: https://huggingface.co/collections/lmms-lab/llava-onevision-15-68d385fe73b50bd22de23713 Demo: https://huggingface.co/spaces/lmms-lab/LLaVA-OneVision-1.5 |

數據構建要點

用於通用視覺語言的預訓練集(85M)與指令微調數據集(22M)。其中 85M 預訓練數據融合 COYO-700M、Obelics、DataComp-1B、LAION-CN、ImageNet-21K、SAM-1B、MINT、Zero250M 等 8 大異構來源,形成約 2,000 萬中文與 6,500 萬英文圖文對。

為破解長尾概念稀疏與原始 caption 噪聲 / 缺失問題,我們不再依賴原始文本詞頻,而是採用特徵驅動的「概念均衡」策略:利用 MetaCLIP 編碼器將全部圖像與 50 萬規模概念詞嵌入共享向量空間,對每張圖像檢索 Top-K 最相似概念,統計概念頻次後按逆頻加權重採樣,抑制高頻背景類並提升罕見細粒度實體、屬性與場景佔比,顯著平坦化長尾分佈;隨後使用高質量 Captioner 生成對齊的中英文增強描述。系統實驗表明,在相同或更低 token 預算下,擴大高質量數據規模並結合概念均衡採樣,可在多模態理解、長尾識別與指令泛化等核心指標上獲得顯著且可復現的性能提升。

指令數據 22M 覆蓋八大類別:Caption、Chart & Table、Code & Math、Domain-specific、General VQA、Grounding & Counting、OCR、Science。通過多源聚合、格式統一、指令重寫、雙語互轉、模板去同質化與安全篩除,保持類別與難度分佈均衡。並且我們的指令數據疊加 FineVision 數據集之後,結果會繼續增加。

訓練策略

1. 視覺編碼器預訓練

為了讓模型在 OCR、表格 / 文檔、區域理解與後續指令推理上具有更高的下限,我們在 LLaVA-OneVision-1.5 中採用自研的 MVT v1.5(RICE-ViT) 作為視覺主幹。

相較僅做全局對齊的 CLIP / SigLIP 類對比模型,RICE-ViT 針對「實例只用單一全局向量」這一結構性瓶頸,引入統一的 Region Cluster Discrimination 機制:在 4.5 億圖像與 24 億候選區域上訓練,利用區域聚類判別 + 區域感知注意力顯式建模局部實體 / 文本塊與上下文關係,並結合 2D 旋轉位置編碼(2D RoPE)實現多分辨率原生支持。

與 SigLIP2 依賴多套專用損失(SILC、TIPS、LocCa 等)不同,我們用單一聚類判別範式同時強化通用語義、OCR 識別與定位能力,訓練與推理鏈路更簡潔、可維護性更高。在多模態融合階段,通過輕量投影與後續全參數聯合訓練,將這一細粒度語義底座無縫接入語言模型,減少冗餘適配模塊並提升跨任務遷移效率。

2. 三階段學習流程

Stage-1:語言–圖像對齊

使用 LLaVA-1.5 558K 數據集訓練視覺投影層,將視覺編碼輸出映射到語言模型詞嵌入空間。此階段控制參數更新範圍以快速穩定收斂。

Stage-1.5:高質量知識中期預訓練

在概念均衡的 85M 預訓練數據上進行全參數訓練,注入廣域視覺語義與世界知識,強調數據質量與覆蓋而非盲目擴張 token 規模。

Stage-2:視覺指令對齊

基於 22M 指令數據與 FineVision 等多源視覺指令語料繼續全參數訓練,提升任務泛化、推理組織與響應格式控制能力。

3. 離線並行數據打包

為降低多模態樣本長度差異帶來的 padding 浪費、提升有效 token 利用率,我們採用離線並行數據打包:先按樣本長度或長度區間進行哈希桶聚類,減少全局排序與掃描成本;再在數據準備階段以多線程將多條短樣本拼接為接近目標長度的定長序列。該流程一次性處理全量語料,具備確定性與可復現性,避免在線動態打包引入的運行時不穩定與額外 CPU 開銷。

在 85M 規模的預訓練樣本上,相比原始方案可實現最高約 11× 的 padding 有效壓縮(定義:原始方案總 padding token / 打包後總 padding token)。

4. 混合併行與長上下文高效訓練,訓練端採用混合併行與長上下文優化

張量並行(TP)+ 流水並行(PP)+ 序列 / 上下文並行(Sequence/Context Parallel)與分佈式優化器協同,以在大規模集群中同時提升算力利用與顯存效率;同時採用原生分辨率策略,保留圖表、文檔與密集文本區域的結構細節,避免統一縮放帶來的信息損失。

在 128×A800 集群上,8B 規模模型的 Stage-1.5(85M 樣本、原生分辨率)約 3.7 天完成,兼顧吞吐與成本。

結論

LLaVA-OneVision-1.5 證明:依託概念均衡的 85M 預訓練數據與高質量指令數據,結合 RICE-ViT 細粒度視覺底座和緊湊的三階段策略(對齊—高質量知識注入—指令泛化),再配合離線並行打包(最高約 11× padding 減少)與混合併行 / 原生分辨率等工程優化,8B 規模即可在更低 token 與算力成本下,對標乃至部分超越主流開源與部分閉源多模態模型,體現「高質量結構化數據 + 系統效率協同」相較單純堆量的優勢。

這是一次非常簡單的復現工作:我們完整開放數據、工具鏈、腳本、配置、日誌與評測配方,復現路徑清晰、依賴明確,無需複雜調參即可跑通。