新智元報道

編輯:KingHZ

【新智元導讀】UC Berkeley、UW、AI2 等機構聯合團隊最新工作提出:在恰當的訓練範式下,強化學習(RL)不僅能「打磨」已有能力,更能逼出「全新算法」級的推理模式。他們構建了一個專門驗證這一命題的測試框架 DELTA,並觀察到從「零獎勵」到接近100%突破式躍遷的「RL grokking」現象。

在AI研究圈,一個核心爭論是:強化學習(RL)是否能夠賦予模型超越其基礎模型(base model)的推理能力。

懷疑派觀點:早在四月份,清華的黃高團隊[arXiv:2504.13837]指出,儘管經過 RLVR 訓練的模型在較小的採樣值 (k)(例如 (k=1))時能優於其基礎模型,但當採樣數較大時,基礎模型往往能取得相同或更好的 pass@k 表現。

他們通過覆蓋率(coverage)和困惑度(perplexity)分析推斷,模型的推理能力最終受限於基礎模型的支持範圍。

類似地,斯坦福崔藝珍團隊 [arXiv:2507.14843] 從理論上論證了 RLVR 無法突破基礎模型的表徵極限。

這種懷疑的直覺在於:

大多數面向推理的強化學習(如 GRPO、PPO 等變體)通過比較同一提示詞(prompt)下多個採樣的獎勵來更新模型。

如果這些採樣中沒有一個成功解決任務(即 pass@K = 0),那麼所有樣本的獎勵都是一樣差的,此時梯度將會消失。

所以關鍵的問題在於,當基礎模型(base model)在某類任務上完全無法解答(pass@K=0)時:

RL是否還能突破零梯度瓶頸,真正學到新策略?

來自加州大學伯克利分校(UC Berkeley)與AI2、華盛頓大學等機構的研究團隊,近日給出了一個令人振奮的答案:

RL確實能讓模型發現全新的推理模式——但前提是,需要不一樣的訓練方式。

他們的最新工作《RL Grokking Receipe: How Does RL Unlock and Transfer New Algorithms in LLMs?》提出了一個嶄新的測試框架 DELTA,專門用來驗證該觀點。

這項研究為「RL是否能突破模型邊界」這一爭論,帶來了新的實驗依據。

論文:https://www.arxiv.org/abs/2509.21016

博客:https://rdi.berkeley.edu/blog/rl-grokking-recipe

相關資源清單(持續更新):https://github.com/rdi-berkeley/awesome-RLVR-boundary

從「打磨」到「頓悟」

RL真學到新算法了?

在主流觀點中,RL似乎被困在「隱形的繩子」上 ——

模型的pass@1雖然提高,但在大規模採樣下(如pass@128)性能並未擴展。

這意味着它可能只是重新分配已有策略的概率,而不是創造新的策略。

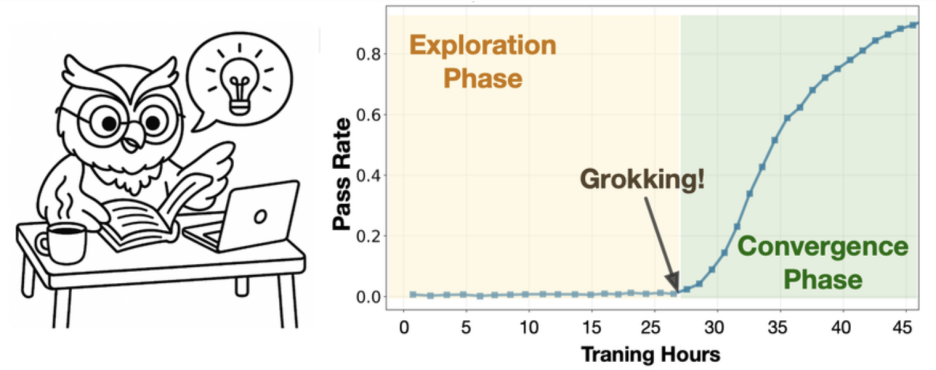

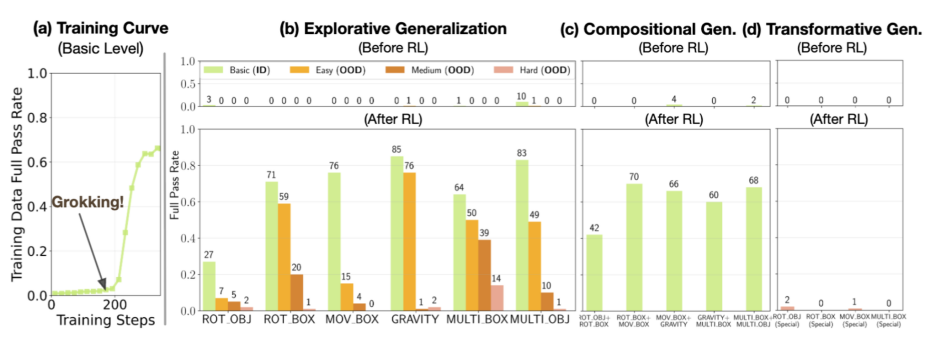

然而,伯克利團隊在 DELTA 測試中發現了「頓悟式躍遷」: 在多個基礎模型完全失敗的任務族中,RL訓練經歷了一個長時間的「零獎勵平台期」,隨後突然出現了準確率接近100%的躍遷 (phase transition) 。

研究者將此描述為 「RL grokking」:那不是微調的延展,而是「想通了」的瞬間。

一個「分佈外任務學習性」試煉場

很多工作聲稱「新任務」,但其實仍落在模型的知識範圍內。

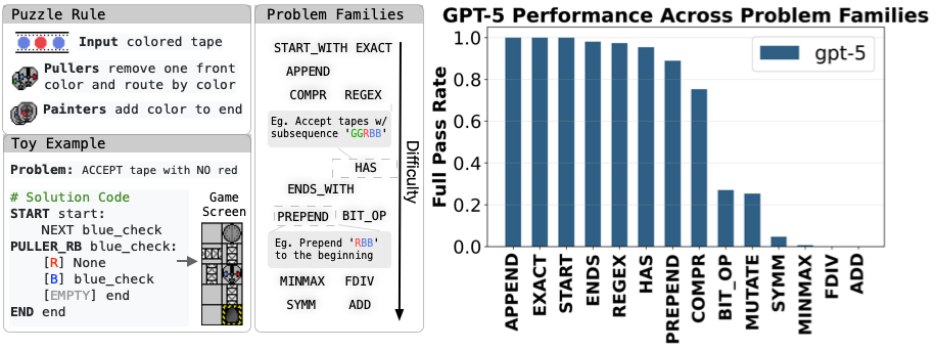

伯克利團隊這次刻意設計的任務,卻真正做到了脫離模型經驗的外部分佈 (Out-of-Distribution):

1. 全新的語言——互聯網上從未出現過。

研究團隊以經典2010 flash遊戲Manufactoria為靈感,構建了一個全新的合成編程世界。

該遊戲的解法僅以圖片的形式存在,為了適配語言模型,作者引入了一種全新的程序描述語言,僅由兩種原始指令組成:

Puller:從左側讀取並移動符號;

Painter:在右側寫入或標記符號,以此來完成輸入輸出匹配任務。

2. 全新的任務家族——不是重混關卡,而是全新打造。

研究者不是簡單復刻原始的謎題,而是合成了一批全新問題族。這些問題族的難度有簡單有困難,最難的問題使得GPT-5都只有0的正確率。

3. 全新的推理方式——與常規代碼推理完全不同。

傳統代碼學習依賴控制流(if/for/while)和數據結構(stack/list/map)。

而在這個極簡世界裏,模型必須發明一種有限狀態機式的推理方式:通過在帶子兩端不斷搬運和標記顏色,完成路由、緩存、比較等操作。

換句話說,模型得在沒有變量的環境中「自造算法」。這是一種人類都要重新思考的推理方式。

如果一個RL模型在這裏能學會通用策略,那幾乎可以排除掉「記憶已有代碼模式」的可能,它確實在學習新的算法結構。

破解零梯度詛咒的關鍵

兩階段獎勵調度

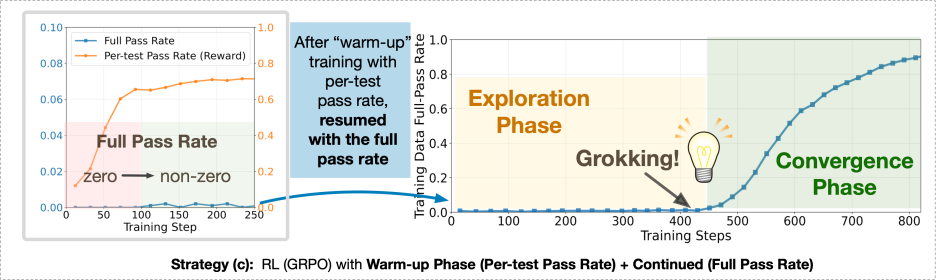

伯克利團隊的突破在於,他們重新設計了獎勵函數的結構。

階段一:密集獎勵(dense reward)

在每個測試用例上給部分分數,而非非黑即白的0/1。即使程序只通過了一半測試,也能獲得部分獎勵。這讓模型從「全零」中獲得一絲梯度信號,開始摸索。

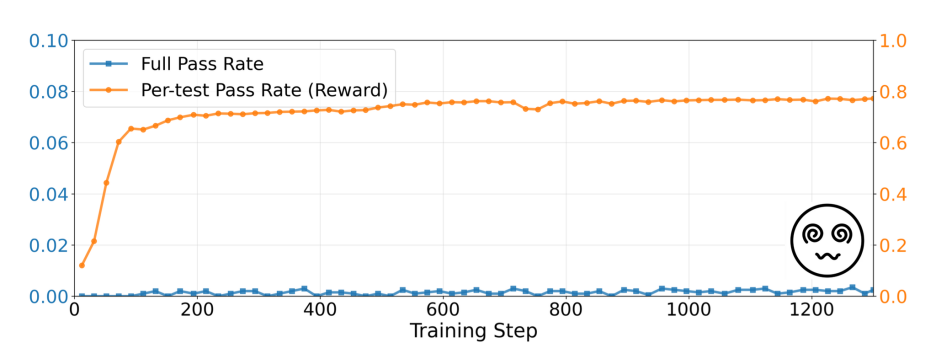

問題是: 密集獎勵雖然讓模型「活了」,但它學會的往往是「投機解」——通過簡單模式騙過部分測試。

結果是:平均分高了,完全通過率仍接近0。

階段二:切換回二值獎勵(binary reward)

研究者發現,關鍵在於時機的切換。當模型通過密集獎勵階段獲得「半正確」策略後,再切換到「全對纔算贏」的二值獎勵,模型突然迎來那一刻——Grokking Phase Transition:從模糊到精確的飛躍。

在約450步後,模型突然學會了任務的核心算法,從此訓練進入「強化收斂」階段,成功率穩定在近100%。那一瞬間,你幾乎能看到模型‘領悟’了規律。

在DELTA的多種任務族中,研究者觀測到高度一致的學習曲線:前幾百步內,獎勵幾乎為零;接着出現一次陡峭的提升;模型學會了任務核心邏輯,性能穩定在近乎100%。

這條曲線如同人類的學習歷程——先是漫長摸索,然後靈光乍現。

頓悟後的技能能否遷移?

團隊進一步設計了 BouncingSim 測試場景,讓模型預測小球的彈跳軌跡。

這是一個涉及物理規律與組合推理的任務,是一個極具挑戰性的編程任務。

結果顯示:

模型能在訓練後期出現相似的「頓悟曲線」;

對於可組合(Compositional)任務,它能複用學到的子技能;

但面對特殊的動力學規律,模型仍會失效。

這表明,RL 學習到的技能具備有限的遷移能力:它能重組技能,但尚未形成「概念躍遷」的能力。

深層啓示1:RL的兩種模式

該研究總結出RLVR在LLM中的兩種模式:

壓縮模式(Sharpening):重新分配概率,減少輸出方差,提升單次採樣的性能。

發現模式(Discovery):從完全不會(pass@K=0)到穩定解題,實現結構性突破。

而進入發現模式的關鍵在於:獎勵函數設計;探索持續時間;數據混合策略;以及任務的複雜度邊界等等。

深層啓示2:提升「硬核任務」的而非平均分

研究團隊指出,目前RLVR的評測往往在「混合任務池」上取平均,這掩蓋了最關鍵的「硬核任務」突破。

在那些基礎模型完全不會(pass@K=0)的任務上,才最有機會觀察到RL的「創造性突破」。他們建議未來評估指標應顯式報告該子集的表現,因為那纔是衡量「模型是否能發現新策略」的真實信號。

為此,伯克利團隊蒐集並維護了一個在此方向上的代表性工作:

按「立場—方法—評測—數據/基準—討論」分門別類的列表,便於研究者直接定位到 pass@k=0 等硬核子集上的最新證據與方法路徑。

項目地址: https://github.com/sunblaze-ucb/awesome-RLVR-boundary

深層啓示3:從編程邁向數學與科學:RL的新邊疆

為何該工作選擇編程作為突破口?

因為代碼任務天然具備:可驗證的單元測試;細粒度、可組合的反饋信號。

這些特性讓RL能夠精確調節獎勵,形成探索路徑。

研究者認為,這一思路完全可擴展到數學與科學推理領域:

通過自動評分(rubric scoring)、逐步檢驗(step checker)或物理仿真器(simulator feedback)

構建細粒度的獎勵系統,從而讓RL引導模型穿越「無梯度」地帶

結語

模型「真正思考」那一刻

這項研究的意義不僅在於性能提升,而在於它展示了LLM真正的學習潛能:

強化學習不只是打磨,而是讓模型學會「如何思考」。

在AGI前夜的諸多技術路徑中,RLVR 可能是那條讓模型從模仿走向洞察的路。

當模型在接近零反饋的黑暗中摸索,直到某一刻突然頓悟——或許這就是AI的「悟道」瞬間。