IT之家 11 月 17 日消息,量子計算的核心難題在於量子糾錯 —— 如何在極易出錯的量子比特中檢測並移除錯誤。哈佛大學研究團隊開發出了一套能夠將錯誤抑制至關鍵閾值以下的系統。

相關成果已於 11 月 10 日發表在《Nature》上,被視為邁向可實用量子計算的重要一步。

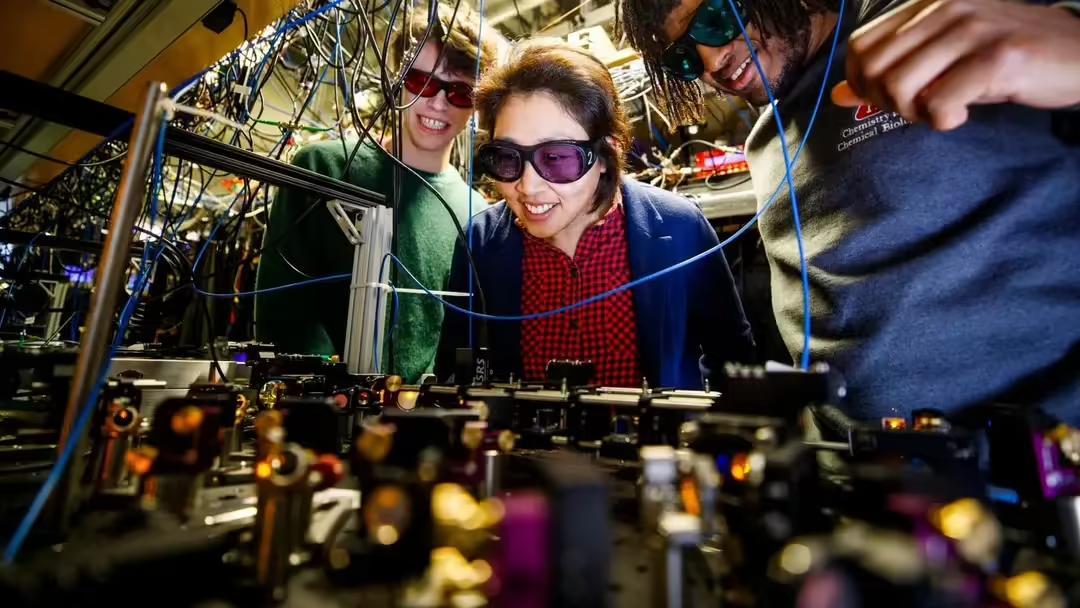

▲ 圖源:哈佛大學,下同

此次合作由哈佛大學和麻省理工學院共同領導,團隊成員來自 Harvard-MIT 實驗室孵化的初創公司 QuEra Computing、馬里蘭大學聯合量子研究所以及美國國家標準與技術研究院等機構。

哈佛量子科學與工程項目聯合主任、論文主要作者 Mikhail Lukin 表示:「我們首次在一個集成架構中結合了可擴展、容錯量子計算所需的全部關鍵要素。這些實驗是目前任何量子平台上最先進的成果之一,為構建實用的大規模量子計算奠定了科學基礎。」

▲ Mikhail Lukin

論文被視為量子糾錯三十年探索中的一次關鍵進展。Lukin 表示:「歸根結底,物理是一門實驗科學。只有在實驗室中實現並檢驗這些基本概念,才能真的看到隧道盡頭的光。」

在這項研究中,科研人員構建了一個包含 448 個原子量子比特的「容錯」系統,並通過多種技術組合操控它們以實現錯誤檢測與糾正。核心機制包括物理糾纏、邏輯糾纏、邏輯魔術以及熵移除,系統還利用了「量子隱形傳態」技術,即在無物理接觸情況下,將一個粒子的量子態傳輸到另一個粒子上。

論文第一作者、現任加州理工學院助理教授的 Dolev Bluvstein 表示:「距離構建擁有數百萬量子比特的大規模量子計算機仍有很多技術挑戰,但這是首次出現概念上可擴展的架構。要實現它仍需大量努力與技術發展,但我們已經越來越清楚地看到,構建容錯量子計算機是可行的。」

量子計算與傳統計算的差異在於其運算單元。經典計算機使用比特,量子計算機則使用量子比特(qubit),由於量子糾纏的存在,量子比特數量增加會帶來指數級的處理能力提升。理論上,300 個量子比特的信息量就超過已知宇宙中粒子的總數。如此巨大的潛力使量子計算有望推動藥物開發、密碼學、機器學習、人工智能、金融和材料科學等領域的突破。然而,量子比特極易失去量子態,導致錯誤率成為量子計算的核心障礙,因此糾錯能力至關重要。

在這項研究中,團隊結合多種方法構建了包含數十層糾錯的複雜量子電路,使系統能夠將錯誤抑制到關鍵閾值以下 —— 即新增量子比特能夠進一步降低錯誤率,而不是帶來更多錯誤。

論文作者之一、哈佛大學 Kenneth C. Griffin 研究生院物理學博士生 Alexandra Geim 指出:「本研究重點在於理解擴展可規模化、深度電路計算所需的關鍵機制。通過理解這一點,我們能夠去除不必要的部分、減少開銷,更快進入實用區間。」

研究團隊使用的是中性原子量子比特,即利用無電荷的銣原子,在激光作用下調整電子排布,使其編碼成量子比特。全球研究團隊正在探索不同的量子比特平台,包括各種原子、離子和超導體系。谷歌 Quantum AI 團隊工程副總裁 Hartmut Neven 稱這項研究在各平台激烈競爭的背景下「代表着向共同目標邁出的重要一步」。

今年 9 月,Harvard-MIT-QuEra 團隊在另一篇發表於《Nature》的論文中展示了一個超過 3000 個量子比特的系統,能夠連續運行兩小時以上,並克服了原子流失的技術難題。隨着一系列進展,Lukin 認為構建量子計算機的核心要素正在逐步到位。「幾十年來我們懷抱的大夢想,現在首次真正變得觸手可及。」