啱啱落幕的全運會,廣東廣播電視台「火力全開」。

作為官方渠道,又是自家主場,他們不僅要直播69項賽事(一度分屏同步直播不同賽事),更要爭分奪秒地捕捉、剪輯、分發精彩瞬間,讓觀衆第一時間享受最新鮮的賽事精華。

作為老朋友,騰訊雲用AI為廣東台助陣——

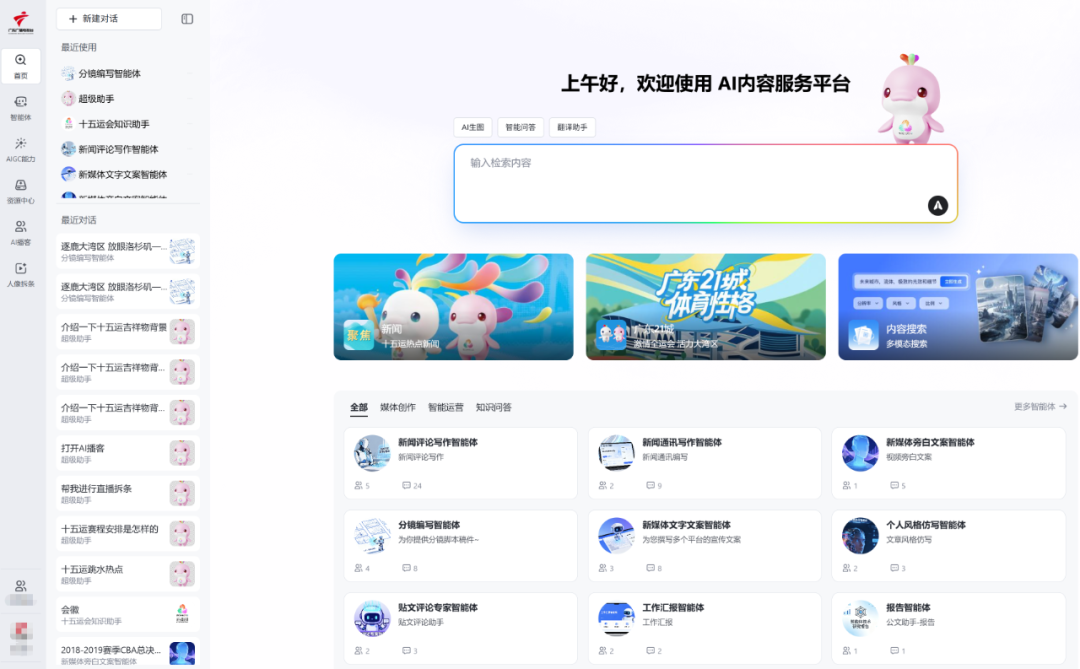

基於騰訊雲ADP(智能體開發平台)打造的「AI內容服務平台」,可以幫助編輯記者朋友們處理直播素材、整理賽事內容,輔助寫新聞稿和做播客等。

這是全棧AI第一次在全運會這樣的大型體育賽事直播中,系統參與內容直播製作環節。對廣東台而言,也是一次融合創新嘗試。整個全運會期間,AI累計輔助廣東台生產了百餘條爆款內容,整體效率提升40%。

AI究竟是怎麼幫助廣東台增效的?是某個環節加速,還是針對工作流提效?往下看——

//智能生產:AI自動值守「出片」,最快僅需幾分鐘

傳統模式下,想剪一條「蘇炳添衝刺」的集錦,編輯記者需要緊盯直播流,標記、剪輯,動輒要幾十分鐘甚至更久。現在,基於AI內容服務平台,這一流程壓縮至十分鐘甚至幾分鐘。

平台依託騰訊雲媒體處理(MPS)AI處理能力,實現直播錄製、直播人物拆條、高光集錦生成三大自動化功能——

直播人物拆條:針對特定運動員,平台採用「人臉識別+人物位置追蹤」組合模型,能識別「運動員身份」並鎖定人物在畫面中的位置。當目標人物離開畫面5到10秒,平台就會自動判斷片段邊界,完成切片打包;

高光集錦生成:基於混元大模型的動態場景理解能力,平台能實時分析運動員動作、裁判手勢以及觀衆反應,自動生成「扣籃」「慶祝」等精彩瞬間。編輯無需回看全部錄像,即可獲得標註好的精華內容。

為了防止AI判斷片段起止點時出現誤差(如動作截取不全),平台還設有智能容錯機制,對關鍵動作前後預留10秒甚至更長的鏡頭緩衝,編輯可自行調整入點和出點,確保剪出來的片子有頭有尾,動作完整。

//智能管理:檢索視頻素材,像「聊天」一樣簡單

生產出海量的精彩片段後,如何快速找到想用的那一條?

騰訊雲提供的「多模態內容管理」,讓編輯可以按片段、場景、摘要或者語音,用自然語言進行內容檢索。

這背後,是一套基於多模態大模型的「理解-記憶」機制。每一條視頻進入素材庫後,AI會為它建立多維度的「數字檔案」:

聽懂聲音。視頻上傳後,平台進行音畫分離,通過語音識別將現場解說、採訪對話等語音轉寫為文本,並根據語義切分成片段;

看懂畫面。視頻素材被拆解為一個個小片段,比如一個運動員的特寫就是一個片段,AI會對每個片段的景別(近景/中景/遠景/特寫)、內容、動作等進行描述,打上標籤;

向量化存儲。所有的聲音文本、畫面描述以及字幕信息等,都轉化為方便AI理解和檢索的「向量」,存入數據庫。

這樣一來,當編輯記者需要某個片段時,無需翻找文件夾,只需在搜索框裏輸入關鍵詞,比如「扣籃得分」,AI就能理解他的意圖,精準定位到相關的畫面和聲音片段,直接推送。

除了視頻生產與檢索,騰訊雲還圍繞編輯記者採編的全流程,配備了一系列開箱即用的AI能力——

智能寫作助手:提供「新聞通訊」「賽事評論」「新媒體文案」「分鏡編寫」等多種風格的智能體,為稿件撰寫提供靈感和初稿;

AI雙人播客:基於騰訊混元播客大模型,可將一篇新聞稿一鍵轉化為生動自然的雙人對話式播客音頻,快速適配視頻號、APP等融媒體平台。

此前,騰訊雲提供的AI技術曾為蘇超賽事提供直播增強、精彩集錦生成等服務,可以自動抓取出每一次射門、撲救和紅黃牌等關鍵瞬間。

全運會的火焰已經熄滅,但賽場上的高光時刻,仍在無數螢幕前閃光。

而廣東台業內首創的AI實踐,正在照亮媒體融合創新的更多可能。我們很榮幸,能夠參與並支持廣東台完成這次創新探索。

我們更期待,將這些智能工具帶給更多媒體夥伴——將繁瑣交給技術,將創造力還給人,共同打造更多值得銘記的好內容。

關注同花順財經(ths518),獲取更多機會