就在啱啱,硅谷 AI 圈上演了一出「火星撞地球」。

OpenAI 和 Anthropic 彷彿商量好似的,同時甩出了自家的重磅更新:Claude Opus 4.6 和 GPT-5.3-Codex。

如果說昨晚之前,我們還在討論怎麼寫好 Prompt 輔助工作;那麼今天過後,我們可能需要學會如何作為老闆去管理 AI 員工。

AI 造 AI,順便接管你的電腦

前一天晚上,Sam Altman 還在因為對手 Anthropic 的超級碗廣告而破防紅溫,今天就直接扔出王炸:

GPT-5.3-Codex。

技術文檔裏藏着一句極具分量的話:「這是我們第一個在創造自己的過程中,發揮了關鍵作用的模型。」

說人話就是:AI 已經學會了自己寫代碼、自己找 Bug,甚至開始自己訓練下一代的 AI 了。

更關鍵的是,這種自我進化能力,能夠直接用跑分數據體現。

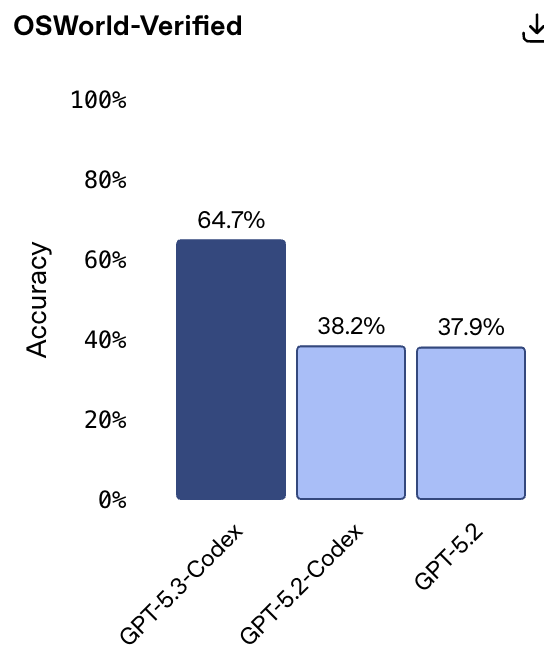

在模擬人類操作電腦的 OSWorld-Verified 基準測試上,前代模型只有 38.2% 的準確率,完全不及格。

但這次,GPT-5.3-Codex 直接跳漲到了 64.7%。

要知道,人類的平均水平也就 72%。

這意味着,AI 距離像你一樣熟練地甩鼠標、切屏、操作軟件,已經很近很近了。

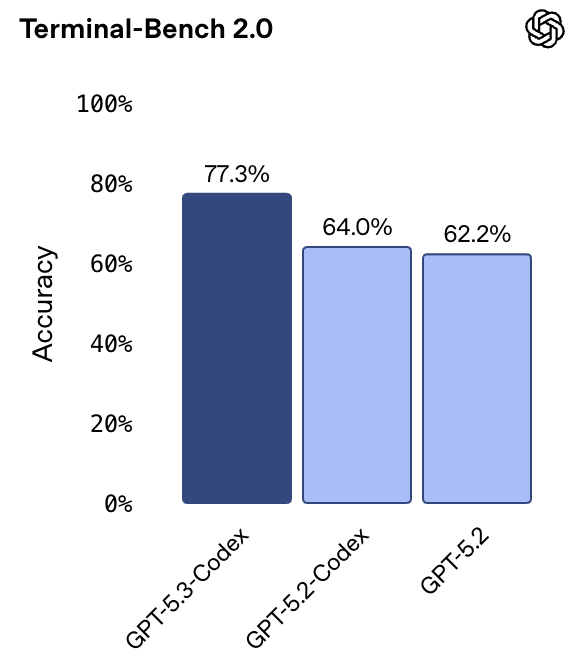

而在 Terminal-Bench 2.0(命令行操作基準測試)中,它更是拿下了 77.3% 的高分,把 GPT-5.2(62.2%)遠遠甩在身後。

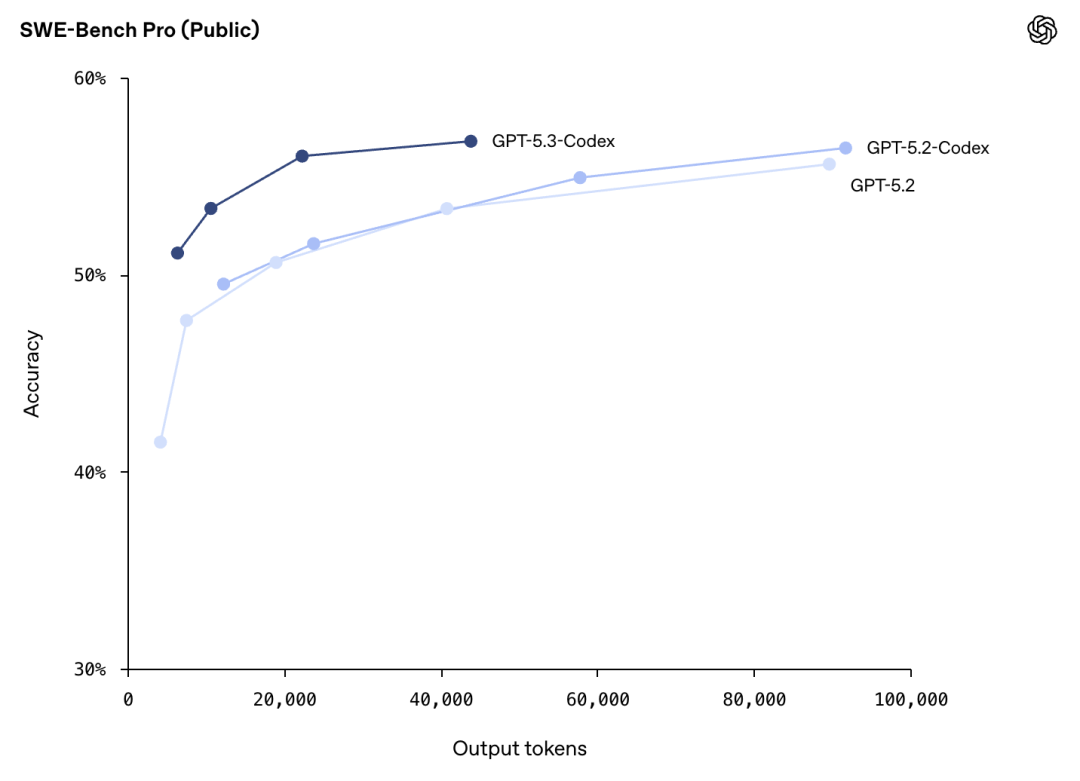

在 SWE-Bench Pro 基準測試(覆蓋四種編程語言,不僅抗污染,還全是真實世界的硬核工程難題)當中,GPT-5.3-Codex 也穩定實現 SOTA 水準, token 用量遠比以往模型更低。

5.3-Codex 獨立構建的能力也毋庸置疑:在 OpenAI 的測試中,用它在幾天時間裏從零構建了一款包含多張地圖的賽車遊戲 v2,順手還搞定了一款管理氧氣系統的深海潛水遊戲。

5.3-Codex 對模糊意圖的理解能力,同樣令人深刻。

在構建網頁時,它自動把年度計劃換算成了打折後的月付價格,甚至還貼心地自動補充了用戶評價輪播。

對了,還有一個有趣的細節。

此前外界盛傳 OpenAI 對英偉達的 AI 芯片頗有微詞,但這次官方博客特地強調:GPT-5.3-Codex 的設計、訓練和部署都在 NVIDIA GB200 NVL72 系統上完成。

這一波高情商操作,屬實是給足了黃仁勳面子。

告別「金魚記憶」,Claude 絕地反擊

在 GPT-5.3-Codex 發布的幾乎同時,Anthropic 也端出了自己的春節大禮包——春節 AI 模型大戰,真沒想到先從硅谷開打了……

壞消息是,這次既不是大家期待已久的 Claude 模型家族「第五代」,也沒有「中杯」Sonnet 模型的更新。這次 Anthropic 直接端出了「超大杯」Claude Opus 4.6。

相比於 OpenAI 在行動力上的激進,Anthropic 今天發布的 Claude Opus 4.6 則是在思考力和可靠性上死磕。

這一波也是直接呼應了昨天超級碗系列廣告的主題:Claude is a place to think(Claude 是思考的空間——思考是不需要廣告的,可以說直接陰陽了 ChatGPT。)

在各種專業場景的大模型使用中,用戶經常遇到上下文腐蝕的痛點,號稱的上下文長度實際根本沒達到就斷點,經常自動切斷上下文——沒錯說你呢 Sonnet 和 GPT……

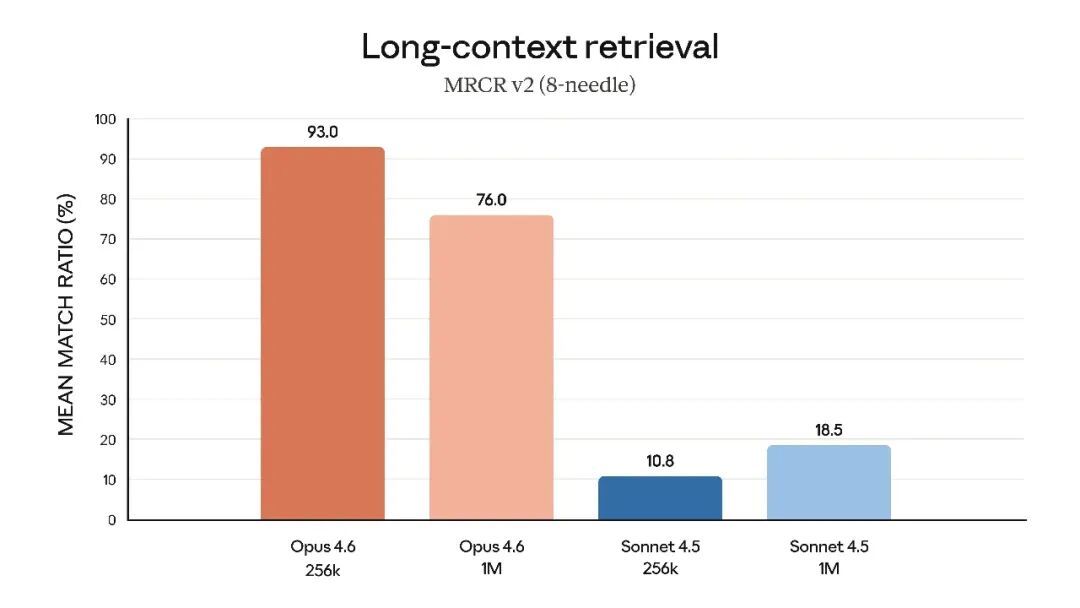

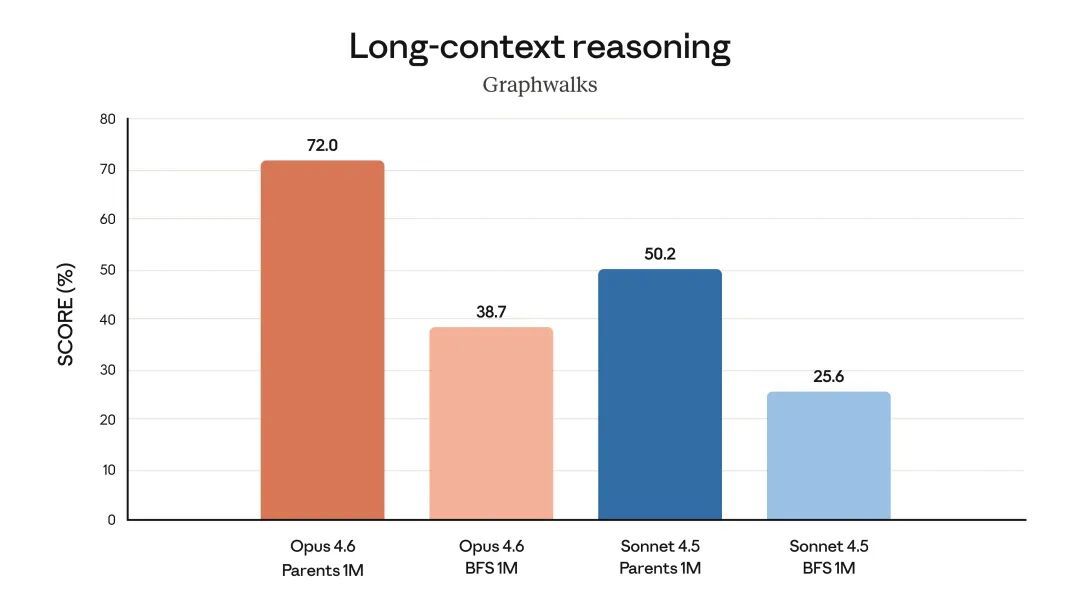

而 Opus 4.6 在上下文腐蝕上面有了顯著的改善:在 MRCR v2(長文本大海撈針)測試中,Claude Opus 4.6 的召回率高達 76%。作為對比,上一代 Sonnet 4.5 只有慘不忍睹的 18.5%。從某種程度上說,這是一個從基本不可用到高可靠的質變。

Anthropic 宣稱,Claude Opus 4.6 首次引入了真正可用的 1M 上下文窗口。

這意味着什麼?意味着你可以把幾百頁的財報、幾十萬字的代碼庫直接扔給它,它不僅能讀完,還能精準地保存和定位上下文細節,告訴你第 342 頁腳註裏的那個數字有問題。

此外,它現在還支持最高 128k 的輸出 Token,可以一次性寫完長篇研報或複雜的代碼庫,而不用因為字數限制被迫截斷、重開會話。

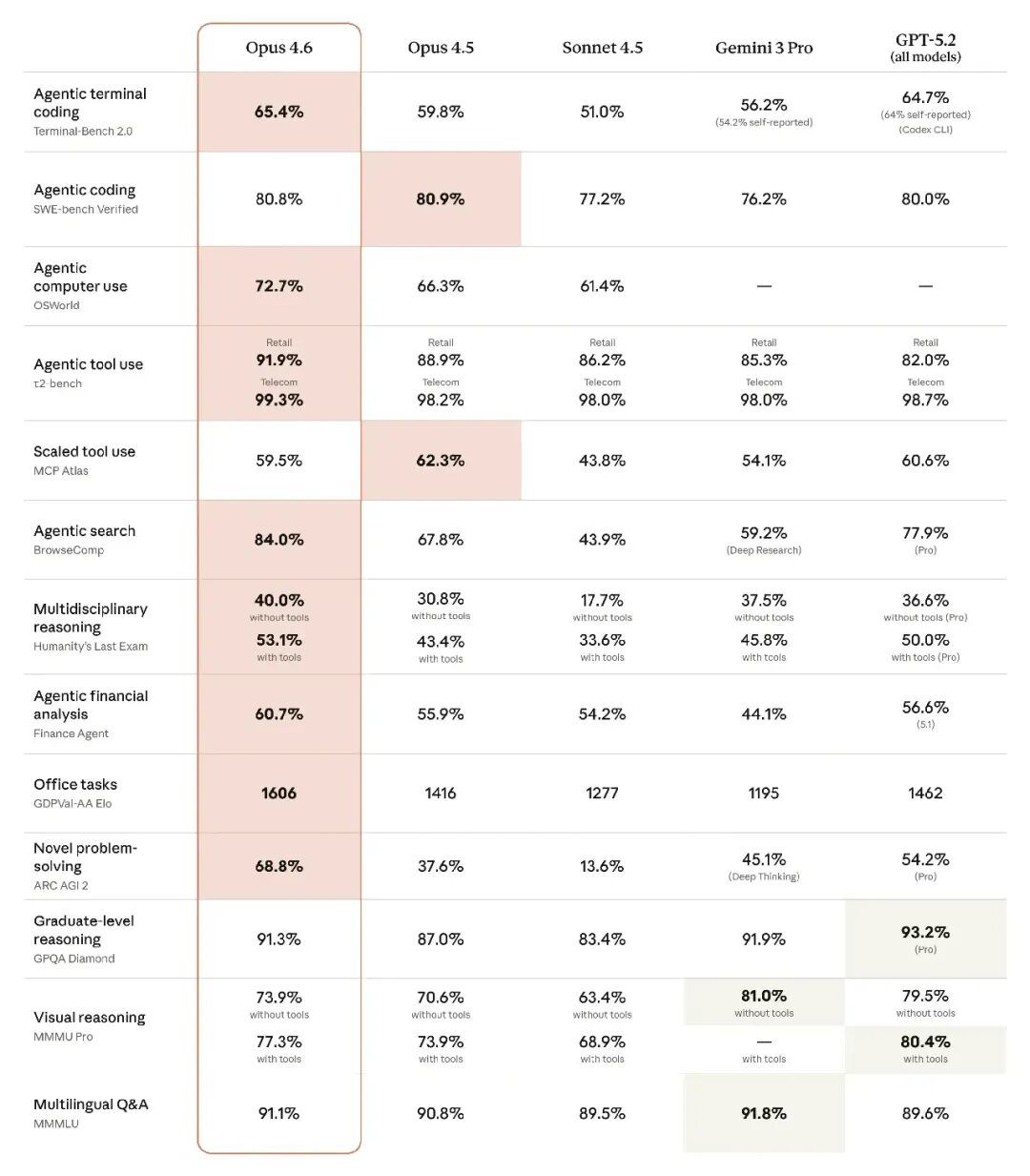

除了記性好,Opus 4.6 這次還在智商上實現了碾壓:

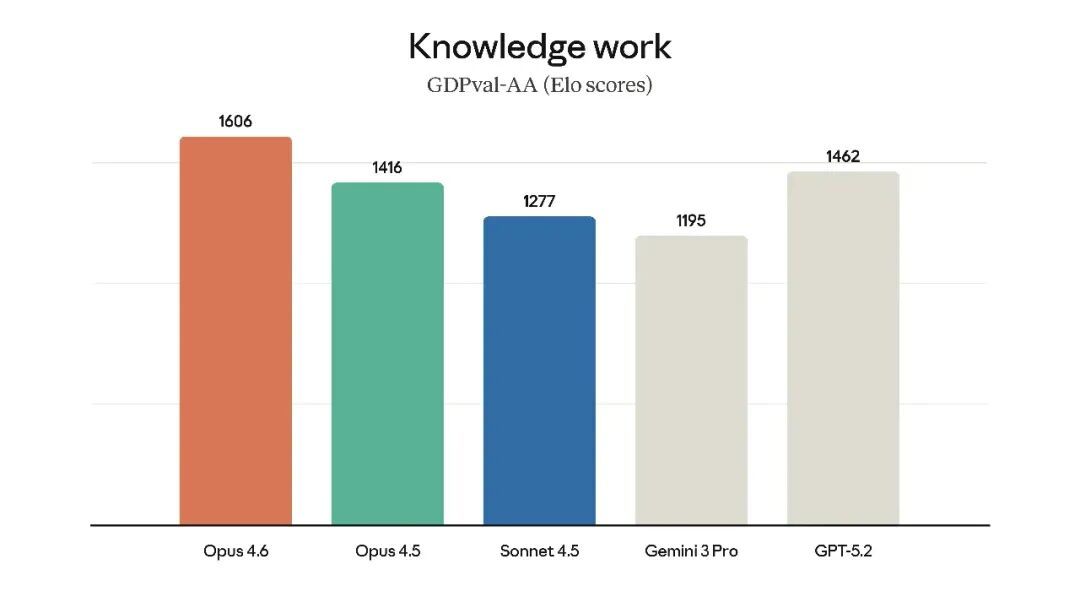

在 GDPval-AA(一項針對金融、法律等高經濟價值任務的評估)中,Opus 4.6 的 Elo 得分比業界第二(OpenAI 的 GPT-5.2)高出了整整 144 分,比前代更是高出 190 分。

在複雜的多學科推理測試 Humanity's Last Exam 中,它領先所有前沿模型。

在測試尋找互聯網「難找信息」能力的 BrowseComp 中,它同樣表現最優。

換言之:如果你要處理複雜的商業決策、法律文書或金融分析,Claude 是唯一的優秀選擇。

更讓打工人眼前一亮的是它的生產力功能。

一方面,Anthropic 這回直接把辦公三件套塞進了 Claude,它能根據 Excel 報表數據直接生成 PPT 彙報文件,不僅保留排版風格,連字體和模板都能對齊。在 Claude Cowork 協作環境中,它甚至能進行自主多任務處理。

Claude Code 還推出了實驗性的 Agent Teams 功能,讓普通開發者也能體驗這種「指揮千軍萬馬」的感覺(這也是 2026 年初的 AI 公司們在 Agent 方向上都在押注的路徑):

角色分工:你可以指定一個 Claude Session 擔任 Team Lead(組長),它不幹髒活累活,專門負責拆解任務、分配工單、合併代碼;其他的 Session 則是隊友(Teammates),各自領任務去幹。

獨立作戰:每個隊友都有獨立的上下文窗口(不用擔心 Token 爆炸),它們甚至能揹着你互相發消息(Inter-agent messaging),討論技術細節,最後只把結果彙報給組長。

並行賽馬:這東西有什麼用?想象一下查一個頑固 Bug,你可以生成 5 個 Agent,分別驗證 5 種不同的假設,像「賽馬」一樣並行排雷;或者在 Code Review 時,讓一個隊友扮「安全專家」查漏洞,一個扮「架構師」看性能,互不干擾。

為了展示 Opus 4.6 的極限,Anthropic 的研究員 Nicholas Carlini 搞了個瘋狂的實驗:充值了 2 萬美元的 API 額度,讓 16 個 Claude Opus 4.6 組成一個「全自動軟件開發團隊」。

結果在短短兩周內,這羣 AI 自主進行了 2000 多個編程會話,從零手寫了一個 10 萬行代碼的 C 語言編譯器(基於 Rust)。

這個 AI 寫的編譯器,還成功編譯了 Linux 6.9 內核(涵蓋 x86、ARM 和 RISC-V 架構),甚至跑通了 Doom 遊戲。

雖然它還不夠完美,但這個案例也足夠說明:vibe coding 氛圍編程僅僅問世一年就過氣了……以後我們真的可以直接下命令,然後看着 AI 從零開始完成一整個複雜產品項目了。

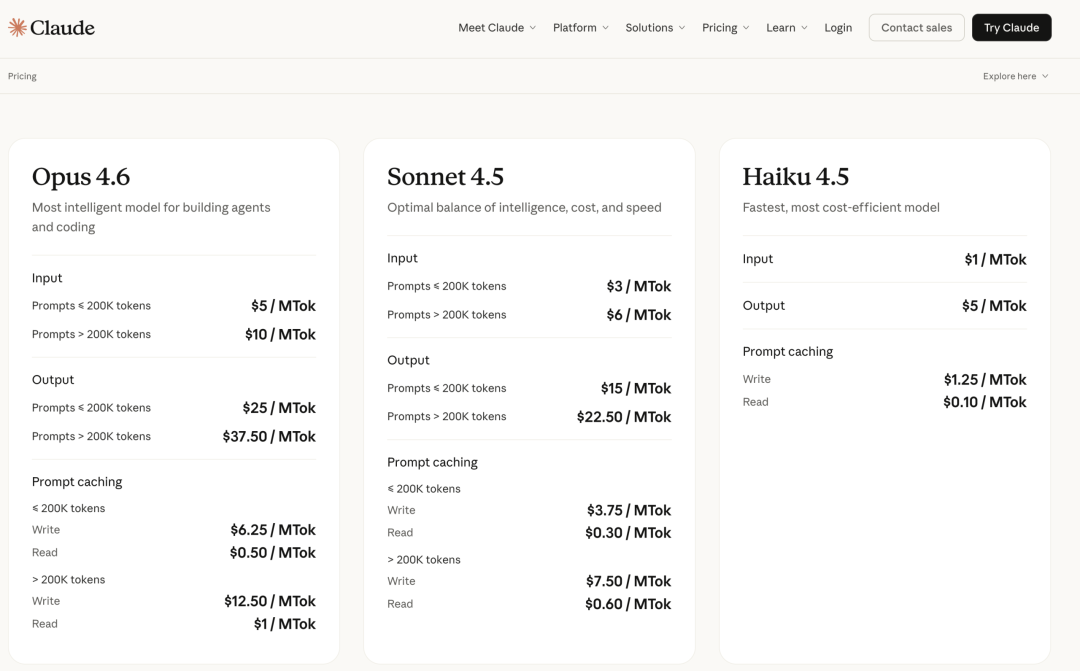

定價方面,Anthropic 這次很良心,維持在每百萬 Token $5/$25 的基礎定價。看來是為了維護住企業級市場這條優勢路,鐵了心要捲到底。

一個是激進天才,一個是靠譜老牛

知名 AI 評測人 Dan Shipper 在第一時間搞了個「盲測」(Vibe Check),他的評價非常精準:

Claude Opus 4.6 是「高上限,高方差」(High Ceiling, High Variance)。

它像是一個才華橫溢但偶爾跳脫的天才。在測試中,它直接解決了一個讓 iOS 團隊卡了兩個月的功能難題;在 LFG Benchmark 中拿到了 9.25/10 的高分。

但它偶爾也會「過度自信」,一本正經地胡說八道。如果你需要突破性的靈感,選它。

GPT-5.3-Codex 則是「高可靠,低方差」(High Reliability, Low Variance)。

它像是一個經驗豐富、絕不掉鏈子的資深工程師。推理速度提升 25%,幾乎不犯低級錯誤,穩健得讓人心安。

雖然在創造性任務上略遜一籌(LFG 得分 7.5/10),但在日常的 Coding 和運維任務中,它是最高效的老黃牛。

當然,比起選擇哪款模型,更重要的是,當 ChatGPT 可以自主修 Bug 甚至操作你的終端,當 Claude 可以一次性吞吐海量文檔並精準定位細節時,Prompt Engineering(提示詞工程)的重要性正在下降,而 Agent Management(智能體管理)的能力開始浮出水面。

我們不再需要像教小學生一樣,把指令拆解得碎碎念。相反,我們需要做的,是學會如何以管理者的身份,去定義目標、審核結果、以及決定在什麼時候,把什麼任務交給哪位 AI 員工。

這就是 2026 年的新職場。你的團隊裏混入了一羣硅基天才,而你是唯一的碳基老闆。