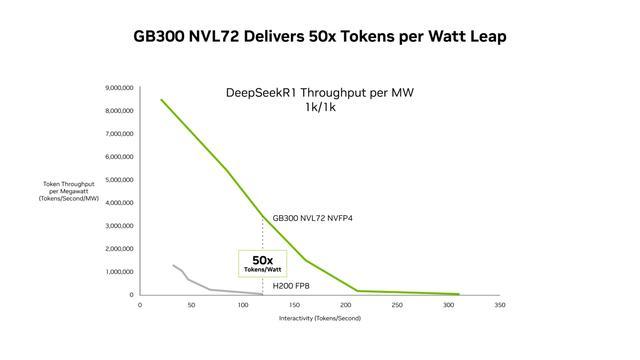

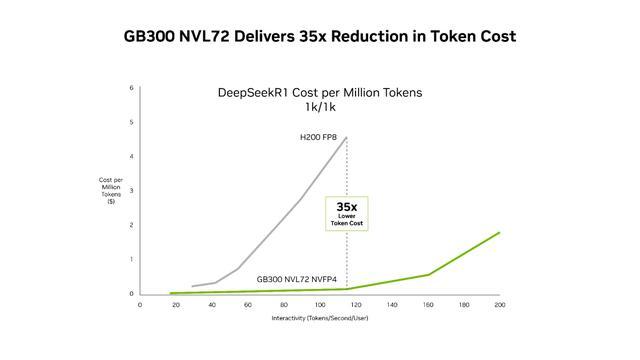

IT之家 2 月 18 日消息,英偉達於 2 月 16 日發布博文,宣佈其 Blackwell Ultra AI 架構(GB300 NVL72)在能效與成本上實現顯著突破,通過 DeepSeek-R1 模型測試,相比前代 Hopper GPU,其每兆瓦吞吐量提升 50 倍,百萬 tokens 成本降低至 35 分之一。

此外,英偉達還預告了下一代 Rubin 平台,預計其每兆瓦吞吐量將比 Blackwell 再提升 10 倍,進一步推動 AI 基礎設施的演進。

IT之家注:每兆瓦吞吐量(Tokens / Watt)是衡量 AI 芯片能效比的核心指標,指每消耗一瓦特電力能處理多少 Token(文本單位)。數值越高,代表能效越好,運營成本越低。

英偉達在博文中指出,性能飛躍的關鍵,是升級技術架構。Blackwell Ultra 通過 NVLink 技術,將 72 個 GPU 連接成統一的計算單元,互聯帶寬高達 130 TB/s,遠超 Hopper 時代的 8 芯片設計。此外,全新的 NVFP4 精度格式配合極致的協同設計結構,進一步鞏固了其在吞吐性能上的統治地位。

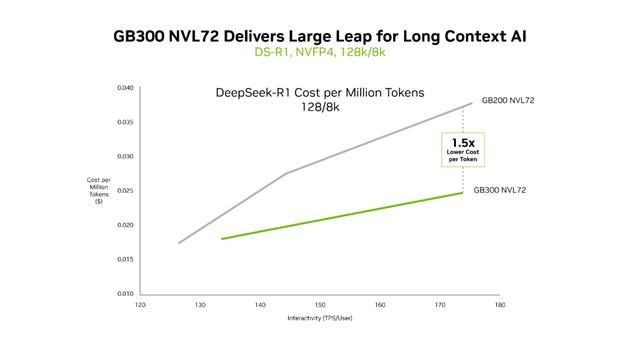

AI 推理成本方面,相比 Hopper 架構,新平台將每百萬 Token 的成本削減至 35 分之一;即便與上一代 Blackwell(GB200)相比,GB300 在長上下文任務中的 Token 成本也降低至 1.5 分之一,注意力機制處理速度翻倍,適配代碼庫維護等高負載場景。

OpenRouter 的《推理狀態報告》指出,與軟件編程相關的 AI 查詢量在過去一年中激增,佔比從 11% 攀升至約 50%。這類應用通常需要 AI 代理在多步工作流中保持實時響應,並具備跨代碼庫推理的長上下文處理能力。

英偉達為應對這一挑戰,通過 TensorRT-LLM、Dynamo 等團隊的持續優化,進一步提升了混合專家模型(MoE)的推理吞吐量。例如,TensorRT-LLM 庫的改進,讓 GB200 在低延遲工作負載上的性能在短短四個月內提升了 5 倍。