林俊暘深夜發文「告別」千問,在AI圈中引起軒然大波,也讓「周浩」這個名字進入公衆視野。

2026年1月,周浩低調加入阿里,第一站不是通義實驗室,而是先掛靠在夸克。

在夸克短暫過渡之後,周浩隨即轉入通義實驗室,接替同日離職的後訓練負責人鬱博文,彙報線直接拉到阿里雲 CTO、通義實驗室負責人周靖人。

周浩本科畢業於中國科學技術大學,2019年在威斯康星大學麥迪遜分校取得機器學習與計算機視覺方向的博士學位,隨後在Meta做了一段AI基礎研究,積累了大規模模型訓練的工程經驗。

真正讓他成名的地方是DeepMind。

自從加入DeepMind以後,周浩在那裏一路升至高級主任研究科學家(Senior Staff Research Scientist),這是谷歌研究體系中極少數人能觸及的級別。

同時周浩也成為了Gemini強化學習與自我改進(RL & Self-Improvement)團隊的負責人。

從Gemini 1.5到現如今的Gemini 3 Pro,周浩參與了谷歌旗艦大模型核心功能的研發工作。

那麼周浩能為千問帶來什麼?

答案藏在他過去幾年在DeepMind裏做的事情裏。

01

周浩有什麼本領?

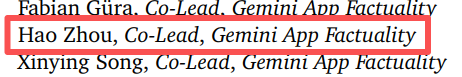

2023年,在Gemini 1.0的技術報告中,周浩擔任「Gemini App Factuality Co-Lead」(Gemini APP事實性聯合負責人)這一職位,他的核心職責是保障Gemini面向C端用戶的輸出事實準確性,輸出的信息準確、可靠,不會「一本正經地胡說八道」。

說白了就是讓模型從後訓練到落地,整個流程裏減少幻覺。

一個模型可以在學術benchmark上跑出漂亮的分數,但如果它在回答「今天天氣怎麼樣」時編造數據,在法律問答時引用不存在的法條,那這個模型就是災難。

傳統的做法是事後檢測。也就是讓模型先生成答案,然後用另一個系統去給已經生成好的答案進行驗證。

但這種方法成本高、延遲大,而且很難覆蓋所有場景。

周浩和團隊在Gemini上做的事實性工作,是從模型訓練和強化學習的源頭入手。

通過設計專門的獎勵函數和訓練策略,讓模型在生成每一個token的時候,就內化了「事實準確性」這個約束。

這不是簡單地讓模型記住更多知識,而是讓模型學會區分「我知道的事實」和「我不確定的推測」,在不確定的時候主動降低置信度,甚至拒絕回答,而不是硬着頭皮瞎編。

這套事實性保障體系的效果,體現在了Gemini的實際表現上。

技術報告中指出,Gemini Ultra在MMLU(大規模多任務語言理解)基準測試中取得了90.04%的準確率,成為首個超越人類專家水平(89.8%)的AI模型。

MMLU涵蓋數學、物理、歷史、法律、醫學、倫理等 57 個學科領域,是衡量模型知識廣度和準確性的權威基準。

更重要的是,技術報告特別強調Gemini模型在事實性相關任務上展現出「exceptionally strong performance on factuality」(在事實性方面表現異常強勁),這直接驗證了周浩團隊在應用層面事實性保障工作的成效。

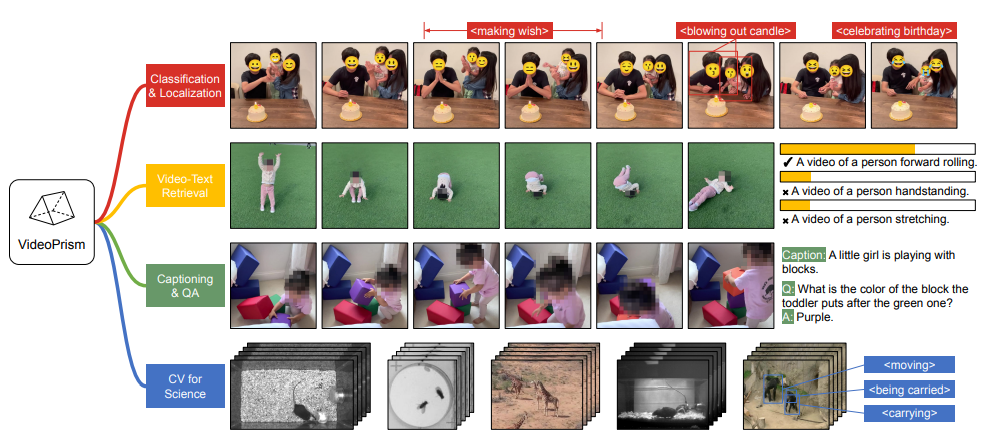

如果說在Gemini 1.0時期,周浩解決的是「怎麼讓AI認識到錯誤」,那麼到了2024年,周浩作為核心貢獻者參與的VideoPrism,它解決的就是「怎麼讓AI看懂視頻」。

這篇論文本質上是構建了一個視頻基礎編碼器,能夠處理從科學視頻到監控錄像等各類視頻內容。

以前的AI「看視頻」,其實是把視頻拆成一幀一幀的圖片分別看,就像把一部電影剪成幾千張截圖然後逐張分析。它能認出畫面裏有什麼,但根本不懂「前後發生了什麼」。

VideoPrism則是讓AI理解視頻裏的時間流動。比如看一段做菜視頻,它不僅知道「這是一個灶底1、有一個人、有一口鍋」,還能理解「這個人先切菜、然後熱油、然後下鍋炒」這個動作序列。

VideoPrism的核心思路是將大規模視頻-文本對數據與純視頻數據結合,通過兩階段訓練,讓模型同時學會語義理解和視覺細節。

第一階段用對比學習讓模型學會匹配視頻和文本描述,第二階段用掩碼自編碼讓模型學會預測視頻中被遮擋的部分。

這個設計讓VideoPrism能夠從兩種互補的信號中學習。文本描述提供語義信息,視頻內容提供視覺動態信息。

在33個視頻理解基準測試中,VideoPrism在31個上達到了最優性能,而且用的是同一個凍結模型,幾乎不需要針對不同任務做適配。

這個工作被直接產品化進入谷歌的多模態體系,是Gemini視頻理解能力的技術基石之一。

周浩同樣也是Gemini 3.0的關鍵貢獻者(Key Contributor)。在這個模型上,他具體負責的是多步驟強化學習(Multi-step RL),翻譯成人話,就是讓模型在解決複雜問題時,能夠進行多輪思考、規劃、執行、反思的鏈式推理能力。

Gemini DeepThink(深度思考模式)和DeepResearch(深度研究)等功能就是因此而來的。

普通的AI回答問題,是「想一步、說一步」。你問它一個複雜問題,它從頭到尾生成一遍答案就完了,中途不會停下來質疑自己。

周浩做的事,是讓AI學會「一口氣想好幾步」。

AI會先拆解問題、制定計劃,然後一步步執行,每走一步都回頭檢查「這步走對了嗎?下一步該怎麼走?」。

這樣一來,Gemini的DeepResearch功能就可以幫你自動搜索幾十個網頁,再綜合搜索結果,給你寫出一份有邏輯的研究報告。而不是像其他大模型一樣,把搜索結果一口氣「噴」出來,因為它真的是在一步步地思考和規劃。

周浩的研究路線啓示有一條清晰的主線。

從最一開始讓AI自己明白什麼是錯的,再讓AI認識到時間序列這個抽象概念,最後通過多步驟強化學習讓AI學會規劃和反思。

隨着時間的推移,AI能理解的事物越來越複雜,也越來越能解決真實的用戶需求。

有意思的是,這個發展軌跡,恰好就是千問接下來要走的路。

02

千問啱啱完成一次技術躍遷

在我看來,周浩的研究方向,與Qwen 3.5 已經走到的技術節點,形成了高度精準的「卡槽對接」。

Qwen 3.5在2026年2月發布,這是千問系列的最新旗艦版本。它採用了混合架構,結合了Gated DeltaNet和稀疏混合專家(MoE)兩種技術。

旗艦模型Qwen3.5-397B-A17B總參數量為3970億,但每次推理只激活170億參數,這樣的設計能夠讓它在保持高性能的同時,成本降低了60%,吞吐量提升了8倍。

雖說Qwen 3.5在架構和預訓練上已經做到了世界級水準,但它的後訓練階段卻不夠出色。尤其是如何讓模型真正學會推理、反思、自我糾錯,這正是千問的短板。

早在2025年5月的Qwen 3技術報告中,Qwen團隊就已經明確表示,其後訓練階段的強化學習「聚焦於數學和編程任務」,並在展望部分坦承「計劃增加強化學習算力,特別強調基於環境反饋的agent強化學習系統」。

這個短板在benchmark上看得更清楚。

在多個最能體現深度推理和複雜任務能力的測試中,Qwen 3.5-397B始終落後於同期發布的Gemini 3.1 Pro。

比如在GPQA Diamond(科學知識推理)上,Gemini 3.1 Pro得分是94.3%,Qwen 3.5只有88.4%。在SWE-bench Verified(代碼任務)上,Gemini 3.1 Pro達到 80.6%,Qwen 3.5則是76.4%。在MMLU系列測試中,Gemini 3.1 Pro的多語言版本得分92.6%,Qwen 3.5的MMLU-Pro是87.8%。

兩者的差距,就集中在需要多步規劃、工具調用與自我糾錯的複雜任務上。

周浩的研究成果剛好能補上了這個缺口。它不需要額外的人工標註數據,不需要給模型灌輸更多知識,就能讓模型意識到錯誤在哪。

而且周浩主導的多步驟強化學習,也彌補了Qwen在多步規劃上的不足。

另外,Qwen 3.5已經具備了agent的基礎能力。

2026年1月,千問App全面接入淘寶、支付寶、高德地圖、飛豬,實現了「一句話點外賣、訂機票、叫出租」。用戶可以說「幫我訂一張明天去北京的機票,預算2000以內,帶行李額」,系統會自動比價、推薦航班、跳轉支付、完成出票。

但這些功能還比較初級,更像是把多個API串起來調用,而不是真正的多步驟推理。

如果航班取消了,AI能不能自己發現問題並切換方案?如果用戶說「幫我安排一個周末去杭州的行程」, AI能不能自己拆解成訂票、訂酒店、規劃路線、推薦餐廳這一系列子任務,然後一步步執行?這些都需要更強的自我糾錯和多步驟規劃能力。

此前在林俊暘的主導下,Qwen 3.5還實現了原生多模態。這是一種從預訓練階段開始,就把文本、圖像、視頻 token混在一起進行訓練的模式。

它能處理最高1344x1344分辨率的圖片,以及60秒的視頻片段。

這套架構和周浩在VideoPrism上做的事情高度一致,他們都是通過早期融合讓模型同時學會語義理解和視覺細節。周浩對這套方法論的深度理解,有望幫助千問在視頻時序推理、動作理解等維度上實現進一步突破。

林俊暘時代,千問團隊的核心競爭力不只是技術,更是組織方式。預訓練、後訓練、多模態、基礎設施全部在一個團隊內部閉環,溝通鏈路極短,一個技術判斷可以當天落地實驗。

但這種「一個人的大腦」式的管理方式,在團隊規模擴大到幾百人之後,開始出現瓶頸。

阿里啓動了官方架構調整,將原本閉環的團隊拆分為預訓練、後訓練、文本、多模態等多個平行的水平分工模塊,直接否定了原本的垂直整合模式。

團隊的考覈邏輯也因此發生轉變,核心KPI從原本的模型性能、排行榜排名、開源影響力,轉向了模型對集團業務的提效成果、千問App的用戶增長、商業化ROI。

周浩要接的,就是這樣一個攤子。

技術上已經走到世界前列,但有明顯短板;組織上從「研究優先」變成了「指標驅動」;戰略上從開源模型轉向C端超級入口,從技術品牌轉向生活助手。

03

千問的未來是?

誠然,千問團隊長期處於「算力飢渴」狀態。吳泳銘也在內部會議上公開道歉,說「沒有更早知道資源的問題」。

但這只是內部矛盾的一面,真正決定這次人事變動的,是它發生的時間節點。

如今的千問正處於戰略大調整,因此,底層模型的性能至關重要。

2025年11月,阿里將「通義」App 更名為「千問」,吳泳銘親自拍板,並在財報分析師電話會上明確表態:「阿里巴巴必須要有一個AI原生的C端超級入口。」

3月2日,就在林俊暘發朋友圈告別的前一天,千問AI眼鏡在 MWC 巴塞羅那全球首秀,並於當天開啓全球預約。

阿里內部人士透露,除AI眼鏡之外,千問還會在年內陸續發布AI指環、AI耳機等產品,全部面向全球市場發售。

「幫你辦事」和「陪你聊天」,是完全不同的兩件事,對模型來說也是如此。

幫用戶訂一張機票,聽起來簡單,實際上需要模型完成一系列連貫動作:理解用戶意圖→調用高德/飛豬 API→處理返回結果→識別異常(比如航班取消)→主動提出備選方案→等待用戶確認→完成支付。

任何一個環節出錯,用戶體驗就會崩塌。

這不是一個聊天機器人能做到的,所以千問App 會從「對話框產品」變成「任務完成產品」。

現在打開千問App,核心交互還是一個聊天框。但有了周浩的多步驟強化學習加持之後,可以預期千問會逐步把「辦事」能力做成獨立的產品模塊。

不是你問它「幫我訂機票」,而是它主動在你說「明天要去北京開會」的時候,自動識別出這是一個需要訂票、叫車、提醒的複合任務,並一步步幫你完成,中途遇到航班取消還能自己切換方案。

這個產品形態,更接近一個「AI祕書」。

阿里的優勢就在於產業鏈完整,可以無縫接入各種阿里系生活、購物產品,這也是Gemini和ChatGPT目前都還沒有做到的。

同時我還認為,千問眼鏡會成為一種具有情境感知能力的AI助手。

目前市面上大多數AI眼鏡的核心能力是「你問我答」,本質上是把手機語音助手搬到了臉上。

千問眼鏡如果能把VideoPrism的視頻時序理解能力真正落地,產品體驗會有質的不同。

它不需要你開口問,就能理解你正在做什麼、下一步可能需要什麼。你走進超市,它知道你在看貨架。你在餐廳猶豫,它知道你在對比菜單。

這種「主動感知、預判需求」的體驗,纔是AI眼鏡相對於手機真正的差異化價值。

林俊暘把千問做成了一個讓全球開發者尊敬的技術品牌,那麼周浩的任務,就是讓千問真正靠得住,不只是聰明,還要穩、準、能把事辦完。