出品|虎嗅ESG組

作者|陳玉立

頭圖|AI生成

本文是#ESG進步觀察#系列第161篇文章

本次觀察關鍵詞:AI

我們可能還是低估了這一波AI Agent可能帶來的顛覆變化。

近半個月以來,OpenClaw成為各大社交媒體平台討論最多的AI軟件,人們對其的態度也經歷了從熱捧到質疑再到理性看待的過程。

恰逢前兩天「3·15」,其中被曝光的GEO與「AI投毒論」再一次強化了人們對AI濫用的警惕。

一連串事件過後,更值得探究的關鍵問題在於——先不論個體對於OpenClaw的使用效率能達到多少(畢竟因人而異),當AI Agent從被動建議變為主動執行後,這一新技術究竟給人類的隱私讓渡與倫理帶來了怎樣的影響,以及當AI使用不當對個體的權益帶來侵害時,究竟該如何定責?

在我們對技術革命的「興奮」逐漸消退後,更現實的治理問題擺在了台面上,如何在創新與安全之間找到平衡,將成為這一輪技術浪潮必須回答的時代命題。

AI Agent作為需求的入口

在分析AI會如何廣泛影響商業及倫理之前,我們有必要先弄清楚一個問題,即當前的AI走到哪一步了,以及AI Agent可能會如何改變當前的商業版圖。一個可行的思路是,將爆火的OpenClaw放入整個AI產業的發展周期中去理解它的位置。

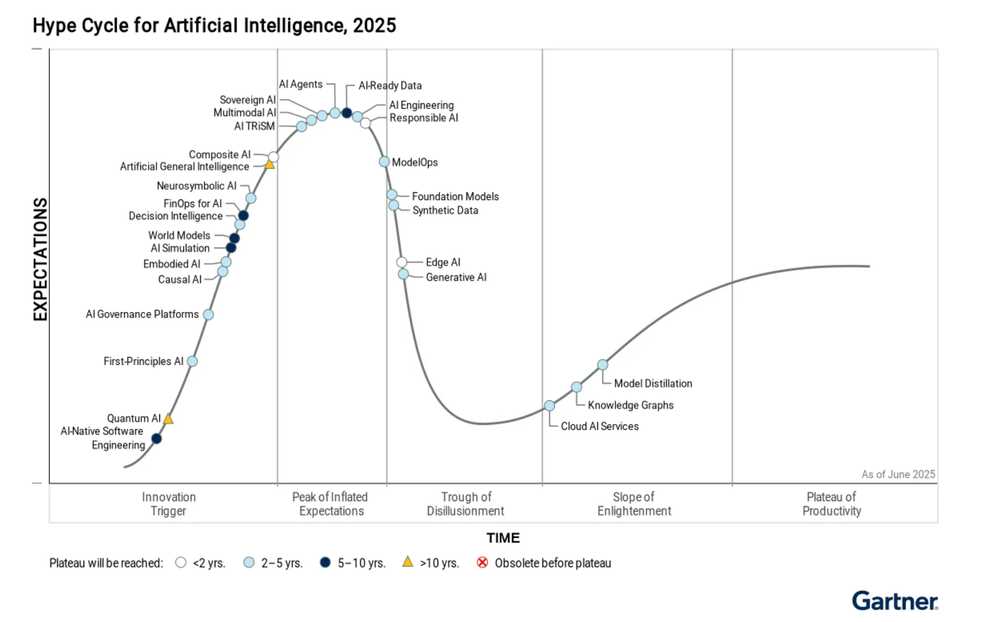

靈碳智能創始人李博傑認為,當前AI的發展處於「預期膨脹的頂峯期」。無論是OpenClaw還是AI Agent,本質上都是圍繞技術講故事。但是從技術到產品,中間還有相當長的一段距離。

「對比互聯網啱啱誕生時期的泡沫期會更貼切,泡沫期中的熱門公司甲骨文到現在都沒有回到當年泡沫時期的估值,」李博傑說道:「互聯網泡沫其實孵化出了很多優秀的技術、商業模式和公司,就像火箭的推進器,每一級都需要強大的推力(泡沫)幫助火箭提升速度,快速推動技術發展。」

而在「預期膨脹的頂峯期」過去後,AI產業會進入「幻滅期」,泡沫會破裂、消耗殆盡,然後會有新的技術泡沫出現,繼續推動技術前進,直到這項技術成熟,被大衆普遍使用,不再被過度討論。

圖源:Gartner

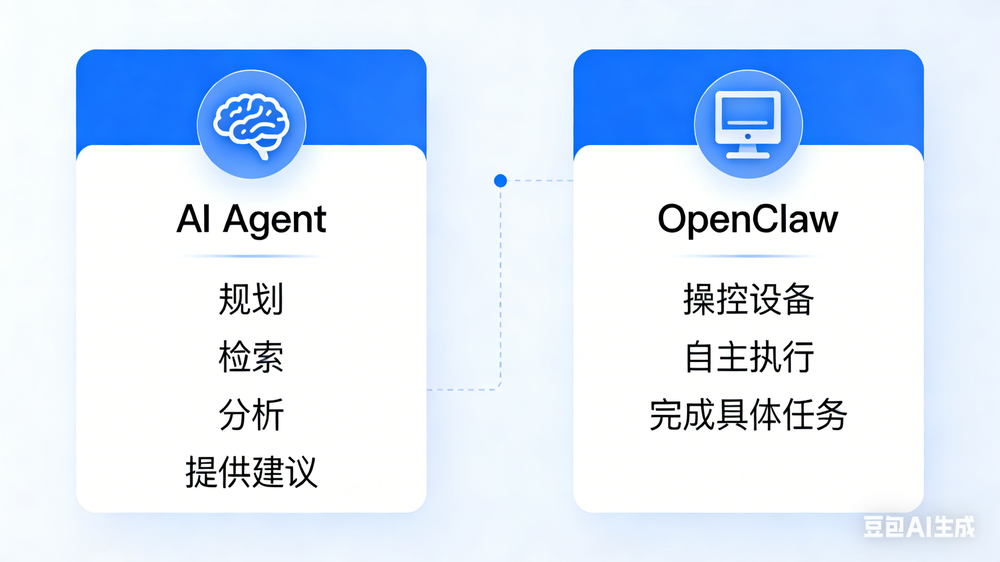

「OpenClaw及AI Agent雖然是泡沫期的產物,但我們也不能把OpenClaw和AI Agent簡單定義為同一代技術,」靈碳科技創始人李博傑分析道:「OpenClaw比AI 更極端,極端在它具備了執行能力。」

簡單來說,AI Agent是做規劃和分析的工具,可以替代人做更復雜的規劃、檢索、分析工作,偏向腦力層面;但OpenClaw卻賦予了AI工具執行能力,能直接幫人完成任務,比如操控電腦、下單買股票、寫文章甚至運營公衆號,它是AI Agent的進一步延伸。

「現在產業已經開始關注為AI準備數據的相關領域,包括所有面向大模型的數據處理能力,比如數據後處理、預處理、標註、合成數據等,現在很多做具身智能的公司都在講合成數據的故事,」李博傑指出:「未來AI會像互聯網的發展一樣進入第四個‘啓蒙期’,那時大衆不會再過度討論它,AI要麼成功落地,要麼就此消亡。」

但無論AI產業怎麼發展,李博傑卻有一個判斷與當下的共識不謀而合,即AI Agent會成為未來一切需求的入口。

就像此前人們使用智能手機一樣,在移動互聯網時代,智能手機的作用是連接各類服務的入口,比如社交、支付、出行、外賣等等。但在AI Agent成熟的時代,用戶不會再逐個打開APP,而是通過向AI Agent表達需求來達到目的。

例如用戶會先表達需求「幫我訂明天去上海的高鐵和酒店」「整理一下這周行業新聞」「給客戶做一份報告初稿」,之後AI Agent再去調用各種應用完成任務。這種模式一旦成立,當前基於移動互聯網的商業模式從「人找服務」,變成「服務被AI Agent調用」。

而這一商業範式便將我們引向了開頭所討論的問題——個體的隱私權是否會被讓渡,AI的濫用又將如何被定責。因為智能手機時代的數據結構被各個平台分開收集,但AI時代數據很可能會被集中到一個AI Agent上。

換句話說,Agent必須了解你,才能代表你行動,於是它很可能成為最了解你的數字系統。

誰來控制你的人生?

李博傑認為,AI Agent時代個體的隱私權不存在是否「讓步」的問題,甚至有可能出現不再由你自己掌控的情況。

「舉個例子,假如未來出現了一個能力很強的AI醫療服務,它為了治療你的疾病需要獲取你所有的生活作息數據、身體實時的各項指標,甚至包括你家人的遺傳信息、你的基因信息,這種情況下的隱私讓渡已經達到了極限,但它能幫你治病,為你研發針對病症的特效藥,你是否會選擇接受?」李博傑說道:「延伸到其他領域也是一樣,AI Agent幾乎能夠幫你作出任何最有利的決定,但代價是把你各類相關的偏好/習慣都告訴它。」

對個體權利的挑戰不僅存在於個人生活領域,在工業生產中同樣凸顯——當 AI 替代工廠所有管理人員且掌握工廠控制權時,工廠的實際運營主體、AI 行為的責任歸屬應該如何界定?

虎嗅ESG組認為,用戶對於隱私讓渡的接受度,本質上取決於兩個核心因素:一是能從隱私讓渡中獲得的實際好處,二是掌控 AI 技術的企業是否具備足夠的可信度。回顧此前李彥宏關於「部分人願意用隱私換取效率」的爭議性言論,客觀說明確實存在部分用戶一旦感知到AI能為生活帶來顛覆性改變,會更快接受這種隱私讓渡的模式。

我們也可以從歷史發展與全球競爭角度來審視這一命題。當下AI 時代的隱私觀與倫理觀重塑正面臨着兩種截然不同的可能性。一種是積極擁抱技術的開放模式,如同工業革命時期若能主動接受鐵路等新技術,便能抓住發展機遇;反之,若像當年慈禧拒絕修鐵路那般死守傳統規則,將AI「封在罐子裏」,最終只會被掌握最新技術的主體降維打擊。

李博傑認為,理想的隱私與數據治理機制,其核心是實現「數據獲取與收益對等」,即每一次個人隱私與數據的讓渡,都必須讓貢獻者獲得高於讓渡成本的實際回報,且數據的獲取必須具備明確的目的性與相關性。

「比如為醫療服務獲取個人醫療數據合理,但藉機採集與醫療無關的短視頻瀏覽、聊天記錄等信息,則屬於明確的數據泄露,」李博傑說道:「這種精細化的治理規則,需要由兼具行業專業知識與職業良知的從業者制定,若由大模型企業、政府或專家學者單一主體一刀切管控,最終只會走向兩個極端——要麼過度保守將AI‘封在罐子裏’,要麼放任技術無序發展,最終因各種問題爆發而被迫叫停。」

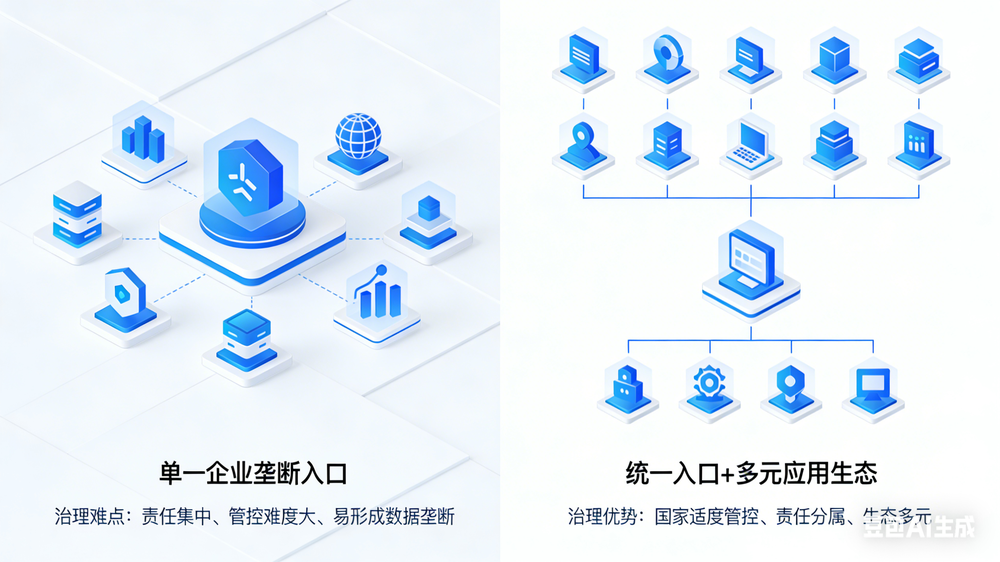

在隱私讓渡之外,責任界定與承擔是更復雜、更現實的核心問題。李博傑構想了兩種可能的AI Agent發展範式,一種是「一家企業足夠強大進而壟斷入口」模式,另一種是 「統一入口+多元應用生態」模式。「從治理角度看,後者的模式更健康,一方面國家可對入口進行適度管控,另一方面在入口之後不同場景下的應用由不同公司運營,也能分別承擔起相應的責任。」

當然,這一切都像是在為未來的想象下定義,畢竟AI產業的發展尚未真正走到那一步。但歸根結底,AI 時代的隱私讓渡與倫理治理,並非簡單的 「要不要保護隱私」「要不要發展技術」 的二元選擇,而是要在技術發展與隱私保護之間找到平衡。

這種平衡的實現,需要摒棄保守封閉的思維,主動擁抱技術創新,同時建立精細化、貼合實際的治理規則與責任體系,既發揮AI提升效率、創造價值的核心作用,也讓個人隱私與數據得到合理的保護與尊重。

AI Agent在重塑企業的「良心」

從更專業的治理語境出發,AI 時代的治理問題與 ESG(環境、社會、治理)三大核心維度高度契合,後者恰好能夠為AI的健康發展提供底層框架與價值指引。

香港大學當代中國與世界研究中心資深研究員施涵認為,AI 治理並不是 ESG 之外憑空增加的「第四支柱」,而更適合作為一個橫跨環境、社會與治理三大維度的複合議題來理解。

對於那些已經在經營管理、客戶服務、風控決策、供應鏈協調等環節深度部署 AI Agent 的企業而言,這一議題甚至可能演變為具有財務實質性的風險與機遇議題,因此有必要被正式納入 ESG 視野。

變化的關鍵,在於 AI 系統的角色正在發生轉變。相較於以識別、分析、預測和內容生成為主的傳統 AI 應用,AI Agent 的突出特徵在於其具備更強的任務分解、工具調用、外部系統交互和自主執行能力。正因為如此,企業治理的重點也不能再僅停留在數據安全、模型準確性和隱私保護層面,而必須進一步前移到行為約束、權限邊界、問責機制、人類監督、事件響應和持續監測等方面。

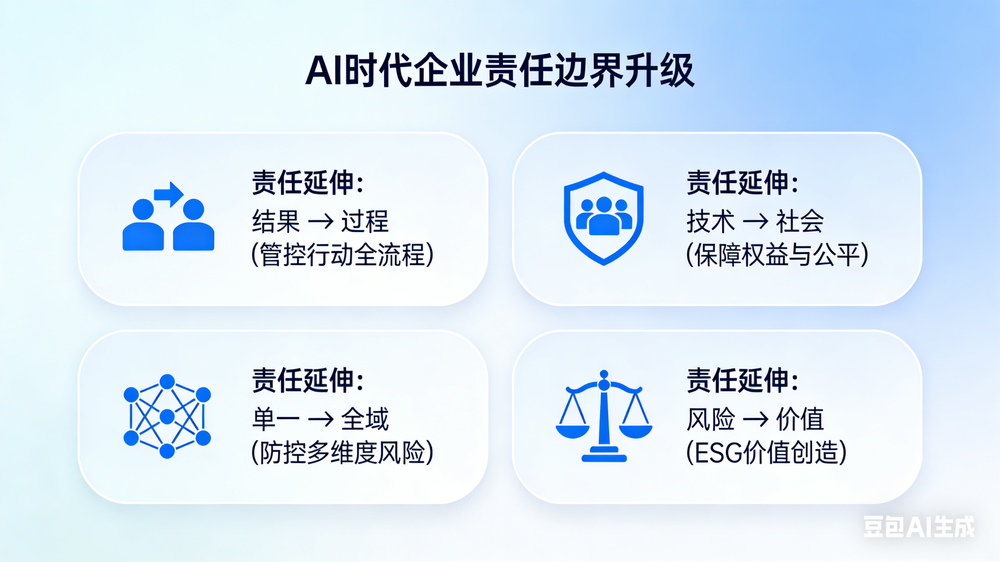

從 ESG 的視角看,施涵認為在AI時代,企業責任邊界的擴展至少體現在以下四個方面:

第一,企業責任正從關注「輸出結果」延伸到關注「行為過程」。過去,企業主要為 AI 系統生成的內容負責;而在 AI Agent 場景下,企業還必須對其如何行動、在何種權限下行動、影響了哪些業務流程、是否觸發了高風險決策,以及在不確定情境下是否能夠被及時叫停和糾偏負責。

第二,AI 治理已不再只是一個技術控制問題,也是一項涉及社會影響與基本權利保障的責任議題。它至少關涉員工是否會因自動化受到不公平影響,個人數據和隱私是否得到尊重,算法是否會放大歧視,消費者是否擁有知情、申訴與補救渠道,以及相關係統是否真正尊重人的尊嚴與自主性。

第三,AI Agents 為企業打開了新的風險傳導渠道。因為它們能夠「採取行動」而不僅僅是「提出建議」,所以可能在更大範圍內放大網絡安全風險、提示詞注入風險、權限失控、虛假信息傳播、偏見擴散、安全事故以及運營失誤。

這意味着,AI Agent 的風險已經不能被視作單純的 IT 問題,而應被納入企業整體風險管理體系,與內控、法務、合規、審計和業務治理協同處理。

第四,AI 既可能成為 ESG 風險源,也可能成為 ESG 價值創造工具。一方面,它可能帶來更高的能耗、硬件資源消耗、勞動力替代壓力、歧視性決策以及治理失靈等問題;另一方面,它也可能被用於氣候建模、電網優化、資源效率提升、安全監測和供應鏈追溯等場景。

真正的關鍵並不在於企業「是否使用 AI」,而在於企業「在什麼治理條件下使用 AI」,以及這種使用是否經過目標設定、影響評估和效果驗證,最終能否形成淨的可持續價值。

施涵進一步指出,將AI治理納入ESG一個更務實的做法,是把它理解為一個分層嵌入、交叉治理的問題。

在治理(G)層面,企業首先需要明確 AI 的治理架構與責任歸屬,包括董事會或相關委員會對重大 AI 風險與機遇的監督職責,管理層對部署、審查、升級、暫停和退出機制的管理職責,以及業務部門、技術團隊、風控合規部門之間的分工邊界。

在社會(S)層面,重點應放在 AI 對人的實際影響上。這不僅包括偏見與歧視測試、員工影響評估、負責任自動化、數據權益保護、消費者保護和無障礙設計,也包括對受影響主體進行充分溝通,以及建立申訴、糾錯和補救機制。需要注意的是,許多 AI 議題並不能被簡單劃入某一個維度之中。

例如,算法歧視既是社會問題,也依賴治理結構中的審查、問責與糾偏機制,因此企業不能用「分欄管理」的方式替代真正的交叉治理。

在環境(E)層面,企業則應同時衡量 AI 的環境足跡與環境效益。對於開發或大規模使用 AI 的企業來說,這意味着不僅要關注模型訓練和推理過程中的能耗、算力依賴、硬件生命周期和潛在水資源消耗,也要評估 AI 是否確實幫助企業在其他業務環節減少排放、優化資源使用、提高環境績效。

AI 不能因為帶有「數字化」標籤就自動被視為綠色,其環境負荷與減排貢獻都應被納入綜合評價。

「AI Agents 正在推動 ESG 治理變得更加關注行為本身、系統邏輯及其長期影響。企業責任的邊界,正在從‘管理企業直接做了什麼’,擴展到‘管理那些在授權範圍內代表企業行動的半自主數字系統做了什麼’,」施涵分析道。

總而言之,面對 AI Agent 所帶來的技術變革,既不能放任其成為衝擊規則與責任邊界的失控力量,也不能因過度擔憂風險而將其拒之門外。無論是盲目樂觀,還是過度保守,都可能使企業錯失技術進步所帶來的重要機遇。如何在創新激勵、風險防控與責任治理之間取得平衡,很可能將成為 AI 時代最重要的議題之一。

本內容未經允許不得轉載。授權事宜請聯繫 hezuo@huxiu.com。

End

想漲知識 關注虎嗅視頻號!