智通財經APP獲悉,根據TrendForce集邦諮詢最新AI Server研究,在大型雲端服務供應商(CSP)加大自研芯片力道的情況下,英偉達(NVDA.US)在GTC 2026大會改為着重各領域的AI推理應用落地,有別於以往專注雲端AI訓練市場。通過推動GPU、CPU以及LPU等多元產品軸線分攻AI訓練、AI推理需求,並藉由Rack整合方案帶動供應鏈成長。

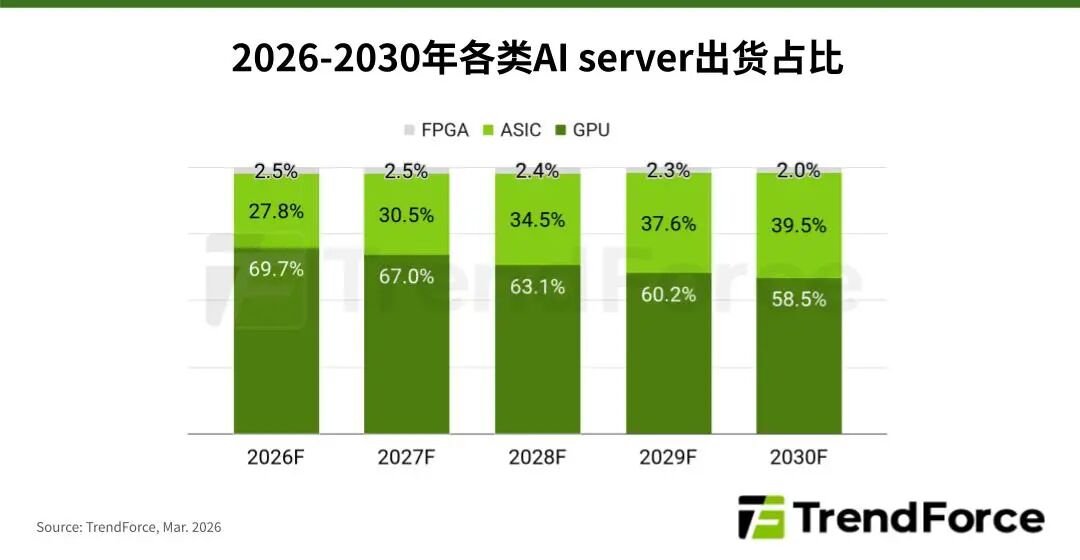

TrendForce集邦諮詢表示,隨着以谷歌(GOOGL.US)、亞馬遜(AMZN.US)等CSP為首的自研芯片態勢擴大,預估ASIC AI Server佔整體AI Server的出貨比例將從2026年的27.8%,上升至2030年的近40%。

為鞏固在AI市場的領導地位,英偉達採取的其中一項策略為積極推動GB300、VR200等整合CPU、GPU的整櫃式方案,強調可擴展至AI推理應用。本次在GTC發表的Vera Rubin被定義為高度垂直整合的完整系統,涵蓋七款芯片和五款機櫃。

觀察Rubin供應鏈進度,預計2026年第二季存儲器原廠可提供HBM4給Rubin GPU搭載使用,助力英偉達於第三季前後陸續出貨Rubin芯片。至於英偉達 GB300、VR200 Rack系統出貨進程,前者已於2025年第四季取代GB200成為主力,預估至2026年出貨佔比將達近80%,而VR200 Rack則約在2026年第三季度末可望逐步釋放出貨量能,後續發展仍需視ODM實際進度而定。

另外,AI從生成跨入代理模型時代,在生成Token的譯碼(Decode)階段面臨嚴重的延遲與存儲器帶寬瓶頸。為此,英偉達整合Groq團隊技術,推出專為低延遲推理設計的Groq 3 LPU,單顆內建500MB SRAM、整機櫃可達128GB。

然而,LPU本身的存儲器容量無法容納Vera Rubin等級的龐大參數與KV Cache。英偉達因此於本次GTC提出「解耦合推理(Disaggregated Inference)」架構,通過名為Dynamo的AI工廠作業系統,將推理流水線一分為二:處理代理型AI時,需進行大量數學運算並儲存龐大KV Cache的Pre-fill、Attention運算階段,交由具備極高吞吐量與巨量存儲器的Vera Rubin執行。而受限於帶寬且對延遲極度敏感的譯碼與Token生成階段,則直接卸載至擴充了巨量存儲器的LPU機櫃上。

在供應鏈進度上,第三代Groq LP30由Samsung(三星)代工,已進入全面量產階段,預計於2026年下半年正式出貨,未來更規劃在下一代Feynman架構中推出效能更高的LP40芯片。