新智元報道

編輯:Aeneas 好睏

【新智元導讀】啱啱,谷歌內部AI曝光了!Agent Smith一經推出,就火到一塌糊塗,全體員工集體瘋搶,服務器直接被擠爆。現在,三巨頭的祕密新模型都集體炸出了,讓全球AI大戰再猛烈一些吧!

黑客帝國,在谷歌成真了?

就在今天,谷歌內部前沿模型也曝光了。

啱啱,外媒Business Insider獨家爆料稱,這款AI工具名為Agent Smith,在公司內部已經人氣爆棚!

它能自動寫代碼、自動調用內部系統、自動完成各種日常任務。

最離譜的是,你甚至不需要打開電腦——掏出手機,就能遠程指揮它幹活!

沒錯,就是《黑客帝國》裏那個穿黑色風衣、能無限複製自己的經典反派。

谷歌給自家AI工具起了這個名字,多少帶點「既然擋不住,不如加入它」的黑色幽默。

Agent Smith到底有多火?一句話,它直接火到谷歌不得不限流。

據知情人士透露,Agent Smith在谷歌內部一上線,員工就蜂擁而至,直接把服務器擠爆了!

因此,谷歌不得不緊急收緊訪問權限。

這種「自己家的工具把自己家服務器擠爆」的場面,放在別的公司可能是事故,放在谷歌,則是2026年AI競賽的真實縮影。

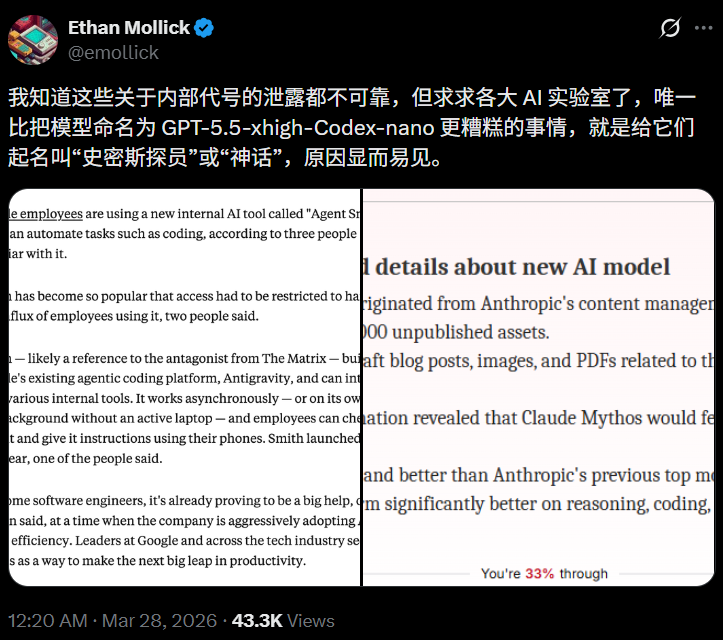

有趣的是,沃頓商學院教授忍不住對最近泄露的這些模型名字吐槽起來——

我求求你們這些實驗室了,唯一比把模型命名為GPT-5.5-xhigh-Codex-nano更糟糕的,就是給它們取名Agent Smith或Mythos!

因為Mythos這個名字,聽起來也太克蘇魯了。

而Agent Smith這個名字,大概率是某個谷歌員工看了黑客帝國……

相比而言,OpenAI的譜系分類法命名,就太可怕了。

Agent Smith,到底有多猛?

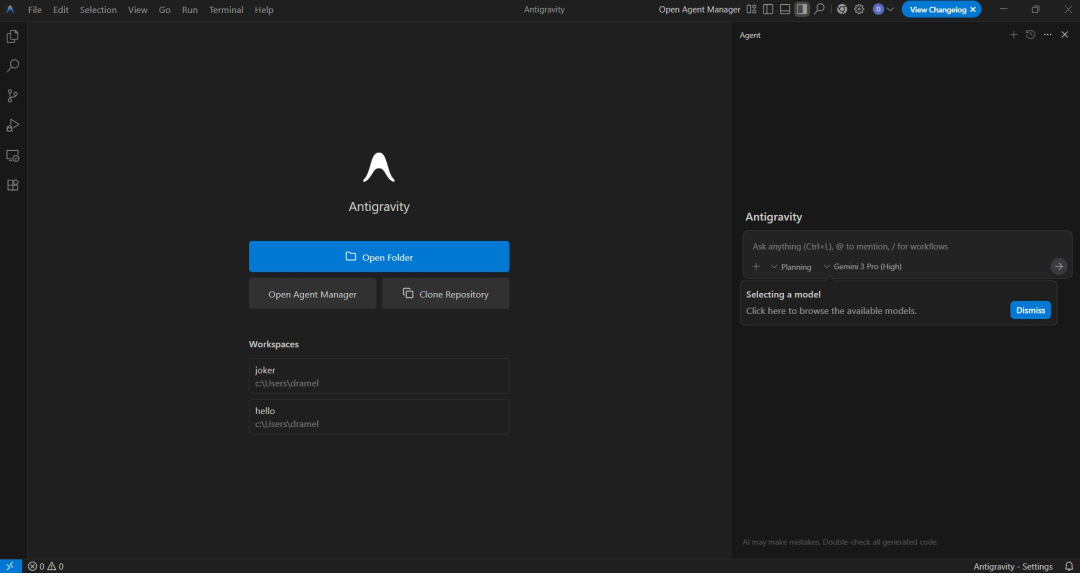

根據外媒爆料,Agent Smith構建在谷歌去年11月推出的Antigravity平台之上。

Antigravity本身已經是一款「Agent優先」的開發平台,支持AI自主規劃、執行、驗證完整的編碼任務。

而Agent Smith,在此基礎上更進了一步。

它不只是一個代碼助手,而是一個能獨立運轉的數字員工。

據了解,Agent Smith有幾個關鍵能力,讓它在谷歌內部迅速走紅:

第一,異步運行。你把任務丟給它,合上電腦走人,它會在後台默默幹完。不需要你盯着螢幕等結果。

第二,手機操控。通過谷歌內部聊天平台,員工可以直接用手機給Agent Smith下指令、查進度。上班路上、午飯時間,隨時隨地指揮AI幹活。

第三,深度接入內部系統。它能調取員工檔案、拉取內部文檔,省去了過去大量手動查找的時間。

第四,自主性極強。相比谷歌此前的AI編碼助手,Agent Smith能自己規劃任務流程、自己執行、自己檢驗結果,工程師只需要在關鍵節點做審核。

據谷歌員工透露,對於部分軟件工程師來說,Agent Smith已經成了真正的生產力放大器。

目前,已有超過100名開發者參與Agent Smith的擴展工作。

它不僅能生成代碼,還能模擬用戶場景、自動測試軟件bug,並將發現的漏洞直接反饋給對應團隊。

谷歌的戰略級押注

Agent Smith的爆火,並非偶然。

它的背後,是谷歌從上到下、全公司級別的AI Agent戰略。

谷歌聯合創始人謝爾蓋布林,2023年從半退休狀態迴歸後,如今幾乎每天都在一線瘋狂寫代碼。

DeepMind負責人Hassabis親口證實:布林一直在深度參與技術開發,「親自編程」。

今年3月初,布林出席了一場內部全員會,明確表態:AI Agent將是谷歌今年最重要的方向。

布林在會上暗示,谷歌正在開發類似OpenClaw的工具。好笑的是,台下的員工都在竊竊私語:這說的不就是Smith嗎?

更有趣的一幕發生在會議現場:谷歌業務主管Philipp Schindler開玩笑說,他現在一眼就能分辨出,此時此刻坐在對面回覆消息的,到底是布林本人,還是布林的Agent。

這預示着:未來的谷歌,可能是一個由數萬個AI Agent協同工作的超大規模蜂巢模型!

而在執行層面,谷歌的態度更加激進。

CEO劈柴早在去年就告訴員工:必須擁抱AI,因為競爭對手也在這麼做。

而到了2026年,這個建議已經變成了硬性要求:AI工具的使用情況,已經被年度納入績效考覈!

甚至,谷歌內部甚至發起了一個Project EAT項目,自下而上地推動AI的標準化應用。

不用AI的,不許升職加薪——這,就是2026年硅谷的真實氛圍。

一周之內,連炸三次

如果說Agent Smith只是谷歌的內部故事,那接下來的事,就是整個AI行業的集體地震。

就在Agent Smith曝光的同一周。

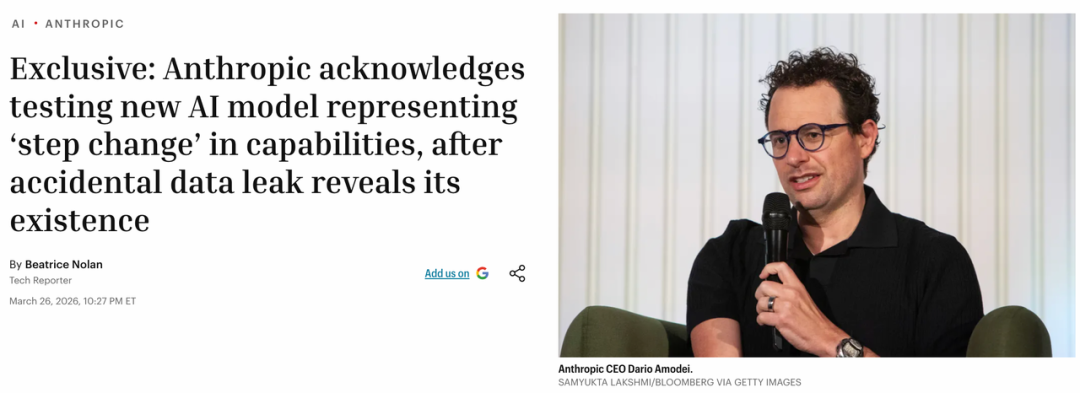

Anthropic,因為一次「配置失誤」,意外泄露了旗下最強模型「Claude Mythos」的全部細節。

OpenAI,砍掉了王牌產品Sora,全力押注一個代號「Spud」的神祕模型。

三個代號,三顆炸彈,一周之內全部引爆。

Anthropic

最強模型泄露,自己都不敢發

先說Anthropic這邊,情況極其戲劇化。

有安全研究人員發現,Anthropic官博背後的內容管理系統居然因為一個配置失誤,把近3000份內部文件敞開了大門——任何人都能直接訪問。

《財富》雜誌從中檢索到了一篇博客草稿,內容足以讓整個AI圈炸鍋——

Anthropic完成了一款名為「Claude Mythos」的全新模型。

目前Claude有三個層級:最強的Opus、居中的Sonnet、最輕的Haiku。

而Mythos所屬的「Capybara」(水豚),是Opus之上全新的第四級——更大、更強、也更貴。

性能方面,與此前最強的Claude Opus 4.6相比,Capybara在軟件編碼、學術推理和網絡安全等測試中,得分大幅提升。

Anthropic隨後也不裝了,直接承認:這個模型是真的,而且是我們造過的最強的東西,能力是「階躍式」的跨越。

但Mythos至今未發布,原因只有一個:它太危險了!

泄露的文件中,Anthropic明確警告,Mythos在網絡攻擊能力上遙遙領先於全球任何模型。它能以遠超防禦人員應對能力的速度發現並利用軟件漏洞。

Stifel分析師Adam Borg看完泄露內容後直言:Mythos顯然比市面上任何前沿模型都要強大一個數量級,且算力消耗極高。

我們認為這有可能成為終極黑客工具。

巧的是,就在Mythos泄露的同一天,Anthropic也被曝出可能會在2026年10月之前啓動IPO。

Mythos的存在,無疑是給IPO估值表上加了一個巨大的砝碼。

OpenAI:

砍掉Sora,All in「Spud」

再看OpenAI這邊。

據The Information爆料:OpenAI已經完成了一款全新模型的預訓練,內部代號「Spud」(土豆)。

Sam Altman在內部告訴員工,這個模型能夠「真正加速經濟」。

Spud的具體參數還沒公開,也沒有公布具體性能。

但有員工透露,Spud具備一種「前所未見的全新能力」。

有消息稱它可能是原生多模態架構,從底層統一處理文本、音頻、圖像,而非像現有模型那樣拼接不同組件。

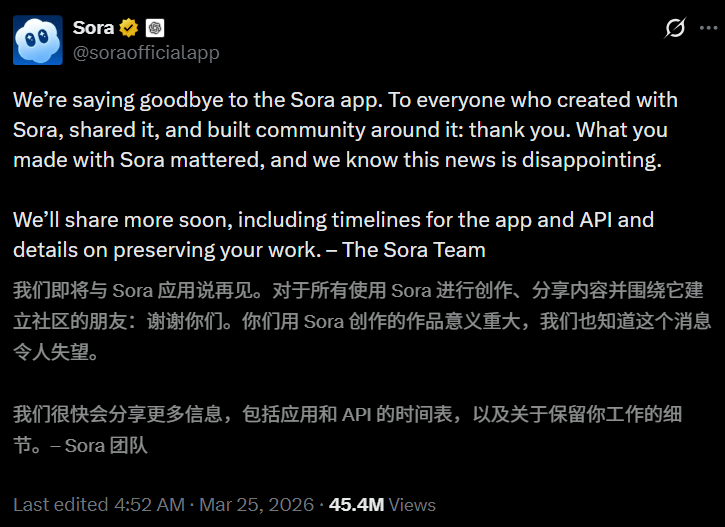

而為了給Spud騰出算力,OpenAI做了一個讓整個行業都震驚的決定——砍掉Sora。

那個去年9月高調上線、與迪士尼簽下10億美元合作、一度被視為AI視頻賽道標杆的Sora,說砍就砍了。

荒誕的是,就在宣佈砍掉Sora的當天周一,迪士尼團隊還在和OpenAI開會討論Sora項目。

誰成想,散會僅30分鐘後,迪士尼方面就收到了通知:Sora沒了。

10億美元合作,200多個迪士尼角色授權,米老鼠、灰姑娘、星球大戰……全部泡湯。

原因很直接:太燒錢。

據報道,Sora每天虧損約1500萬美元,下載量從2025年12月起連續暴跌。

OpenAI的應用CEO Fidji Simo告訴員工,公司「在太多App上分散精力」,不能再搞「支線任務」了。

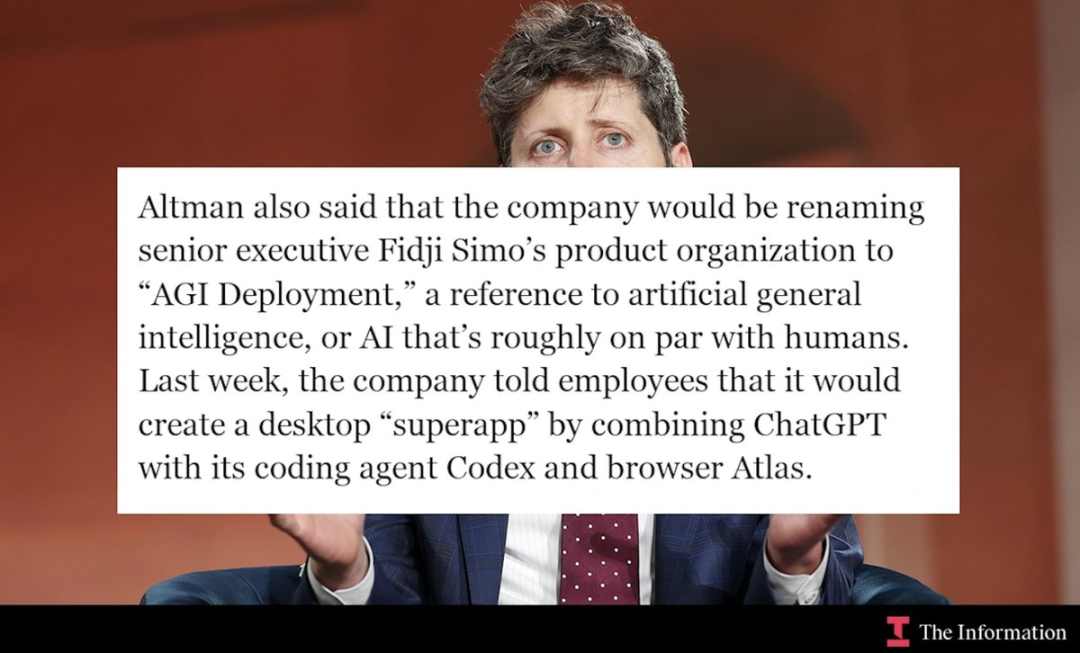

砍掉Sora省下的GPU,全部投入Spud和正在開發中的「超級App」——一個整合了ChatGPT、Codex和瀏覽器的統一平台。

與此同時,OpenAI的產品團隊悄悄更名為「AGI Deployment」(AGI部署)。

這可不是改個名那麼簡單,這是在向全世界宣告——我們認為自己已經進入了AGI落地階段。

AI巨頭集體All in同一張牌桌

Agent Smith、Spud、Mythos——三個風格迥異的代號,指向的卻是同一個方向:

從「聊天機器人」到「自主Agent」的範式轉移。

谷歌的Agent Smith,讓AI不再是等你輸入prompt才動的被動工具,而是一個能在後台獨立運轉、主動完成任務的數字員工。

OpenAI All in Spud和超級App,賭的是一個統一入口下的全能Agent——聊天、編程、上網、執行,全在一個窗口裏完成。

Anthropic的Mythos,則把模型能力推到了一個連自己都害怕的高度,以至於不得不先讓「防守方」跑起來,再考慮開放。

如今,這場遊戲的賭注,已經遠遠超出了「誰的模型跑分更高」的範疇。

AI公司們正在押上一切。贏了之後怎麼辦?它們也沒想好。

但不管怎樣,先All In再說!