近日,「人工智能賦能新型工業化深度行」活動舉行,正式拉開2026年工業和信息化部「人工智能+」行動序幕。本次活動由國家先進計算產業創新中心主辦,聚焦打通從算力底層到工業場景的「最後一公里」,推動人工智能與製造業深度融合。商湯大裝置事業群解決方案總經理代繼在會上發表《AI基礎設施及產業服務實踐》主題演講,系統闡述了Token經濟驅動下AI基礎設施的演進邏輯與產業落地路徑。

代繼指出,大模型產業正從「開源與閉源之爭」轉向「技術生態之爭」,國際頭部廠商通過「開源構建生態、閉源沉澱價值」的路徑重塑競爭格局。隨着新一代智能體交互模式的火爆,模型已突破普遍應用的技術門檻,而頭部模型用戶付費意願的上升標誌着Token消費共識正在形成。

與此同時,AI基礎設施正迎來歷史性建設窗口。代繼援引行業研究報告指出,2025年AI工作負載以模型訓練為主導,但到2027年,模型推理將成為主要算力需求。這意味着AI的價值創造正從一次性的模型開發轉向持續性的規模化應用。預計到2030年,全球數據中心總容量將突破200GW,五年內規模翻番,複合年增長率達14%。

Token的規模化生產與消費,AI基礎設施需要在算力供給、調度效率與系統穩定性等方向實現全面升級。圍繞這一趨勢,商湯大裝置構建了系統化技術支撐體系——

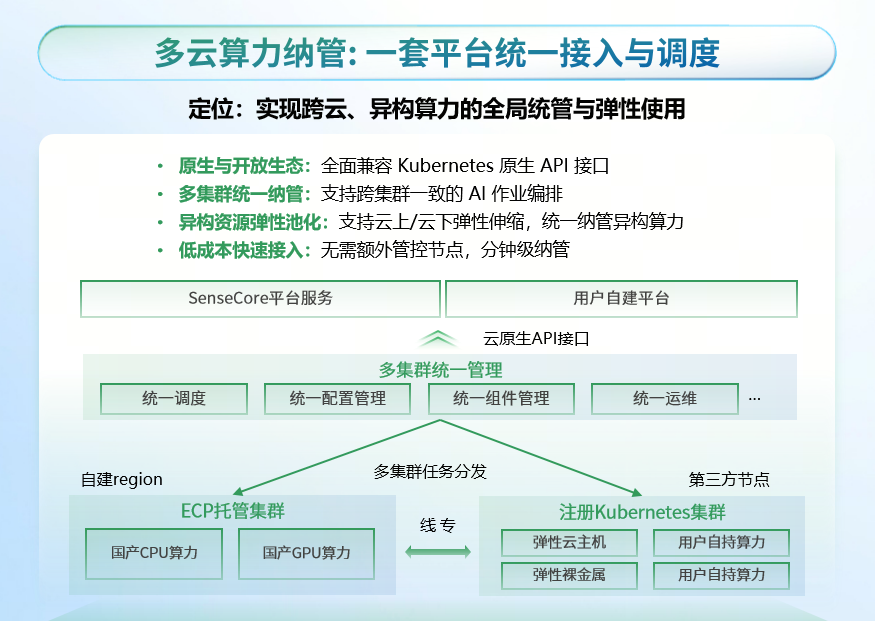

代繼介紹,面對推理需求爆發與算力結構複雜化的趨勢,商湯大裝置打造了具備「異構統一納管與彈性調度能力」的AI基礎設施體系。

「基於SenseCore AI雲平台,商湯大裝置實現了多雲環境下的統一管理與異構算力調度,平台兼容Kubernetes原生生態,將自建集群、第三方雲資源以及多種國產CPU/GPU算力整合為統一資源池。」代繼表示,「這種‘算力池化’能力,使企業能夠在不同區域、不同架構之間靈活調用資源,支撐大規模分佈式推理任務。」

更關鍵的是,在異構環境下,商湯針對不同芯片架構進行了深度優化,使訓練與推理任務均可獲得最優的性價比表現——這意味着,在Token持續消耗的場景下,企業可以以更低成本獲得穩定、可預期的算力供給,從而提升整體投入產出比。

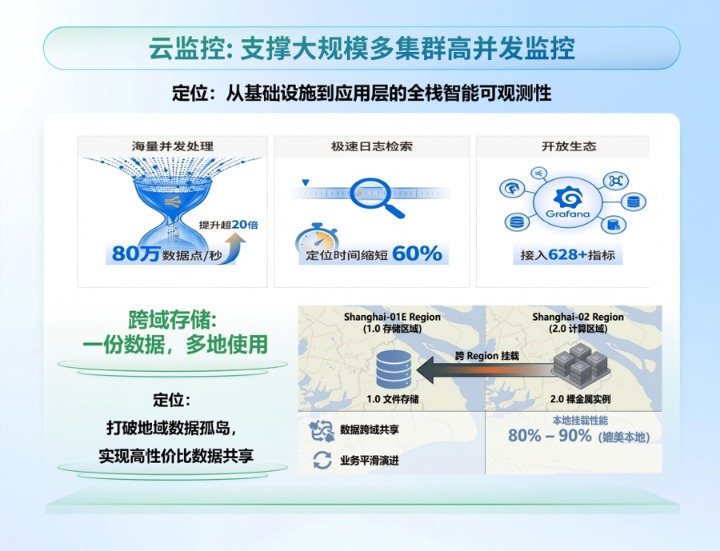

如果說算力調度解決的是「資源如何用」,那麼可觀測性解決的則是「系統是否可控」。在大規模海量高併發場景下,系統需要同時處理海量請求與複雜任務鏈路,傳統監控體系難以支撐。對此,商湯構建了覆蓋基礎設施到應用層的全棧智能可觀測體系:單秒可處理80萬數據點,性能提升超過20倍;日誌檢索效率提升60%,顯著縮短問題定位時間等。同時,通過跨地域數據掛載技術,實現「一份數據,多地使用」,在保證接近本地性能的前提下,打破數據孤島。這不僅降低了數據流轉成本,也為跨區域業務部署提供了基礎支撐。

「在Token經濟驅動下,AI調用頻率越高,對系統穩定性與可觀測性的要求越高,‘可感知、可分析、可優化’的智能監控才能真正支撐規模化應用。」代繼說。

值得一提的是,在算力成本與供應鏈雙重挑戰下,國產算力成為重要支撐路徑,不僅能夠降低基礎設施成本,也有效提升了算力資源選擇的靈活性。

目前,商湯大裝置已完成20餘款國產AI芯片適配,並率先實現萬卡規模國產芯片的異構混訓,算力利用率達到80%,訓練效率接近同構集群的95%,有效突破單一芯片限制,實現了國產算力規模化商用,也為企業提供了更多靈活選擇。與此同時,商湯聯合產業夥伴推出「算力Mall」,將算力資源、平台工具與模型服務進行標準化封裝,企業可以像選購商品一樣進行組合與調用。這種服務模式,本質上也在重構AI供給方式,使Token成本更加可控。

「AI正加速從技術能力轉化為現實生產力。」代繼表示,未來競爭將不再侷限於模型本身,而是圍繞「基礎設施+生態+應用」的系統能力展開。

(文章來源:上觀新聞)