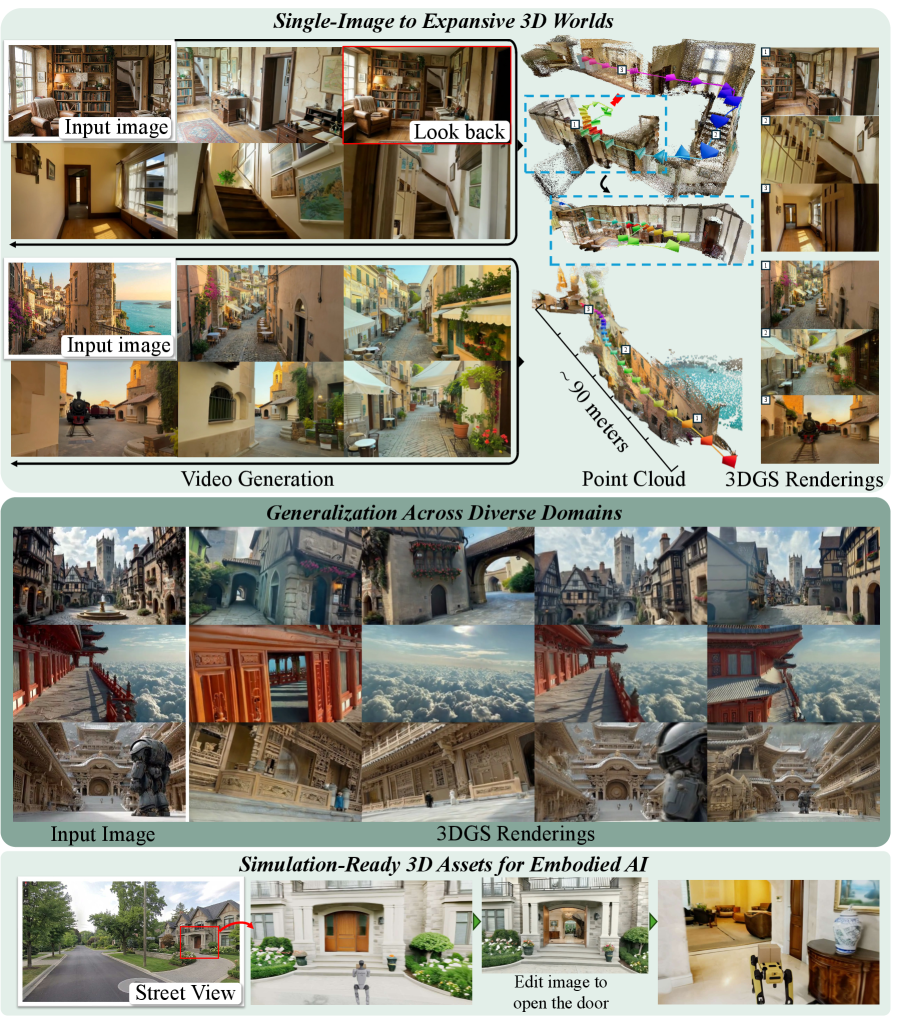

IT之家 4 月 17 日消息,科技媒體 The Decoder 昨日(4 月 16 日)發布博文,報道稱英偉達研究人員推出 Lyra 2.0 系統,可從單張照片生成跨度約 90 米的連貫 3D 環境,解決現有模型在長距離漫遊中的畫面扭曲與遺忘難題。

當前 AI 生成 3D 場景的核心痛點之一,是虛擬攝像機長距離移動後,畫面會出現色彩與結構扭曲,返回已探索區域時模型常重新構建環境。

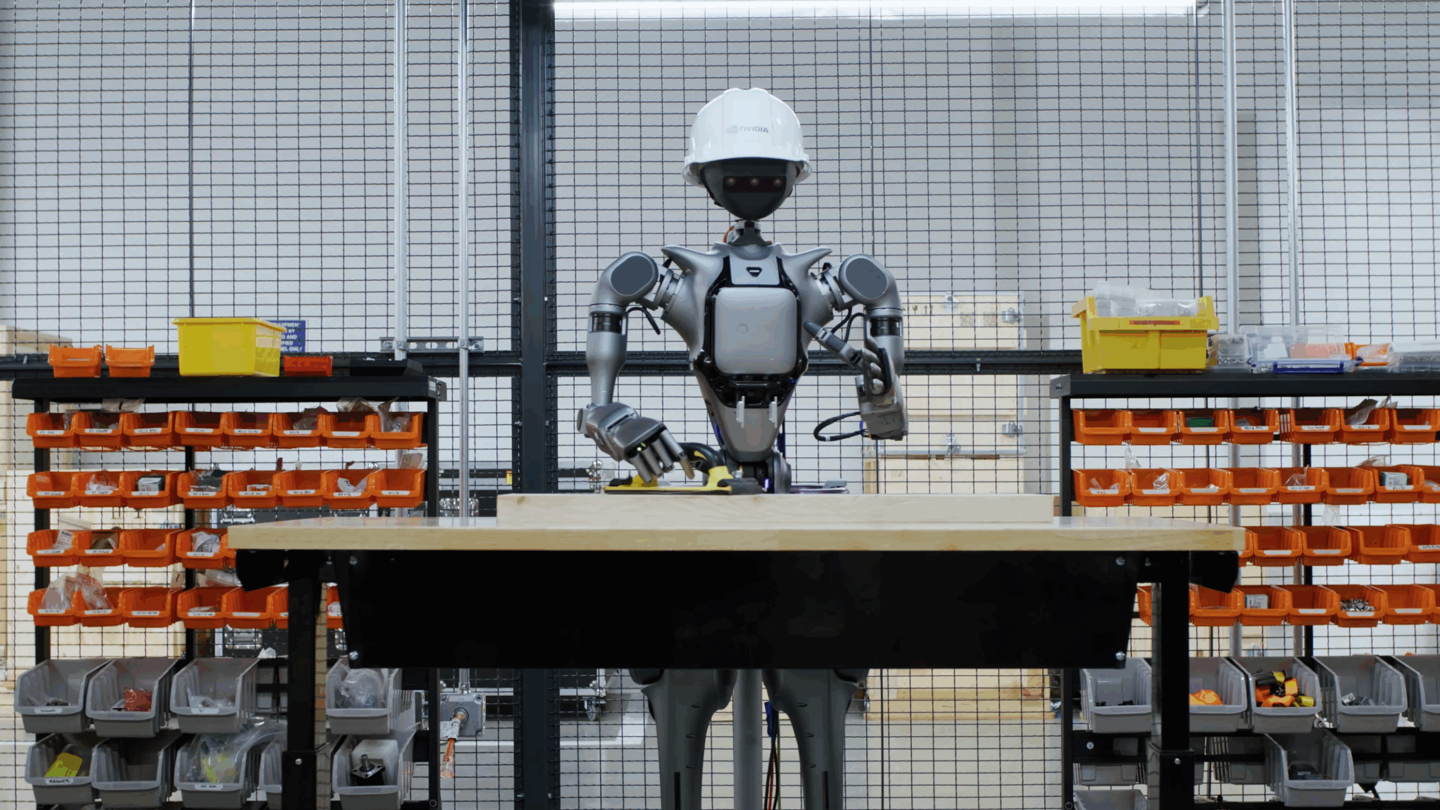

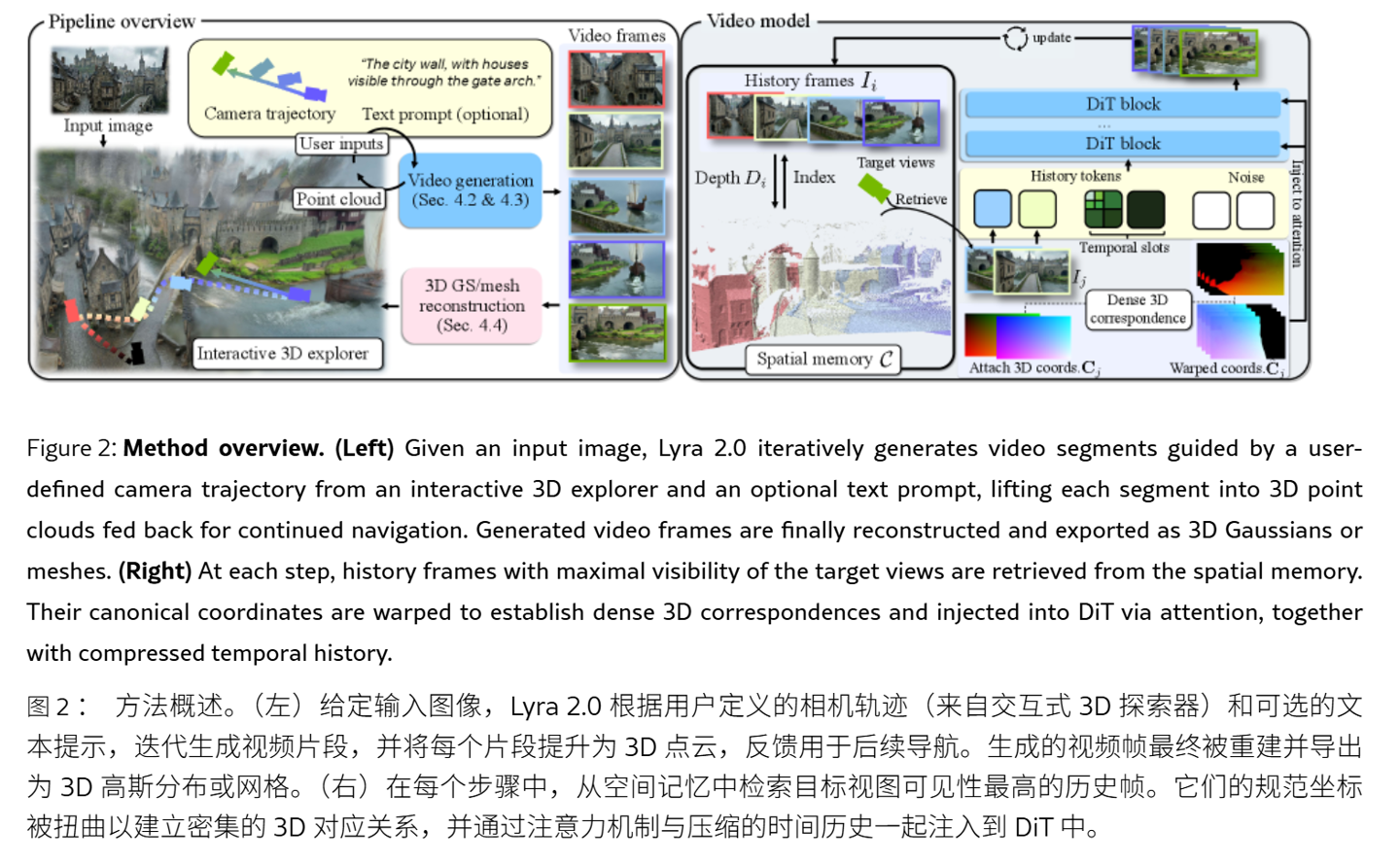

英偉達團隊為提高機器人仿真訓練質量,針對視頻模型離開視野即遺忘已見區域,以及逐步生成過程中誤差累積導致嚴重扭曲兩大挑戰,發布 Lyra 2.0 系統,僅需單張照片即可生成可實時漫遊的 3D 場景。

Lyra 2.0 通過存儲每一幀的 3D 幾何數據解決記憶問題,當攝像機重返舊地後,系統調取歷史空間信息作為參考,避免重複生成。針對誤差累積,研究團隊在訓練中讓模型暴露於自身有缺陷的輸出,讓其學會識別並糾正質量下降,而非傳遞錯誤。

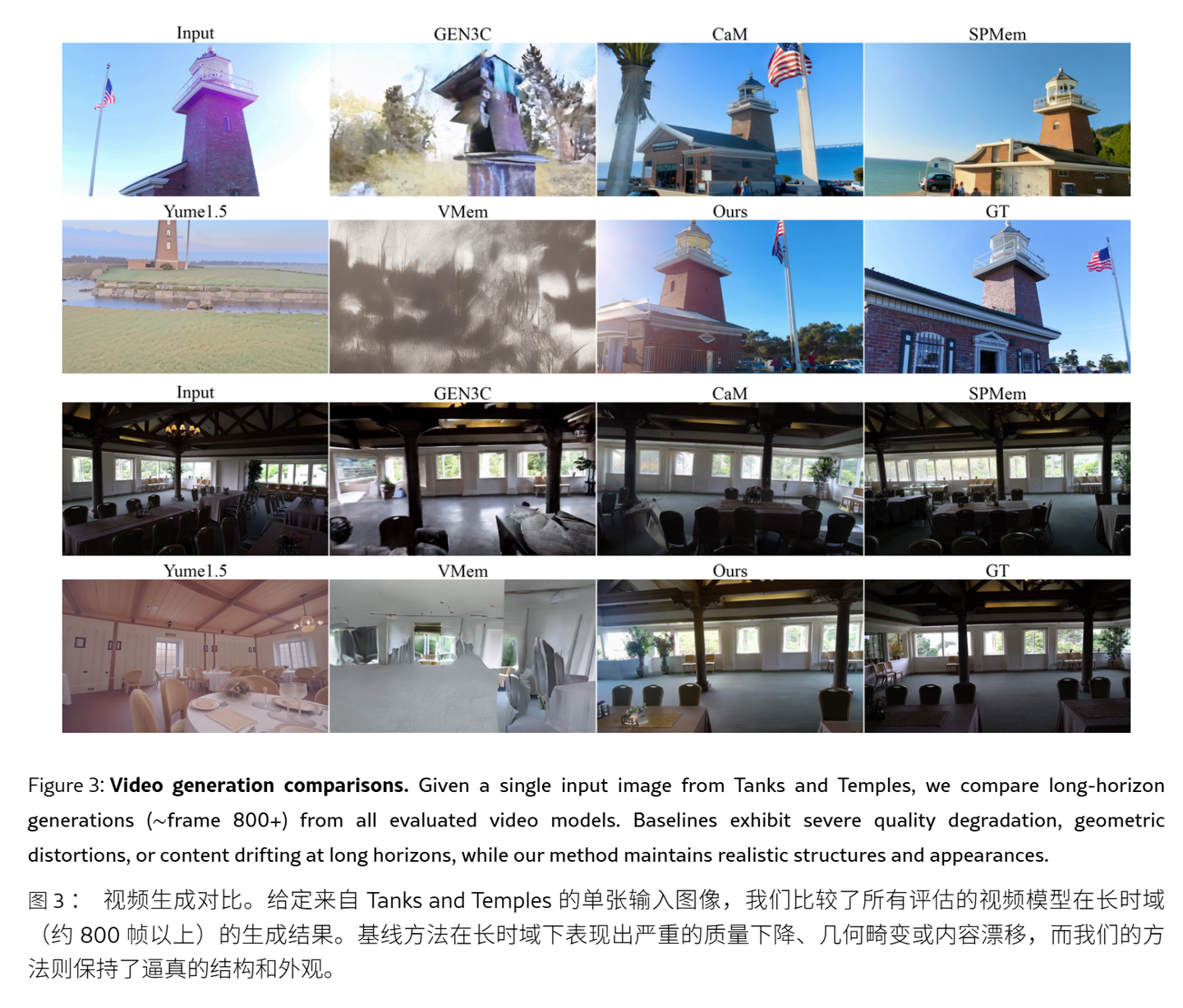

基準測試顯示,Lyra 2.0 在圖像質量、風格一致性和攝像機控制等幾乎所有指標上擊敗 GEN3C、Yume-1.5、CaM 等 6 種競品,其 Fast 版本在質量相當的情況下,視頻生成速度提升約 13 倍。

生成的 3D 場景支持交互式探索,並可導出為網格格式用於 Nvidia Isaac Sim 等物理引擎。這意味着訓練機器人無需採集真實世界 3D 數據,可在完全生成的虛擬環境中訓練。