来源:企业上市

被称为“全球大模型第一股”的智谱AI(股票代码02513.HK),在2月20日周五经历了一场惊人的股价狂欢,单日暴涨超过42%,公司市值一举冲破了3200亿港元的大关。

然而,狂欢的烟火还没散尽,第二天剧情就急转直下。这家备受瞩目的AI公司发布了一封致歉信,直接向开发者们坦承:其刚刚推出的旗舰大模型GLM-5,在发布后正面临着不小的运营挑战和困境。

国产AI公司智谱在同一天上演的“冰火两重天”:

一方面,股价疯涨。 因新一代模型GLM-5技术获国际认可、核心产品提价30%仍售罄,叠加流通盘稀少,智谱港股单日暴涨42%,市值超3200亿港元,市场押注其“技术领先”能转化为商业胜利。

另一方面,运营翻车。 新模型发布后,因计费规则不透明、服务器扩容滞后、升级体验坑人,导致大量付费开发者“用不上、被乱扣费”。公司次日火速发道歉信,承认“菜”并推出全额退款、套餐延期等补偿。

公司本质: 清华学霸创立的技术派“AI模型超市”,收入暴增但巨资研发(年亏30亿),靠烧钱抢跑。风险在于技术淘汰快、重度依赖芯片进口和顶尖人才。

一句话总结:技术强到让市场疯狂,运营菜到让用户骂娘——这场股价狂欢,赌的是它能尽快补齐商业化短板。

一出“技术天才”和“运营菜鸟”在同一天上演的冰火两重天。

第一件事:股价为什么一天涨了42%?

不是因为出了什么完美的产品,而是因为大家觉得它有“王者之气”了。

技术真的牛:新出的GLM-5模型,被海外开发者社区认可了,说快赶上国际顶尖水平。这给了市场一个信号:中国也能做出世界级的AI了,而且是在被芯片卡脖子的情况下,用国产芯片搞出来的,这想象空间就大了。

敢涨价还有人抢:新出的编程套餐提价30%,结果一上线就卖光了。这说明什么?说明它的技术好到让程序员觉得“贵也值”,这是真本事,不是靠低价换市场。

股票太少不够买:它刚上市不久,大部分股票还在锁定期不能卖,市面上能自由买卖的股票很少。大家一看这公司有戏,都冲进去买,僧多粥少,价格一下子就给推到天上去了。

所以,股价暴涨,是市场在给它的“技术实力”和“赚钱潜力”投票。

第二件事:为什么股价刚暴涨,转头就发道歉信?

因为“理想很丰满,现实很骨感”。技术是牛了,但“交作业”的时候搞砸了。

道歉信里说了三个“坑”:

规则没说清:新模型太耗算力,所以公司偷偷搞了个“高峰期消耗加倍”的规则,但没告诉用户。结果用户发现账户余额像坐过山车一样往下掉,就炸了。

服务器没准备好:新模型太火,加上有“黄牛”进来捣乱抢资源,公司的服务器不够用了,导致很多付了钱的用户用不上,或者高峰期卡顿。

升级体验太坑:把老用户升级的页面做得不清不楚,很多人稀里糊涂点错了,被强制消费。

简单说就是:产品是好产品,但服务拉胯了,把第一批支持你的“兄弟们”给得罪了。

这公司到底什么来头?(招股书)

它是谁? 一帮清华学霸开的“AI模型超市”。卖的不是实物,是各种能写文章、能画画、能帮你操作手机的“AI大脑”。

怎么赚钱? 把“AI大脑”租给企业用(按调用次数收费),或者直接卖给银行、政府这些需要保密的大客户(打包安装到他们自己服务器里)。

财务状况? 典型的“高富帅烧钱”模式。收入涨得飞快(一年几个亿),但亏得更快(一年亏几十亿)。钱都烧在买天价显卡和养科学家上了。毛利率不错,说明生意模式本身是赚钱的,只是现在为了抢市场,选择把赚来的钱和融来的钱都all in到研发里了。

最大风险?

技术淘汰赛:AI这行日新月异,跑得慢一点就被淘汰。

持续输血:现在还是个“碎钞机”,需要源源不断的资金支持。

人才依赖:公司命根子就是那几个顶尖科学家,被挖走就塌方了。

芯片卡脖子:命根子之二就是英伟达的芯片,被制裁就歇菜。

巨头环伺:旁边百度、阿里、腾讯这些“富二代”也在拼命砸钱搞AI。

最后,这事该怎么看?

这就像一个天赋异禀的学霸(技术牛),考了个全校第一(股价暴涨),但因为太想表现,在交作业时抄错了行,被老师点名批评(运营事故)。

市场现在分成了两派:

乐观派:觉得学霸就是学霸,犯点小错改了就完了,重点是他有考清华的潜力。所以这个回调,可能是上车的机会。

悲观派:觉得这次事故暴露了这学霸其实是个“书呆子”,只会做题,不会来事。连基本的服务和运营都搞不定,以后怎么跟那些“学痞”(巨头)斗?这估值(50-60倍市销率)已经透支了未来的期望,泡沫太大。

一句话人话总结:智谱现在的情况就是,技术牛掰到让人愿意为它鼓掌,但运营又菜到让人想顺着网线去骂它。股价的疯狂,是赌它能把“技术优势”成功转化成“商业胜势”。而道歉信,则是给这场豪赌泼了盆现实的冷水。

GLM Coding Plan 致信

各位开发者朋友们:

大家春节好。

GLM-5发布后,本该是让大家爽写代码的日子,结果我们这几天的表现,估计让不少兄弟想顺着网线过来敲我们。大家在社区、后台的反馈我们都逐条看了,看完之后非常愧疚。对不起,这波我们确实“菜”了,但我们想负责到底。

这次主要犯了三个错:规则透明度不够、GLM-5灰度节奏太慢、老用户升级机制设计粗糙。挨打要立正,我们反思后,以下是我们的处理和补偿方案。

一、关于规则:一切透明化

很多老用户反馈“消耗变快了”,这里面有我们的锅,也有一些客观的算力逻辑:

1.GLM-5的“胃口“更大了:GLM-5的参数规模是GLM-4.7的两倍以上,定位是效果逼近Claude Opus 4.5的“大杯”模型,适合复杂任务。为了让更多用户能把GLM-5用在真正需要的场景,我们设计了分层使用策略:日常简单任务优先用GLM-4.7,GLM-5按高峰期3倍、非高峰期2倍的消耗计算。尽管我们提前对消耗倍数做了准备,但没提前算清楚账给到大家,这是我们的失误。

2.看板延迟:之前的看板1小时一刷,大家看着余额“蹦极”确实吓人。现在我们已经优化到了10分钟刷新,让大家心中有数。

3.规则详情如下(现已在购买页全面展示):

二、关于体验:我们正在全力优化

诚实地讲,我们近期遭受灰产号池和黄牛党冲击,恶意占用了我们的大量资源。与此同时,GLM-5发布后,流量超出预期,我们的扩容节奏没有跟上,不得以将GLM-5按照Max、Pro、Lite的顺序逐步开放。目前Max用户已经全面开放,Pro用户虽已开放,但高峰期可能会因集群负载较高遇到限流,Lite用户将会在节后非高峰期逐步灰度开放。类似的应急策略同行身上也发生过,去年Claude3.5发布时因流量爆表,被迫针对Pro用户加上一定的限额。

针对受到影响的Lite和Pro用户(不分新老),我们支持自主申请退款。退款遵循2026年1月1日至今天,我们全部请客的原则。

老用户(2026年1月1日前订阅,且2月12日后仍有效):退2026年1月1日至今+剩余天数的全部金额。新用户(2026年1月1日后订阅,且2月12日后仍有效):全额退还当前订阅周期内全部实付金额。退款方式:退款窗口将在节后一周内开启,截止至2026年3月6日。届时进入我的套餐页面,点击取消并退款一键完成。包括Max用户在内的已经用上GLM-5的用户,及继续选择我们的用户,我们统一为您延期15天使用期(系统将在2026年3月7日为您发放价值15天订阅费用的赠金)

Coding Plan走过这半年,是大家的信任与我们共同成就了这个产品。GLM-5 Bet On Opus平替这个生态位,模型效果在全球范围受到认可,我们会继续追求极致的Coding效果,全力与黑灰产搏斗、优化lInfra,相信体验将很快改善。希望大家能继续给予我们信任,再给我们一点时间,我们将用行动证明值得您的选择。

三、关于升级“回滚”:不让老朋友吃亏

针对2月12至16日期间,从老套餐误打误撞升到新套餐的用户,我们要帮您一键回滚:

1.处理方式:

发放与您新套餐同档位、同周期的老套餐权益(无周限额版本),并取消新套餐续费。

2.差额处理:

钱多退,少不补。中间产生的差额,我们自己扛了。

3.时间线:

预计在节后1-2周内联系受影响用户尽快处理,届时会短信/邮件通知大家。

4.升级页面的新老套餐不同权益现已明确展示。

这次改版确实让我们学到了很多。错误我们会及时修正,大家的损失我们会全力补偿。此外,向大家保证:未来涉及用户核心权益的调整,我们一定会提前说明并给出“选择期”,绝不让大家被动接受。最后,祝大家新年代码无Bug,马年行大运!

智谱全体团队敬上

2026年2月21日

一份关于这家中国人工智能公司招股章程核心内容,用最直白的语言为你梳理关键信息。

这家公司是做什么的?

一句话:中国领先的AI大模型公司,目标是做出通用人工智能(AGI),类似于打造一个超级智能大脑。

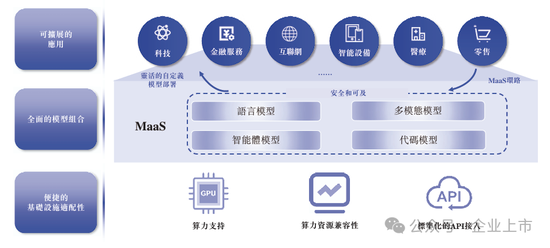

它的核心业务是开发和销售各种AI大模型,并通过一个叫 MaaS(模型即服务) 的平台对外提供服务。客户既包括企业(如金融、互联网公司),也包括个人开发者。你可以把它理解为AI界的“模型超市”,提供语言、视觉、代码等各种模型,客户可以按需选用。

他们有什么牛的技术和产品?

公司基于自研的 GLM 模型框架,开发了四大类模型:

语言模型:这是基础,能理解和生成语言。代表产品是 GLM-4.5(他们的旗舰模型),据称在国内排名第一,全球开源模型中也是第一。

多模态模型:不仅能看懂文字,还能看懂图片、视频,能听能说。例如:

GLM-4V:能理解和推理图片内容。

CogVideoX:能生成视频。

GLM-4-Voice:能生成带情感的语音。

智能体模型(AI Agent):这是能帮你干活的AI,能像人一样操作手机App完成复杂任务。

AutoGLM:可以自主操作你的手机,比如帮你点外卖、订票。

CoCo:为企业设计的智能助手,用于自动化处理业务流程。

代码模型:能自动写代码,帮程序员提高效率。

他们怎么赚钱?

主要通过 MaaS平台 卖服务,主要有两种方式:

云服务:客户通过云端调用API(应用程序编程接口),按使用量或订阅付费。适合希望快速上手的公司。

本地化部署:把整个模型安装到客户自己的服务器上,保证数据安全。适合对数据保密性要求高的公司(如银行、政府)。

公司的发展历程和融资情况如何?

2019年成立,创始团队主要来自清华大学。

发展迅速:从2021年开始不断发布新模型,2023年推出了知名的ChatGLM和“智谱清言”App。

融资凶猛:从成立到上市前,完成了多轮融资,累计融资超过83.6亿元人民币。投资方阵容豪华,包括美团、腾讯、蚂蚁集团、社保基金等。

股权结构:创始团队通过一致行动协议,共同作为公司的控股股东,上市前合计持股约33.03%。刘德兵博士是董事长,张鹏博士是CEO。

他们的财务表现怎么样?

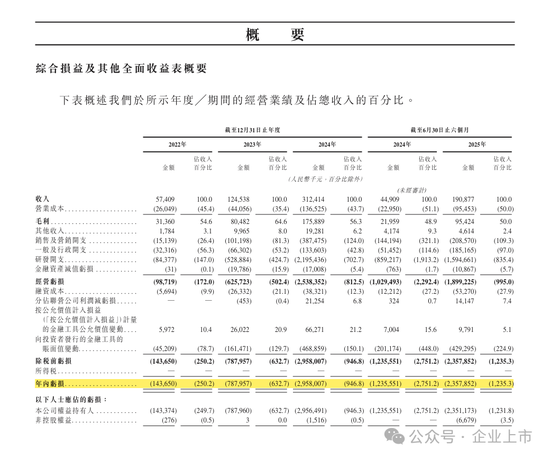

收入增长极快:2022年收入仅5740万,2023年1.245亿,2024年就到了3.124亿。2025年上半年收入1.909亿,继续保持高增长。

但还在亏钱:2022年亏1.44亿,2023年亏7.88亿,2024年亏29.58亿。亏损的主要原因是在疯狂投入研发,2024年一年研发开支就高达21.95亿元。

毛利率不错:毛利率一直保持在50%以上,说明产品本身是有利可图的,只是现在需要大量砸钱搞研发。

有什么主要风险?

技术迭代快:AI行业日新月异,如果不能持续创新,很快就会被淘汰。

持续烧钱:研发投入巨大,何时能盈利还不确定。

人才依赖:公司极度依赖核心的研发团队,人才流失是重大风险。

算力卡脖子:AI训练需要大量昂贵的GPU(图形处理器)芯片(主要是英伟达的),依赖海外供应链,存在被“卡脖子”的风险。

监管风险:AI是个强监管行业,未来政策变化可能影响业务。

竞争激烈:不仅要和其他独立AI公司竞争,还要和百度、阿里这样的科技巨头竞争。

他们为什么要上市?

为了融更多钱,继续搞研发,吸引人才,同时也让早期投资人和员工手里的股票可以变现。公司计划在香港上市,股票代码类别属于“特专科技公司”。

一句话总结

这是一家由清华学霸创立、技术实力强劲、收入增长飞快但仍在巨额亏损、被众多明星资本看好的中国AI大模型头部公司。它正在豪赌未来,希望通过持续的技术领先,最终在即将爆发的AI市场中赢得胜利。

责任编辑:王珂