IT之家 7 月 17 日消息,英特尔近日在 GitHub 开源了一款基于 AI 的视频质量评估工具 —— 计算机图形视觉质量指标(Computer Graphics Visual Quality Metric,简称 CGVQM),旨在为现代游戏和实时渲染图形的画质评价提供客观衡量标准。该工具已以 PyTorch 应用形式在 GitHub 上发布,同时配套研究论文《CGVQM+D:计算机图形视频质量指标及数据集》也对外公布。

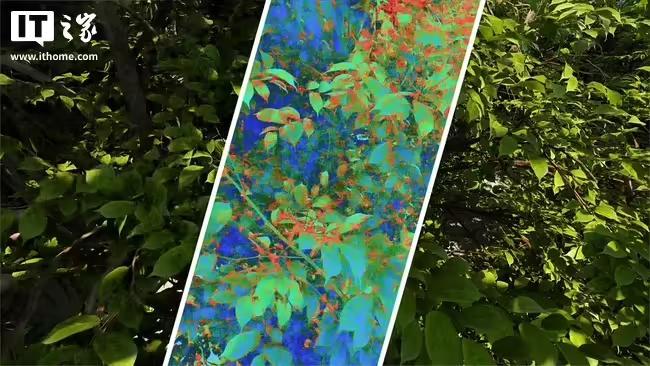

当前游戏画面很少以原生帧渲染,普遍依赖 DLSS 等超分技术、帧生成、可变速率着色等手段提升性能与画质,但也由此引发鬼影、闪烁、锯齿、遮挡等各种视觉问题。此前业内多通过主观评价描述这些缺陷,缺乏标准化的客观量化工具。

据IT之家了解,尽管视频压缩评估常用的峰值信噪比(PSNR)等指标可用来衡量画质,但这些方法并不适用于实时图形渲染。PSNR 主要评估压缩伪影,难以全面反映实时图形中的复杂失真与画质劣化。

为此,英特尔研究团队采取了双管齐下的策略:一方面,构建了一个全新视频数据集 —— 计算机图形视觉质量数据集(CGVQD),涵盖路径追踪、神经去噪、神经超采样(如 FSR、XeSS、DLSS)、高斯泼溅、帧插值和可变速率着色等技术所引发的多样化画质退化;另一方面,基于该数据集,训练了 CGVQM AI 模型,专门用于识别并量化这些失真。

研究团队邀请人类观察者对数据集中的视频失真程度进行评级,形成“几乎不可察觉”到“非常恼人”的感知基线,再以此为依据训练 AI 模型。模型采用 3D 卷积神经网络(3D-CNN),具体基于 3D-ResNet-18 架构。3D 网络相较于 2D 模型,可同时捕捉空间和时间维度的图像特征,更好识别视频中动态变化带来的画质问题。

实验显示,CGVQM 的评估效果几乎全面超越现有同类工具。其中更复杂的 CGVQM-5 模型在 CGVQD 数据集上,仅次于人类基线评分,简单版 CGVQM-2 也稳居第三。更重要的是,CGVQM 在未见过的视频中同样展现了良好的泛化能力,使其具备广泛适用价值。

研究人员同时指出,未来可通过引入 Transformer 网络架构进一步提升模型性能,尽管这会带来更高的计算资源消耗;也可引入光流等信息以优化失真识别。