今天凌晨,麻省理工技术评论发布了专访文章《塑造OpenAI研究未来的两个人》,主要介绍了OpenAI两位最重要的研究主管Mark Chen和Jakub Pachocki。

前OpenAI联合创始人兼首席科学家Ilya Sutskever离开OpenAI之后,Jakub Pachocki接替了他的职位,曾领导开发过GPT-4、OpenAI Five、o1、o3等重要模型。

Mark Chen是在前OpenAI首席技术官Mira Murati离开后,接替了她的职责并任命为首席研究官。曾领导开发过GPT‑3、GPT‑4/Turbo、DALL·E、Codex等重要模型。

而OpenAI即将发布的重磅产品GPT-5模型,依然由这两位技术大神领导研发。

对于麻省理工技术评论这篇专题文章,Sam Altman相当认可,并表示,我通常觉得这类文章都没说到点子上,但这篇确实抓住了Mark和Jakub的合作精髓。

以下是专访文章的完整内容:

在过去几年里,OpenAI 给人的感觉像是 “一人品牌”。凭借其娱乐圈风格和筹资魅力,首席执行官Sam Altman盖过了公司其他所有知名人士的风头。甚至他那次搞砸的被赶下台事件也以他重新回到巅峰并比以往任何时候都更出名而告终。但如果你能越过这位富有魅力的代言人,你就能更清楚地了解这家公司的走向。毕竟,Altman并不是构建该公司赖以立足的技术的人。

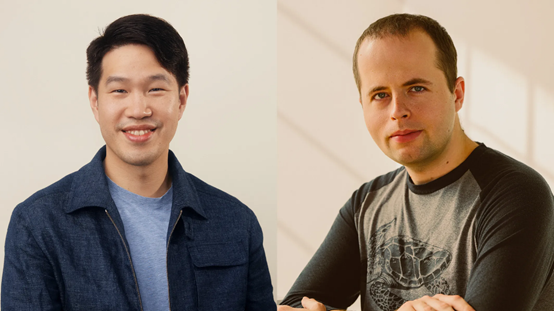

这一责任落在了 OpenAI的双料研究负责人身上首席研究官Mark Chen和首席科学家Jakub Pachocki。他们共同肩负着确保 OpenAI在像谷歌这样的强大竞争对手面前保持领先一步的职责。

在我与Chen和Pachocki进行独家对话期间,他们刚于2023年前往伦敦,那里是 OpenAI 设立的首个国际办公室所在地。我们讨论了他们如何应对研究与产品之间固有的紧张关系。

我们还讨论了他们为何认为编程和数学是更通用模型的关键;当他们谈论通用人工智能(AGI)时,他们真正指的是什么;以及 OpenAI 的超级对齐团队发生了什么,该团队由公司联合创始人兼前首席科学家Ilya Sutskever设立,旨在防止假设中的超级智能失控,该团队在他离职后不久便解散了。

特别是,我想了解在 OpenAI 即将推出数月来最大产品发布之际GPT-5,他们的想法是什么。

有报道称,该公司的下一代模型将于 8 月推出。OpenAI 的官方说法好吧,是Altman的说法是 GPT-5 将“很快”发布,期待值很高。

OpenAI 在GPT-3 和 GPT-4 上取得的飞跃提高了人们对这一技术可能性的预期。然而,GPT-5 发布的延迟引发了谣言,称OpenAI 在构建符合自身更不用说其他所有人期望的模型方面遇到了困难。

但对于一家在过去几年里一直为行业设定议程的公司来说,管理预期是工作的一部分。而Chen和Pachocki则在OpenAI 内部设定议程。

双巨头并峙

OpenAI的伦敦总部位于圣詹姆斯公园,距离白金汉宫以东几百米。但我是在国王十字车站附近的一个共享工作空间的会议室里见到Chen和Pachocki的,OpenAI在那里保留了一个落脚点的地方,位于伦敦科技街区的中心。OpenAI 的研究传播主管Laurance Fauconnet坐在桌子一端,打开笔记本电脑。

穿着酒红色马球衫的Chen,看起来整洁利落,几乎有点书生气。他接受过媒体培训,与记者交谈时很自在。穿着印有大象标志的黑色 T 恤的Pachocki,看起来更像是电影里的黑客。他说话时经常盯着自己的手。

但这对搭档比他们最初看起来更紧密。Pachocki总结了他们的角色。Chen负责塑造和管理研究团队,他说。“我负责制定研究路线图并建立我们的长期技术愿景。”

“但角色之间存在流动性,”Chen说。“我们都是研究人员,我们都在研究技术问题。无论我们看到什么可以深入研究并解决的问题,那就是我们要做的。”

Chen于 2018 年加入该公司,此前他在华尔街公司 Jane Street Capital 担任量化交易员,开发用于期货交易的机器学习模型。

左Mark Chen,右Jakub Pachocki

在OpenAI他主导了 DALL-E 的创建,这是该公司突破性的生成式图像模型。随后,他参与了为 GPT-4 添加图像识别功能的工作,并主导了 Codex的开发,Codex 是为 GitHub Copilot 提供支持的生成式编码模型。

Pachocki于2017年离开理论计算机科学的学术生涯加入 OpenAI,并于 2024 年接替Sutskever担任首席科学家。他是 OpenAI 所谓的推理模型的关键架构师尤其是 o1 和 o3这些模型旨在解决科学、数学和编程中的复杂任务。当我们见面时,他们刚刚经历了公司技术连续两次获胜的兴奋。

7月16日,OpenAI 的一个大型语言模型在AtCoder世界巡回赛总决赛中获得第二名,这是世界上最艰难的编程比赛之一。7 月 19 日,OpenAI 宣布其一个模型在 2025 年国际数学奥林匹克竞赛中取得了金牌水平的成绩,这是世界上最负盛名的数学竞赛之一。

数学竞赛的结果登上了头条新闻,不仅因为 OpenAI 取得了令人瞩目的成就,还因为竞争对手谷歌 DeepMind在两天后透露,其一个模型在同一竞赛中取得了相同的分数。谷歌 DeepMind 遵守了竞赛规则,等待组织者检查结果后再宣布;而 OpenAI实际上是自己评判自己的答案。

对于Chen和Pachocki来说,结果不言自明。不过,他们更兴奋的是编程比赛的胜利。“我认为这有点被低估了,”Chen对我说。国际数学奥林匹克竞赛的金牌成绩会让你跻身前20到50名的选手之列,他说。但在AtCoder竞赛中,OpenAI 的模型位列前两名:“突破到人类表现的一个真正不同的层级这是前所未有的。”

不断推出新产品

OpenAI的员工仍然喜欢说他们是在研究实验室工作。但该公司已经不同于 ChatGPT 发布三年前的公司了。该公司现在正与世界上最大、最富有的科技公司展开竞争,其估值高达 3000 亿美元。突破性的研究和引人注目的演示已经不够了。它需要推出产品并将其交到人们手中而且它确实做到了。

OpenAI一直在推出新产品发布其GPT-4 系列的重大更新,推出一系列生成式图像和视频模型,并引入与 ChatGPT 语音交流的功能。六个月前,它启动了新一轮所谓的推理模型,首先是o1,随后是 o3。上周,它向公众发布了其浏览器使用智能体Operator。该公司现在声称每周有超过 4 亿人使用其产品,并提交25亿个提示。

OpenAI即将上任的应用程序首席执行官Fidji Simo计划保持这一势头。在给公司的一份备忘录中,她告诉员工,她期待着“帮助将 OpenAI 的技术交到世界各地更多人的手中”,在那里它们将“为人们创造比历史上任何其他技术都更多的机会”。

我问 OpenAI 如何平衡开放式研究和产品开发。“这是我们很久以前就在思考的问题,远远早于 ChatGPT 时代,”Pachocki说。“如果我们真的要认真尝试构建通用人工智能,显然,你可以用这项技术做很多事情,中途可以走很多分支,这些分支都可以成为重要的产品。”换句话说,不断摇动这棵树,收获你能得到的一切。

OpenAI人士经常提到的一个观点是,将实验性模型推向世界是研究的必要部分。目标是让人们意识到这项技术已经变得多么出色。“我们希望让人们了解即将到来的事情,这样我们就可以参与一场非常艰难的社会对话,”Altman在 2022 年告诉我。这种奇怪新技术的制造者也很好奇它能用于什么:OpenAI 很想将其交到人们手中,看看他们会用它做什么。

这种情况仍然存在吗?他们同时回答道。“是的!”Chen说。“在某种程度上,”Pachocki说。Chen笑了:“不,你先说。”

“我不是说研究会在产品上迭代,”Pachocki说。“但现在这些模型已经处于可以通过经典基准测试的边缘,许多我们一直在思考的长期挑战也开始被攻克,我们正处于一个真正关乎模型在现实世界中能做什么的阶段。”

比如在编程比赛中与人类一较高下。在今年于日本举行的 AtCoder 竞赛中击败 OpenAI 模型的人是一名名叫Przemysław Dębiak的程序员,他也被称为 Psyho。这场比赛是一场解谜马拉松,参赛者有 10 个小时的时间来找到解决复杂编程问题的最高效方法。在他获胜后,Psyho 在 X 上发文说:“我完全筋疲力尽……我几乎要崩溃了。”

Chen和Pachocki与竞争性编程的世界有着深厚的联系。他们过去都参加过国际编程比赛,Chen还指导美国计算机奥林匹克竞赛队。我问他们,对竞争性编程的个人热情是否影响了他们对模型在这种挑战中表现出色的重要性看法。

他们俩都笑了。“当然,”Pachocki说。“所以:Psyho 是一种传奇人物。他多年来一直是排名第一的选手。他实际上也是我的朋友我们过去常在一起参加这些比赛。”Dębiak也曾与Pachocki在 OpenAI一起工作过。

当Pachocki参加编程比赛时,他更喜欢那些关注较短问题且有明确解决方案的比赛。但Dębiak喜欢更长、开放式的问题,没有明显的正确答案。

“他过去常常取笑我,说我会参加的那种比赛比他喜欢的那种比赛更早被自动化,”Pachocki回忆说。“所以我非常关注这个模型在最近这次比赛中的表现。”

Pachocki告诉我,他一直关注着从东京传来的深夜直播,看着自己的模型获得第二名:“Psyho 这次坚持住了。”

“我们已经跟踪大型语言模型在编程比赛中的表现有一段时间了,”Chen说。“我们看着它们变得比我强,比雅库布强。这有点像李世石下围棋。”

李世石是一名围棋大师,他在 2016 年与谷歌 DeepMind 的围棋模型 AlphaGo 进行了一系列比赛并输掉了比赛。这一结果震惊了国际围棋界,并导致李世石放弃了职业棋手的身份。去年,他告诉《纽约时报》:“在某种意义上,输给人工智能意味着我的整个世界正在崩溃……我再也无法享受这个游戏了。”然而,与李世石不同的是,Chen和Pachocki对于被超越感到非常兴奋。

但其他人为什么应该关心这些小众的胜利呢?很明显,这种旨在模仿并最终取代人类智能的技术是由那些认为在数学竞赛中取得优异成绩或与传奇程序员一较高下是智力巅峰的人构建的。这种对智力的看法偏向于数学、分析这一端是否存在问题?

“我的意思是,我想你说得对你知道,自私地说,我们确实想创建能够加速我们自身发展的模型,”Chen对我说。“我们将其视为一个非常快速的进步因素。”

像Chen和Pachocki这样的研究人员所提出的论点是,数学和编程是更通用智能形式的基础,这种智能可以以我们自己可能想不到的方式解决各种问题。“我们在这里谈论的是编程和数学,”Pachocki说。“但这实际上关乎创造力,提出新奇的想法,将来自不同地方的想法联系起来。”

看看最近的两次比赛:“在这两种情况下,都有问题需要非常艰难的、突破常规的思考。Psyho 在编程比赛的一半时间里都在思考,然后想出了一个真正新颖且与我们的模型所考虑的任何内容都相当不同的解决方案。”

“这正是我们所追求的,”Pachocki继续说道。“我们如何让模型发现这种新奇的见解?真正推动我们的知识进步?我认为它们已经在某些有限的方式上能够做到这一点。但我认为这项技术有潜力真正加速科学进步。”

我又回到了关于是否专注于数学和编程是一个问题的问题上,承认也许如果我们正在构建的是帮助我们做科学研究的工具,这没关系。我们不一定希望大型语言模型取代政治家并具备人际交往能力,我建议道。

Chen皱了皱脸,抬头望向天花板:“为什么不呢?”

OpenAI还缺少什么

OpenAI的成立带有一种即使在硅谷也很突出的傲慢,当时它就吹嘘其构建通用人工智能(AGI)的目标,而当时谈论 AGI 还听起来很荒谬。OpenAI 仍然和以往一样热衷于 AGI,并且它比大多数人更多地使 AGI 成为一个主流的数十亿美元的焦点。不过,它还没有实现。我问Chen和Pachocki他们认为还缺少什么。

“我认为设想未来的方式是真正深入研究我们今天看到的技术,”Pachocki说。“从一开始,OpenAI就将深度学习视为一种非常神秘且显然非常强大的技术,具有很大的潜力。我们一直在试图了解它的瓶颈。它能做什么?它不能做什么?”

Chen说,目前处于最前沿的是推理模型,这些模型将问题分解成更小、更易于管理的步骤,但即使是它们也有局限性:“你知道,你有这些模型,它们知道很多事情,但却无法将这些知识串联起来。为什么呢?为什么它不能像人类那样做到这一点呢?”

OpenAI正在全力以赴回答这个问题。

“我们可能仍然处于这种推理范式的非常初期阶段,”Pachocki告诉我。“真的,我们正在思考如何让这些模型长期学习和探索,并真正提出全新的想法。”

Chen强调了这一点:“我真的不认为推理已经完成。我们绝对没有解决这个问题。你必须阅读大量的文本,才能对人类所知道的东西有一个大致的了解。”

OpenAI不会透露其用于训练模型的数据,也不会透露有关模型的大小和形状的细节只说它正在努力使开发过程的各个阶段更加高效。

这些努力使他们相信,所谓的规模定律这些定律表明,随着你投入更多的计算能力,模型将继续变得更好并没有显示出任何崩溃的迹象。

“我认为没有证据表明规模定律已经死亡,”Chen坚持说。“总是存在瓶颈,对吧?有时它们与模型的构建方式有关。有时它们与数据有关。但从根本上说,这只是关于找到能够突破当前瓶颈的研究。”

我对进步的信心是坚定不移的。我提到了Pachocki在 5 月接受《自然》杂志采访时关于 AGI 的说法:“2017 年我加入OpenAI 时,我仍然是公司里最大的怀疑论者之一。”他看起来有些怀疑。

“我不确定我对这个概念是否怀疑,”他说。“但我认为我是”他停顿了一下,看着放在面前桌子上的手。“当我加入 OpenAI 时,我预计达到我们现在所处的阶段的时间会更长。”

“人工智能有很多后果,”他说。“但我最常思考的是自动化研究。当我们回顾人类历史时,其中大部分是关于技术进步的,是关于人类构建新技术的。当计算机能够自己开发新技术时,这似乎是一个非常重要的、嗯,转折点。

“我们已经看到这些模型协助科学家。但当它们能够从事更长期的工作当它们能够为自己建立研究项目时世界将会有实质性的不同。”

对于Chen来说,模型能够独立工作更长时间的能力是关键。“我的意思是,我认为每个人对通用人工智能都有自己的定义,”他说。“但这个自主时间的概念模型在遇到死胡同时能够花在解决一个难题上的时间是我们所追求的一个重要目标。”

这是一个大胆的愿景远远超出了当今模型的能力。但我仍然被Chen和Pachocki使通用人工智能听起来几乎平淡无奇的方式所打动。与 18 个月前我和Sutskever交谈时他的反应相比,他当时告诉我:“这将是具有里程碑意义的,是震撼世界的。这将是一个分水岭。”面对他正在构建的东西的巨大性,Sutskever将他的职业生涯重心从设计越来越好的模型转移到弄清楚如何控制他认为很快就会比自己更聪明的技术上。

两年前,Sutskever成立了一个所谓的超级对齐团队,他将与另一位 OpenAI 安全研究员扬·莱克(Jan Leike)共同领导这个团队。该团队声称将投入 OpenAI 五分之一的资源来研究如何控制假设中的超级智能。如今,超级对齐团队的大多数人,包括Sutskever和莱克,都已离开公司,该团队也不复存在。

莱克离职时说,是因为该团队没有得到他认为应得的支持。他在 X 上发帖说:“制造比人类更聪明的机器本质上是一项危险的事业。OpenAI 正代表全人类肩负着巨大的责任。但在过去几年里,安全文化和流程被耀眼的产品所忽视。”其他离职的研究人员也发表了类似的声明。

我问Chen和Pachocki他们如何看待这些担忧。“很多事情都是非常个人的决定,”Chen说。“你知道,研究人员可能会有一种信念,认为该领域将朝着某个方向发展,他们的研究将取得成果并结出硕果。而你知道,也许公司并没有按照你希望的方式进行调整。这是一个非常动态的领域。”

“很多事情都是非常个人的决定,”他重复道。“有时该领域的发展方向与你的研究方式不太一致。”

但他们俩都坚持认为,对齐现在是核心业务的一部分,而不是某个特定团队的专属问题。根据Pachocki的说法,这些模型根本无法工作,除非它们按照你的预期工作。而且,当现有的模型已经足够具有挑战性时,人们也不太愿意专注于将假设中的超级智能与你的目标对齐。

“两年前,我们所想象的风险大多是理论上的风险,”Pachocki说。“如今的世界看起来大不相同了,我认为许多对齐问题现在都是出于非常实际的动机。”

然而,实验性技术被转化为大众市场产品的速度比以往任何时候都要快。这真的不会导致他们之间产生分歧吗?

“我常常有幸能够真正思考技术的长期发展方向,”Pachocki说。“应对过程的现实无论是人员方面,还是更广泛的公司需求都落在了Chen身上。这并不是真正的分歧,但在我们之间确实存在一种自然的紧张关系,这种紧张关系源于公司面临的这些不同的目标和不同的挑战。”Chen插话说:“我认为这只是一个非常微妙的平衡。”