作者 | 陈骏达

编辑 | 李水青

国产SOTA(最佳表现)级开源图像生成模型,来了!

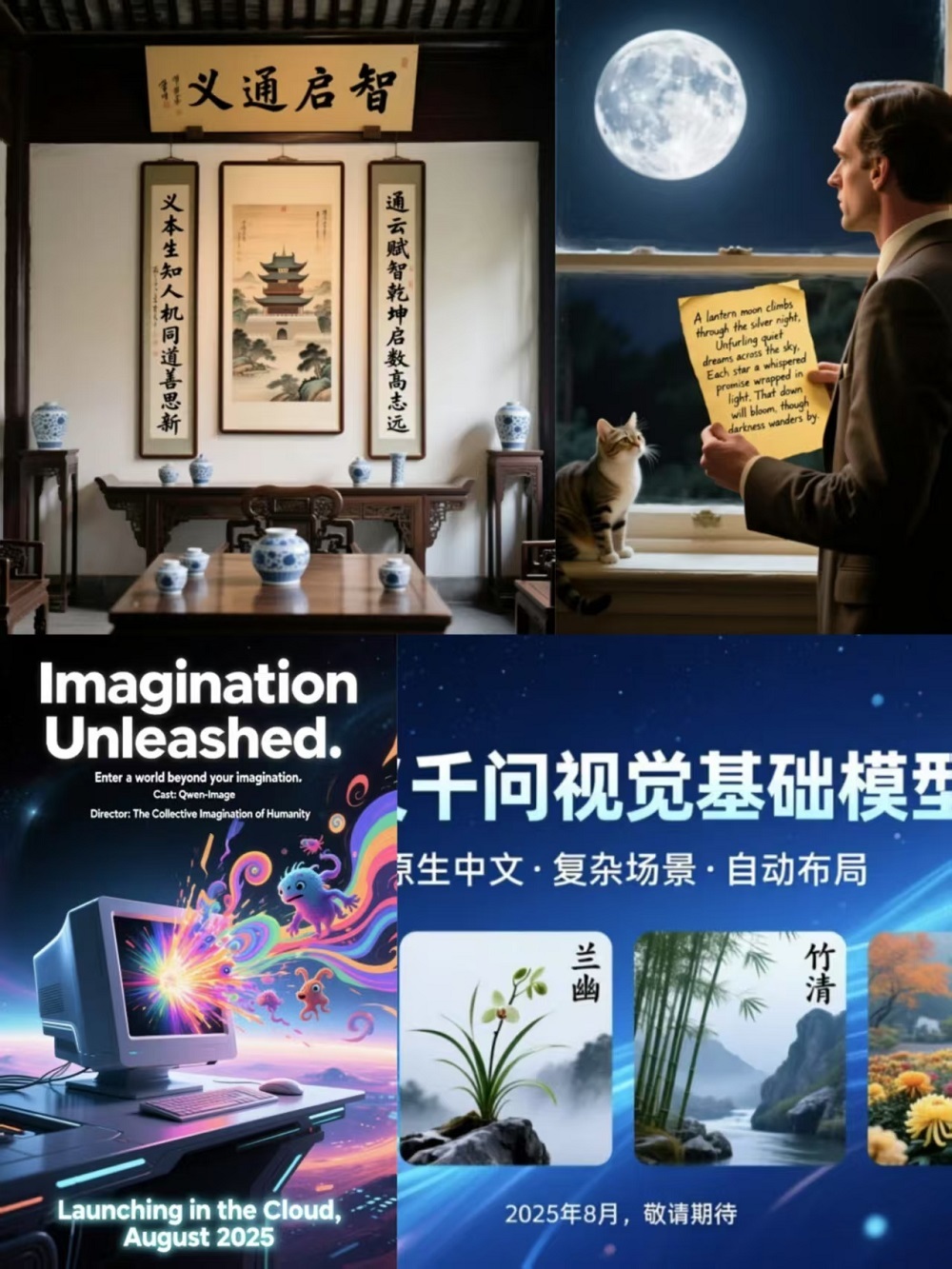

智东西8月5日报道,今天,阿里开源了Qwen-Image,通义千问系列中首个图像生成基础模型。Qwen-Image主打复杂文本渲染能力,能在不同场景中,准确地生成不同语种、风格的文字,甚至可以写毛笔字书法,或是直接生成带有文本和图像的PPT页面。

下图中,Qwen-Image不仅准确还原了提示词中的“宫崎骏”风格要求,还随着构图的景深变化,将“云存储”、“云计算”等字样准确地渲染。文字与画面的融合较为自然。

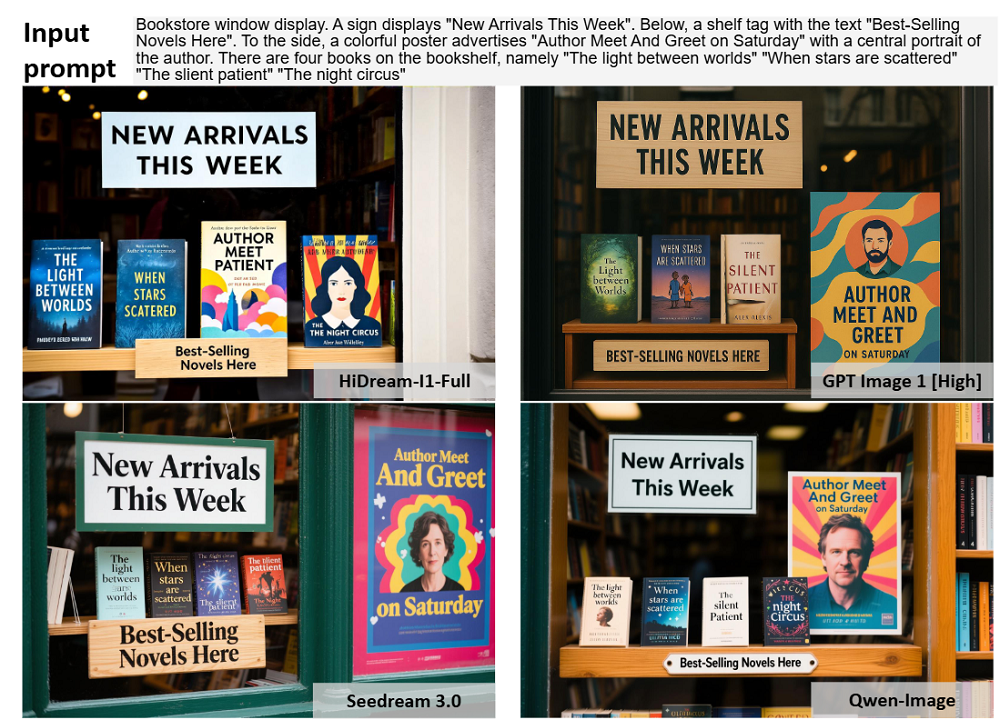

Qwen-Image同样准确生成英文内容。它根据英文提示词生成了一个书店的橱窗场景,所有指定的文字都被准确还原,并且它还自动为每本书生成了不同的风格化字体以及封面,与书名契合。

除了文本处理,Qwen-Image在通用图像生成方面支持了多种艺术风格。从照片级写实场景到印象派绘画,从动漫风格到极简设计都掌握了。

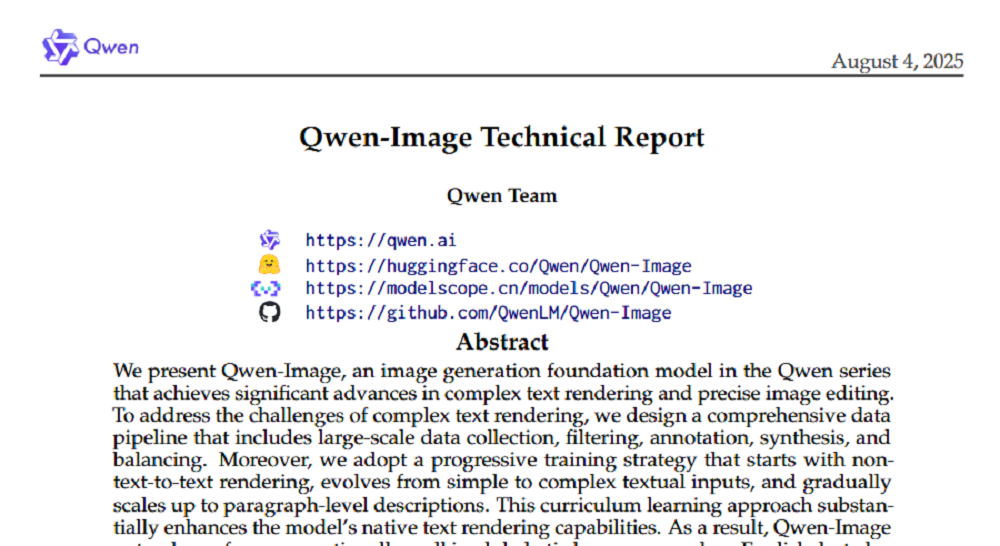

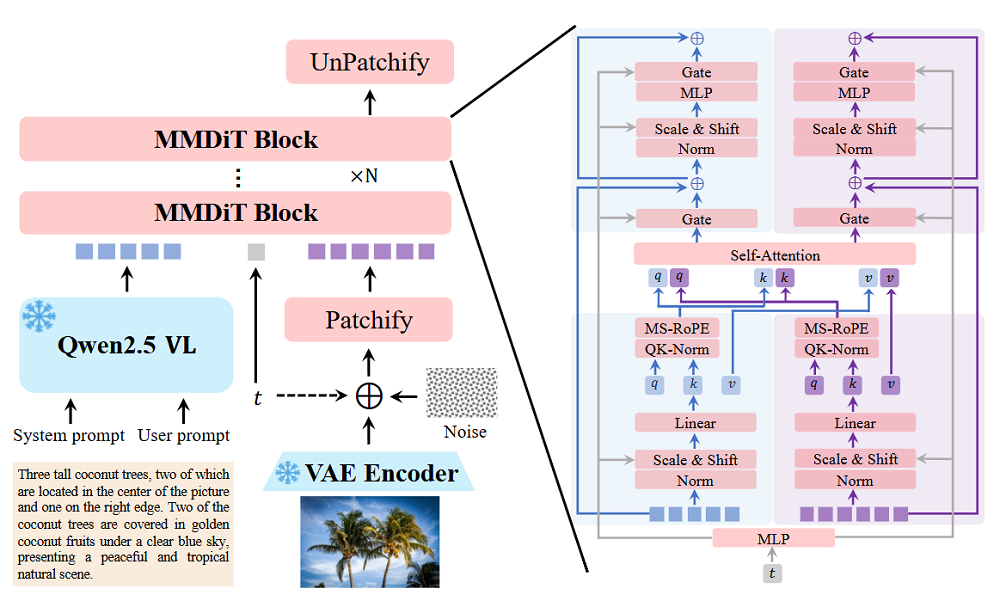

Qwen-Image是一个20B的模型,使用了MMDiT(多模态扩散Transformer)架构,其中“MM”代表的是模型生成图像、文本等多模态内容的能力,“DiT”则代表了这是一个扩散Transformer。

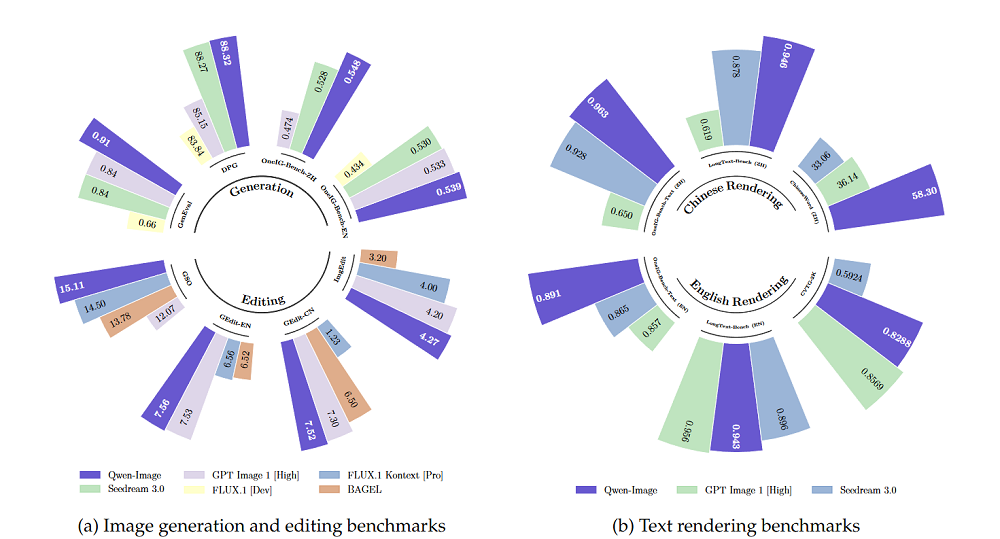

千问团队在多个公开基准上对Qwen-Image进行了评估,比较对象为全球头部的开源、闭源图像生成模型,共获得12项SOTA(最佳表现)。在通用图像生成测试GenEval、DPG和OneIG-Bench,以及图像编辑测试GEdit、ImgEdit和GSO上,Qwen-lmage超过了Flux.1、BAGEL等开源模型、字节跳动的SeedDream 3.0和OpenAI的GPT Image 1(High)。

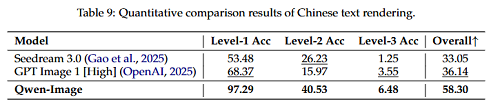

在用于文本渲染的LongText-Bench、ChineseWord和TextCraft基准测试上的结果表明,Qwen-Image在文本渲染方面表现尤为出色,特别是在中文文本渲染上,大幅领先现有的最先进模型,包括SeedDream 3.0和GPT Image 1(High)。

目前,Qwen-Image已在魔搭、Hugging Face等社区开源,普通用户可在QwenChat(chat.qwen.ai)中选择图像生成功能,直接体验这款模型。

Qwen-Image的技术报告也同步开源,报告内容逐一揭秘了这款模型的具体技术实现。

一、架构包含三大核心组件,多模型协作实现图像生成

千问团队观察到,市面上已有的图像生成模型虽然在分辨率、细节刻画上实现一定突破,但在多行文本渲染、非字母语言(如中文)生成、局部文本插入或文本与视觉元素融合等任务时,仍然表现不佳。

智东西也将关注度颇高的Flux生图模型与Qwen-Image进行对比,在提示词完全一致的前提下,左侧的Flux直接拒绝生成“2025年夏季上映”的中文字样,其画面冲击力也略逊于Qwen-Image。

▲智东西实测电影海报生成,提示词:科幻电影海报标题‘GALAXY INVASION’,金属质感字体带有霓虹光效和破损边缘,背景是太空爆炸,小字标注‘2025年夏季上映’。

其次,在图像编辑方面,编辑结果与原始图像之间的对齐仍面临挑战。首先要保持视觉一致性,例如仅改变发色而不影响面部特征;还需拥有语义连贯性,例如修改人物姿态的同时保持身份和场景的一致。

▲智东西实测图像编辑,提示词为加入宇宙飞船元素,改为2026年夏季上映(左侧为Flux,右侧为Qwen-Image)

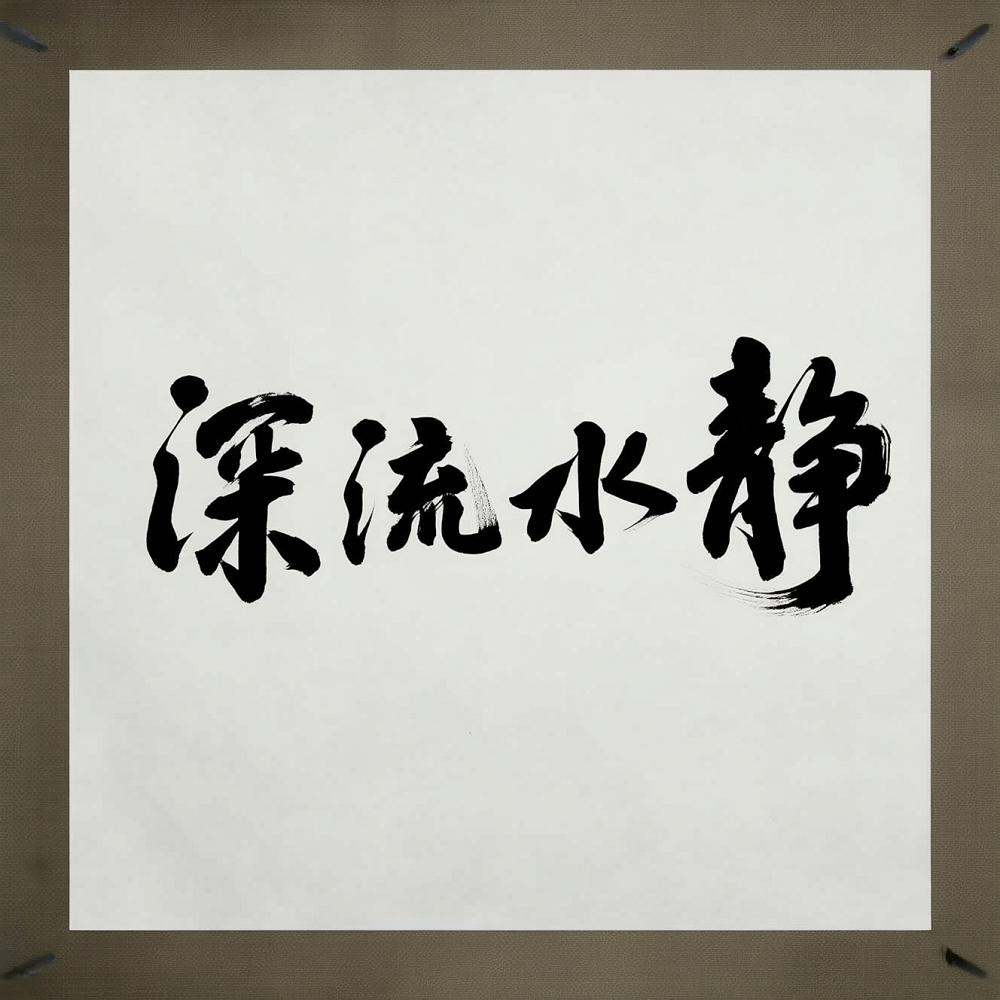

中文书法场景下,智东西让Qwen-Image自主选择了书写的内容和字体,最终的结果如下。

Qwen-Image的架构由三个核心组件构成,三者协同工作,实现文本到图像生成。

Qwen2.5-VL多模态大语言模型(MLLM)作为条件编码器,负责从文本输入中提取特征。

系统提示词要求Qwen2.5-VL详细描述物体和背景的颜色、数量、文字、形状、大小、纹理以及空间关系,来为图像生成提供依据,引导模型生成精细化的潜在表示。

Wan-2.1视频生成模型的分自编码器(VAE)被用于充当Qwen-Image的图像分词器(tokenizer)。

它能将输入图像压缩为紧凑的潜在表示,并在推理阶段将其解码还原。值得注意的是,Qwen团队冻结了Wan-2.1的编码器,仅对图像解码器进行微调,但仍然显著增强了模型的细节表现力。

多模态扩散Transformer(MMDiT)作为主干扩散模型,在文本引导下建模噪声与图像潜在表示之间的复杂联合分布。

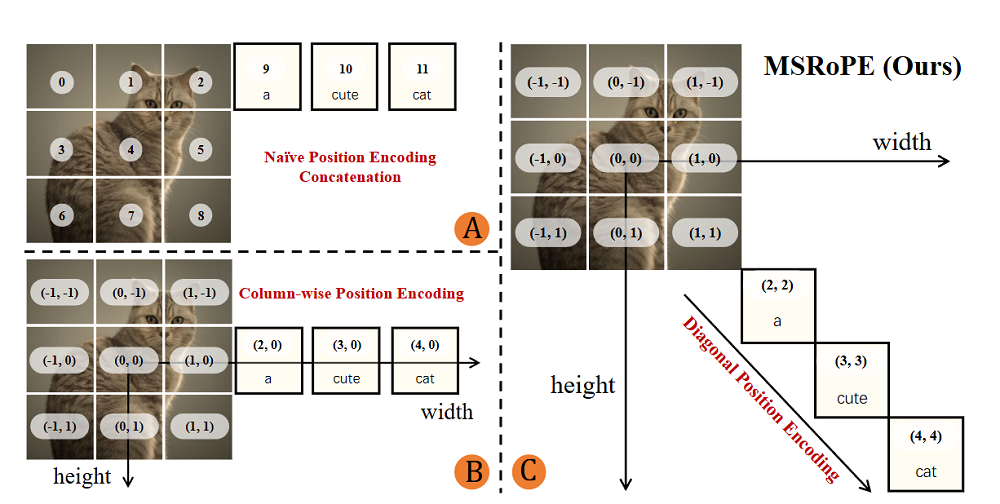

在每个MMDiT中,千问团队引入一种多模态可扩展RoPE方法,能帮助模型在区分图像与文本token的前提下,保持较强的高分辨率图像生成能力,准确生成文字内容。

二、打造数十亿规模数据集,模型“渐进学习”生图能力

架构设计完成后,Qwen-Image通过数据工程、渐进式学习策略、增强的多任务训练范式以及可扩展的基础设施优化,来解决图像生成模型的常见问题。

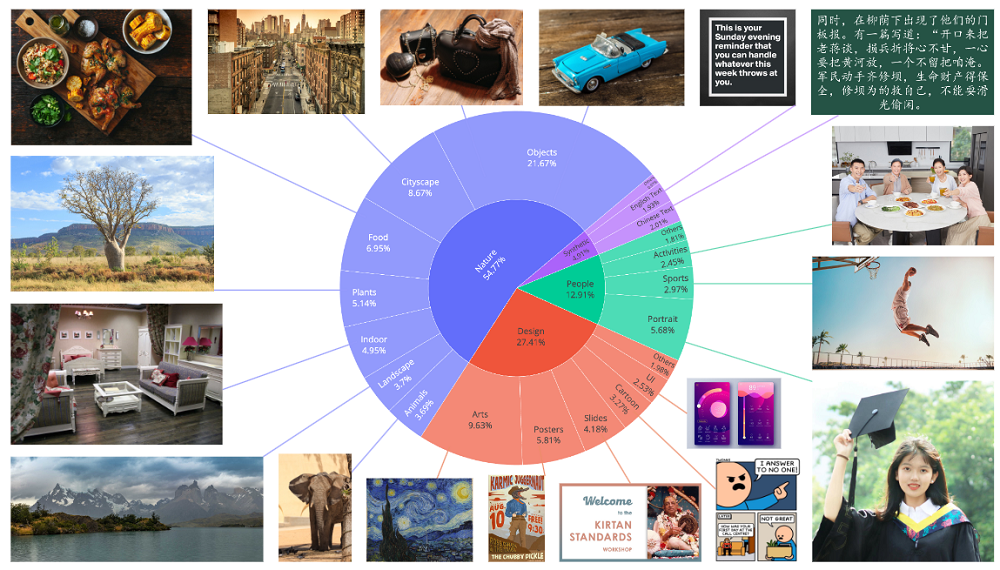

为实现复杂提示对齐,千问团队构建了一套数据处理流程,涵盖大规模数据采集、标注、过滤、合成增强与类别平衡。

数据收集与分类阶段,该团队系统性地收集并标注了数十亿规模的图文对数据,该数据集分为四大核心领域:

(1)自然(55%):涵盖物体、风景、城市、植物、动物、室内、食物等广泛类别,是模型生成多样化真实图像的基础。

(2)设计(27%):包含海报、用户界面、PPT、绘画、雕塑、数字艺术等,富含文本、复杂布局和艺术风格,对提升模型理解艺术指令、文本排版和设计语义至关重要。

(3)人物(13%):包括肖像、运动、人物活动等,用于提升模型生成真实、多样人像的能力。

(4)合成数据(5%):特指通过可控文本渲染技术生成的数据,而非其他AI模型生成的图像。此举避免了AI生成图像带来的伪影、文本扭曲和偏见风险,确保数据可靠性。

拿到原始数据集后,千问团队进行了七阶段渐进式数据过滤,包含初始预训练数据整理、图像质量增强、图文对齐优化、文本渲染增强、高分辨率精炼、类别平衡与肖像增强、平衡的多尺度训练。

进入预训练阶段,Qwen-Image采用课程学习(curriculum learning)策略,从基础的文本渲染任务起步,逐步过渡到段落级和布局敏感型描述的生成。这一方法显著提升了模型对多样化语言的理解与生成能力,尤其在中文等表意文字语言上表现突出。

这种渐进式的学习方式体现在多个方面。

分辨率上,Qwen-Image从256p开始,逐步提升至640p和1328p,使模型由浅入深地学习从整体到细节的视觉特征。

数据质量也渐进提升,初期使用大规模数据快速建立基础能力,后期引入更严格的数据过滤,使用高质量、高分辨率数据进行精炼。

文本渲染能力逐步增强,先训练无文本的通用图像生成,再逐步加入含文本(尤其是中文)的图像,专门强化文本渲染能力。

数据分布上,不同领域(自然、设计、人物)和不同分辨率的数据比例会根据训练情况调整,防止过拟合。

在图像编辑方面,Qwen-Image支持风格迁移、增删改、细节增强、文字编辑,人物姿态调整等多种操作。

三、多任务框架统一生成、编辑,20万+次对决后跻身竞技场前三

图像生成模型的训练对基础设施提出了更高的要求,为应对模型巨大的参数量和数据量,千问团队设计了高效的分布式训练框架。

这一框架中包含生产者与消费者(Producer-Consumer)。

生产者负责所有数据预处理,包括数据过滤、MLLM特征提取和VAE编码。处理后的数据按分辨率存入高速缓存。

消费者部署在GPU集群上,专注于模型训练。通过专用的HTTP传输层,消费者能异步、零拷贝地从生产者拉取预处理好的批次。

这一框架解耦了吞吐密集型的预处理和计算密集型的训练,极大提升了GPU利用率和整体吞吐量,且支持数据管道的在线更新。

千问团队还采取了混合并行策略,结合数据并行与张量并行,在多头注意力模块中采用“头并行”(head-wise parallelism)以减少通信开销。

预训练后,该团队通过监督微调(SFT)和强化学习(RL)进一步提升Qwen-Image的生成质量,并对齐人类偏好。

监督微调阶段构建了一个分层组织的高质量数据集,所有样本均经过人工精标,强调图像清晰度、细节丰富性、亮度表现和照片级真实感,用以引导模型输出更高品质的视觉内容。

随后引入强化学习进一步优化生成偏好,主要采用直接偏好优化方法:对同一提示生成多个候选图像,由人工标注出最优与最差样本,DPO损失函数基于流匹配框架,通过比较模型对“好”与“坏”样本在速度预测上的差异来更新参数。

在此基础上,Qwen-Image进一步应用组相对策略优化(GRPO)进行细粒度调优,在每组生成结果中依据奖励模型打分计算优势函数,并据此调整策略;为增强探索能力,GRPO在采样时采用随机微分方程(SDE)替代传统的ODE。

Qwen-Image还通过一个统一的多任务框架,支持文本到图像(T2I)和图文到图像(TI2I,即图像编辑)等多种生成模式。对于图像编辑任务,用户提供的参考图像会经由Qwen2.5-VL处理,画面由视觉Transformer(ViT)编码,并与文本标记(text tokens)拼接,形成输入序列。

这一过程中,Qwen2.5-VL会描述输入图像的关键特征(颜色、形状、大小、纹理、物体、背景),然后解释用户的文本指令应如何改变或修改该图像。Qwen-Image会生成一张符合用户要求的新图像,同时在适当的情况下保持与原始输入图像的一致性。

为了使模型能够区分多张图像,千问团队在原有用于定位单张图像内图像块的高度和宽度基础上,进一步扩展了MSRoPE,引入了一个额外的“帧(Frame)”维度,进一步增强了模型保持视觉保真度以及与用户所提供图像在结构上保持一致的能力。

千问团队用大量定量与定性实验,验证了Qwen-Image在生成和编辑两方面的能力。

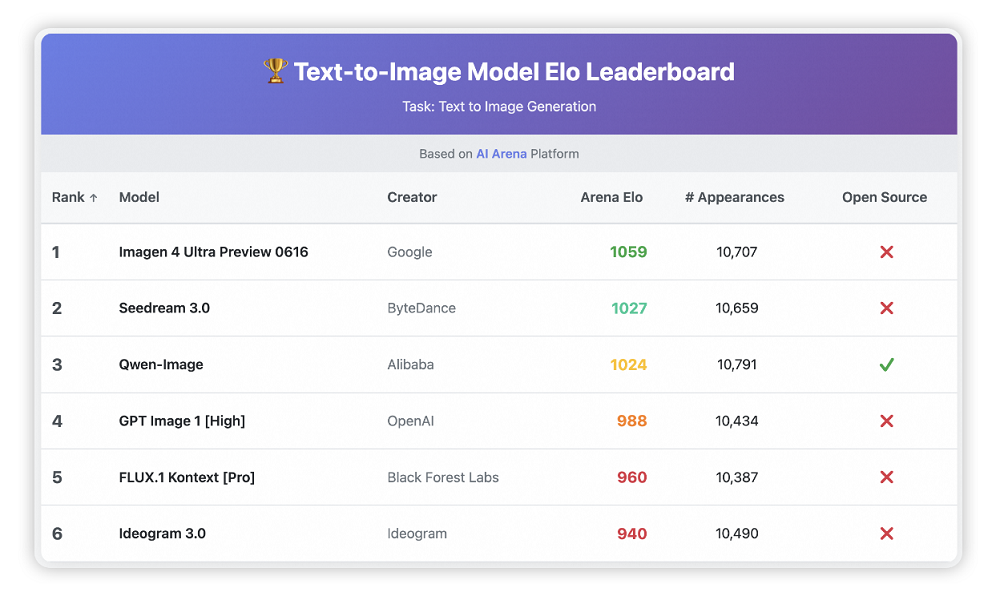

在5000条提示、20万+次匿名对决的AI Arena中,Qwen-Image作为唯一开源模型跻身前三,领先GPT Image 1、FLUX.1 Pro等30分以上。

在其主打的中文文字生成场景,Qwen-Image单字渲染准确率达到58.3%。

图像编辑任务上,Qwen-Image在GEdit、ImgEdit等榜单获得第一,深度估计与零样本新视角合成也能与闭源模型持平或更好。

技术报告中还展现了这一模型与其他模型的生成效果对比。可以看到,在书店橱窗的案例中,Qwen-Image在书籍封面与文字的搭配上做得不错。

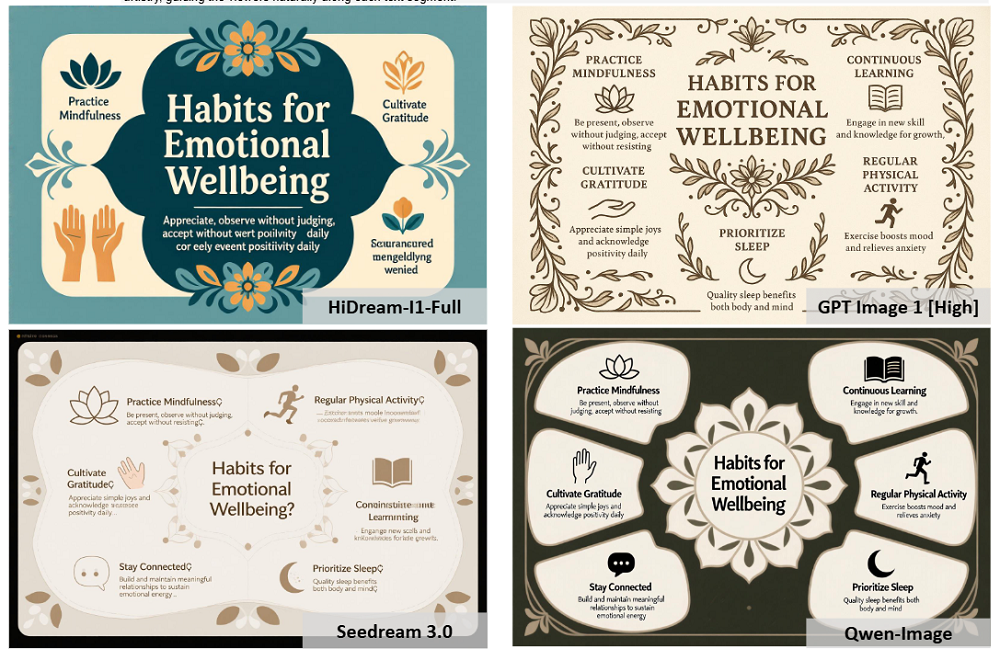

复杂英文文本渲染上,左侧两款模型已经出现不同程度的乱码,右侧的GPT Image 1(High)和Qwen Image没有出现类似问题。

在图像编辑类任务上,其他三款模型都未能准确展现出提示词中要求的冰箱贴质感,而Qwen-Image的结果无论从颜色还是形状来看,都较为符合提示词要求。

结语:阿里持续开源图像模型,可用性进一步提升

今年6月,阿里已经开源了Wan 2.1图像生成模型,提供最大14B的版本。本次的Qwen-Image将参数量进一步提升至20B,模型可用性进一步提升。

Qwen-Image凭借对文本生成、图像编辑等功能的针对性提升,已经具备了海报制作、PPT生成、精准图像编辑等能力,这些能力对图像生成技术走入真实生产场景有较大意义。