作者 | 王涵

编辑 | 漠影

智东西8月7日报道,今天上午,通义千问Qwen宣布推出两款更小尺寸的新模型:Qwen3-4B-Instruct-2507和Qwen3-4B-Thinking-2507。

其中,Qwen3-4B-Thinking-2507的推理能力可媲美中尺寸模型;Qwen3-4B-Instruct-2507在知识、推理、编程、对齐以及agent能力上全面超越了闭源的小尺寸模型GPT-4.1-nano。

此次发布的“2507”版本的Qwen3-4B模型对手机等端侧硬件部署较为友好,目前已在魔搭社区和Hugging Face正式开源。

▲已在Hugging Face开源(来源:Hugging Face)

一、性能比肩中尺寸模型,agent能力超越GPT-4.1-nano

Qwen3-4B-Instruct-2507与Qwen3-4B-Thinking-2507的上下文理解能力都扩展到了256K,可处理长文本,能支持更复杂的文档分析、长篇内容生成以及跨段落推理等场景。

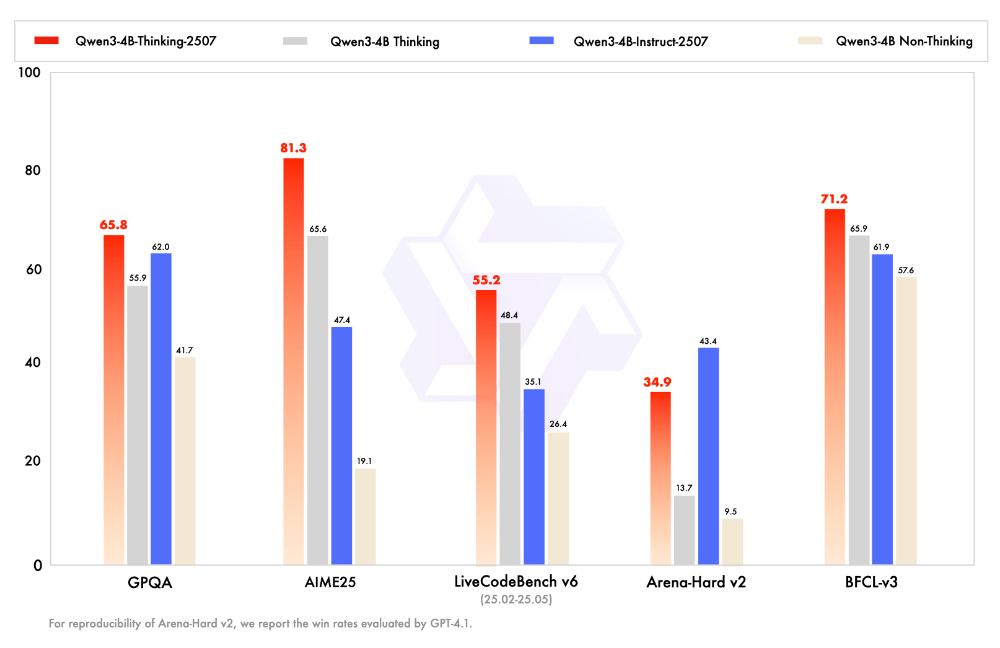

性能方面,Qwen3-4B-Thinking-2507在复杂问题推理能力、数学能力、代码能力以及多轮函数调用能力上的表现大幅领先Qwen3同尺寸小模型。在Arena-Hard v2基准测试上,Qwen3-4B-Instruct-2507取得43.4分的成绩,更胜一筹。

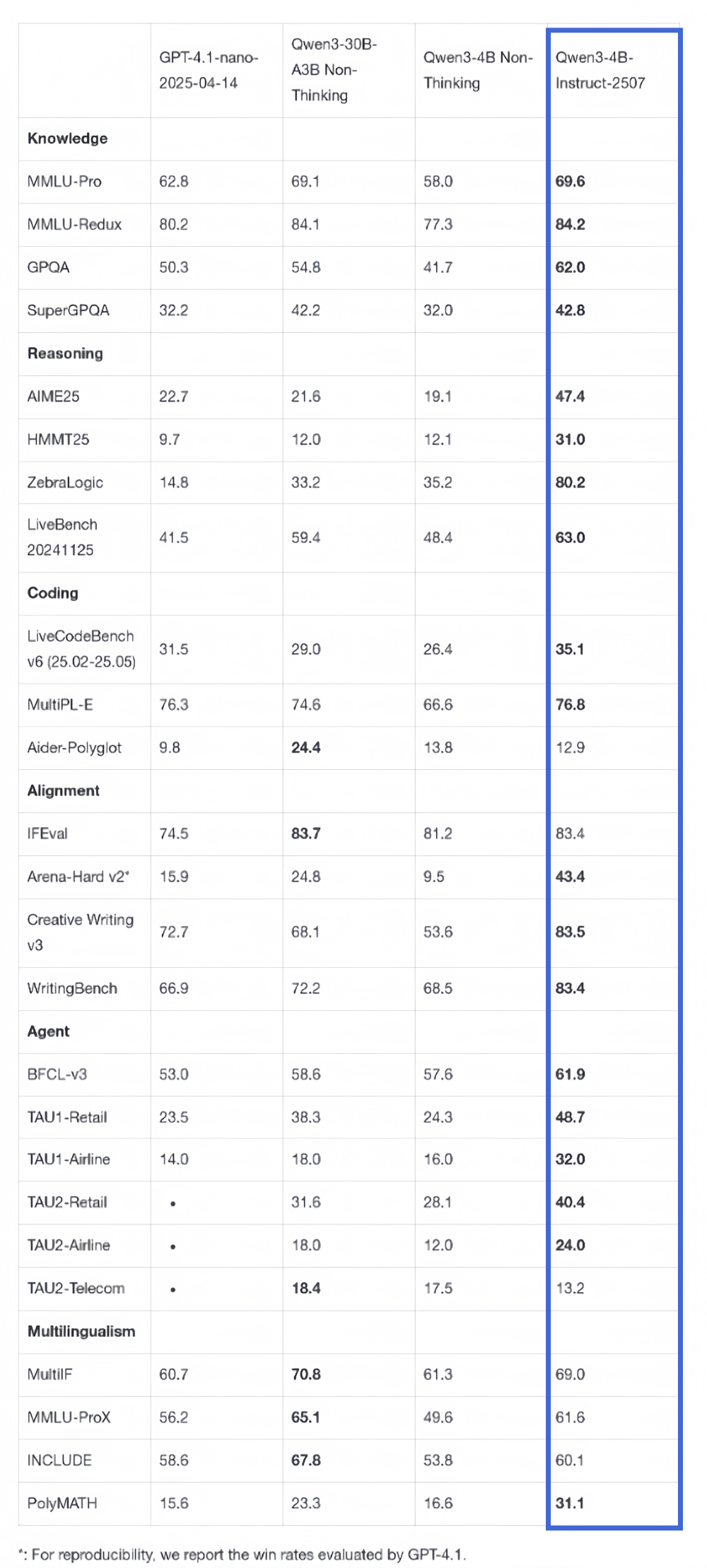

在非推理领域,Qwen3-4B-Instruct-2507在知识、推理、编程、对齐以及agengt能力上全面超越了闭源的小尺寸模型GPT-4.1-nano,且与中等规模的Qwen3-30B-A3B(non-thinking)性能接近。

该模型覆盖了更多语言的长尾知识,在主观和开放性任务中与人类偏好的对齐性增强,能够提供更符合需求的答复。

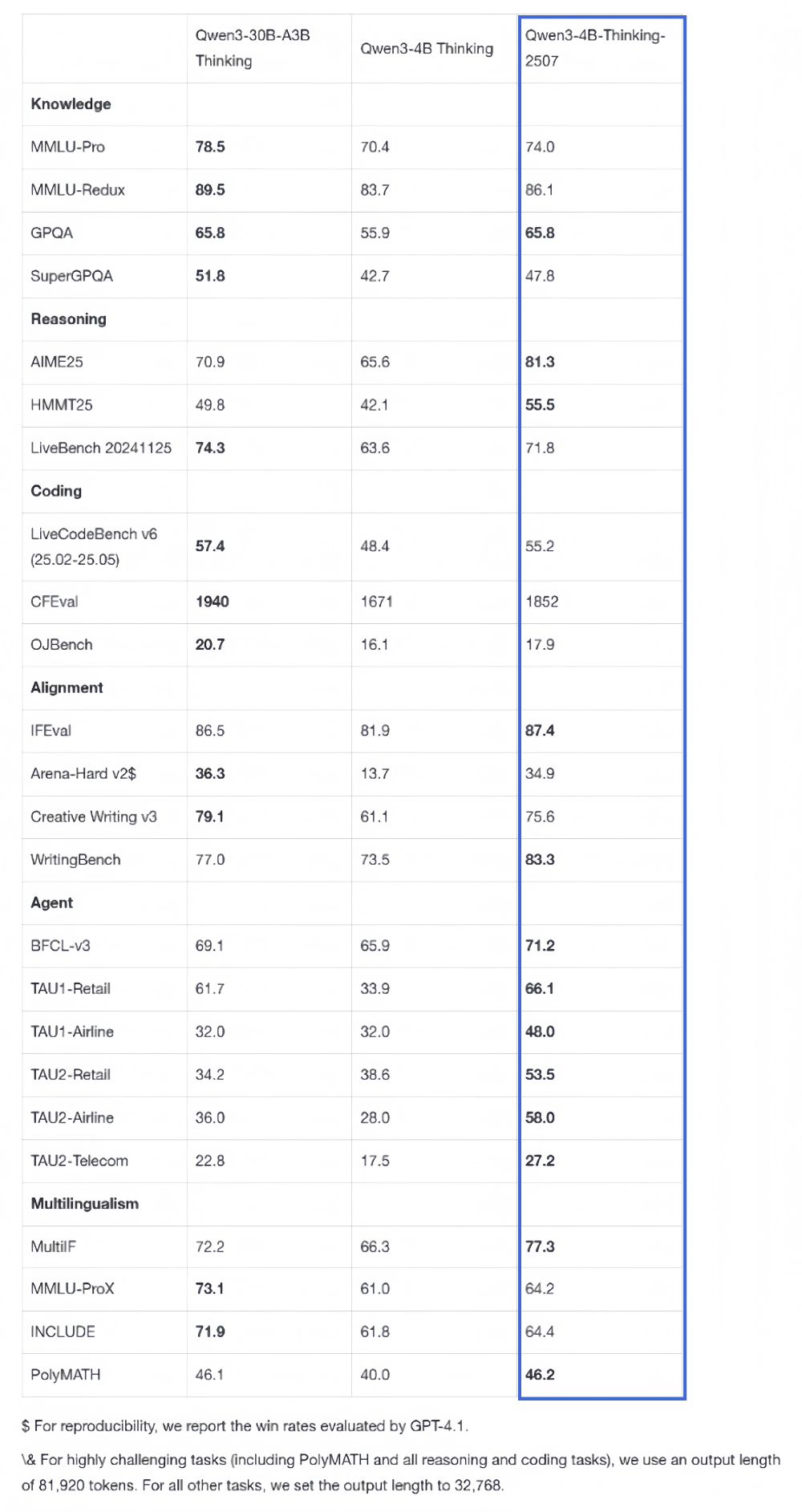

在推理领域,Qwen3-4B-Thinking-2507表现突出,推理能力可媲美中等模型Qwen3-30B-Thinking。特别是在聚焦数学能力的AIME25测评中,以4B参数量取得了81.3分的成绩。

其通用能力也显著提升,Agent分数超越了更大尺寸的Qwen3-30B-Thinking模型。

结语:小尺寸模型加速AI端侧落地

通义千问此次推出的Qwen3-4B系列新模型,以更小的尺寸实现了性能上的优化,在通用能力上展现出超越同级别模型甚至逼近中大规模模型的实力,并且,小尺寸模型展现出了对端侧硬件的更高的友好度。

无论是腾讯、阿里还是OpenAI等AI老玩家,都开始推出小尺寸模型,并且在agent能力上下功夫。这在一定程度上反映出目前主流市场认为小型语言模型(SLM)对Agentic AI的发展具有重要价值。

这类高性能小模型的开源与普及,将有望加速AI技术在端侧设备的渗透,进而推动更多轻量化、场景化的智能应用落地。