炒股就看金麒麟分析师研报,权威,专业,及时,全面,助您挖掘潜力主题机会!

(来源:极客公园)

当 AI 不再抢手机,手机 Agent 可能就真正可用了。

作者|连冉

编辑|郑玄

8 月 18 日,智谱正式发布了新的 ToC 产品 AutoGLM 2.0——一个手机通用 Agent。

3 月份发布的 AutoGLM,在操作任务时,“人只能看着,没有其他选择,也不能做其他事情”。这种本地“抢屏”的方案导致了人与机器“二选一”的局面。

比如要用一个 Agent 在手机上点一杯咖啡,用户能做的就是“看着”,等它完成任务。这种模式让 AI 带来的整体效率提升被限制在 1.x 倍的范围内,并不能实现生产力的倍增。

现在,当 AutoGLM 再次进入公众视野,情形已有所不同。在 2.0 版本的 AutoGLM 上,每位用户都将拥有一部云手机与一台云电脑,只需一句指令,Agent 便可在云端自动执行操作、跨应用协作,并完成整套任务。

这意味着 AI 可以 7x24 小时在云端独立“打工”,不再干扰前台操作,人与 AI 的协作范式,也正从“你盯着我干”的同步模式,更新为“你忙你的,我干我的”的异步并行模式。

当 AI 拥有了独立行动的“身体”和“工位”,一个新的、由 Agent 驱动的并行数字世界,似乎正在打开。

01

从“抢屏”到“云端分身”

先回到那个核心痛点。过去,无论是 AutoGLM 的早期版本,还是其他类似的尝试,AI 的每一步操作,都实时反映在用户的物理屏幕上。这种“抢屏”模式带来了几个障碍:

首先是效率问题,AI 工作时,人必须等待,人机之间是“二选一”的互斥关系。这使得总效率提升有限,并没有达到理想中的生产力倍增。

其次是执行中断的可能,锁屏、网络波动、切换应用等任何用户行为都可能中断 Agent 的长任务流。AI 难以在用户非关注时段(如睡眠、娱乐时)持续工作,其价值被大打折扣。

最后还有适配的难题,安卓系统的碎片化,让本地适配成本居高不下。每一个手机品牌、每一个系统版本,都可能影响 Agent 的稳定运行。

AutoGLM 的新方案是用“云端原生”取代“本地镜像”。它为每个用户在云端部署了一个完整的安卓环境(云手机)和一个 Linux 环境(云电脑,后续将支持 Windows)。

当用户下达指令,例如“去美团找附近的奶茶店,点 20 杯,记得用优惠券”,整个任务流——从打开 App、跳过广告、搜索店铺、选择商品、连续点击增加数量,到智能选用优惠券——这些都是在那台云端手机上运行。

而用户的物理手机则依旧自由。用户可以继续聊天、看视频,或者息屏把它放进口袋。AI 的工作与用户的操作在物理上完全解耦,互不干扰。用户只需在任务列表中查看进度,并在支付、发布等关键节点回来“确认”一下即可。

在智谱的闭门交流会上,产品负责人刘潇现场演示了这一核心体验。当他用一台 iPhone 向 AutoGLM 下达运营小红书的任务——“制作并发布一个介绍 AutoGLM 的视频,风格要适配自媒体”,Agent 在云端开始了高效工作。它高并发地搜索了十几个关键词,快速浏览多个网页,随后完成了信息收集和文案撰写,并自动开始制作视频。

而在此期间,刘潇又在云手机上演示了点奶茶和“在抖音刷到小猫视频为止”的娱乐任务。

据官方介绍,AutoGLM 目前已能在云端操作包括抖音、小红书、美团、京东在内的超过 40 款高频应用。

这背后是智谱对未来人机协作关系的洞察。智谱 CEO 张鹏在会上分享了一个观点:未来个人竞争力的核心,将是“自身能力 + N 个 AI 智能体”的总和。每个人都将从“打工者”转变为“领导者”,核心能力不再是事必躬亲地执行,而是“会沟通、会安排任务、会指挥”。

AutoGLM 的云端架构,是这一理念的产品化落地。它让 AI 开始成为了一个可以 7x24 小时并行工作的“数字员工”,打破了“AI 必须在你眼皮底下操作”的障碍,让用户可以将那些耗时、重复、甚至超出自己能力范围的任务,“外包”给这个云端分身。

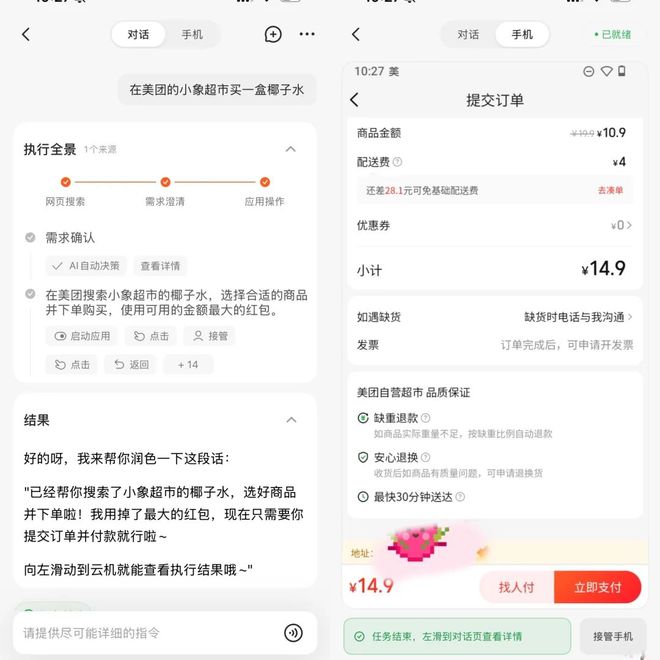

在实际操作中,我试了一下用 AutoGLM 在美团小象超市买一盒椰子水,发起任务前,需要先接管云机-登录任务涉及的 app 账号-退出接管-正常发起任务,以及在支付环节也需要手动操作,其他则确实是可以自动完成,并且在任务启动前还会自己润色需求,自己加上了“用掉红包”,但就是速度堪忧,还不如自己拿手机点来的快。

图片来源:极客公园

图片来源:极客公园随后,我又在电脑上尝试了一个任务“在知乎热榜第一的话题下回答问题”,中间可能是因为出现了一个是否执行操作的确认点没及时确认,所以自动重启了任务,所以当我从别的页面切回去时,看到的就是下面这个情况。

图片来源:极客公园

图片来源:极客公园在我接管电脑确认了操作点之后,可以看到 AutoGLM 进行了一番执行:

图片来源:极客公园

图片来源:极客公园这个任务执行的就有点……

指令是“在知乎热榜第一的话题下回答问题”,结果只是找到知乎热榜第一的话题,然后停留在话题下就算完成任务,并没有“回答”这个操作。

或许是指令不够详细?于是我更新了一下指令,换成“找到知乎热榜第一的话题,并针对问题写 200 字的回答,写完之后直接发布”,新开了一个任务。

这次确实写了回答,但是由于系统连接限制,还是得手动提交回答:

图片来源:极客公园

图片来源:极客公园这是它写的两百字回答:

还有一个问题是,有一些用户在使用 AutoGLM 发布小红书内容时,遇到了会被强制下线、被锁机器码等情况,可能是触发了风控。

02

驱动 Agent 的“3A 原则”与“在线强化学习”

如果说“云手机/云电脑”是 AutoGLM 的新“身体”,那么其背后强大的模型、训练方法论和产品原则,则是这具身体得以高效运转的“大脑”。

在与团队的交流中,极客公园了解到 AutoGLM 的产品哲学可以被提炼为“3A 原则”。

这三大原则,共同构成了 AutoGLM 对一个成熟 Agent 形态的定义,也解释了其当前产品架构。

过去,许多 Agent 的训练依赖于监督微调(SFT),即学习人类专家的操作轨迹。这种方法的弊端是“泛化能力差”——AI 只会模仿它见过的操作,对于未见过的场景或界面改动,往往束手无策。

为了让 Agent 在复杂多变的真实环境中(数千个并发的手机、电脑、浏览器环境)真正具备完成任务的能力,AutoGLM 团队选择了端到端在线强化学习的技术路线。

其核心思想是,在经过少量专家数据“冷启动”后,让模型在数千个并行的真实云环境中,像人类一样去“试错”。系统不再告诉模型“下一步该点哪里”,而是只在任务最终完成时给予一个“成功”的奖励信号(Reward)。

模型必须自己探索出最优的决策路径。

这对工程的挑战是巨大的,需要一个能同时调度和监控数千台云电脑、云手机的庞大系统。

在具体的技术实现上,智谱进一步披露了其在强化学习方面的多项突破成果:例如在电脑端,提出了 API-GUI 协同范式以提升数据多样性(ComputerRL);在移动端,则创新了难度自适应强化学习方法,以提升复杂任务的稳定性(MobileRL);同时通过交叉采样等机制,解决了多任务训练中的不稳定问题(AgenRL)。

这些具体的技术创新,共同构成了 AutoGLM 在复杂环境中高成功率的底层保障。

据智谱披露,通过在线强化学习,AutoGLM 的任务成功率相较于冷启动阶段提升了 165%,超过 66% 的成功率增益来源于此。

“我们发现,只要能提供足够好的‘环境(Environment)’和‘奖励(Reward)’,现有算法几乎可以优化任何任务,”刘潇分享道,“瓶颈已经不在算法本身,而在于如何构建可规模化的验证和反馈环境。”

这种“模型即 Agent”的理念,也体现在其底座模型上。GLM-4.5 和 GLM-4.5V 从预训练阶段开始,就为 Agent 任务进行了深度优化,被称为“Agentic Language Model”。

从底层开始的原生设计,使得 AutoGLM 在多个公开基准测试中表现出色。比如,在考察电脑操作能力的 OSWorld Benchmark 中,AutoGLM 获得 48.1 分,超越了 ChatGPT Agent 和 Anthropic 的模型。

技术路线的先进性,带来了商业可行性上的巨大突破——成本下降。

传统基于第三方大模型 API 构建的 Agent,单次复杂任务(如 Deep Research)的成本高达 3-5 美元。而 AutoGLM 借助自研模型和一体化架构,将包含模型调用和虚拟机资源的单次任务成本,压缩到了约 0.2 美元(约 1.5 元人民币)。这已经与谷歌单次搜索约 0.02 美元的成本相差不到一个数量级。

这种数量级的成本降低,让智谱有底气在此次发布中不用邀请码,直接向所有 C 端用户开放。

成本降低,成为超级应用的潜力才能上升。

03

“工具”到“生态”

通过为 Agent 提供独立的云端运行环境和基于 GLM-4.5/4.5V 的模型能力,AutoGLM 的定位超越了单一的效率工具,开始构建一个连接多设备和服务的生态。

首先,是产品能力的纵深。除了已经展示的跨应用操作,AutoGLM 的云电脑目标是支持 Office、Photoshop 等更专业的生产力工具。

同时,即将上线的“定时任务”功能,也会是 AI 从“被动响应”迈向“半主动规划”的关键一步。想象一下,“每天早上 9 点,自动总结老板的未读邮件并发送摘要到我微信”,“工作日上午 10 点,自动在多平台比价下单我常喝的咖啡”,相当于半个秘书。

其次,是对硬件生态的赋能。目前的 AI 硬件,如智能眼镜、Pin 类设备,普遍面临算力、续航和交互的“不可能三角”。

在微型设备上堆叠重系统和大电池,体验往往不尽人意。AutoGLM 提出的解法是,让这些端侧硬件“轻量化”,只负责感知和发起指令,而将复杂的应用操作和任务执行全部交由云端的 Agent 完成。

交流会上展示的创意案例体现了这一点:连接了体重秤,当检测到用户体重超过 70kg 警戒线时,会自动触发云端 Agent 下单代餐;连接了气体传感器,当检测到鞋柜中氨气/硫化氢浓度超标时,则会自动下单除臭脚垫。

这展示了一条相对完整的“物理传感器 → 云端 Agent → 现实世界服务”的链路,让 Agent 实现了对物理世界的连接和操作。

通过开放 API 和开发者计划,AutoGLM 正在试图让“万物皆可 Agent”。

为了加速这一进程,智谱上线了“AutoGLM 移动端 API 申请通道”及“开发者生态共建计划,开发者可以申请将 AutoGLM 的云端执行能力封装进自己的硬件或软件产品中。

最后,传统互联网的流量天花板,是用户的“注意力上限”——一天只有 24 小时,用了这个 App,就没时间用那个。

Agent 创造了一种新的流量形态:并行且由需求驱动。当你只有一个单线程的注意力时,可以派出无数个并行的 Agent,帮你研究旅行攻略、对比全网物价、筛选工作资料。

这种由 AI 代理人类去使用服务的模式,可能会极大地扩充整个互联网的有效流量池。而且,这种流量是带着明确“成交意图”的高质量流量,商业价值相对更高。

从另一个角度看,Agent 单任务平均超过 256k tokens 的消耗,也对上游的推理基础设施提出了 32 倍于传统对话场景的需求和价值密度。

在分享会的结尾,刘潇提出了一个关于 AGI(通用人工智能)的阶段性定义,他称之为“AGI 的下限”。

当一个 Agent 能自主稳定地运行一整天(24 小时),作为你的同事或秘书,协同完成工作与生活任务,使你的综合效率提升超过 2 倍时,AGI 的曙光初现。

AutoGLM 的这次进化,或许离这个“下限”还有距离。它仍处于早期形态,对指令的理解还很初级,也存在一些 Bug。但通过构建“云端分身”这一核心架构,它确实开始在为 Agent 的“独立行走”铺平道路。

从同步操作转变为异步委托,或许是人机协作范式的转变的开始,未来的个人竞争力可能取决于“自身能力+N 个 AI 智能体”的模式,用户通过下达指令,让多个 AI 并行完成任务,从而根本性地改变个人处理日常与工作事务的方式。

更理想化一点,也许,一个你只需动动嘴,就有无数个数字分身为你打理数字世界的未来正在展开。

*头图来源:极客公园

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

极客一问

你如何看待智谱 AutoGLM 2.0?