刚刚,AI医疗新突破,来自谷歌!

这一次,他们直接瞄准了真实临床环境的痛点。

长期以来,医疗模型就像是一个“偏科生”,它擅长“读病历”,却对CT、MRI、病理切片这些医学影像“力不从心”。

这是因为,它们被迫用文本逻辑去理解图像,导致效率低、错误多、成本高。

为此,谷歌祭出了最新模型MedGemma 1.5,找到了破局答案。

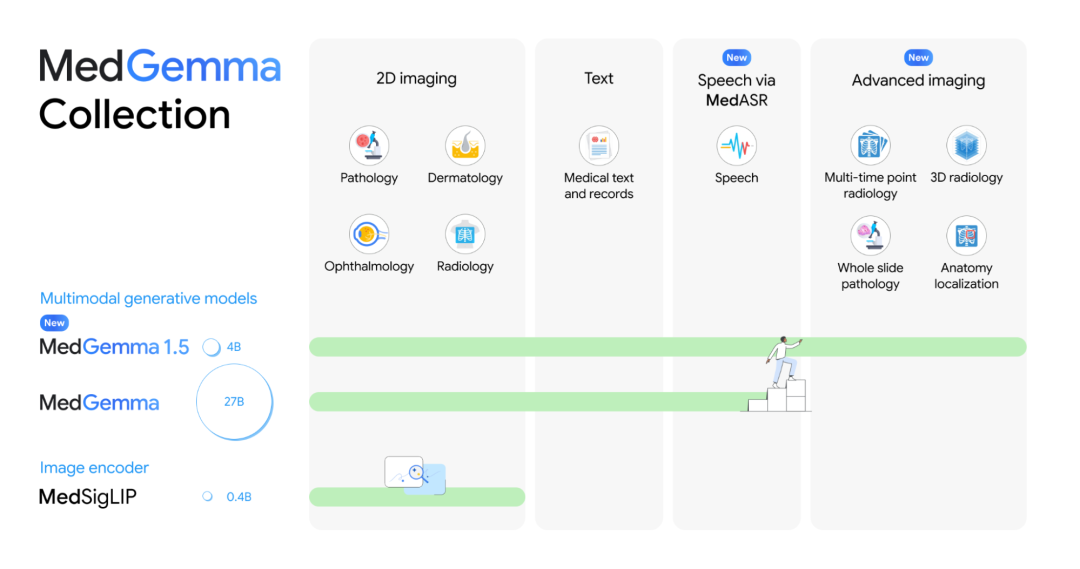

相较于此前的MedGemma 1.5,MedGemma 1.5在多模态应用上实现重大突破,融合了:

高维医学影像:计算机断层扫描(CT)、磁共振成像(MRI)和组织病理学。

纵向医学影像:胸部X光时间序列回顾。

解剖定位:胸部X光片中解剖特征的定位。

医学文档理解:从医学实验室报告中提取结构化数据。

谷歌表示,MedGemma 1.5是首个公开发布的开源多模态大语言模型,既能够解读高维医学数据,同时还拥有解读通用二维图像和文本的能力。

更关键的是,MedGemma 1.5只有40亿参数量,这意味着,普通的消费级显卡甚至高性能工作站,就能流畅运行。

不仅如此,谷歌还发布了MedASR,一个专门为医疗语音微调的语音识别模型,可以将医生与患者的对话转化为文本,并无缝接入到MedGemma。

直白讲,MedGemma 1.5解决“怎么看图”,MedASR解决“怎么听音”。

这并不是简单的模型迭代,而是谷歌对“如何让AI真正走进诊室”给出的一套体系化答案。

一个读得透病历、看得懂影像、听得清语音的AI医生,即将走进每一家医院。

AI医疗,进入多模态时代

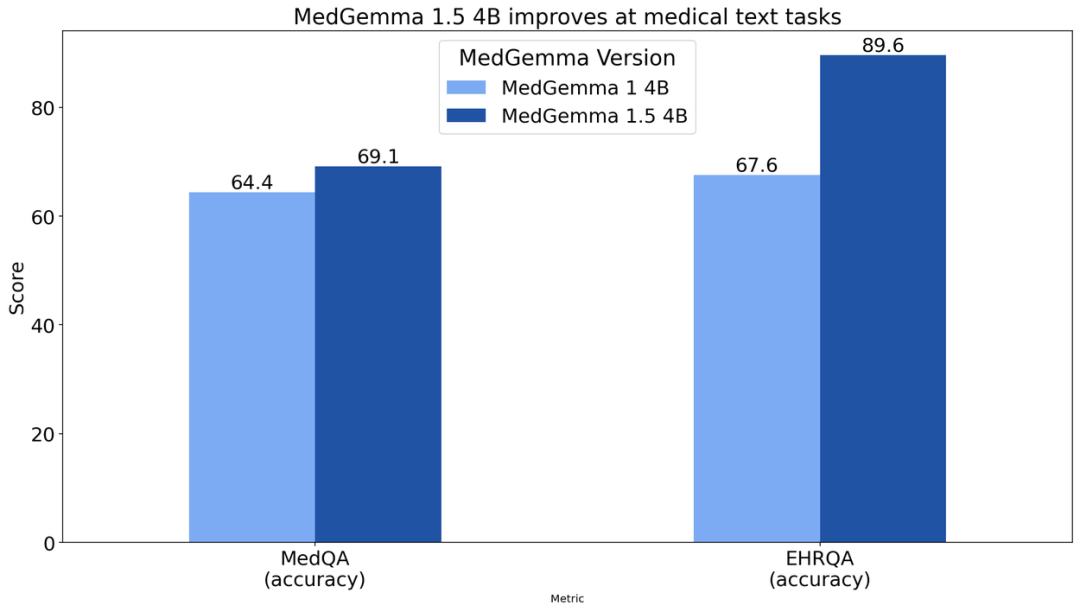

在过去的一年里,我们见证了GPT-5等模型在医学考试中的惊艳表现,但在真实的临床场景中,它们的表现往往不尽如人意。

一个重要的原因在于信息维度的断层。

包括初代MedGemma在内的很多医疗模型本质是“文字专家”,对于图像的理解能力不强,带来了诊断信息的丢失。

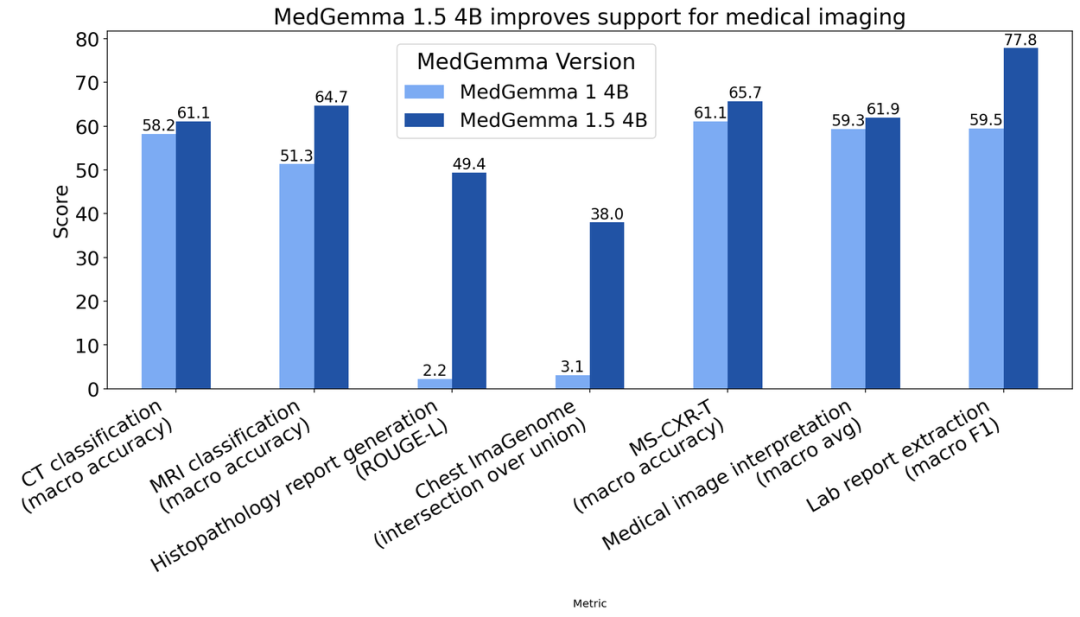

MedGemma 1.5则在医学影像应用场景中实现了全方位、多维度的性能跃升,显著超越其前代模型。

针对高维医学影像,MedGemma 1.5做到了:

CT疾病分类准确率从58%提升至61%。

MRI疾病分类准确率从51%提升65%,尤其在脑部、关节等复杂解剖结构识别上进步显著。

全切片病理描述质量ROUGE-L分数从近乎无效的0.02提高到0.49,达到专用模型PolyPath的水平(0.498),可生成临床可用的组织学描述。

图:MedGemma 1.5在医疗影像上的性能提升

针对纵向时序影像分析,MedGemma 1.5做到了:

在MS-CXR-T 时序评估基准上,宏观准确率从 61% 提升至 66%。

有效捕捉病灶动态变化,例如判断肺炎浸润是否吸收,支持随访决策。

针对通用2D医学图像解读,MedGemma 1.5做到了:

在内部综合单图基准(涵盖X光、皮肤、眼底、病理切片)上,整体分类准确率从59% 提升至 62%。

表明模型在保持广泛2D能力的同时,未因新增高维任务而牺牲基础性能。

针对结构化医学文档,MedGemma 1.5做到了:

从非结构化PDF或文本中提取检验项目、数值、单位的宏平均F1分数从60%提升至78%(+18%)。

自动构建结构化数据库,打通影像-文本-检验多源信息融合分析的最后一环。

图:MedGemma 1.5在文本任务上的性能提升

与此同时,传统的语音识别(ASR)模型在面对生僻医疗术语时,也表现得像一个完全没受过医学教育的外行,极高的词错率让AI录入变成了医生的负担。

而新发布的自动语音识别模型MedASR针对医疗进行了微调,错误率大大减少

研究人员将MedASR的性能与通用ASR模型Whisper large-v3进行了对比。

发现MedASR在胸部X光口述错误率上降低了58%,在不同专科之间的口述中错误减少82%。

万亿谷歌,押注AI医疗

谷歌在医疗健康领域的布局十分深入,其技术触角已延伸至行业各个角落。

投资上,谷歌通过旗下风险投资及其私募股权部门投资了许多生命科学公司。

其中,AI制药成为谷歌偏爱的重点领域,在Google Ventures在2021年51笔医疗健康领域投资中,对于药物研发的投资就达到28笔,超过半数。

合作层面,凭借业内领先的人工智能、云计算等服务,谷歌近年来与拜耳、辉瑞、施维雅、梅奥诊所等药企和医院达成协议,探索从药物研发到临床诊疗的智能解决方案。

在内部,谷歌除了Google Health外,还有包括Verily、Calico在内专注于不同领域的业务单元,形成多元化的强大矩阵。

尤其是,作为全球顶尖的人工智能研究机构,GoogleDeepMind推出多个具有重要意义的科学模型,包括AlphaFold(蛋白质结构)、AlphaGenome(DNA调控)、C2S-Scale(单细胞)等。

DeepMind的CEO,Demis Hassabis,就因为在AI蛋白质结构预测上的贡献获得了2024年诺贝尔化学奖。

近年来,在大语言模型的潮流下,谷歌也开发了多款用于医疗保健的垂类大模型。

这些模型不仅能够帮助医生更精准地诊断疾病,还能为患者提供个性化的健康建议。

谷歌团队首先研发了Flan-PaLM,这一模型挑战了美国医学执照考试(USMLE),取得了67.6%的成绩,比此前最好的模型提高了17%。

之后,谷歌发布了Med-PaLM,该成果登上了Nature,经过专业临床医生评判,Med-PaLM对实际问题的回答准确率与真人相差无几。

2023年,全球首个全科医疗大模型Med-PaLM M发布,其在14项测试任务(问题回答、报告生成和摘要、视觉问题回答、医学图像分类和基因组变体调用)中均接近或超过现有SOTA。

去年,谷歌首席健康官Karen DeSalvo博士宣布了六项进展,包括AI制药模型TxGemma、获得FDA批准的手表脉搏停止检测功能、多智能体系统“AI联合科学家”、儿科个性化癌症治疗模型等。

从医学影像到药物研发,从健康助手到可穿戴设备,谷歌正在重新定义未来医疗。