智通财经APP获悉,2月10日,腾讯混元正式推出一款面向消费级硬件场景的“极小”模型HY-1.8B-2Bit,等效参数量仅有0.3B,内存占用仅600MB,比常用的一些手机应用还小。通过对此前混元的小尺寸语言模型——HY-1.8B-Instruct进行 2 比特量化感知训练(QAT)产出,这一模型对比原始精度模型等效参数量降低了6倍,并且在沿用原模型全思考能力同时,在真实端侧设备上对比原始精度模型生成速度提升2—3倍,可大幅提升使用体验。

此次腾讯混元推出HY-1.8B-2Bit模型,可以在边缘设备上无压力部署。这也是首个在实现2bit产业级量化的端侧模型实践。此外,HY-1.8B-2Bit模型还沿用了Hunyuan-1.8B-Instruct的全思考能力,用户可以灵活使用,为简单的查询提供了简洁的思维链,为复杂的任务提供了详细长思维链,用户可以根据其应用的复杂性和资源限制灵活地选择这两种模式。

腾讯混元还通过数据优化、弹性拉伸量化以及训练策略创新三个方法来最大限度的提升HY-1.8B-2Bit的全科能力。

部署方面,腾讯混元提供了HY-1.8B-2Bit的gguf-int2格式的模型权重与bf16伪量化权重,对比原始精度模型,HY-1.8B-2Bit实际模型大小直降6倍,仅有300MB,能够灵活用于端侧设备上。该模型也已在 Arm 等计算平台上完成适配,可部署于启用 Arm SME2 技术的移动设备上,并实现高效运行。

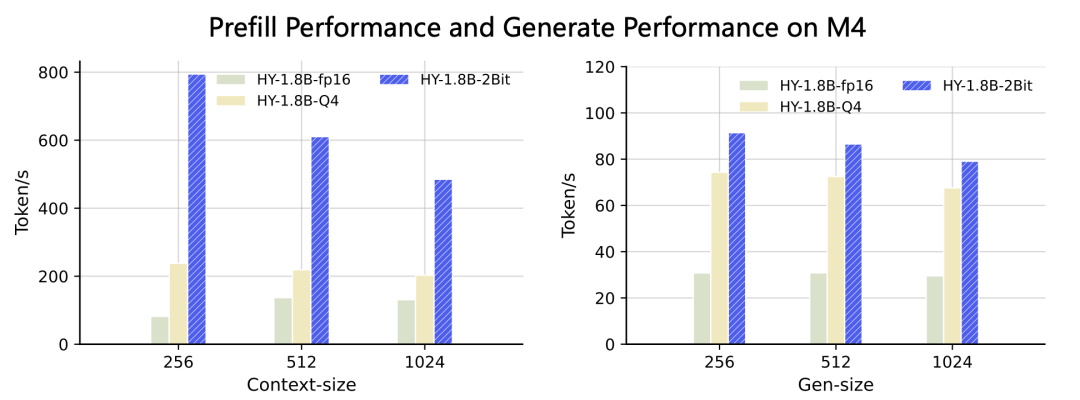

在MacBook M4芯片上,HY-1.8B-2Bit固定了线程数为2测试了不同窗口大小下的首字时延和生成速度,模型选定fp16、Q4、HY-1.8B-2Bit三种gguf格式作为对比,首字时延在1024输入内能够保持3~8倍的加速,生成速度上常用窗口下对比原始模型精度,HY-1.8B-2Bit能够实现至少2倍稳定加速。

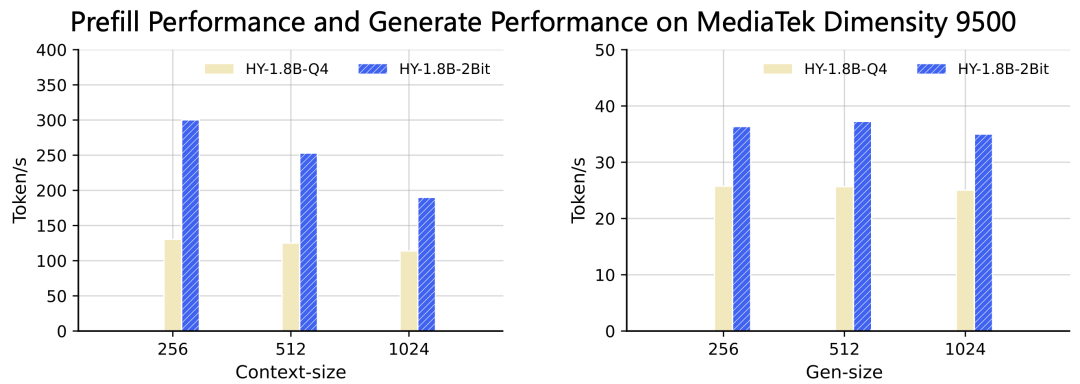

在天玑9500上同样进行了测试,对比HY-1.8B-Q4格式首字时延能够加速1.5~2倍,生成速度加速约1.5倍。

为在边缘设备上实现大语言模型的灵活部署,HY-1.8B-2Bit采用了极低比特量化技术,在保持与INT4-PTQ方法相当模型性能的同时,实现了在端侧设备上的高效稳定推理。

当前,HY-1.8B-2Bit的能力仍受限于监督微调(SFT)的训练流程,以及基础模型本身的性能与抗压能力。针对这一问题,混元团队未来将重点转向强化学习与模型蒸馏等技术路径,以期进一步缩小低比特量化模型与全精度模型之间的能力差距,从而为边缘设备上的大语言模型部署开拓更广阔的应用前景。