根据周二发布的声明,Meta承诺将使用更多来自英伟达的AI处理器和网络设备。同时,Meta还将首次在其独立计算机的核心部件采用英伟达的Grace CPU。此次部署将涵盖基于英伟达当前Blackwell架构,以及即将推出的Vera Rubin设计的AI加速器产品。

Meta公司已同意在未来几年内部署“数百万”英伟达芯片,进一步巩固这两家人工智能行业巨头之间本已紧密的合作关系。

根据周二发布的声明,Meta承诺将使用更多来自英伟达的AI处理器和网络设备。同时,Meta还将首次在其独立计算机的核心部件采用英伟达的Grace CPU。此次部署将涵盖基于英伟达当前Blackwell架构,以及即将推出的Vera Rubin设计的AI加速器产品。

Meta为英伟达营收贡献9%。Meta首席执行官扎克伯格在声明中表示:“我们很高兴扩大与英伟达的合作,利用他们的Vera Rubin平台构建最先进的计算集群,为全球每一个人提供个人超级智能。”

上述协议在AI竞争格局不断变化之际,再次确认了Meta对英伟达的忠诚。目前,英伟达的系统仍被视为人工智能基础设施的黄金标准,为英伟达带来数千亿美元的营收。但竞争对手正在提供替代方案,Meta自己也在开发自研芯片组件。

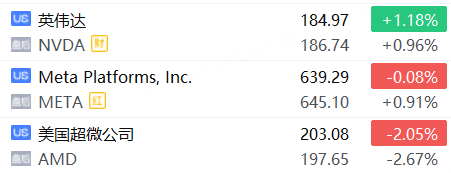

消息公布后,英伟达与Meta的股价在盘后交易中均上涨近1%,而英伟达劲敌AMD股价下跌近3%。

英伟达加速计算副总裁Ian Buck表示:

双方并未公布具体的投资金额或时间表。他指出,Meta等公司测试其他替代方案是合理的,但他强调,只有英伟达能够提供一个希望在AI领域保持领先地位的公司所需的完整组件、系统与软件生态。

与此同时,扎克伯格已将AI设为Meta的最高优先级,承诺投入数千亿美元建设新一代所需的基础设施:

Meta已预计2026年将创下支出纪录。扎克伯格去年表示,公司将在未来三年内向美国基础设施项目投入6000亿美元。Meta正在全美建设多个千兆瓦级数据中心,包括路易斯安那州、俄亥俄州和印第安纳州。1吉瓦电力大约足以为75万户家庭供电。

Buck强调,Meta将成为首个在独立服务器中使用英伟达CPU的大型数据中心运营商。通常情况下,英伟达会将这类CPU与其高端AI加速器一同提供。

这一举动意味着英伟达正进一步进入原本由英特尔和AMD主导的领域。同时,这也为大型数据中心运营商自研芯片,例如亚马逊AWS所设计的芯片,提供了替代选择。

Buck表示,这类芯片的应用场景正在不断增长:

Meta作为Facebook和Instagram的母公司,将不仅自身使用这些芯片,还将采用其他公司基于英伟达架构提供的计算能力。

英伟达的CPU将越来越多地用于数据处理和机器学习等任务。

CPU有许多不同类型的工作负载。我们发现,Grace是一款非常优秀的数据中心后端CPU,也就是说,它擅长处理后台计算任务。在这些后端工作负载上,它实际上可以实现每瓦性能提升两倍。