本文来自微信公众号: 腾讯科技 ,编辑:徐青阳,作者:苏扬,题图来自:视觉中国

Anthropic向中国大模型发难,是为了打击对手,还是别有商业目的?

2月24日,Anthropic在其官网发布内容,称DeepSeek、Moonshot和MiniMax三家人工智能企业试图窃取Claude的功能以改进其自身模型,并强调上述企业通过约24000个账户与Claude进行了超过1600万次交互,违反其服务条款和区域访问限制。

所谓的区域访问限制,可以追溯到2024年5月,Anthropic旗下Claude相关模型停止对中国大陆地区支持,随后2025年9月更进一步,限制向中资关联方提供服务。

更早之前,Anthropic CEO Dario Amodei还曾呼吁禁止美国芯片出口中国以限制中国AI发展。

北京大学新闻与传播学院教授胡泳将Dario Amodei的这种“不友好”概括为人工智能民族主义,“以前有技术民族主义,现在有人工智能民族主义。”

“OpenAI一开始就不开放中国大陆接口,不让你用,奥特曼连香港、澳门都不去,但最赤裸裸敌视的还是Anthropic。”一位长期关注科技政策的研究员说。

Anthropic指责中国大模型对Claude模型进行蒸馏,意图贴上“抄袭”的标签。

所谓蒸馏,简单来说就是用大模型对话的输出,来当小模型训练的教材,这项技术由“AI教父”杰弗里·辛顿2015年提出。

Anthropic认为,蒸馏是一种广泛使用且合法的训练方法,但强调可能会被用于非法目的:竞争对手可以利用它,以极低的成本和极短的时间,从其他实验室获取强大的功能,而独立开发这些功能则需要花费更多的时间和精力。

“蒸馏本身没啥,大家相互借鉴,你既然敢开放使用,就不要怕用你的回答当数据,”一位学术界研究员强调用大模型来获取数据是行业惯例,“对于闭源模型来说,既然你不公布代码,我也可以用指令微调学习黑盒的经验。”

一名知名研究机构的研究员也表示,没有什么(有效的)方法确定蒸馏的情况,现在大家都互相这么做。

不过需要注意,即便Anthropic强调24000个账户与Claude进行了超过1600万次交互,也不能直接证明DeepSeek、Moonshot这些企业利用了上述交互获取的知识,实质上用于了大模型训练。

在此之前,DeepSeek就曾回应过OpenAI指控的蒸馏问题,强调V3模型的训练数据都来自于网页和电子书,但也表示相关网页上包含了大量OpenAI模型生成的答案,可能会导致基础模型间接受益于其他强大模型的知识。

也就是说,DeepSeek不否认使用了带有OpenAI模型推理的知识进行训练,但这些数据都来自于网页,不是其主动“蒸馏”的行为。

“现在这个时代,某个网页不是OpenAI官方的但里面有截取的部分对话,这很难避免。”前述学术界研究员补充说。

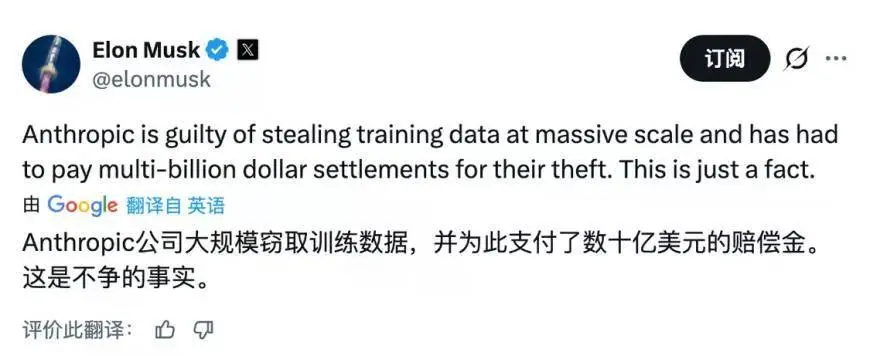

马斯克调侃Anthropic“偷”数据

Anthropic给中国大模型贴“抄袭”的标签,社交网络上却出现了不同的声音。马斯克在X上转发用户评论时调侃,“他们竟敢‘偷窃’Anthropic从人类程序员那里偷走的东西?”

上述被点名的企业中的一位不愿具名的人士说,“可以看看海内外反应,Twitter评论区还挺正常的,可能大家比较反感Anthropic。”

用户调侃“问大模型训练数据来源”是不礼貌行为

和马斯克一样,一位用户在评论区中贴了一张梗图,将“问女性年龄”,“问男性薪资”,“问AI公司的训练数据从哪里来”列为不礼貌的行为,暗示大模型训练数据来源之谜。

“(来源)太多了,互联网上的都有可能,大家现在都说互联网数据用得差不多了。”前述学术界研究员强调。

前OpenAI联合创始人、SSI创始人Ilya Sutskever在NeurIPS 2024大会上也表达过类似观点,Ilya认为预训练时代即将结束,数据作为AI的化石燃料是有限的。

从这个角度来看,所有模型公司都在“燃烧”互联网数据以喂养自家基座模型,同样还是马斯克,更是不留情面的批评Anthropic“窃取”数据,并为此赔了数十亿美元的赔偿。

回到“蒸馏”这件事情上,融力天闻律师事务所高级合伙人翁才林在“OpenAI质疑DeepSeek‘蒸馏’”时就曾强调,需要从合同法、著作权法、不正当竞争角度来看“蒸馏”的问题。

翁才林认为,即便使用协议明确禁止“蒸馏”,也可能存在提示义务不足导致协议无效的问题,且协议即便有效,还需要举证中国大模型的行为造成的实际损失。

然而就像前文所述,1600万次的调用很难直接认定为与“蒸馏”直接挂钩,这一次Anthropic也很难拿出实锤证据。

而在著作权上,翁才林表示,利用模型输出的数据,通常缺乏人类作者足够的智力贡献,很难被认定受到版权保护,即便达到可版权性的标准,也因为平台将输出内容的权利转让给用户,无法主张著作权侵权。

至于不正当竞争,翁才林强调,仅通过公开API获取输出数据,而非窃取OpenAI内部参数、算法或源代码,则难以认定其存在欺骗、侵犯商业秘密等不正当手段。

“如果OpenAI将合法的蒸馏技术一律禁止,反而可能因其市场支配地位而被认为构成滥用市场优势,阻碍技术创新与自由竞争。”翁才林补充说。

指控中国公司对其模型蒸馏是表象,打击竞争对手才是核心目的,为了实现这一目的,Anthropic甚至为自己披上了国家安全的外衣。

“非法提炼的模型缺乏必要的安全保障,会造成重大的国家安全风险,”Anthropic在新闻稿中写道,“Anthropic一直支持出口管制,以帮助美国保持其在人工智能领域的领先地位。然而,蒸馏攻击却破坏了这些管制措施。”

Anthropic极力将模型竞争与国家安全关联,与最近两届美国政府保持高度一致,“中国大模型第一股”智谱一度因此被纳入实体清单,但智谱则强调称缺乏事实依据。

“这个口径是拜登时期政府提出来的,(Anthropic)他家是去靠这个口径,”美国凯腾律所合伙人韩利杰认为此举既有商业目的,也是营销手段。

“我觉得有两个原因:一个是价值观比较凸显,一个是为了利益。”前述长期关注科技政策的研究员表示,“站队美国政府,拿订单和政策。”

2025年,Anthropic和美国政府达成了多项重点合作,已经成为美国政府的大模型服务承包商。

根据公开资料,2025年6月,Anthropic推出专为国防、情报、执法等敏感场景设计的模型,获得政府合规优先认定。随后7月,与美国国防部CDAO签约,为国防场景开发定制模型、部署涉密网络,订单最高2亿美元。

2025年9月,Anthropic签署白宫《AI安全承诺》《AI教育承诺》,被认定为“符合政府AI安全与伦理标准”的头部企业,获得美国政府采购白名单资格。

不过也需要注意,Anthropic与美国政府的关系并非牢不可破。

当地时间2月23日,美国《国会山》报披露其与美国国防部近期有关在敏感领域的应用已经出现分歧,有可能波及近2亿美元的订单。

事实上,2亿美元的订单,影响对于年化收入140亿美元的Anthropic来说并不算大,更重要的是其高优先级的美国政府承包商这一身份,这对于其未来与OpenAI的竞争以及持续的融资来说至关重要。

就在2月中旬,Anthropic宣布完成总额300亿美元的G轮融资,投后估值达3800亿美元。作为对比,OpenAI正在推动新一轮投后估值8500亿美元的融资。

本内容来源于网络,观点仅代表作者本人,不代表虎嗅立场。如涉及版权问题请联系 hezuo@huxiu.com,我们将及时核实并处理。

End

想涨知识 关注虎嗅视频号!