过去几天,硅谷上演了一出堪比《黑镜》的伦理大戏。

前脚Anthropic刚刚立起“数字贞节牌坊”,发誓不搞“大范围数字监控”和“全自主武器”,公开与美国军方唱反调。

后脚,曾经的非营利组织OpenAI,就火速官宣与国防部首席数字与人工智能办公室(CDAO)达成合作,合同最高金额达2亿美元。

一夜之间,两者的口碑迅速滑向两个极端。

一个成了浪子回头的圣人,一个成为千夫所指、毫无下限的战争贩子。

2月28日,OpenAI宣布与国防部合作当天,卸载量较前一天暴增295%。

截至3月3日中午,ChatGPT美国区累计卸载量已突破300万,一星评价暴涨775%,活跃用户流失超120万。

反观Claude,下载量暴涨51%,直接冲上美国App Store榜首。

美国网民似乎正集体对邪恶进行审判。

但大众毕竟是盲目、甚至愚蠢的,很容易被舆论带节奏。

作为一个旁观者,一名投资者,我们必然要冷静得多。

Anthropic为什么突然硬气?OpenAI为什么突然糊涂?

世界上从来没有纯粹的黑与白。

01 “圣人”溢价

Anthropic肯定不是什么圣人。

它是第一家在美国政府保密网络中部署前沿AI模型的公司,也是第一家为国家安全客户提供定制模型的公司,广泛参与到战争部的情报分析、作战规划、网络行动等核心任务。

为了更多订单,它并不排斥将AI应用于军事。

只不过这次,军方提出了两个“越界要求”。

第一,大规模国内监控。

Anthropic明确表示,支持针对境外的情报工作,但绝不允许Claude用于对美国公民的大规模监控。

有个词叫“数字画像拼接”,简单来说,就是政府可以不用搜查令、从公开渠道购买美国公民的行踪、网页浏览记录、社交关系等零散数据,一旦AI介入,就能自动把这些零散数据拼接成一个人的完整数字画像。

届时,每个人的一举一动都将被严密监控。

这不是简单的隐私问题,而是对公民自由的系统性威胁,天然站在所有人的对立面。

第二,全自主武器。

即把人类完全移出决策环节,由AI自行选择目标、发起攻击。

有别于现在那些虽然有AI辅助、但最终的攻击决策还是由人类做出“部分自主武器”。

为什么要拒绝前者呢?

最大的原因,是现在的AI系统不够完善,根本无法做到“全自主”,有很大概率出错。

而一旦出错,伤亡的就是美国士兵和无辜平民。

届时,Anthropic要承担多大的舆论压力?

显然,这两个要求的任何一个,都是把人架在火上烤。

一旦答应了,以后除了美国军方,不仅民间会自发抵制它,更重要的B端也将被堵死。

从市场策略的角度来看,这叫“道德护城河”。

根据Gartner发布的《2025年企业AI采用报告》,超68%的500强企业在部署大模型时,将“数据隐私与合规性”列为第一考量,远高于“模型性能”。

也就是说,Anthropic在这个节点高举道德大旗,并非因为他们真的是圣人,更可能是在争夺最肥的那块肉:企业级合规市场。

这是很浅显的道理,大型跨国银行或医疗机构敢用一个在民间臭名昭著的模型来处理客户数据吗?

大概率不敢。

Anthropic拒绝美国军方,实际上是在向华尔街和欧洲监管机构(特别是欧盟的AI Act)递投名状。

欧盟AI法案已于2026年1月1日正式生效,2月进入全面执行阶段,其中明确规定,“实时远程生物识别(公共场所)、社会信用评分、全自主武器”等属于禁止类AI,违规企业将被处以全球年营业额6%的罚款。

Anthropic的合规布局,等于顺应全球AI监管的趋势,哪怕拒绝美国军方的合作,它也能在全球市场获得认可。

主要地区已落地关于AI的监管,来源:财通证券

根据Gartner 2026年2月的报告,Anthropic在“伦理合规”方面的用户满意度高达4.8星,远超行业平均的3.6星。

虽然短期内损失了国防部这个8000亿美元的大客户,但却锁死了万亿级的民用合规市场。

所以Anthropic才突然浪子回头,发誓要“做个好人”。

但是,它还是留了条后路:如果军方要换供应商,会配合平稳过渡,确保正在进行的军事行动不受影响。

这再一次说明,Anthropic并非什么圣人,只是懂得趋利避害的企业而已。

当然与OpenAI相比,这的确是“有底线”的表现。

那OpenAI又为什么丢掉底线?

02 无奈之举?

首先,两家公司的定位,从一开始就不一样;其次,OpenAI远比Anthropic缺钱。

Anthropic的战略核心是“AI安全+合规差异化”,目标是成为“全球最可靠的AI公司”。

根据其2025年的财报,公司每年在AI伦理和安全上的投入,占总营收的23%,远高于行业平均水平的12%。

同时,短期内,它并没有非常大的资金压力。

根据Crunchbase的行业融资报告,Anthropic于2025年完成了一轮100亿美元的融资。

关键点是什么呢?

谷歌、亚马逊等投资方明确表示,支持Anthropic的“AI伦理底线”,不要求其“短期盈利”。

客户更是如此。

2025年,Anthropic的营收达到45亿美元,同比增长120%,其中B端占比达到60%。这些客户的付费意愿高,粘性强,而且不会要求Anthropic突破伦理底线。

Anthropic收入中60%+来自API,来源:中金公司

反观OpenAI,其战略核心是“规模变现+政企绑定”,目标是成为“全球最大的AI公司”。

怎么才能大?

无非是快速盈利、快速扩张,其它的都是次要的。

但OpenAI现在最大的困境就是,虽然赚钱速度快(2025年营收180亿美元),但烧钱速度更快。

据The Information披露的数据,OpenAI在2025年的训练成本和推理成本预计达到70亿美元,算力基础设施的资本支出更是个无底洞。

2025年,公司全年亏损28亿美元,虽然亏损幅度较2024年收窄,但距离盈利还有很大的距离。

偏偏在这种时候,最大的投资方微软却要求OpenAI在2027年前必须实现盈利,否则将减少甚至停止投资。

如此巨大的压力,导致OpenAI不得不急功近利。

哪里有“利”?

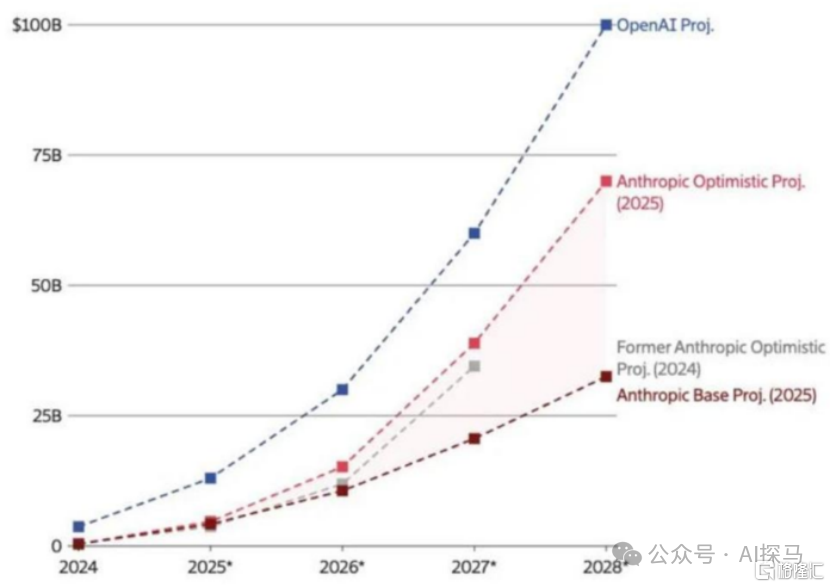

OpenAI与Anthropic收入曲线,来源:The Information

根据FutureSearch 2026年2月的报告,OpenAI的年度经常性收入虽然高达34亿美元,但其中55%来自ChatGPT的C端会员付费,B端API收入仅占15%。

更关键的是,根据SimilarWeb的数据,2026年1月,ChatGPT的C端活跃用户环比增长仅2.3%。

这意味着C端增长现阶段基本见顶了。

极端的结构失衡,让OpenAI急于拓展B端市场,尤其是政企市场(毛利高达68%)。

这方面的最大金主是谁?

毫无疑问是美国国防部。

2025财年,美国国防部的预算申请高达8498亿美元,其中仅用于RDT&E的预算就高达1432亿美元,且以每年18%的速度高速增长。

同时,这里还有一个隐形诉求。

OpenAI 2025年收入中近半来自C端,来源:中金公司

OpenAI计划在2026年底启动IPO,估值目标是1万亿美元。而要实现这个估值,获得美国政府的背书至关重要。

和国防部达成合作,相当于贴上了“官方认可”的标签,这在IPO估值中是很重要的加分项。

而早在一年前,OpenAI就悄悄从使用条款中删除了“禁止用于军事和战争”的字样,如今这只靴子只能说终于落地了。

所以,OpenAI这次选择“拿国防部的钱来补贴民用AGI的研发”,是早有预谋的,在逻辑上也说得通。

但落地在实际中,这毫无疑问是一场灾难。

03 三重暴击

奥特曼显然事先低估了用户的敏感度。

根据Sensor Tower和SimilarWeb的联合数据,截至3月3日13时,ChatGPT美国区的活跃用户较2月28日减少了120万,流失率达到17.6%。

7天留存率也从68%跌到42%,这意味着很多用户卸载后,就再也不会回来了。

最伤的是,OpenAI的品牌好感度从72分(满分100)跌到35分,低于谷歌、Anthropic等同行,甚至被贴上了“战争贩子”的标签。

根据Brandwatch 的最新舆情预测,OpenAI的负面舆情峰值将持续至3月中旬,至少需要3-6个月才能逐渐平息,而且需要投入不低于8亿美元的公关费用,才能初步挽回用户信任。

这笔钱,远高于拿到的国防部订单。

更麻烦的是,据美国司法部3月3日公告,已有12名议员联合提出,将对OpenAI与国防部的合作启动专项伦理审查,审查将于3月10日正式启动。

一旦查实违规,OpenAI将面临巨额罚款,甚至可能被终止合作、纳入国防合作黑名单。

欧盟AI办公室也发布声明,将同步核查OpenAI的合作内容,是否违反欧盟AI法案中“禁止全自主武器相关AI研发”条款。

一旦查实违规,OpenAI将面临全球年营业额6%的罚款,按照2025年180亿美元营收算,罚金高达10.8亿美元。

而且,可能被逐出欧盟市场,这对OpenAI的全球扩张,是致命的打击。

基于这些风险,B端客户也开始动摇了。

据Forrester 的最新调研数据,有37%的美国政企客户,表示“将重新评估与OpenAI的合作”;12%的客户,已经明确表示“将终止与OpenAI的合作”,转而选择Anthropic、谷歌等“伦理合规”的AI公司。

上文也说了,政企客户是OpenAI未来的增长核心,一旦这些客户流失,其盈利的压力可能比现在更大。

按照当前的流失速度,预计OpenAI 2026年Q1的企业业务营收,将环比下降23%,损失超过5亿美元。

损失的钱,同样远超这次拿到的国防部订单。

除此之外,更有一点致命的隐患不得不说。

据Levels.fyi的数据,在硅谷顶级AI研究员的年薪在80万到150万美元之间。

这些人大多不缺钱,他们缺的是“信仰”。

OpenAI的这次举动,不仅仅是自损品牌形象,更是对这些技术人才信仰的亵渎。

这波舆论风暴中,最扎心的一刀来自OpenAI内部,年仅19岁、被视为核心算法团队未来的天才工程师Potato Dog,因反对与国防部合作愤然辞职,转头就加入了Anthropic。

他在离职推文中的大概意思是:“我加入是为了造神,不是为了造终结者。”

再看LinkedIn的职场数据,3月1日-3日,OpenAI的员工离职率较平时暴涨189%,其中伦理团队、AI安全团队的离职率高达37%,大部分人的离职原因都是“与公司价值观不符”“无法接受AI用于军事用途”。

据Blind上的匿名调查,OpenAI的内部士气指数已下降了约15%;人才获取成本则飙升,未来要招到同样水平的天才,可能需要支付20%-30%的溢价。

技术的护城河本质上就是人才储备。

这些人的离去,对OpenAI的长期发展,毫无疑问是致命打击。

因为AI产品具有极强的替代性。

看看目前市面上的竞品:

Claude,主打安全,现在道德光环加身;

Gemini,虽然有这样那样的问题,但至少捆绑在安卓生态里;

Llama 3,开源,不想被监控就自己部署……

如果OpenAI不能及时挽回用户和员工信任,在对手突飞猛进的时候突然慢下来,其市场份额只会被一点点瓜分。

这就不仅是公关危机了,更是估值危机。(全文完)