作者|壹览商业官方账号 李彦

林俊旸在X平台敲下“me stepping down. bye my beloved qwen”的七个单词时,大洋彼岸的硅谷,或许有人能读懂这短短一句话背后的重量。

四个月前,另一位AI领域的标志性人物——图灵奖得主、Meta首席AI科学家杨立昆(Yann LeCun),同样选择离开自己一手建立的实验室。他在接受英国《金融时报》采访时直言,Meta内部已经“完全被大语言模型洗脑了”(completely LLM-pilled)。

两场离职,隔着太平洋,却像同一面镜子的两面。当我们将Meta Llama团队的震荡与阿里千问的人事剧变并置观察,会发现这不仅是两家公司的故事,而是全球科技巨头AI战略转型期的“时代症候”:当AI从技术探索期进入商业变现期,那些曾经被宽容的“理想主义角落”,正在被系统性清扫。

Meta的急转弯

故事要从2025年4月说起。

彼时,Meta发布了备受期待的Llama 4系列模型,包括Scout、Maverick和Behemoth三个版本。在Chatbot Arena基准测试中,Llama 4 Maverick以1417分的高分一度压过GPT-4o,风光无两。

然而,开发者社区的反馈很快让这层光环褪色。用户报告称,Llama 4在处理复杂任务时会产生“完全无用的输出”,推理和编码能力明显落后于竞争对手。

更致命的质疑接踵而至:今年1月,杨立昆在接受《金融时报》采访时首次公开承认:Llama 4的测试结果“被注水了”。团队针对不同的基准测试采用了不同的模型变体,目的是优化分数。

这一事件成为Meta内部AI团队动荡的导火索。杨立昆透露,公司CEO马克·扎克伯格“基本上对所有参与此事的人都失去了信心”,进而将整个生成式AI组织边缘化。

既然内部团队靠不住,扎克伯格选择花钱从外部“买”一个解决方案。2025年6月,Meta宣布斥资约143亿美元收购数据标注公司Scale AI 49%的股份,并聘请其28岁的创始人Alexandr Wang担任公司历史上首位“首席AI官”(CAIO)。随后,Meta成立了“超级智能实验室”(Meta Superintelligence Labs, MSL),将此前分散的研究力量统一收归Wang的麾下。

这意味着,65岁的杨立昆需要向比自己年轻37岁的Alexandr Wang汇报工作。杨立昆在采访中并未掩饰不满:“他没有研究经验,不知道如何进行科研,也不知道科研人员会喜欢什么或不喜欢什么。你不能告诉研究人员该怎么做,尤其不能告诉像我这样的研究人员。”

管理层摩擦很快延伸为技术路线的分歧。Wang上任后,将Meta的AI战略集中在“大语言模型驱动的超级智能”路径上;而杨立昆长期批评大语言模型的局限,主张发展能够理解物理世界的“世界模型”。在新的权力结构下,这一路线逐渐被边缘化。

2025年10月,MSL实施了一项被杨立昆称为“压垮骆驼的最后一根稻草”的新政策:FAIR研究人员在发表任何学术论文之前,必须先将草稿提交给Wang直接领导的核心产品部门TBD Lab进行审查。对于习惯了开放交流、视发表论文为核心价值的科学家们来说,这无异于一种学术自由的剥夺。

随后,Meta AI部门出现大规模人员流动。约600名员工被裁撤,受影响较大的包括FAIR及相关基础设施团队。

与此同时,Meta的开源战略也出现摇摆。据多个媒体报道,公司的最新大模型项目“Avocado”是一款专有模型,与Llama系列的开源路线形成明显对比。知情人士称,推动更封闭策略正是Wang团队的一贯主张。

镜像的另一面:阿里千问的“组织整编”

将视线转回国内,林俊旸的离职剧本几乎如出一辙。

据《晚点Latepost》报道,林俊旸最终选择离开,很可能与Qwen团队正经历的组织调整有关。近期,通义实验室计划将Qwen团队分拆,从涵盖不同训练流程和模态的“垂直整合”体系,变成预训练、后训练、文本、多模态等一个个分开的水平分工团队。林俊旸的管理范围被缩小。

把模型团队拆开、打散的变化,不符合林俊旸对技术趋势的判断。去年至今,他曾多次提及,认为预训练、后训练乃至Infra和训练团队应该更紧密地结合和沟通。

也有行业消息称,林俊旸的离职或与团队内部近期的人事变化有关。阿里近期引入了新的核心研究人员,其中包括曾任Google DeepMind高级研究科学家的周浩。有接近团队的人士透露,周浩是由通义实验室负责人周靖人直接招募进入团队,并与林俊旸爆发了内部冲突。

林俊旸的离职或与Qwen团队所面临的压力也有关系。一方面,Qwen在全球开源社区拥有大量拥趸,全球下载量突破6亿次,衍生模型超17万;另一方面,阿里内部也在持续评估Qwen的成果和价值,其中有对开源模型商业化效率的追问——开源会影响阿里直接通过售卖模型API获得收入。

况且,据上述媒体报道,阿里内部有高管对除夕夜亮相发布的 Qwen-3.5 并不完全满意,称其是一个 “半成品”。

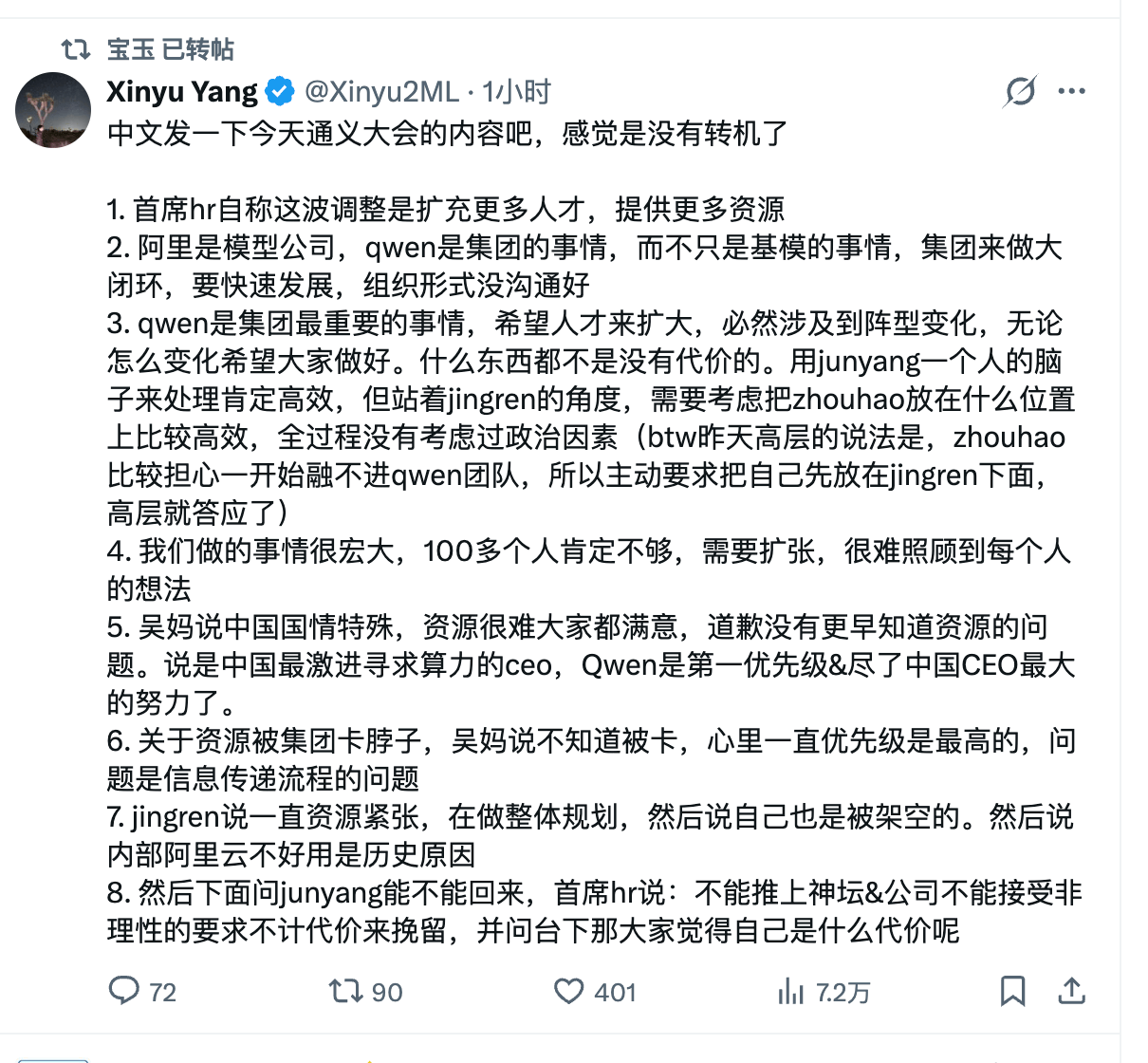

3月4日下午,有博主在X上披露了阿里千问内部大会最新的要点。根据该博主的整理,在会上,阿里方面表示,这一轮调整的初衷是为了扩大团队规模、投入更多资源,并将Qwen从“基础模型团队”升级为整个集团级别的核心项目,未来将以更大规模的人才和资源投入推动模型能力的发展。管理层同时强调,随着团队扩张,组织结构发生变化几乎不可避免。阿里巴巴CEO吴泳铭还表示,对与Qwen资源被集团卡脖子一事并不知情。

针对外界关注的人事问题,会上也提及了近期加入团队的研究人员周浩。管理层解释称,站在周靖人的角度,需要考虑把周浩放在什么位置上会比较高效,全程没有考虑过政治因素。

不过,在问答环节中,有员工直接询问林俊旸是否有可能回归团队。对此,阿里方给出了相当明确的回应:公司不会把任何个人“推上神坛”,也不会为了挽留某一个人而接受非理性的要求。

针对以上信息,林俊旸暂未给出正面回复。仅在今日早些发表朋友圈表示“今天不回复消息和电话了,我真的需要休息”,以及让Qwen的前同事们按照既定安排继续执行。

同一股潮水的两个浪花

将这两起事件并置,我们会发现惊人的结构相似性:

在Meta,杨立昆离职前,Llama 4陷入“刷榜”丑闻;在阿里,林俊旸离职前,内部有高管对除夕夜亮相发布的Qwen-3.5并不完全满意,称其是一个“半成品”。

在Meta,28岁的Alexandr Wang空降接管所有AI研究与产品部门;在阿里,组织架构从“垂直整合”拆分为“水平分工”,林俊旸的管理范围被缩小。

在Meta,约600名FAIR等“旧秩序”团队员工被裁;在阿里,林俊旸、郁博文、惠彬原等早期核心成员相继离开。

在Meta,Avocado模型可能转向闭源;在阿里,开源战略同样面临商业化重估的追问。

杨立昆在采访中警告:“很多人已经离开,很多还没离开的人也会离开。”这句话放在阿里语境中,同样成立。

技术理想主义者们往往有着相似的选择。杨立昆离开后创立了AMI Labs,专注于他心心念念的“世界模型”。前Meta FAIR团队研究总监田渊栋也拒绝了大厂的橄榄枝,宣布创业。林俊旸的去向同样值得期待。

谁在清扫“理想主义角落”?

这不仅是两家公司的故事,而是全球大厂AI战略的“时代症候”。

当AI从技术探索期进入商业变现期,那些曾经被宽容的“理想主义角落”正在被系统性“整编”。大语言模型的Scaling Law边际效益递减,迫使巨头们从“模型有多强”转向“模型能干什么”的追问。开源社区的影响力无法直接转化为财报上的收入,技术理想主义者的存在空间被不断挤压。

杨立昆与林俊旸的离开,本质上是同一股潮水的两个浪花。他们身后的组织,都在用各自的方式回答同一个问题:当技术红利期收窄,公司需要的是能将80分技术卖出100分价值的“商业操盘手”,还是追求100分技术的“极致工匠”?