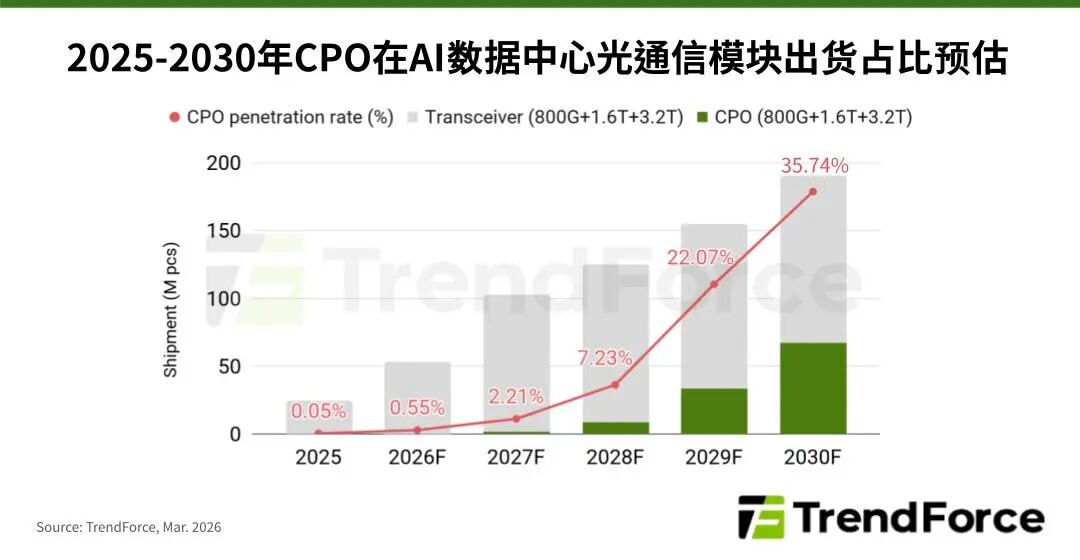

智通财经APP获悉,根据TrendForce集邦咨询最新高速互连市场研究,NVIDIA(英伟达)下一代的AI算力柜架构显示,未来GPU设计重心将转向更高密度的芯片互连,以及更高速的数据传输,机柜内芯片互连(Scale-Up)及跨机柜的大规模互连(Scale-Out)将成为规划数据中心的核心课题。使用铜缆的传统电气传输方案,受物理限制无法应对超大规模的数据搬运需求,光学传输方案因此获得发展空间。TrendForce集邦咨询预估,CPO(共同封装光学)在AI数据中心光通信模块的渗透率将逐年成长,有机会于2030年达35%。

依照NVIDIA NVLink 6的传输通信协定,其定义单通道400G SerDes的极速,以及单颗GPU拥有3.6 TB/s的带宽极限。在极端的高频传输速率下,铜缆方案电信号随传输距离增加而衰退的情况加剧,导致可用距离被严格限缩在一米内。

然而,当芯片互连规模放大,Scale-Up串联规模从单一机柜扩展至跨机柜(如NVIDIA八组NVL72组成之576 GPU集群),铜缆方案将无法应付需求。此外,光学传输具备WDM(波分复用)技术,能利用多种波长在单一光纤内大幅提升传输密度,是铜缆传输无法企及的优势。因此,各大云端供应商(CSP)正携手新创公司研发各项光学传输方案,为将来更大的带宽需求作准备,也替CPO技术的渗透与成长前景奠定基础。

产业龙头深化布局,算力基础建设对光学技术依赖将加深

观察NVIDIA近年在CPO与硅光技术的策略,在半导体封装端,NVIDIA通过TSMC(台积电)COUPE 3D封装技术,堆栈逻辑与硅光芯片,并利用硅光芯片上的200G PAM4微环调变器(MRM),兼顾小体积与低功耗,提升光引擎的整体带宽密度。

NVIDIA近日也宣布分别投资Lumentum与Coherent各20亿美元,并签署多年度采购承诺,以及先进激光、光学产品的优先供货权。此举显示NVIDIA开始针对Scale-Up光互连的关键零部件预先做战略储备,将深度参与激光与光学元件研发,意味未来的算力基础设施将更依赖光学技术。

TrendForce集邦咨询预期,基于硅光与CPO的光互连技术,将率先导入在NVIDIA Rubin 世代机柜间数据传输的Scale-Out,并规划将光互连整合至未来的Scale-up互连架构中,以实现更高的带宽密度。据TrendForce集邦咨询估计,2026年用于AI数据中心的光通信模块中,CPO渗透率仅约0.5%。随着硅光与CPO封装技术逐渐纯熟,跨机柜的Scale-Up光互连数据传输最快将于Rubin Ultra或Feynman世代开始出现。在数据传输带宽不断提高的情况下,TrendForce集邦咨询预估至2030年左右,硅光CPO于AI数据中心的渗透率有机会达到35%水平。同时,新型态的光互连与Optical I/O等光学技术也可能陆续出现。