在当今激烈的全球AI竞赛之中,除了AI大模型的较量之外,AI基础设施的竞争亦是核心焦点。

Gartner预测,到2026年,全球AI总支出将攀升至2.52万亿美元,其中构建 AI 基础设施的支出增长率高达49%。当AI大模型参数量进化到万亿规模、算力集群规模攀升至万卡乃至十万卡,用户“算力焦虑”与AI集群算力利用率(MFU)低下形成极为尖锐的供需矛盾时,如何提升AI基础设施的协同效率就成为整个产业界亟待突破的一道“难题”。

而解决这道“难题”的本质在于提升数据在计算、存储与网络间流转和处理效率,让数据不断突破极限跑得再快一些。为此,中科曙光发布首款全栈自研400G无损高速网络--scaleFabric,同时结合超级隧道等技术,构筑起“存算传一体化”紧耦合架构,为AI集群提供高效、安全、稳定的数据供给。

AI基础设施步入强协同阶段

近年来,AI基础设施的发展脉络逐渐有迹可循。自从AI大模型爆发,迅速带动算力等AI基础设施建设的兴起。随着最近几年完成阶段性的建设之后,AI基础设施又迎来了一个新的关键阶段:政府工作报告首次提出要发展超大规模智算集群等新基建,而如何将AI集群庞大的算力资源充分发挥出效能,从而满足用户迫切的需求和进一步推动AI发展,成为当下行业面临的现实问题。

在曙光信息产业(北京)有限公司总裁助理、分布式存储产品部总经理石静看来,当前AI基础设施在计算、存储与网络三个层面主要面临着以下核心挑战:

其一、AI集群的规模在持续扩张,在堆砌大量AI算力之后,算力效能成为制约整个AI发展的瓶颈所在。中国信息通信研究院报告显示,大模型训练的算力需求大约每3.5个月就会翻一番,这意味着万卡级别甚至更大规模的AI集群未来会越来越多,且亟待充分释放算力的能效。

其二、与数据密切相关的存储,需要更好地匹配算力需求,充分协助算力将效能发挥出来。

其三、如果是算力是AI时代的内核、数据是仓库,那么网络就是脉络。随着AI集群规模持续增加,网络层面的“通信墙”正在成为成为制约AI集群性能的突出挑战,网络性能是影响AI集群效率的关键变量。“AI集群的网络性能越来越重要。现在很多新建集群,基本都过渡到400G网络。”曙光信息产业(北京)有限公司scaleFabric产品经理纵瑞博介绍道。

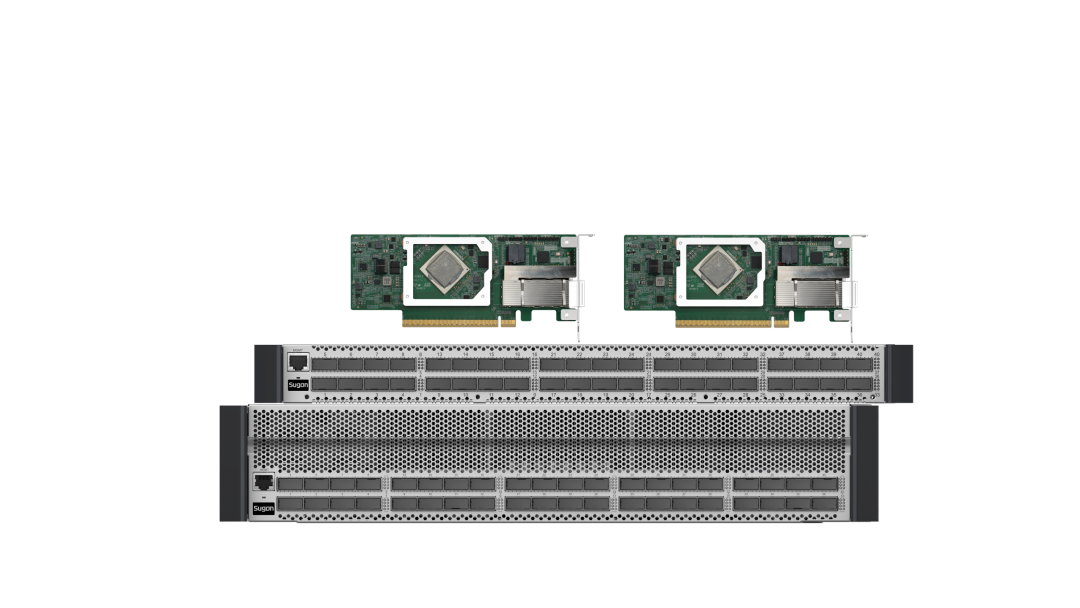

事实上,中科曙光发布的国内首款原生无损RDMA高速网络scaleFabric,即是针对当下AI集群愈发突出的网络性能挑战。据悉,scaleFabric面向超大规模智算集群设计,中科曙光从核心关键IP、芯片、网卡到交换机、驱动与管理软件均实现自主研发,构建起scaleFabric从硬件到软件的完整技术体系。

毫无疑问,随着AI快速发展带来对于性能的持续需求,除了局部突破性能瓶颈之外,AI基础设施作为一个整体的重要性愈发关键,需要计算、存储和网络形成一体化、高效协同,“AI基础设施步入紧耦合、强协同的新发展阶段,只有这样才能让用户的投资建设回报率最高。”石静如是说。

算存传一体化离不开这个法宝

如果说scaleFabric相当于将数据中心网络从国道升级到超级高速公路,那么曙光分布式存储“超级隧道”技术则赋予了这条高速公路的智能化调度能力,可以根据AI集群的不同IO类型来设计路线,设计出一条条专属数据通道,让数据沿最优路径高速流动,有效减少网络拥堵和资源竞争,从而串联起计算、存储与网络,实现AI基础设施的一体化和高效协同。

事实上,AI对于数据存储有着高性能、高带宽、低时延的显著需求。此外AI的预训练、推理等不同工作负载的IO特征又有着明显差异。例如,在预训练阶段的数据加载,需要短时间完成海量数据的顺序读取;训练阶段的Checkpoint则需要大量的并发读写;而越来越多的推理任务,则对于小IO的随机吞吐要求更高……

因此,“超级隧道”技术的设计思路在当前很有必要。那么,曙光存储是如何实现“超级隧道”技术,并且让其与自研RDMA高速网络scaleFabric深度适配、协同工作的?

石静介绍,“超级隧道”技术在硬件层面为各数据域配置独享的RDMA网络连接和PCIe通道,并通过NUMA亲和性优化资源分配;在软件层面实现线程、内存与存储资源的绑定调度;同时通过软硬件协同优化设计,来实现数据高速流动最优化路径,从而实现计算、存储与网络的一体化,并持续为AI计算提供稳定的数据负载支撑。

具体来看,“超级隧道”技术充分利用了RDMA高速网络的高性能和低延时的特点,利用独有的虚拟网卡技术虚拟出多个小网卡,既实现了不同数据的链路均衡保障,又让资源得到隔离,使得不同数据链路之间互不干扰和争抢资源。

传统做法是针对计算、存储与网络之间每一笔联接都先分配好内存等资源,这种模式不够灵活,一旦AI集群规模提升、业务应用快速增长,尤其是当前智能体涌现趋势下,推理业务呈现出爆炸性态势,海量的数据联接很容易耗尽宝贵的基础设施资源,并形成性能瓶颈。

“超级隧道”技术赋予了数据传输的动态化和智能化。在确保基本服务启动的情况,“超级隧道”技术为每一个联接灵活分配资源,既能够快速确保每一个联接启动起来,还能根据联接流量大小变化来动态分配内存等资源,确保了整个数据中心数据流转与传输的高效。

在石静看来,“超级隧道”技术这项法宝之所以能够在存算传一体化中发挥重要作用,得益于中科曙光坚持多年的全栈自研战略,在硬件层基于国产化组件构建,在软件层面拥有完整源代码,实现基础架构与软件栈的全面自主可控,为存算传高效协同提供了坚实基础,完美支撑起AI工作负载的需求。

实战验证,让数据跑得更快

技术在纸面上的优美,终究需要在AI现实世界繁杂业务中经过洗礼。

今年2月在国家超算互联网核心节点,3套scaleX 万卡超集群同时上线试运行,成为了中国首个实际投运的最大国产 AI 算力池,这正是中科曙光存算传一体化紧耦合、强协同架构的最佳证言。

据悉,凭借原生RDMA网络的零门槛部署优势,这3套scaleX万卡集群从交换机上电到应用上线,仅用时36小时。超集群已经历近1年的稳定测试,服务作业逾10万个,性能、扩展性和稳定性均经受了考验。

实际应用中,超集群依托RDMA高速网络+超级隧道技术,各类应用均获得了效能的大幅提升。例如,助力某气象模拟客户将应用性能提升达到2倍左右、支撑国内顶级科研团队将蛋白质研究效率提升3-6个数量级等。

此外,国内主流大模型厂商也在scaleX 集群中验证了RDMA高速网络+超级隧道技术的优势,其预训练的数据准备、训练阶段的Checkpoint以及推理等AI全链路环节均实现了高性能支撑。“一套存储即支撑起该客户训推场景的全业务流。”石静补充道。

无疑,RDMA高速网络+超级隧道技术对于对多样化工作负载的兼容和支撑能力,未来将会为“算存传一体化”架构带来更加广阔的应用前景。

综合观察

未来的数据中心,将是一个以数据为中心、计算、存储、网络深度融合的有机体。只有消除数据流动的一切障碍,才能将算力的价值最大化。

在 scaleFabric 发布之前,中国在高性能网络领域几乎是一片空白。广大客户只能在性能卓越但封闭的国外方案与兼容性好但时延较高的传统以太网方案之间艰难权衡 。

如今,曙光分布式存储超级隧道技术与scaleFabric紧密结合,补齐了国产AI 基础设施版图上的最后一块拼图,构建起AI基础设施领域完整的国产化技术闭环,推动着中国人工智能产业向着更深邃、更辽阔的星辰大海进发。