梦晨 henry 发自 凹非寺

量子位 | 公众号 QbitAI

英伟达GTC 2026很不寻常,黄仁勋迟到了15分钟。

今年有450家企业赞助、1000场技术分会、2000位演讲者、110台机器人,这样的规模已经不像一场技术会议,更像AI行业的年度朝圣。

皮衣老黄站在舞台中央,接受了新称号“Token之王”。

这次他没有直奔芯片发布,而是花了整整一个小时,从25年前的GeForce游戏显卡讲起,讲到20年前的CUDA,讲到10年前的RTX渲染技术,讲到云计算合作伙伴,再讲到今天的爆火OpenClaw和token经济。

AI从感知到生成到推理再到执行,每一步都需要生成更多token,消耗更多算力。

所有这一切铺垫,只为引出一个数字:

英伟达到2027年营收预计至少达到1万亿美元。

去年GTC上,我看到了5000亿美元的高确信需求。今年,站在同一个舞台上,这个数字变成了1万亿美元,覆盖Blackwell和Rubin到2027年的订单。

而且我确定,实际需求会比这更高。

就在这个瞬间,与现场观众的掌声和欢呼声一同高涨的是英伟达股价。

Token工厂经济学:老黄教全球CEO看一张图

只有英伟达的Keynote,你才会看到去年的slide再出现一次。

而老黄称这是全球CEO都要仔仔细细研究的一张图。

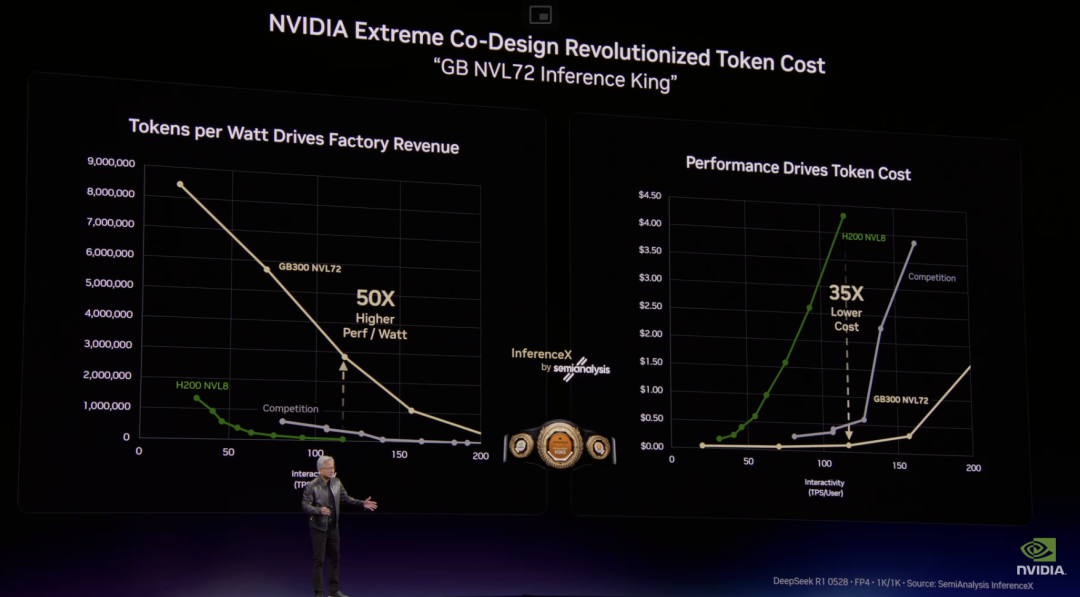

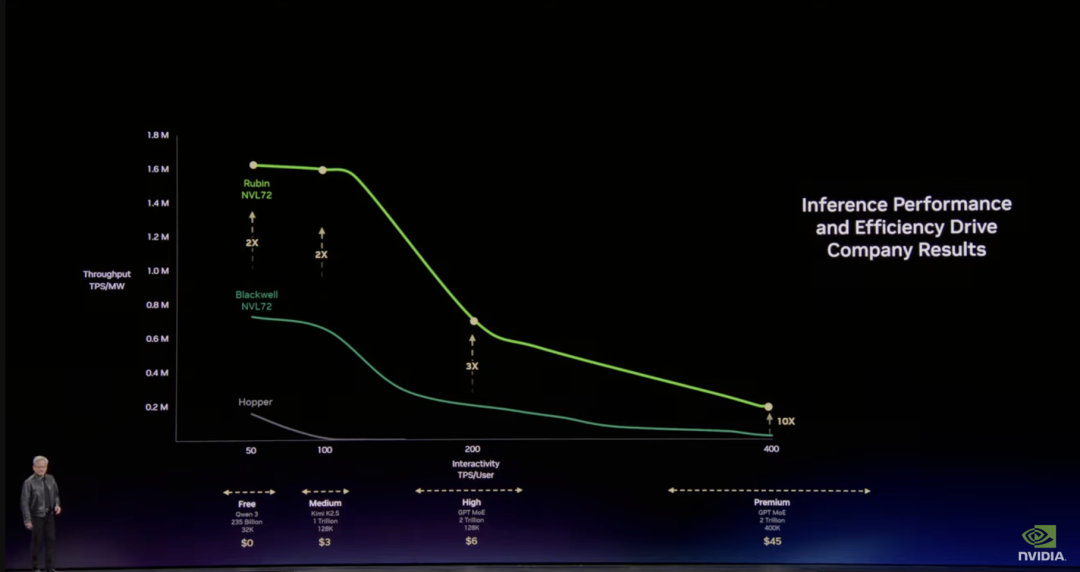

纵轴是Token吞吐量(每瓦产出多少Token),横轴是Token速率(每秒生成多少Token)。

吞吐量代表你的工厂产能,速率代表AI的“聪明程度”,模型越大、上下文越长、思考越深,速率就越低,但每个Token越值钱。

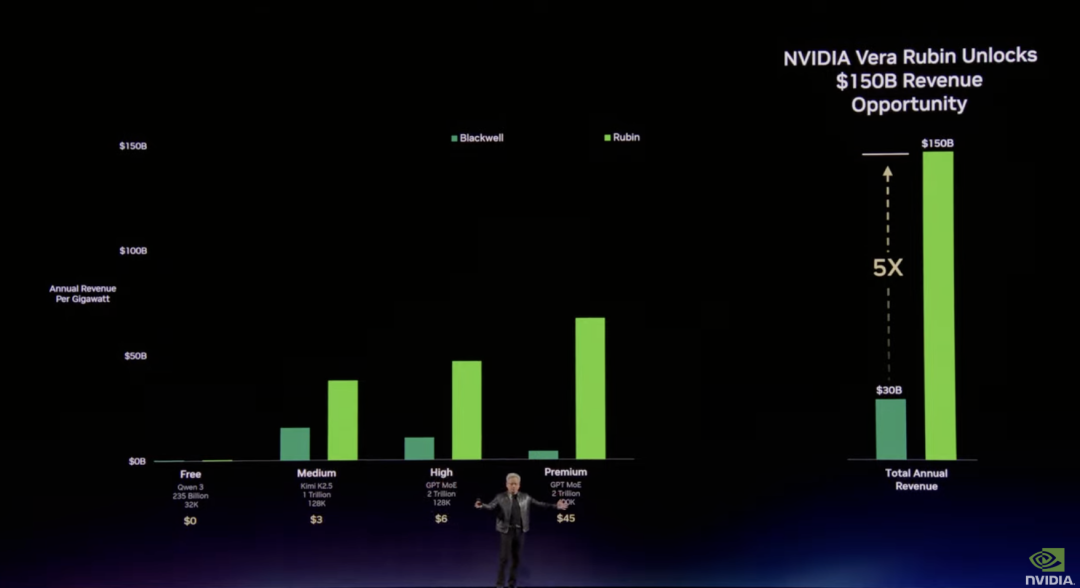

老黄把这张图变成了一套完整的商业模型。

免费层:高吞吐、低速率,用来获客。

中间层:$3-$6/百万Token,服务普通用户。

高级层:$45/百万Token,大模型深度推理。

顶级层:$150/百万Token,超长研究任务、关键路径实时响应。

去年Semi Analysis做了一次有史以来最大规模的AI推理基准测试。结果显示,Grace Blackwell NVLink 72的每瓦token吞吐量,比上一代Hopper H200高出50倍。

而黄仁勋自己说说的35倍。对此,Semi Analysis创始人公开表示:“黄仁勋在sand bagging(故意保留余地)”。

老黄说没错,我就说故意的,实际是50倍,

每瓦性能决定了一切。

因为每座数据中心的功率都是物理约束,一座1GW的AI工厂永远不会变成2GW。在固定功率下,谁的每瓦token产出更高,谁的token成本就更低。

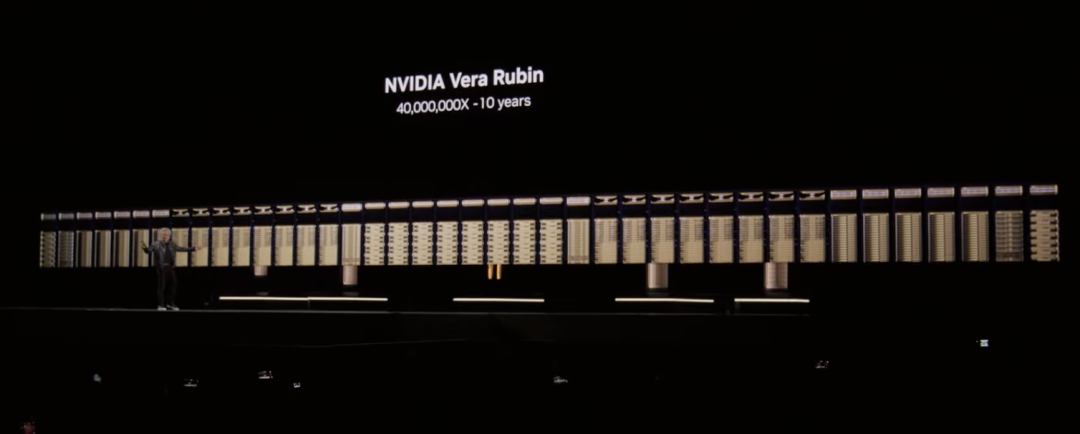

这就是Vera Rubin存在的理由:

作为下一代计算平台,再次将每瓦token吞吐量提高2-10倍。

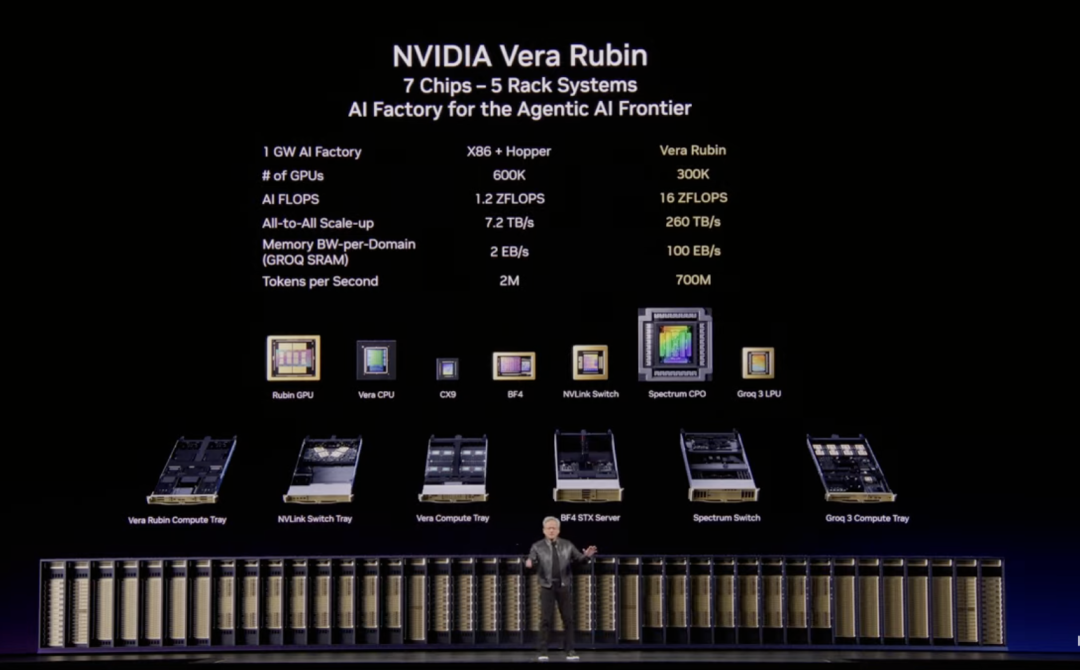

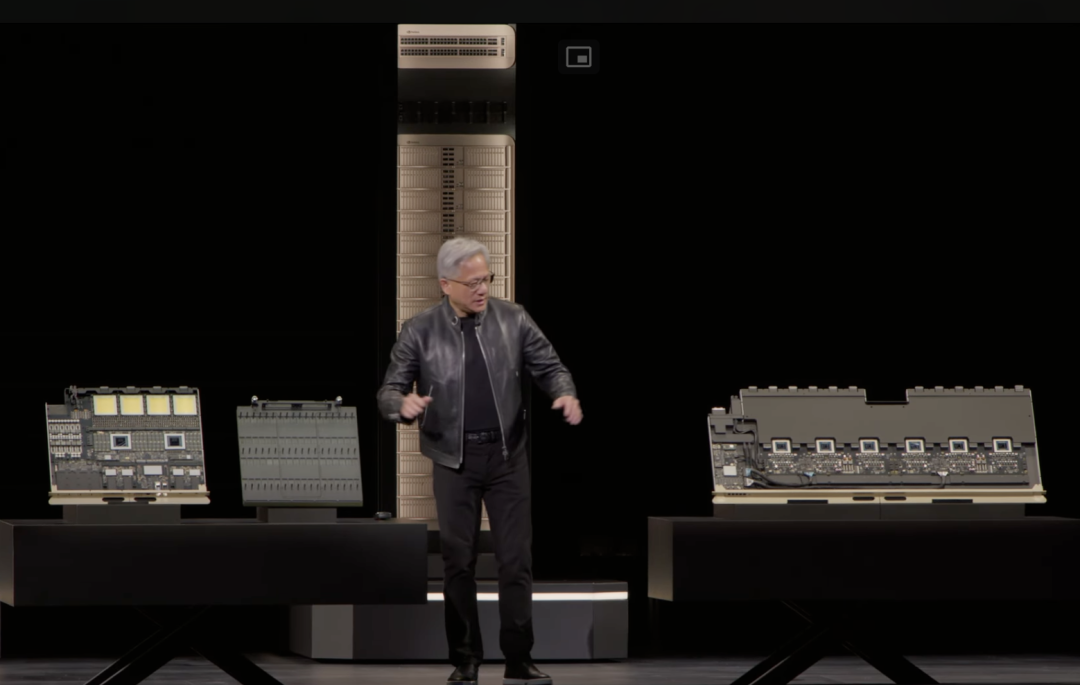

Vera Rubin:十年千万倍加速

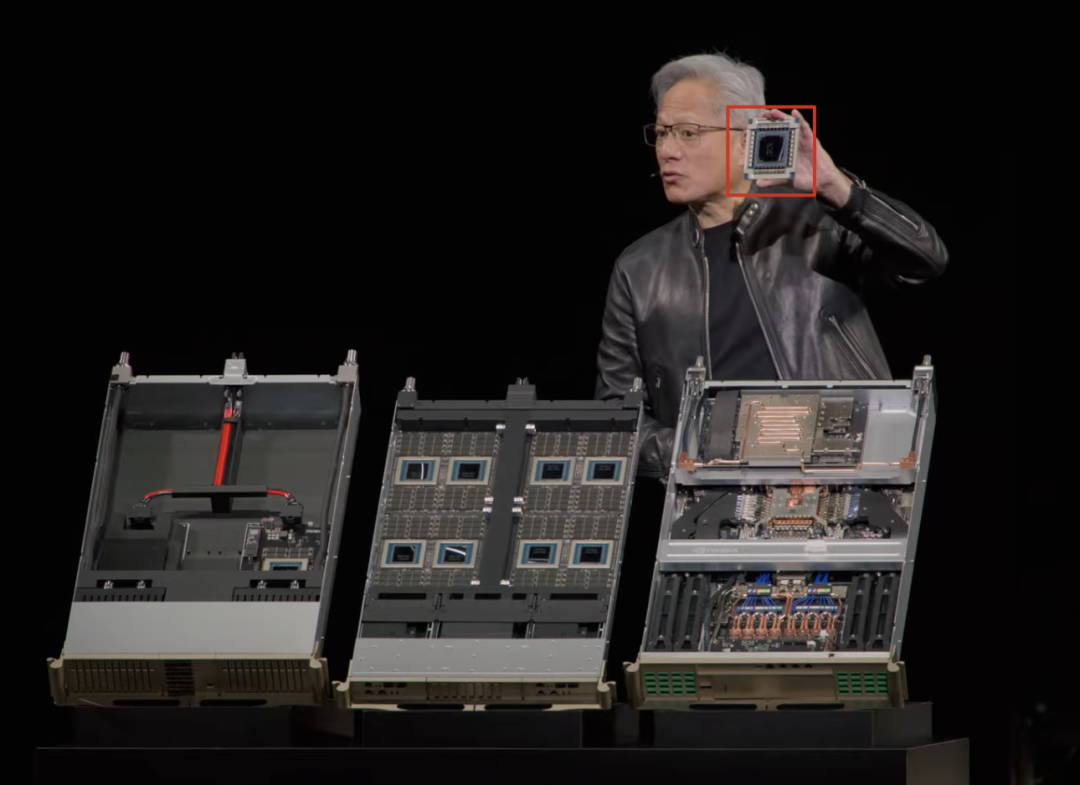

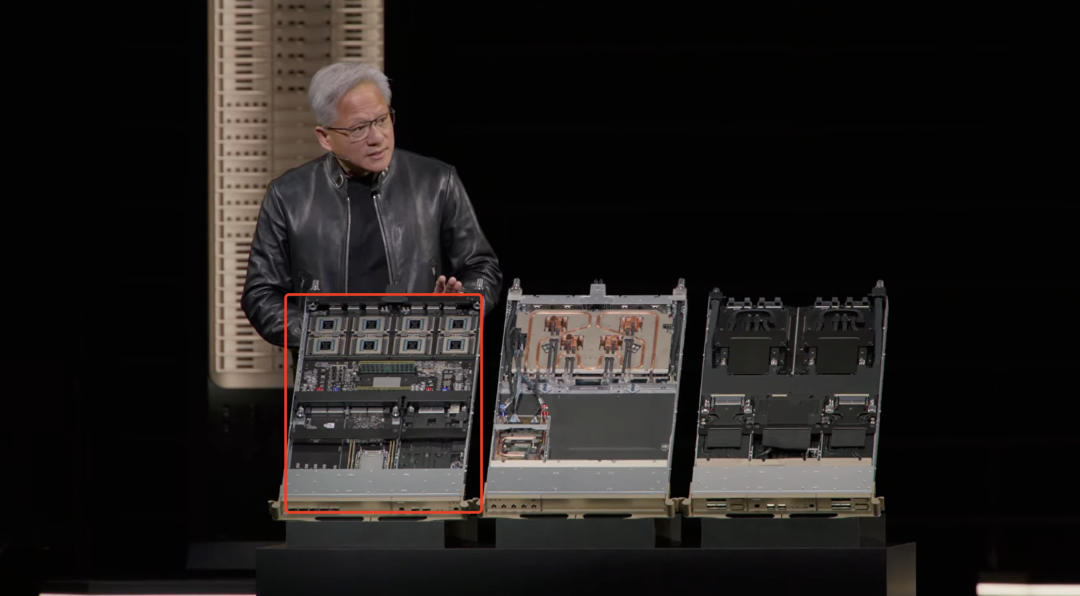

Hopper时代老黄还会举起一块芯片秀给观众看,但那个时代已经结束了。

去年我说Hopper的时候,会举起一块芯片,那很可爱。

但这是Vera Rubin,当人们想到Vera Rubin,人们想到的是整个系统。

Vera Rubin是英伟达有史以来最复杂的AI计算系统。

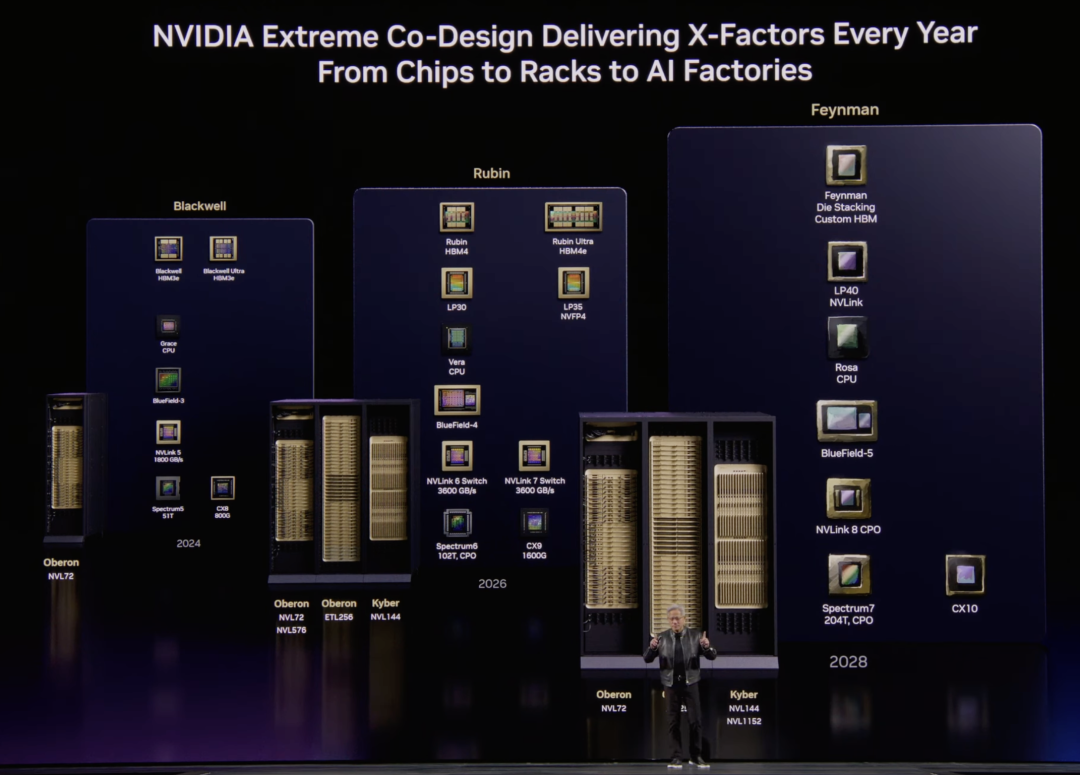

7种芯片,5种机架,垂直集成、端到端优化成一台巨型计算机:

Rubin GPU:

全新架构,支持NVLink 72全互联,3.6 exaflops算力,260TB/s全对全带宽。

Vera CPU:

全新数据中心CPU,全球唯一采用LPDDR5的服务器处理器,单线程性能和能效比出色。老黄原本没打算单独卖CPU,但Vera卖得太好,这已经确定是一个数十亿美元的业务了。

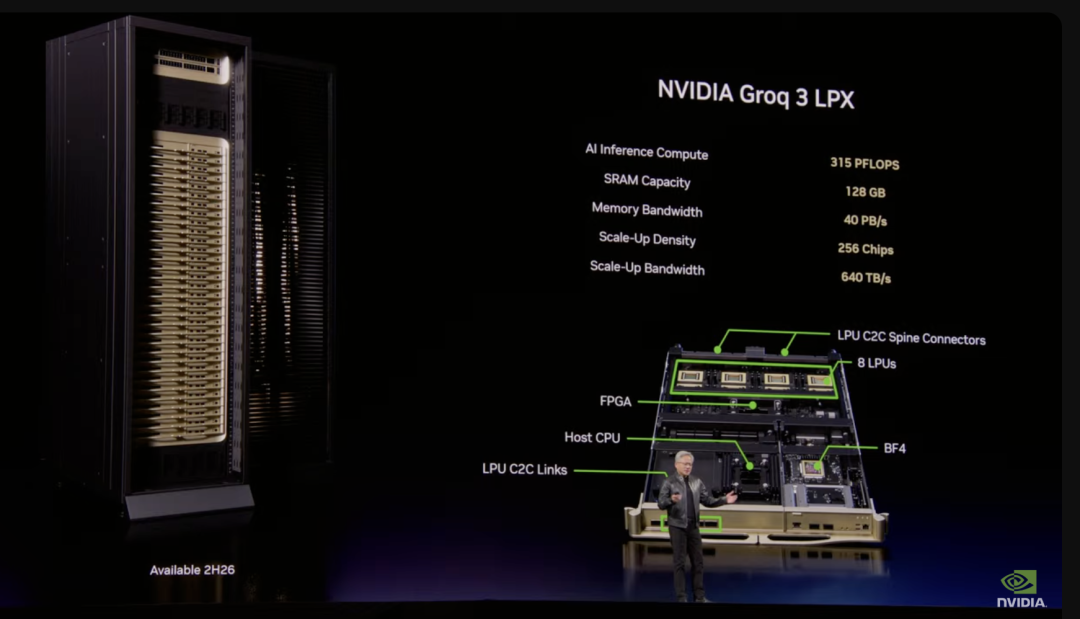

Groq LP30:

世界上从未见过的第三代芯片,500MB片上SRAM,确定性数据流处理器,静态编译、软件调度,专为推理而生。

BlueField 4 DPU + CX9网卡:

全新存储平台,共同构成了面向AI原生的全新存储基础设施。

NVLink Switch:

第六代NVLink交换芯片,提供大规模MoE模型所需的快速、无缝的GPU到GPU通信

Spectrum X CPO交换机:

全球首款量产的共封装光学(Co-Packaged Optics)交换机,电子直接转光子。

在同一座1GW数据中心里,从Grace Blackwell到Vera Rubin + Groq,token生成速率从200万跳到7亿。‘

两年时间,350倍。

摩尔定律在同样的时间里能给多少?大约1.5倍。

350倍不是靠芯片上多塞几个晶体管实现的。当算力密度卷到这个程度,瓶颈早就转移到了芯片之外:散热和互联。

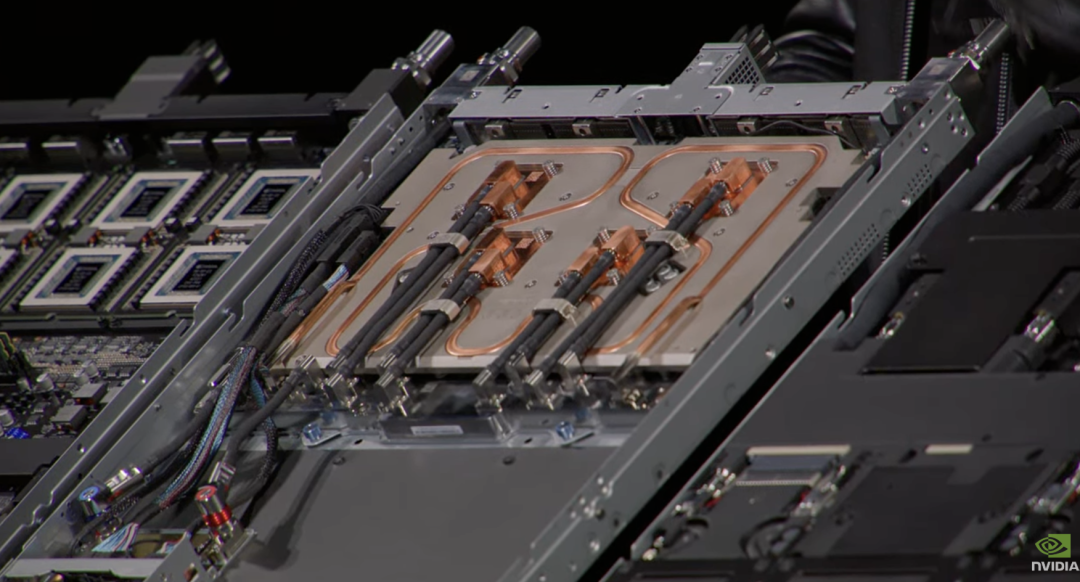

Vera Rubin的答案是两大变化,一个关于水,一个关于光。

关于水,Vera Rubin采用100%液冷方案,连NVLink交换机都泡在液冷系统里。

互联不再靠外部线缆,而是在液冷模块内部做板级/背板式集成互联。

线缆全部消失了,过去安装一个机架要两天,现在两小时。

关于光,黄仁勋举起了世界首款量产的CPO(共封装光学)交换机。

传统交换机里,电信号从芯片出来,经过PCB走线,到达光模块,在光模块里完成电-光转换,再通过光纤传出去。每一次转换都有延迟,每一段铜线都有损耗。

CPO把这条链路压缩到极致:光学器件直接封装到芯片上,电子在硅片表面就转换成光子。 没有光模块,没有铜线中转。英伟达和TSMC联合发明了一种叫CoUP的封装工艺,目前全球只有英伟达在量产。

要让72块GPU实现260TB/s的全对全带宽,如果还用传统铜缆,信号跑不了太远,机架尺寸就是物理极限。

CPO打破了这个限制,光子跑得更远、损耗更低、能效更高。

但铜缆和光学不是二选一。

黄仁勋被问了太多次这个问题,干脆一次说清:

我们都要,我们需要更多的铜缆产能,更多的光芯片产能,更多的CPO产能。

十年前的DGX-1,8块Pascal GPU,170 TFLOPS。

十年后的Vera Rubin NVLink 72,3.6 ExaFLOPS。

十年,算力增长四千万倍。

高吞吐的归Rubin,低延迟的归Groq

但还有一个问题没解决。

NVLink 72在高吞吐区间几乎无敌,72块GPU全对全互联,带宽拉满。

可一旦要求的不是400 token/秒,而是1000 token/秒的极速推理,NVLink 72的带宽就不够用了。

这就是Groq的故事。

英伟达在2025年底收购了推理芯片公司Groq,后者以“LPU”(Language Processing Unit)著称。

Groq的架构和英伟达GPU截然相反:它是一颗确定性数据流处理器,静态编译、编译器调度,没有动态调度,片上堆了500MB的巨量SRAM,只干一件事,推理。

此前业界一直猜测英伟达会如何整合这项资产。

答案来了:不是替代GPU,而是与GPU协同。

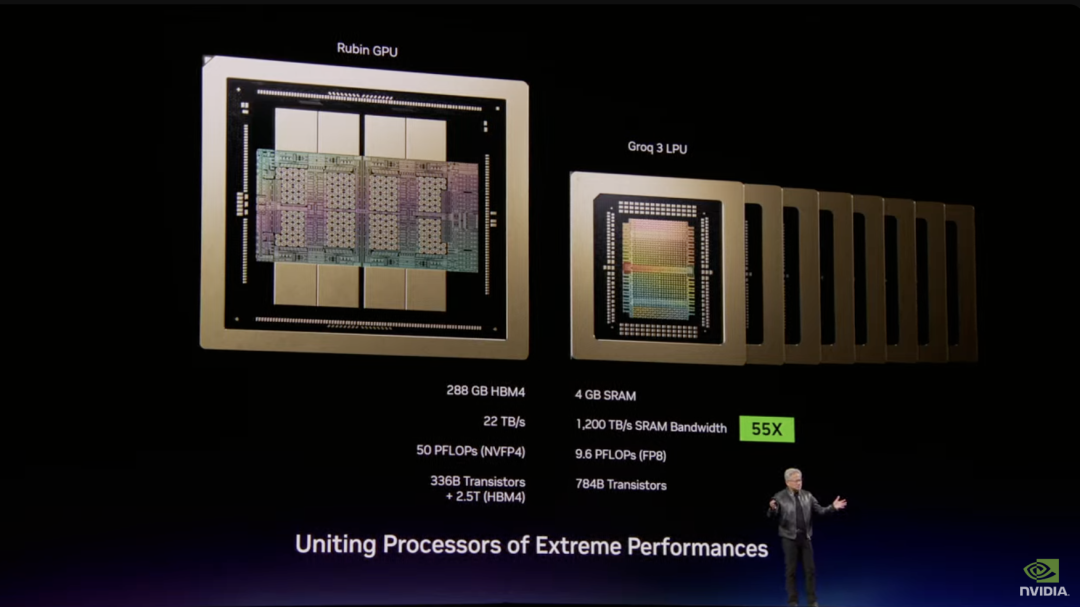

一颗Groq芯片4GB SRAM,一颗Rubin芯片288GB HBM。

前者极致快,后者极致大。单独用Groq,装不下万亿参数模型和海量KV cache;单独用Rubin,推不到极速token生成。

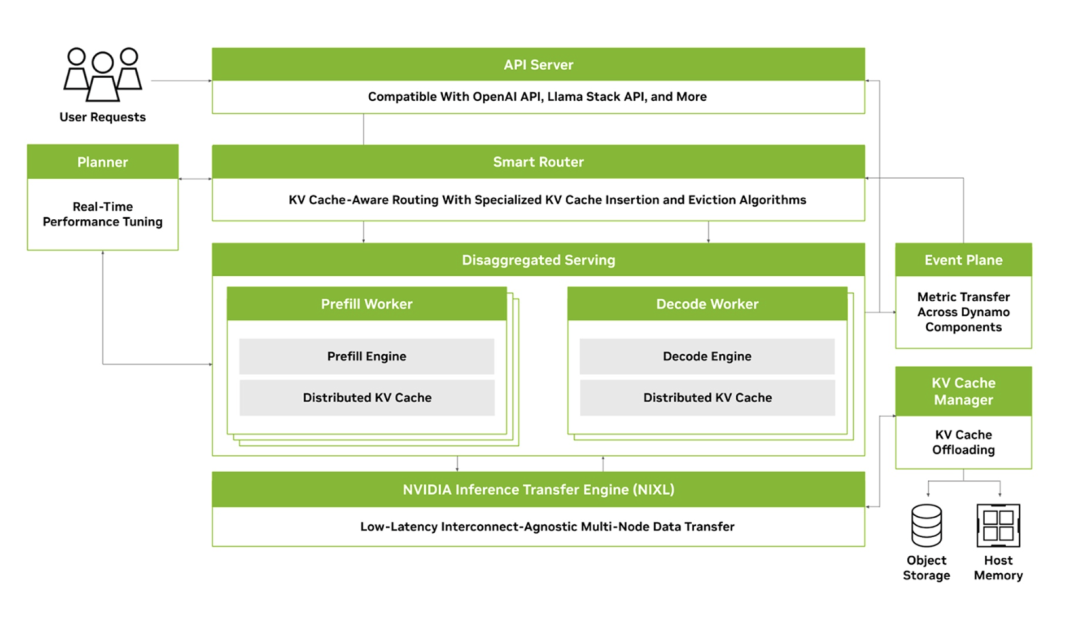

英伟达的解法是分离式推理,用Dynamo推理框架把流水线拆开。

Pre-fill和attention的计算量大,交给Vera Rubin;decode阶段的token生成对带宽敏感、对延迟敏感,卸载给Groq。

两颗极端不同的处理器,通过以太网紧密耦合,延迟减半。

结果在最高价值的推理层级上,再提升35倍吞吐量。同时解锁了此前根本不存在的新推理层级,千token/秒级别的极速生成。

黄仁勋给出了配比建议:如果你的工作负载主要是高吞吐,100%上Vera Rubin就够了。如果你有大量编程、工程级token生成需求,拿出25%的数据中心功率给Groq。

Groq 3芯片由三星代工,已经量产,预计Q3出货。

而Vera Rubin的首个机架,已经在微软Azure云上跑起来了。

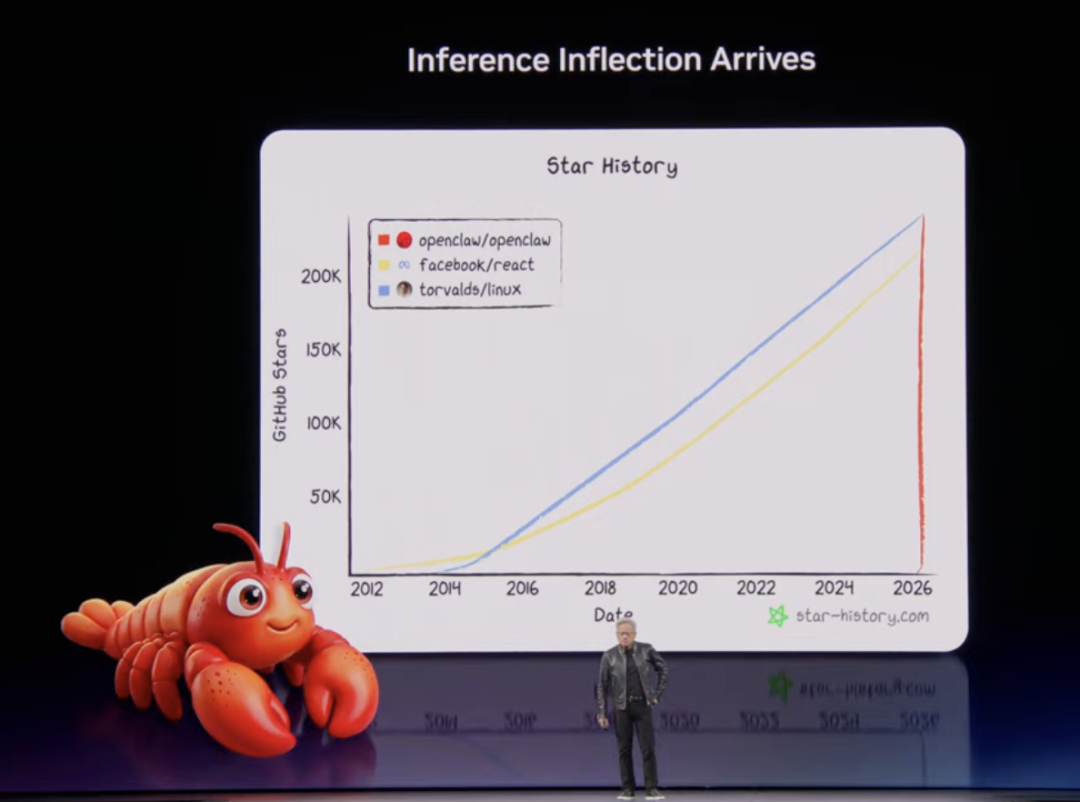

OpenClaw:AI时代的Linux时刻

发布会的最后一部分,老黄画风一转,开始聊人类历史上最受欢迎的开源项目OpenClaw。

OpenClaw能做什么,老黄举例有人帮60岁的父亲自动化了整个精酿啤酒生意,蓝牙连接酿造设备,自动生成销售网站,顾客可以直接下单“龙虾拉格啤酒”。

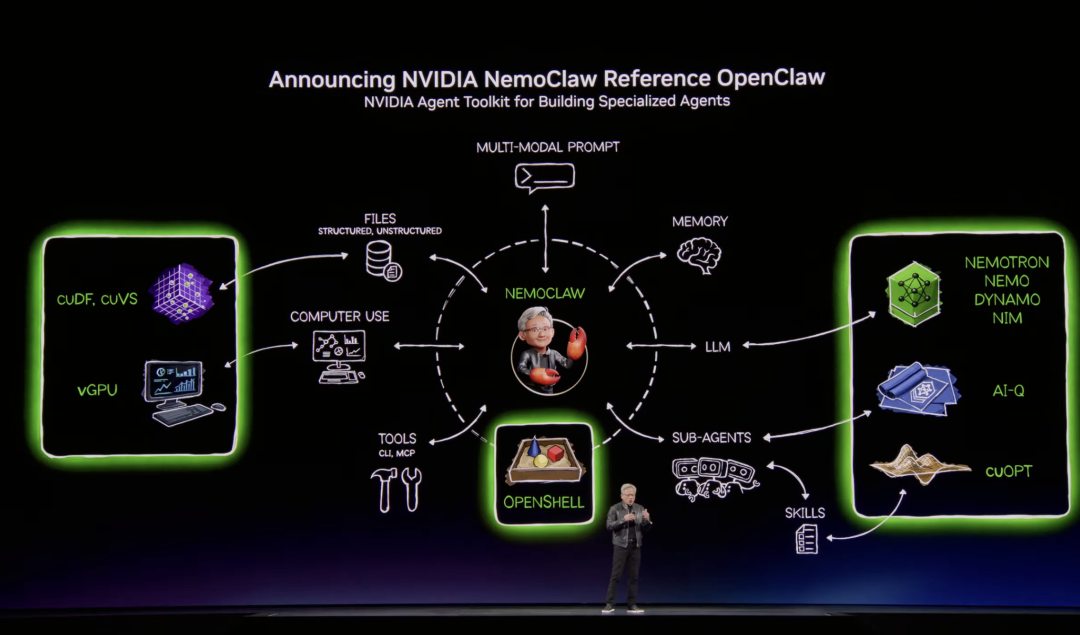

但老黄更在意的是它的本质。他用操作系统的语言重新定义了OpenClaw:

资源管理: 可以调用大语言模型、访问文件系统、使用工具。

调度系统: 能做cron jobs、分步执行、生成子Agent。

I/O系统: 多模态输入输出,你可以冲它挥手,它给你发邮件。

OpenClaw开源了Agent计算机的操作系统。就像Windows让我们创造了个人电脑,OpenClaw让我们创造了个人Agent。

Windows→PC时代,Linux→服务器时代,HTML→互联网时代,Kubernetes→云时代,OpenClaw→Agent时代。

每一次平台转移,都催生了一批改变世界的公司。

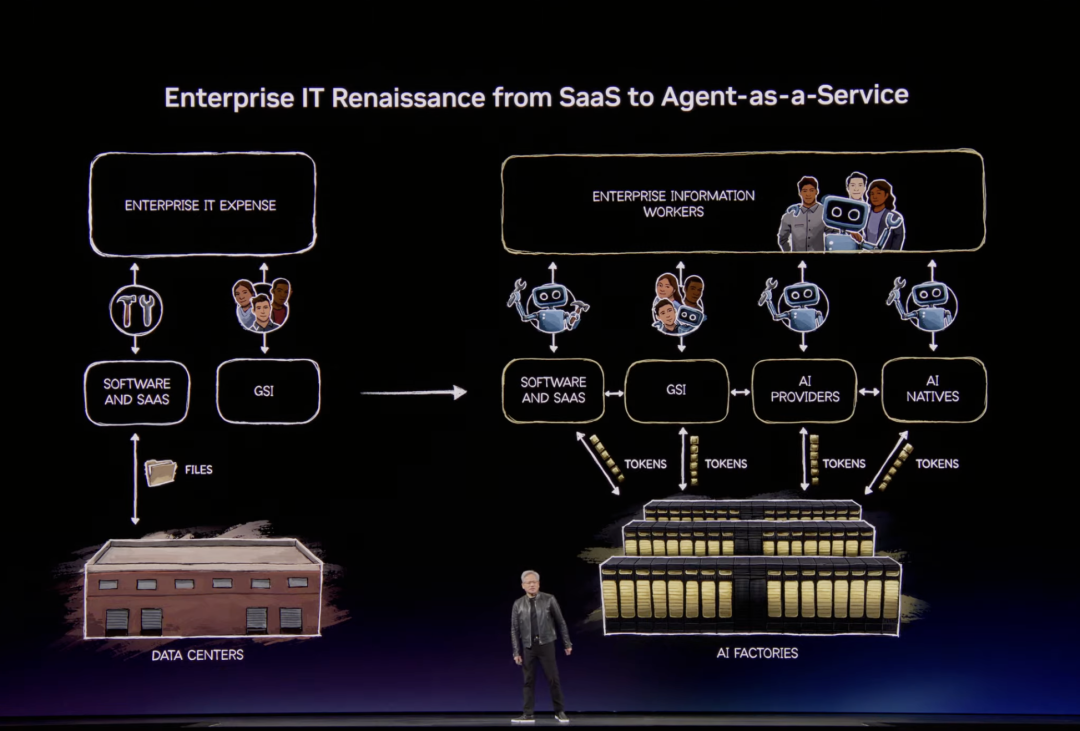

企业IT的全部逻辑即将改写。

老黄直接断言:每家SaaS公司都将变成Agent-as-a-Service公司。

But!

Agent在企业网络中能访问敏感信息、执行代码、对外通信,“你把这三件事连起来大声说出来,再想一想……”

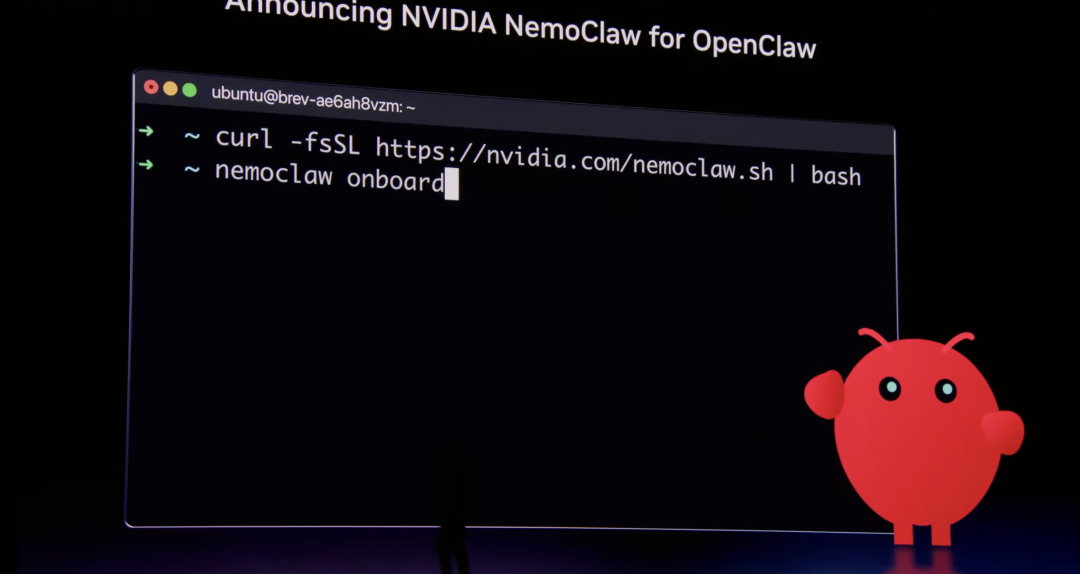

所以英伟达与OpenClaw合作推出了企业版NeMo Claw,加上了策略引擎、网络护栏、隐私路由器。

老黄给出了他对未来企业的终极想象:

未来每个工程师都会有一个年度Token预算。

他们年薪几十万美元,我会在此基础上再给他们一半的金额作为Token额度。

这已经是硅谷的新招聘筹码了:你的offer里带多少Token?

Two More Thing

在发布会上,对于外界备受关注的下一代计算架构Feynman(费曼),老黄也做了预告,并表示计算架构,每年都会有新东西。

Feynman将带来全新的GPU、LPU(LP 40)和CPU Rosa。

新一代的BlueField 5将连接下一代CPU与SuperNIC CX10,并配合新的Kyber技术实现铜线与光学双扩展——

这意味着,Feynman将首次同时支持铜线与光学封装的水平扩展。

老黄强调,无论是铜线、光学还是CPO,未来都需要更高的容量与带宽,这正是Feynman的核心突破。

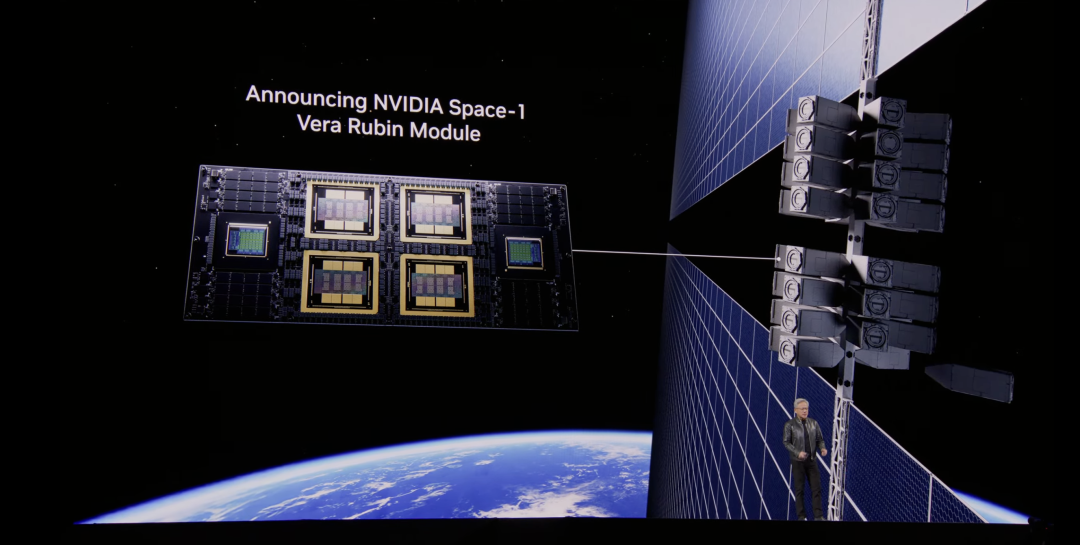

此外,他还透露,NVIDIA 正与合作伙伴联合开发英伟达Space One,一台将部署在太空的数据中心计算机,开启“太空算力”的新篇章。

太空中没有对流,没有传导,只有辐射散热。

我们得想办法在太空里给GPU散热。不过我们有很多优秀的工程师在搞这件事。

把GPU送上近地轨道,这大概是“AI无处不在”最字面意义上的诠释了。

直播回放:https://www.youtube.com/watch?v=jw_o0xr8MWU