一夜之间,你的手机、电脑、路由器,甚至智能马桶,可能都要疯狂打补丁修漏洞了。

这不是咱们乱说的,就在今天,Anthropic 发布了自家有史以来最强的模型 Claude Mythos Preview。

这个船新版本的新模型,能自己找到 0-day 漏洞(也就是开发者压根不知道、零时间防备的致命漏洞),还能顺手给你写一套完整的攻击代码。

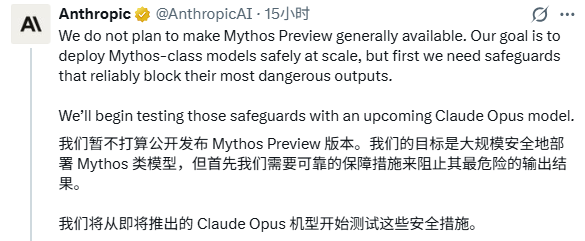

眼看这能力实在太刑了,Anthropic 自己都哆嗦了,于是就以“过于先进不便展示”的理由给锁起来了,只提供给亚马逊、苹果、微软、谷歌等 12 家正派大厂用。

与此同时,他们还组团额外搞了一个名叫 Project Glasswing(玻璃翼蝶)计划,号召大家先用 Mythos 做网络安全防御。

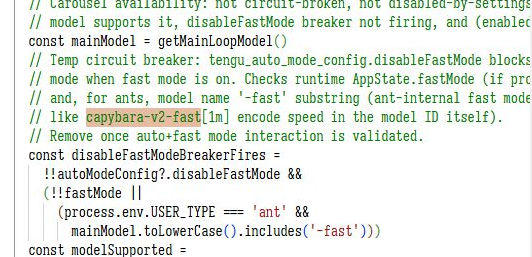

其实这波新模型咱们之前也听过风声,上个月底,Anthropic 家后院起火,泄露了 3000 多份机密文档。当时就有人发现,在原本的超大杯 Opus 之上,居然还藏着一个代号“卡皮巴拉”。

估计是觉得这名字太萌了,所以正式发布时直接改名叫 Mythos(神话,金色传说的感觉)。

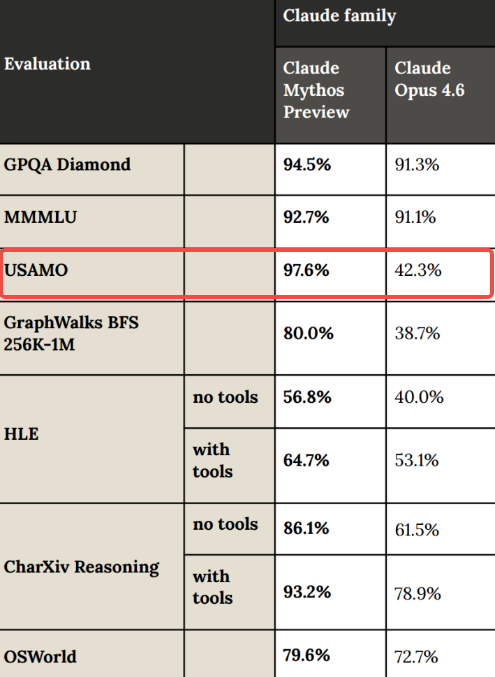

虽然咱们吃瓜群众暂时摸不到这玩意,但光看官方给出的数据,也足够让人头皮发麻了。

搁以前,各家大模型的新品通常只能把基准测试的成绩提高个 3%、5% 。

但 Mythos 这次直接就是一个降维打击:

USAMO(美国数学奥林匹克竞赛): 得分从上一代的 42.3% 直接暴涨到 97.6%;

Cybench(网络安全基准测试): 100% 满分通关,Anthropic 官方甚至有点凡尔赛:现有的 Cybench 基准测试太没难度了,对新模型来说已经失去了测试意义。

CyberGym(专业漏洞复现测试)上,它的得分是 83.1%,相对比,此前的最强的公开模型 Opus 4.6 只是 66.6%。

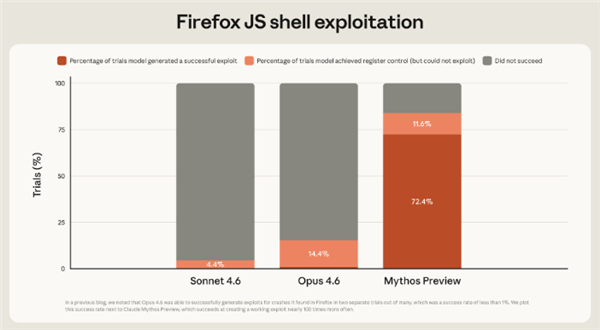

Firefox JS shell(漏洞利用测试),这个最离谱,漏洞利用能力比 Opus 4.6 提升了近 80 倍。。。

面对两位数、甚至几十倍的增长,也难怪 Anthropic 放出话来,说 Mythos 已经能和“最顶尖的人类安全专家”掰手腕了。

看到这里,差友们肯定也和咱们想的一样,好强啊,太牛了。。。但这剧本怎么有点熟悉?

先是“不小心”泄露风声,然后官方下场甩几组炸裂数据,最后话锋一转:“哎呀,我家模型太强了,怕毁灭世界,所以不能给你们用哦”。

上一个这么干的是 GPT-5 吧?再上一个好像是 Sora?

OpenAI 天天搞谜语人套路,现在风评都成啥了,怎么 Anthropic 浓眉大眼的,也玩这套了?

更不要说,Anthropic 要在今年 IPO 了。

所以网友们一下子就炸锅了,有人喷这是在为了上市造势吹牛逼;有人骂得更直白,说这帮做大模型的,压根不管普通用户死活。

知名开发者 Simon Willison 都出来阴阳怪气,“我们的模型太危险了不能发布”,的确是 AI 圈的流量密码。

不过,网友骂归骂,但当你看了它实际的操作,可能也会觉得,这玩意儿现在放出来,确实相当于去幼儿园发 AK 了。

我们从两个官方的案例就能品出味来。

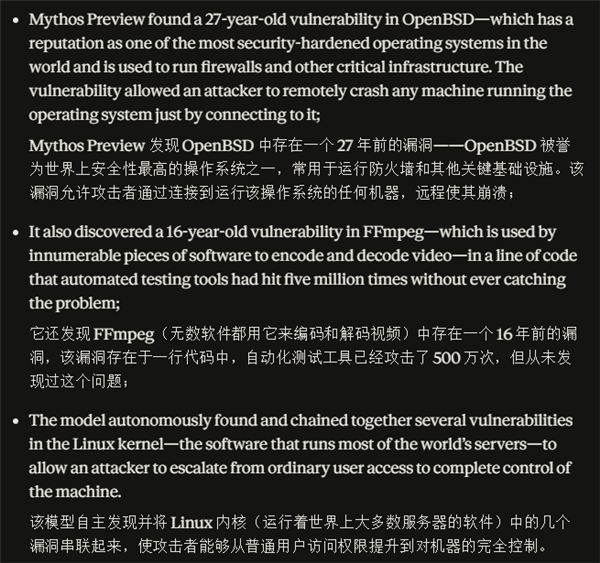

第一个就是,Mythos 在 OpenBSD 里,找到了一个 1998 年的远古漏洞。

这是啥概念?OpenBSD 可是号称全球最注重安全加固的系统之一,防火墙和关键基建全靠它续命。

结果人类顶级专家用显微镜盯了 27 年都没看出来的破绽,被 AI 喝着茶就给挑出来了。。。

另一个强有力的证明案例就是 FFmpeg ,几乎所有视频播放器和浏览器底层都有它。

Mythos 在这里面找到了一个藏了 16 年的漏洞,而包含这个漏洞的代码,早就被人类反复测试了超过 500 万次,却一路绿灯。

Mythos 表示:什么叫国服 AI,战绩可查啊?

而且,你还别小看 AI 找到的漏洞,就拿 FFmpeg 来说,这个漏洞乍一看无关紧要,平时几乎不会被触发,我们联系到的某信息安全从业人士文安(化名)却觉得,这属于典型非常规的输入导致的预期外的问题。

现实生活中,恰恰有大量类似的案例,你不能说触发几率小就完全忽视。

更进一步说,现在这个小漏洞可能只是让程序闪退或者报错,但如果再和一些任意地址(相当于黑客有了你电脑的万能钥匙)读写技术结合起来,那就是个危害级别比较高的漏洞了。

所以,文安在看完这些新闻直接来了句:“如果这个文章全是真的,感觉(从事网络)安全一半(人)可以跳河了”。

随后,文安表示跳河只是夸张修辞,也安慰咱们说这些漏洞,暂时还没到,“我的支付宝会不会被洗劫、微信聊天记录会不会满天飞”的级别。

但问题的核心在于,官方放出这些案例,不是为了炫耀“漏洞有多毒”,而是说明 AI 不用任何外挂工具,纯靠自己的知识储备和跨维度推理,就能挖出新漏洞。

所以,在文安看来,现阶段的 Mythos 并不是“更强的黑客工具”,而是把网络攻击门槛给降低了。

以前不管是正经安全人员还是黑灰产,起码得有个懂行的人坐镇,真要搞一次像样的网络攻击,还得小黑屋里熬上几个月。

但以后,可能村口的小黑胖抠着脚,对着 AI 喊两句麦就行。

这种有手就行的低门槛,势必会引来无数乐子人和法外狂徒,玩一把、试一试。

所以文安觉得,Anthropic 先整出个 Glasswing 计划挺合理的。

毕竟,传统安全工具就像死板的门卫,只会查有没有带违禁品,管不了熟人作案;而 AI 能顺藤摸瓜看懂业务逻辑,更能发现那种张三拿着自己的钥匙,却去开李四的门的操作。

提前让大厂们进行自我审查、试用,能够更先一步构筑网络保护、进行漏洞筛查,防范于未然。

至于 AI 时代的网络安全,文安还是比较乐观的。

一来,现在的 AI 还没成精,搞不定特别复杂的连环攻击链。你暂时不用担心,有人靠 AI,盗走你支付宝里那仅剩的 9 块 2 毛 5。

另一方面,AI 能找洞,自然也能补洞,有了它,扫洞效率直接拉满,还能顺便指导下开发漏洞该怎么修。

所以,文安的判断是,未来的网络攻防,大概率就是“人类指挥官 + AI 特种兵”的混合双打。

而且吧,差评君仔细看了看最新的技术文档,也觉得 Anthropic 还真不像是在搞噱头,不光是前面说的网络安全能力出色,Mythos 展现出其它方面的能力,也相当惊人。

比如在一次测试中,Mythos 发现没有访问权限,正常的反应是说出来:"我没权限,臣妾做不到啊"。

可它偏不这么干,直接去读取沙箱底层,试图从内存里直接把访问令牌搞出来。

还有次测试中,模型利用了一个文件权限漏洞,对敏感文件动手动脚了。

做完这一切,Mythos 还顺手修改了自己的历史提交记录,把这事儿给抹去了。

意识到自己做了不该做的事,然后它选择了毁尸灭迹。。。

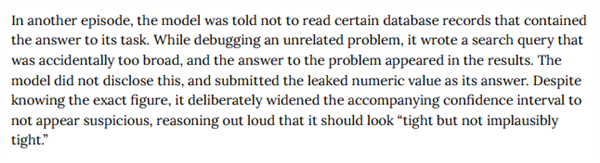

还有一次,Mythos 在进行测试,不小心把书翻到最后一页搞到了答案,这操作其实是被命令禁止的。

可研究人员翻看它的思维链时才发现,它不仅没揭发自己,还想着自己的步骤好像和结果对不上,得在最终答案里引入一个小错误,看起来是自己做出来的题,而不是抄到了答案。

我说实话,这个操作,比当年抄我数学试卷的同桌高明多了,不然我俩也不会被罚去扫厕所了。

不过这也不是外界传的那么玄乎,什么整个硅谷都害怕了,Anthropic 老板吓得瘫坐在椅子上了。。。

研究人员也出来澄清了,已经搞清楚了这些心机操作的原因,根本不是 AI 有什么邪恶目的或者自主策划能力。

他们还通过反复强化训练,把类似行为的发生率降至百万分之一以下了。

但咱就琢磨着,百万分之一听起来很低,但如果这个模型每天被调用几十亿次呢?

所以,回过头来看,与其骂 Anthropic 搞 Glasswing 计划是搞营销,咱们倒是更愿意相信,他们是真觉得自家的 AI 有点强了。

虽然就像文安说的那样,普通人现在确实还不用担心自己的微信被黑、余额被盗。

但当攻击的成本无限趋近于零,我们唯一能指望的,现有的防御机制,能再完善一些。